将自定义 ONNX 模型集成到鸿蒙端侧进行推理

随着人工智能(AI)技术的快速发展,模型推理已经成为现代应用中一个重要的组成部分。在鸿蒙系统中,AI 推理可以通过多种方式进行,其中ONNX(Open Neural Network Exchange)是一个非常流行的深度学习模型交换格式,它能够支持多种框架(如 PyTorch、TensorFlow 等)的模型导出和跨平台部署。将自定义 ONNX 模型集成到鸿蒙端侧进行推理,可以实现高效的本地推理,

👋 你好,欢迎来到我的博客!我是【菜鸟不学编程】

我是一个正在奋斗中的职场码农,步入职场多年,正在从“小码农”慢慢成长为有深度、有思考的技术人。在这条不断进阶的路上,我决定记录下自己的学习与成长过程,也希望通过博客结识更多志同道合的朋友。

🛠️ 主要方向包括 Java 基础、Spring 全家桶、数据库优化、项目实战等,也会分享一些踩坑经历与面试复盘,希望能为还在迷茫中的你提供一些参考。

💡 我相信:写作是一种思考的过程,分享是一种进步的方式。

如果你和我一样热爱技术、热爱成长,欢迎关注我,一起交流进步!

全文目录:

前言

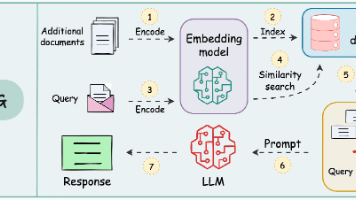

随着人工智能(AI)技术的快速发展,模型推理已经成为现代应用中一个重要的组成部分。在鸿蒙系统中,AI 推理可以通过多种方式进行,其中 ONNX(Open Neural Network Exchange)是一个非常流行的深度学习模型交换格式,它能够支持多种框架(如 PyTorch、TensorFlow 等)的模型导出和跨平台部署。

将 自定义 ONNX 模型 集成到 鸿蒙端侧进行推理,可以实现高效的本地推理,不仅可以减少对云端计算资源的依赖,还能够提高响应速度和减少带宽消耗。鸿蒙系统通过其 HiAI 和 ArkTS 提供了便捷的推理接口,允许开发者将 ONNX 模型加载到设备上并进行推理。

本文将详细介绍如何将 自定义 ONNX 模型 集成到鸿蒙设备上进行推理,包括模型的转换、加载、推理执行以及结果处理。

1. 准备工作

在将自定义 ONNX 模型集成到鸿蒙设备进行推理之前,开发者需要确保以下几项准备工作:

1.1 准备 ONNX 模型

ONNX 是一个开源的深度学习框架互操作格式,支持多种框架(如 TensorFlow、PyTorch 等)的模型导出。在使用 ONNX 进行推理之前,首先需要将训练好的模型导出为 ONNX 格式。

假设你使用的是 PyTorch,可以通过以下代码将模型导出为 ONNX 格式:

import torch.onnx

import torch

import torchvision.models as models

# 加载预训练的模型

model = models.resnet18(pretrained=True)

model.eval()

# 创建一个输入张量

dummy_input = torch.randn(1, 3, 224, 224)

# 导出模型为ONNX格式

torch.onnx.export(model, dummy_input, "resnet18.onnx", export_params=True, opset_version=11)

这个代码会将预训练的 ResNet18 模型导出为 resnet18.onnx 文件。

1.2 准备鸿蒙开发环境

在鸿蒙系统中进行推理操作,开发者需要准备好以下工具和依赖:

- 鸿蒙开发环境:确保安装了 DevEco Studio 或其他支持鸿蒙开发的 IDE。

- HiAI SDK:这是鸿蒙系统提供的人工智能开发工具包,它支持 AI 模型的加载和推理。需要安装 HiAI SDK,并配置好相关的开发环境。

2. 将 ONNX 模型加载到鸿蒙设备

鸿蒙系统支持通过 HiAI SDK 对 ONNX 模型进行推理。要在鸿蒙端进行 ONNX 模型推理,开发者需要使用 HiAI 提供的 API 来加载和执行推理。

2.1 配置 HiAI SDK

在鸿蒙应用中,需要先配置 HiAI SDK。首先,确保你的项目中添加了 HiAI 相关依赖。可以在 build.gradle 文件中加入相关依赖配置:

dependencies {

implementation 'com.huawei.hiai:hiai-onnx:1.0.0'

// 其他必要的依赖

}

2.2 加载 ONNX 模型

在鸿蒙系统中,可以通过 HiAI 的 ModelManager 来加载 ONNX 模型。首先需要将 ONNX 模型文件(如 resnet18.onnx)存放在鸿蒙设备的适当位置。

import { HiAi } from '@ohos.hiai';

// 加载ONNX模型

async function loadONNXModel() {

const modelPath = '/path/to/resnet18.onnx';

try {

const model = await HiAi.ModelManager.loadModel(modelPath);

console.log('ONNX Model loaded successfully');

return model;

} catch (error) {

console.error('Error loading ONNX model:', error);

}

}

在这个代码中,我们使用 HiAi.ModelManager.loadModel 方法加载了一个本地的 ONNX 模型。你需要根据你的设备实际路径替换 modelPath。

2.3 创建输入数据并进行推理

一旦模型加载完成,你就可以使用该模型执行推理操作。在进行推理时,你需要提供合适的输入数据(例如图像数据),并将其转化为与模型兼容的格式。

import { HiAi } from '@ohos.hiai';

// 执行推理

async function runInference(model, inputData) {

try {

const result = await model.predict(inputData);

console.log('Inference result:', result);

return result;

} catch (error) {

console.error('Error during inference:', error);

}

}

在这个示例中,model.predict 方法用于执行推理。你需要将输入数据(如图像)转换为模型可以接受的格式,例如张量(Tensor)。

2.4 处理输入数据

对于 ONNX 模型,输入数据通常需要经过一定的预处理。例如,图像数据需要进行尺寸调整、归一化处理,并转化为适合推理的张量(Tensor)格式。

假设我们需要进行图像分类,可以使用以下方法对图像进行预处理:

import { Image } from '@ohos.image';

// 预处理图像数据

async function preprocessImage(imagePath) {

try {

const image = await Image.load(imagePath);

const resizedImage = image.resize(224, 224); // 调整图像大小

const normalizedImage = resizedImage.normalize(0.485, 0.456, 0.406); // 归一化图像数据

return normalizedImage;

} catch (error) {

console.error('Error during image preprocessing:', error);

}

}

在此代码中,我们通过 Image.load 加载图像,并将其调整为模型所要求的尺寸(224x224)。然后,使用 normalize 方法进行归一化处理,使得图像数据适合模型输入。

3. 模型推理结果处理与输出

推理结果通常是一个张量,需要根据模型的输出格式进行处理。例如,分类任务的结果可能是一个概率分布,开发者需要将其转化为具体的分类标签。

// 处理推理结果

function processInferenceResult(result) {

const predictions = result.getPredictions(); // 获取推理结果

const maxPrediction = Math.max(...predictions); // 获取最大概率的类别

const predictedClass = predictions.indexOf(maxPrediction); // 获取预测类别的索引

console.log('Predicted Class:', predictedClass);

return predictedClass;

}

在这个例子中,getPredictions 方法返回的是模型的预测结果(可能是一个概率分布),我们通过 Math.max 找到最大概率的类别,并返回相应的类别索引。

4. 性能优化与模型瘦身

在设备端进行推理时,性能和内存资源的优化是至关重要的,尤其是在资源受限的设备上。以下是几种常见的优化策略:

4.1 使用 TensorRT 优化推理

鸿蒙支持 TensorRT 对 ONNX 模型进行加速优化,这能显著提高推理速度并减少内存使用。通过将模型转换为 TensorRT 格式,可以优化模型的执行效率,尤其是在具有 GPU 加速的设备上。

4.2 模型瘦身

对于资源受限的设备,可以使用 量化 和 裁剪 等技术进行模型瘦身。通过减少模型的参数量和计算复杂度,能够有效提高推理效率和减少内存占用。

4.3 异步推理

使用 异步推理 可以避免阻塞主线程,提高用户体验。鸿蒙提供了异步接口,能够在后台执行推理任务,并在完成后返回结果。

// 异步推理示例

async function asyncInference(model, inputData) {

try {

const result = await model.predictAsync(inputData); // 异步推理

console.log('Async inference result:', result);

return result;

} catch (error) {

console.error('Error during async inference:', error);

}

}

5. 总结

通过 HiAI 和 ArkTS,开发者可以方便地将自定义 ONNX 模型集成到鸿蒙设备上进行推理。在这一过程中,我们需要进行 模型加载、输入数据预处理、推理执行 和 结果处理。此外,开发者还可以通过 TensorRT 加速、量化 和 异步推理 等方式进一步优化推理性能,确保在不同设备上都能获得良好的用户体验。

通过将自定义 ONNX 模型集成到鸿蒙系统中,开发者能够充分利用设备的计算能力,进行本地推理,减少对云端的依赖,提高响应速度和性能,提供更加高效和智能的应用体验。

📝 写在最后

如果你觉得这篇文章对你有帮助,或者有任何想法、建议,欢迎在评论区留言交流!你的每一个点赞 👍、收藏 ⭐、关注 ❤️,都是我持续更新的最大动力!

我是一个在代码世界里不断摸索的小码农,愿我们都能在成长的路上越走越远,越学越强!

感谢你的阅读,我们下篇文章再见~👋

✍️ 作者:某个被流“治愈”过的 Java 老兵

📅 日期:2025-07-25

🧵 本文原创,转载请注明出处。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)