点积与元素乘法

点积与元素乘法【附一个GPU矩阵乘法运算工具软件Windows版本】

点积与元素乘法

什么是点积?

点积是两个向量之间的数学运算,可产生标量(单个数字)。它通过乘法将两个向量的相应元素组合在一起,然后对结果求和。

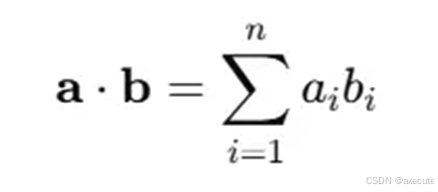

数学定义

给定两个向量 a=[a1,a2,…,an] 和 b=[b1,b2,…,bn],点积计算如下:

关键属性

• 结果始终为标量。

• 它仅针对相同长度的向量定义。

• 点积测量两个向量对齐的程度。如果结果为:

o 阳性: 向量指向相同的大致方向。

o 零:矢量是正交的(垂直)。

o 阴性: 向量指向相反的方向。

实际应用

点积驱动推荐系统和 NLP 等任务,而元素乘法支持神经网络、注意力机制和财务建模中的操作。

• 推荐系统:用于余弦相似度,以衡量项目或用户之间的相似度。

• 机器学习:对于计算神经网络中的加权和至关重要。

• 自然语言处理:帮助测量单词嵌入中的单词相似性,以执行情感分析等任务。

• 神经网络中的元素乘法:用于在训练期间按权重缩放特征。

• 注意机制:适用于 transformer 模型中的查询键值乘法。

• 计算机视觉:用于卷积层,将滤镜应用于图像。

• 财务建模:在投资组合优化中计算预期回报和风险。

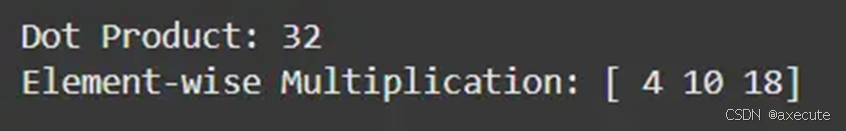

示例计算

设 a=[1,2,3] 和 b=[4,5,6]:

a⋅b=(1⋅4)+(2⋅5)+(3⋅6)=4+10+18=32

什么是逐元素乘法?

元素乘法,也称为 Hadamard 乘积,涉及将两个向量或矩阵的相应元素相乘。与点积不同,结果是与输入具有相同维度的向量或矩阵。

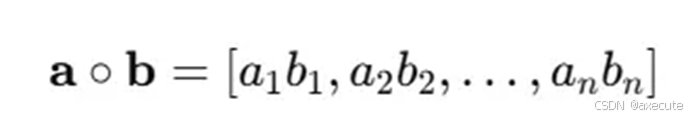

数学定义

给定两个向量 a=[a1,a2,…,an] 和 b=[b1,b2,…,bn],元素乘法为:

关键属性

• 输出保留输入向量或矩阵的形状。

• 此操作要求输入具有相同的维度。

• 它通常用于深度学习和矩阵运算中,以进行特征计算。

机器学习中的应用

点积对于相似性测量、神经网络计算和降维至关重要,而元素乘法则支持特征缩放、注意力机制和卷积运算。

• 特征缩放: 按元素将特征乘以权重是神经网络中的一种常见操作。

• 注意力机制: 在 transformer 中用于计算重要性分数。

• 在 NumPy 中广播: 元素乘法有助于不同形状的数组之间的操作,并遵循广播规则。

示例计算

设 a=[1,2,3] 和 b=[4,5,6]:

a∘b=[1⋅4,2⋅5,3⋅6]=[4,10,18]

点积与元素乘法

点积生成标量并测量对齐,而元素乘法保留维度并执行特征运算。

方面 点积 元素乘法

结果 标量 向量或矩阵

操作 将相应的元素相乘并求和 直接乘以相应的元素

输出形状 单个号码 与输入向量或矩阵相同

应用 相似性、预测、机器学习 特征计算、广播

机器学习中的实际应用

点积用于相似性计算和神经网络计算,而元素乘法则为注意力机制和特征缩放提供支持。

机器学习中的点积

• 余弦相似度:确定自然语言处理 (NLP) 中文本嵌入之间的相似性。

• 神经网络: 在前向传递中用于计算全连接层中的加权和。

• 主成分分析 (PCA):帮助计算降维中的投影。

机器学习中的元素乘法

• 注意力机制: 在 BERT 和 GPT 等 transformer 模型中,按元素乘法用于查询键值注意力机制。

• 特征缩放: 在训练期间应用特征权重。

• 卷积滤波器:用于将内核应用于计算机视觉任务中的图像。

Python 实现

以下是使用 numpy 在 Python 中执行这些操作的方法:

import numpy as np

# Define two vectors

a = np.array([1, 2, 3])

b = np.array([4, 5, 6])

# Dot Product

dot_product = np.dot(a, b)

print(f"Dot Product: {dot_product}")

# Element-wise Multiplication

elementwise_multiplication = a * b

print(f"Element-wise Multiplication: {elementwise_multiplication}")

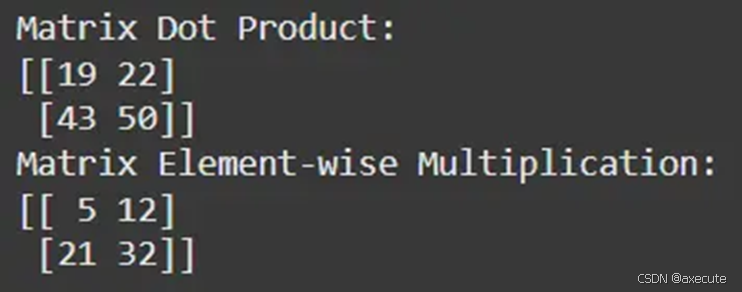

对于矩阵:

# Define two matrices

A = np.array([[1, 2], [3, 4]])

B = np.array([[5, 6], [7, 8]])

# Dot Product (Matrix Multiplication)

matrix_dot_product = np.dot(A, B)

print(f"Matrix Dot Product:\n{matrix_dot_product}")

# Element-wise Multiplication

matrix_elementwise = A * B

print(f"Matrix Element-wise Multiplication:\n{matrix_elementwise}")

结论

了解点积和元素乘法之间的区别对于从事数据科学、机器学习或计算数学工作的任何人来说都至关重要。点积将信息压缩为标量以测量对齐或相似性,而元素乘法则保留输入的形状并执行特征运算。掌握这些操作可确保为在计算过程中处理高级概念和应用程序奠定坚实的基础。

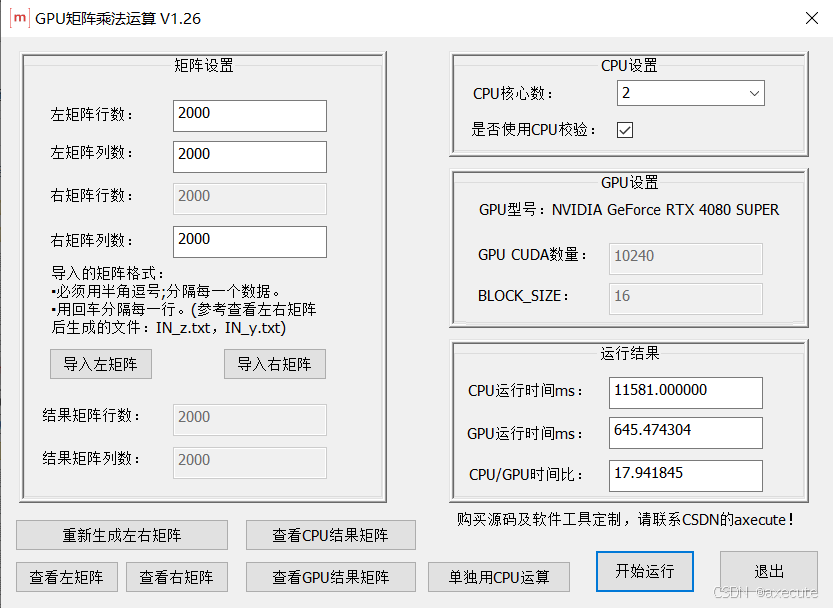

最后推荐:一个GPU矩阵乘法运算工具-GPUMatrix1.26【Windows版本】

https://download.csdn.net/download/axecute/90266772

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)