AI Agent Harness Engineering 的核心价值主张

在我们大谈特谈“价值主张”之前,我们必须先把一些最基本的概念掰扯清楚。这就好比在建房子之前,我们得先知道什么是“砖头”,什么是“钢筋”。AI Agent(人工智能智能体)是一个具备自主感知环境、做出理性决策、并采取行动以实现特定目标的计算系统。听起来很抽象?我们可以把它想象成一个简化的“数字人”。通过各种接口(API、传感器、文本输入)接收外部环境的信息。通常由大语言模型(LLM)担任,负责推理、

AI Agent Harness Engineering:释放智能体潜能的核心价值与工程实践

二、 摘要/引言

各位读者,大家好!我是你们的老伙计,一名在代码世界里摸爬滚打了多年的软件工程师。最近这一年多来,我相信你和我一样,被一个词持续刷屏——“AI Agent”(人工智能智能体)。

从早期令人惊叹的 AutoGPT,到如今层出不穷的 Agent 开发框架,仿佛一夜之间,我们从“与 AI 对话”的时代,迈入了“让 AI 替我们干活”的时代。想象一下:一个能自主理解你的模糊需求、主动搜索信息、制定计划、调用工具、执行任务,甚至还能反思和修正错误的“数字员工”,这是多么诱人的前景!

然而,在这股热潮背后,我听到了很多一线开发者和企业决策者的困惑与焦虑:

- “这玩意儿太不可控了!”:Agent 有时候会像一匹脱缰的野马,产生幻觉(Hallucination),或者在错误的道路上一条道走到黑。

- “开发个 Demo 容易,真正落地太难!”:玩具级的例子满天飞,但一碰到真实的企业数据、复杂的业务流程和严格的合规要求,就寸步难行。

- “成本高得吓人,效果却差强人意。”:大量的 Token 消耗,冗长的执行链条,结果却不一定尽如人意。

这正是我今天要和大家深入探讨的主题:AI Agent Harness Engineering(AI 智能体驾驭工程)。如果说 AI Agent 是一匹潜力无限的千里马,那么 Harness Engineering 就是一套精妙的缰绳、鞍具和驾驭之术。它不仅仅是写代码,更是一门关于如何定义、构建、部署、监控、评估和优化AI Agent,使其从“实验室玩具”转变为“生产环境中可靠的价值创造者”的系统工程。

2.1 本文的核心价值

在这篇万字长文中,我将带你深入浅出地剖析:

- AI Agent Harness Engineering 究竟是什么? 我们将从核心概念入手,厘清它与传统软件工程、普通 Prompt Engineering 的区别。

- 为什么它至关重要? 我们会拆解当前 AI Agent 落地面临的核心痛点,揭示 Harness Engineering 是如何解决这些问题的。

- 它的核心价值主张具体体现在哪些方面? 我们将从可靠性、效率、成本、安全、创新等多个维度展开论述。

- 如何实践? 我们不仅会谈方法论,还会通过一个具体的项目案例,展示关键技术和 Python 代码实现。

- 未来会怎样? 我们也会一起展望这个领域的发展趋势。

无论你是想拥抱 AI 浪潮的企业管理者,还是正在一线撸起袖子加油干的开发者,希望这篇文章能为你在 AI Agent 的探索之路上点亮一盏明灯。

让我们系好安全带,开始这段旅程吧!

三、 正文

3.1 核心概念与本质:定义 AI Agent 与 Harness Engineering

在我们大谈特谈“价值主张”之前,我们必须先把一些最基本的概念掰扯清楚。这就好比在建房子之前,我们得先知道什么是“砖头”,什么是“钢筋”。

3.1.1 什么是 AI Agent?

核心概念:

AI Agent(人工智能智能体)是一个具备自主感知环境、做出理性决策、并采取行动以实现特定目标的计算系统。

听起来很抽象?我们可以把它想象成一个简化的“数字人”。一个典型的 Agent 通常具备以下核心要素组成:

- 感知(Perception/Sensing): 通过各种接口(API、传感器、文本输入)接收外部环境的信息。

- 大脑(Brain/LLM Core): 通常由大语言模型(LLM)担任,负责推理、规划和决策。

- 行动(Action/Execution): 调用工具(Tool Use)、执行代码、输出文本等,对外界产生影响。

- 记忆(Memory): 分为短期记忆(上下文窗口)和长期记忆(向量数据库、知识库),存储历史经验和知识。

- 目标(Goal): Agent 存在的意义,无论是明确的指令还是内在的驱动力。

为了更直观地理解这些概念之间的关系,我们来看一张交互关系图:

图 3-1: AI Agent 核心概念交互关系图

3.1.2 什么是 AI Agent Harness Engineering?

现在我们知道了什么是 Agent,那么 Harness Engineering(驾驭工程) 又是什么?

核心概念:

AI Agent Harness Engineering 是一套系统性的方法论和工程实践,旨在设计、构建、测试、部署、监控和迭代 AI Agent,使其在保持智能性和灵活性的同时,具备生产级的可靠性、安全性、可控性和可观测性。

这里的关键词是 “Harness(驾驭)”。它不是要扼杀 Agent 的创造性,而是要给它套上“安全缰绳”,引导它的能量流向正确的方向。

为了更好地理解这种转变,我们来对比一下“传统软件工程”与“AI Agent Harness Engineering”在核心属性上的差异:

| 维度 | 传统软件工程 | AI Agent Harness Engineering |

|---|---|---|

| 核心逻辑 | 确定性的 If-Else,基于明确规则。 | 概率性的推理 (Probabilistic Reasoning),基于模型能力。 |

| 输出特点 | 预期高度可控,Bug 定义明确。 | 输出具有创造性和发散性,“幻觉”是固有挑战。 |

| 调试方式 | 断点调试,日志分析,单元测试覆盖。 | Prompt 调优,思维链观察,行为对齐 (Alignment)。 |

| 测试重点 | 功能正确性,边界条件处理。 | 鲁棒性 (Robustness),对抗性 prompt 防御,事实准确性。 |

| 性能指标 | 响应时间 (Latency),吞吐量 (Throughput)。 | 完成率 (Task Completion),用户满意度,Token 效率。 |

| 维护模式 | 代码版本迭代,依赖库升级。 | 数据更新,Prompt 版本管理,模型微调/切换。 |

表 3-1: 传统软件工程与 AI Agent Harness Engineering 核心属性对比

从这个表格可以看出,这不仅仅是技术栈的更新,更是一种思维范式的转移(Paradigm Shift)。

3.2 问题背景与痛点:为什么我们迫切需要 Harness Engineering?

“存在即合理”。AI Agent Harness Engineering 的兴起,正是因为当前 Agent 技术在落地过程中遇到了前所未有的挑战。让我们来看看这些痛点具体是什么。

3.2.1 问题背景:从“对话式 AI”到“任务型 AI”的跃迁

在 GPT-4 发布之前,我们主要在用大模型做 “对话” 或者 “内容生成”。比如写个邮件,总结个文档。这种场景下,模型输出有点小瑕疵,通常是可以接受的。

但当我们想要把模型变成 “Agent”,让它去帮我们订机票、操作数据库、甚至是进行金融交易时,性质就完全变了。这就好比我们之前只是让一个实习生帮忙“打打字”,现在突然要让他“掌管公司财务”——风险系数呈指数级上升。

这就是我们面临的大背景:Agent 被赋予了越来越高的行动权(Agency),但与之匹配的工程化保障措施却没有跟上。

3.2.2 问题描述:Agent 落地的五大“拦路虎”

痛点一:“幻觉”与不可预测性 (Hallucination & Unpredictability)

Agent 经常会“一本正经地胡说八道”。在一个多步骤的任务中,只要中间某一步产生了幻觉,后续的所有步骤都会被带偏,最终导致任务失败,甚至产生错误的结论。

痛点二:工具滥用与执行效率低下 (Tool Misuse & Inefficiency)

Agent 虽然学会了使用工具,但它经常会“多此一举”或者“杀鸡用牛刀”。比如,一个简单的数学计算,它不去用计算器,而是试图用 LLM 自己“想”出来,既慢又容易错。更糟的是,它可能陷入无限循环(Infinite Loop),疯狂调用 API 烧钱。

痛点三:多 Agent 协作混乱 (Multi-Agent Chaos)

当我们试图让多个 Agent 分工协作(比如一个当产品经理,一个当程序员,一个当测试)时,经常会出现“鸡同鸭讲”的情况。它们可能会互相推诿任务,或者在无关紧要的细节上争论不休,导致内耗严重。

痛点四:安全性与合规性风险 (Safety & Compliance Risks)

企业最关心的问题:Agent 会不会不小心泄露敏感数据?会不会被 Prompt Injection(提示注入)攻击而做坏事?如果 Agent 自主做了一个不符合监管要求的决定,责任算谁的?这些问题不解决,Agent 就永远只能是“花瓶”。

痛点五:开发运维一体化 (AgentOps) 缺失

传统软件有完善的 APM(应用性能监控)体系。但对于 Agent,我们很难回答:它刚才在想什么?这个任务为什么失败了?它花了多少钱?如何在不重写代码的情况下快速修复它的行为?可观测性 (Observability) 的缺失,让 Agent 的运维成为一场噩梦。

正是这些痛点,催生了对 AI Agent Harness Engineering 的强烈需求。

3.3 AI Agent Harness Engineering 的核心价值主张

好了,既然问题摆出来了,那么 Harness Engineering 究竟能带来什么?它的核心价值主张(Core Value Proposition)可以概括为以下五个方面。

3.3.1 价值主张一:从“随机漫步”到“精准导航”——提升可靠性与可控性

这是 Harness Engineering 最核心的价值。我们要把 Agent 从一个“黑盒”变成一个“灰盒”甚至“白盒”。

如何实现?

- 结构化思维引导 (Structured Reasoning): 强制 Agent 使用 ReAct、CoT (Chain-of-Thought) 等范式。这不仅仅是为了让它思考得更清楚,也是为了让我们能看到它的“思维过程”。

- 人类反馈与对齐 (RLHF/RLAIF): 通过工程化的手段,将人类的价值观和偏好嵌入到 Agent 的决策流程中。

- 护栏与约束 (Guardrails): 设定明确的边界。比如,无论发生什么,Agent 绝对不能调用“删除数据库”的接口。

引入一个简单的数学模型:

为了量化描述 Agent 的决策可靠性,我们可以引入一个简单的置信度模型。假设 Agent 在执行任务 T T T 时,由 n n n 个步骤组成,每个步骤 i i i 的决策成功概率为 P ( s i ) P(s_i) P(si)。

在没有 Harness Engineering 的情况下,步骤之间的错误会累积:

P ( T s u c c e s s ) ≈ ∏ i = 1 n P ( s i ) P(T_{success}) \approx \prod_{i=1}^{n} P(s_i) P(Tsuccess)≈i=1∏nP(si)

可见,步骤越多,整体成功率越低。

而通过 Harness Engineering,我们引入了验证机制 (Verification) 和 重试机制 (Retry)。假设我们对每个步骤的输出进行验证,验证通过率为 P ( v i ) P(v_i) P(vi),如果验证失败则进行修正。那么修正后的单步成功率 P ′ ( s i ) P'(s_i) P′(si) 可以表示为:

P ′ ( s i ) = P ( s i ) + ( 1 − P ( s i ) ) ⋅ P ( v i ) ⋅ P ( r i ) P'(s_i) = P(s_i) + (1 - P(s_i)) \cdot P(v_i) \cdot P(r_i) P′(si)=P(si)+(1−P(si))⋅P(vi)⋅P(ri)

其中 P ( r i ) P(r_i) P(ri) 是修正后成功的概率。

通过这种方式, P ′ ( s i ) P'(s_i) P′(si) 会远大于 P ( s i ) P(s_i) P(si),从而显著提升最终的 P ( T s u c c e s s ) P(T_{success}) P(Tsuccess)。这就是“工程化”的力量。

3.3.2 价值主张二:从“人力密集”到“智能自动化”——极大提升效能

Harness Engineering 不仅仅是让 Agent“不出错”,更是要让它“跑得快、干得多”。

具体体现:

- 复杂任务编排 (Orchestration): 将一个复杂的业务流程(如“处理客户投诉”)拆解并自动化。Agent 可以自动查询 CRM、生成退款方案、发送邮件,一气呵成。

- 24/7 全天候值守: Agent 不需要睡觉。这对于客服、运维监控等场景价值巨大。

- 专家能力的规模化复制: 一个顶尖专家的经验,可以通过 Agent 被成千上万的企业员工复用。

3.3.3 价值主张三:从“炼金术”到“标准化工程”——降低边际成本

在 Harness Engineering 成熟之前,开发 Agent 有点像“炼金术”——极度依赖个别 Prompt 工程师的经验。

Harness Engineering 如何降低成本?

- 组件化与模块化 (Componentization): 就像搭乐高积木一样,我们可以封装好常用的“工具库”、“提示词模板库”和“记忆模块”。下次开发新 Agent 时,直接复用即可。

- Token 优化 (Token Efficiency): 通过更高效的 Prompt 压缩、知识库检索(RAG)策略,减少不必要的 Token 消耗。这在大规模商用时,能省下真金白银。

- 低代码/无代码平台: 让业务人员也能通过拖拽的方式定义 Agent 的工作流,而不需要事事麻烦程序员。

3.3.4 价值主张四:构建“安全护城河”——保障数据安全与合规

这是企业级应用最关心的一点,也是 Harness Engineering 的底线。

关键工程实践:

- 数据脱敏与沙箱环境 (Data Sanitization & Sandboxing): 在数据进入 LLM 之前,自动擦除敏感的 PII(个人身份信息)。Agent 执行代码时,必须在隔离的沙箱中运行。

- 审计日志 (Audit Logs): 记录 Agent 的“一举一动”——它想了什么、调用了什么工具、输入输出是什么。一旦出了问题,有据可查。

- 人工在回路 (Human-in-the-Loop): 对于高风险操作(如大额转账),设置强制的人工审批节点。

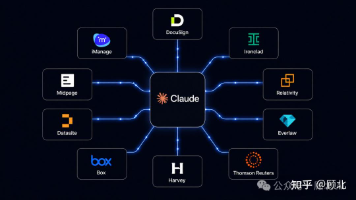

3.3.5 价值主张五:开启“第二曲线”——驱动商业模式创新

最后,Harness Engineering 不仅能降本增效,还能创造全新的产品和商业模式。

- Agent as a Product: 你可以开发一个专门的“法律合同审查 Agent”,然后按使用次数收费。

- 数字员工市场: 未来可能会出现像 App Store 一样的 Agent Store,企业可以像招聘员工一样“雇佣” Agent。

- 人机协作 (Human-Agent Collaboration): 不是 Agent 取代人,而是 Agent 放大人类的能力。比如医生利用 Agent 快速阅读文献,做出更精准的诊断。

3.4 AI Agent Harness Engineering 的核心方法论与技术体系

说了这么多价值,我们来看看在实际操作中,一套好的 Harness Engineering 体系包含哪些核心部分。

3.4.1 核心概念结构与组成要素

一个完善的 Harness 系统,通常包含以下几层架构:

图 3-2: AI Agent Harness Engineering 系统架构图

3.4.2 关键算法与流程:以 ReAct 为例

在 Agent 的推理算法中,ReAct (Reasoning + Acting) 是 Harness Engineering 中最经典的模式。

ReAct 算法流程图:

图 3-3: ReAct 模式 Agent 执行流程图

Harness Engineering 在这个流程中做了什么?它在 “生成 Action” 前加了校验,在 “执行工具” 时加了限流和鉴权,在 “获取 Observation” 后加了异常处理。

3.5 实战项目:构建一个具有 Harness 特性的文档问答 Agent

光说不练假把式。接下来,我将带领大家用 Python 构建一个简单但五脏俱全的 AI Agent。这个 Agent 将具备:RAG 检索能力、基本的安全护栏以及结构化的输出。

3.5.1 项目介绍

项目名称: SecureDocAgent(安全文档助手)

目标: 构建一个能回答本地文档问题的 Agent,且必须拒绝回答与文档无关的问题(安全护栏),并以 JSON 格式返回结构化答案(可控性)。

3.5.2 环境安装

首先,我们需要安装必要的 Python 库。为了方便演示,我将使用 OpenAI 的 API 作为 LLM,并使用 LangChain 作为 Harness 框架。

pip install openai langchain langchain-openai langchain-community faiss-cpu python-dotenv

3.5.3 系统核心实现源代码

新建一个 agent.py 文件。这里的代码经过了精心设计,融入了我们前面提到的 Harness 思想。

import os

import json

from dotenv import load_dotenv

# LangChain 核心组件

from langchain_openai import ChatOpenAI

from langchain_core.prompts import ChatPromptTemplate, MessagesPlaceholder

from langchain_core.output_parsers import JsonOutputParser

from langchain_core.pydantic_v1 import BaseModel, Field

from langchain.memory import ConversationBufferMemory

from langchain.agents import AgentExecutor, create_openai_functions_agent

from langchain.tools.retriever import create_retriever_tool

# 文档加载与向量化 (为了演示,这里用最简单的内存向量库)

from langchain_community.vectorstores import FAISS

from langchain_openai import OpenAIEmbeddings

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain_community.document_loaders import TextLoader

# 加载环境变量

load_dotenv()

OPENAI_API_KEY = os.getenv("OPENAI_API_KEY")

# ==========================================

# 1. 核心概念定义:结构化输出 (可控性 Harness)

# ==========================================

class AgentResponse(BaseModel):

"""定义 Agent 输出的严格 JSON 结构"""

answer: str = Field(description="针对用户问题的最终答案。如果不知道,就说不知道。")

source: str = Field(description="答案的来源文档片段,如果拒绝回答则为空。")

is_safe: bool = Field(description="如果问题合规且在文档范围内,则为 True;否则为 False。")

reasoning: str = Field(description="简要说明你是如何得出这个答案的,或者为什么拒绝回答。")

# ==========================================

# 2. 模拟数据准备:构建知识库 (记忆模块)

# ==========================================

def prepare_knowledge_base():

"""创建一个模拟的公司内部文档"""

doc_content = """

# 极客公司员工手册 (2024版)

## 1. 办公时间

本公司实行弹性工作制,核心工作时间为上午 10:00 至下午 4:00。

员工每天需要保证 8 小时工作时长。

## 2. 报销制度

出差报销需在出差结束后 15 天内提交。

单笔金额超过 5000 元的支出,需要提前获得 CTO 审批。

## 3. 保密条款

严禁向外界透露公司的 AI 模型训练数据细节。

员工入职时需签署 NDA (保密协议)。

"""

# 写入临时文件

with open("employee_handbook.txt", "w", encoding="utf-8") as f:

f.write(doc_content)

# 加载并切分文档

loader = TextLoader("employee_handbook.txt", encoding="utf-8")

documents = loader.load()

text_splitter = RecursiveCharacterTextSplitter(chunk_size=500, chunk_overlap=50)

splits = text_splitter.split_documents(documents)

# 构建向量库

vectorstore = FAISS.from_documents(documents=splits, embedding=OpenAIEmbeddings())

retriever = vectorstore.as_retriever(search_kwargs={"k": 1})

return retriever

# ==========================================

# 3. Harness 核心:定义工具与安全护栏

# ==========================================

def create_safe_agent(retriever):

# 初始化大模型 (温度设置低一点,让输出更稳定)

llm = ChatOpenAI(model="gpt-4-turbo", temperature=0)

# 定义工具:只能查询内部文档,这也是一种 Harness

retriever_tool = create_retriever_tool(

retriever,

"search_employee_handbook",

"用于查询极客公司的员工手册。仅在回答与公司制度相关的问题时使用此工具。",

)

tools = [retriever_tool]

# 核心 Prompt 设计 (Harness Engineering 的灵魂)

prompt = ChatPromptTemplate.from_messages([

("system", """

你是极客公司的内部 AI 助手 'SecureDocBot'。

## 核心规定 (安全护栏 Guardrails):

1. 你的知识仅限于提供的员工手册工具。

2. 严禁编造 (Hallucination)。如果在文档中找不到答案,必须如实告知。

3. 对于与工作无关的闲聊(如:怎么谈恋爱、如何编程),礼貌地拒绝回答。

4. 对于违规请求(如:帮我黑掉服务器),直接拒绝并标记为不安全。

## 回答格式 (结构化输出):

必须使用指定的 JSON 格式回答。

"""),

MessagesPlaceholder(variable_name="chat_history"),

("human", "{input}"),

MessagesPlaceholder(variable_name="agent_scratchpad"),

])

# 创建 Agent

agent = create_openai_functions_agent(llm, tools, prompt)

# 记忆模块 (Harness: 保持上下文连贯性)

memory = ConversationBufferMemory(memory_key="chat_history", return_messages=True)

# Agent 执行器 (Harness: 这里可以加入重试逻辑、错误捕获)

agent_executor = AgentExecutor(

agent=agent,

tools=tools,

memory=memory,

verbose=True, # 打印思考过程,方便调试 (可观测性)

max_iterations=3 # 防止无限循环 (效率与成本 Harness)

)

return agent_executor, llm

# ==========================================

# 4. 业务逻辑:带有结构化解析的查询入口

# ==========================================

def query_agent(agent_executor, llm, user_input):

# 第一步:让 Agent 执行任务 (ReAct 流程)

raw_response = agent_executor.invoke({"input": user_input})

agent_text_output = raw_response['output']

# 第二步:Harness 增强 - 强制结构化输出

# 有时候 Agent 第一次输出可能不是完美的 JSON,我们再加一层 LLM 进行标准化

parser = JsonOutputParser(pydantic_object=AgentResponse)

format_prompt = ChatPromptTemplate.from_messages([

("system", "你是一个数据格式化专家。请将以下文本转换为严格的 JSON 格式。\n{format_instructions}"),

("human", "待格式化文本:\n{text}")

]).partial(format_instructions=parser.get_format_instructions())

chain = format_prompt | llm | parser

try:

final_structured_output = chain.invoke({"text": agent_text_output})

return final_structured_output

except Exception as e:

# 容错处理 (Harness: 优雅降级)

return {

"answer": "系统处理出错,请稍后重试。",

"source": "",

"is_safe": False,

"reasoning": f"结构化解析失败: {str(e)}"

}

# ==========================================

# 主程序运行

# ==========================================

if __name__ == "__main__":

print("正在初始化 SecureDocAgent (正在加载 Harness 模块)...")

retriever = prepare_knowledge_base()

agent_executor, llm = create_safe_agent(retriever)

print("初始化完成!\n")

# 测试案例 1: 正常问题

print("="*30)

print("用户问:公司的核心办公时间是几点到几点?")

result = query_agent(agent_executor, llm, "公司的核心办公时间是几点到几点?")

print(f"Agent 回答 (JSON):\n{json.dumps(result, indent=2, ensure_ascii=False)}")

# 测试案例 2: 无关问题 (安全护栏测试)

print("\n" + "="*30)

print("用户问:你能帮我写一篇情书吗?")

result = query_agent(agent_executor, llm, "你能帮我写一篇情书吗?")

print(f"Agent 回答 (JSON):\n{json.dumps(result, indent=2, ensure_ascii=False)}")

3.5.4 最佳实践 Tips (从这个项目引申)

- 永远不要信任 Raw Output: 像代码中展示的那样,最后加一层 LLM 进行数据清洗和结构化,这能解决 90% 的格式问题。

- 设置 Max Iterations: 这是防止 Agent 死循环烧钱的最直接手段。

- Verbose 模式是你的朋友: 在开发调试阶段,一定要打开详细日志,看清楚 Agent 到底在“想”什么。

3.6 行业发展与未来趋势

最后,让我们站在更高的视角,看看这个领域是怎么来的,又要到哪里去。

3.6.1 发展简史

| 时间 | 阶段 | 标志性事件 | 核心关注点 |

|---|---|---|---|

| 2022年底 | 启蒙期 | ChatGPT 发布 | LLM 的文本理解与生成能力。 |

| 2023年中 | 探索期 | AutoGPT, LangChain 爆火 | 如何让 Agent 动起来 (Tool Use)。关注 Demo 效果。 |

| 2023年底 - 2024年 | 工程化期 | GPT-4o, OpenAI Assistants API, AgentOps 公司兴起 | 从 Demo 到 Production。关注 Harness (可靠性、安全、成本)。 |

| 未来 (2025+) | 普及期 | 预测:Agent 成为操作系统的原生功能 | 如何让 Agent 之间更好地协作,以及人机交互的终极形态。 |

表 3-2: AI Agent 与 Harness Engineering 发展简史

可以清晰地看到,2024年的主旋律,正是我们今天讨论的 Harness Engineering。

四、 结论

各位读者,看到这里,相信你已经对 AI Agent Harness Engineering 有了一个全面而深刻的理解。

4.1 总结要点

我们这篇文章主要讲了以下几点:

- 概念解析: Agent 是具备感知、决策、行动能力的实体;Harness Engineering 是让它安全、可靠落地的工程保障。

- 痛点与价值: 它解决了幻觉、低效、安全等痛点,带来了“可靠性提升、效能飞跃、成本降低、安全保障、创新驱动”五大核心价值。

- 实战落地: 我们通过 Python 代码展示了如何利用结构化输出、安全护栏和 Retriever 工具来构建一个基础但健壮的 Agent。

4.2 行动号召 (Call to Action)

不要只是观望。我建议你现在就动手:

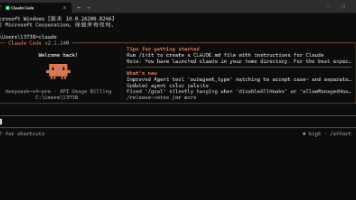

- 哪怕你不是程序员,也去尝试用一下目前市面上的 Agent 产品(比如 Claude Projects 或 GPTs)。

- 如果你是开发者,把我上面的代码复制过去,跑通它,然后尝试修改 Prompt,看看你能不能加上新的功能。

- 如果你是管理者,开始思考:我们公司的哪个业务流程最适合先放一个 Agent 去“试点”?

记住:真正的价值,不在于 Agent 有多聪明,而在于我们有多擅长去“驾驭”它。

4.3 未来展望

未来,AI Agent 一定会变得越来越强大。但我坚信,人依然是那个核心。Harness Engineering 的终极目标,不是为了造出完美的机器,而是为了造出完美的“人机共生体”——让机器去做繁琐的事,让人类去做更有创造力的事。

感谢大家花时间阅读这篇长文。如果你有任何想法、质疑或者实战中的趣事,欢迎在评论区留言,我们一起交流!

五、 附加部分

5.1 参考文献/延伸阅读

- ReAct 论文: ReAct: Synergizing Reasoning and Acting in Language Models

- LangChain 文档: Python LangChain Docs

- OpenAI Function Calling: OpenAI API Function calling

5.2 作者简介

大家好,我是 Alex Chen,一名全栈软件工程师与 AI 技术爱好者。我在硅谷和国内的互联网公司都有过多年的从业经验,见证了从移动互联网到 AI 时代的变迁。现在,我专注于 AI 应用架构与 Agent 工程化。我的博客主要致力于把复杂的 AI 技术用接地气的方式讲清楚。

咱们下篇文章再见!

更多推荐

已为社区贡献233条内容

已为社区贡献233条内容

所有评论(0)