AI Agent的“结构化认知“革命:知识图谱技术架构与实战指南

知识图谱正成为AI Agent发展的关键技术基础设施。2025年,微软GraphRAG 1.0和学术界的ArchRAG等创新方案推动了知识图谱技术的快速发展。本文系统分析了知识图谱在智能搜索、数据分析、多Agent协作和企业知识管理四大场景的应用价值,对比了不同技术路线的优劣。重点介绍了LLM驱动的知识图谱构建流程及主流工具,并为企业实践提供了混合搜索架构、多跳推理实现等关键要素与实施路线图。随着

本文深入探讨了知识图谱在AI Agent发展中的核心作用,从技术架构角度解析了GraphRAG、ArchRAG等前沿方案,并阐述了其在智能搜索、数据分析、多Agent协作及知识管理四大场景的应用。文章对比了不同技术路线的优劣,介绍了LLM驱动的知识图谱构建流程及主流工具,并提供了企业实践的关键要素与实施路线图。最后,展望了神经符号融合、代码知识图谱等2025年最新趋势,强调知识图谱作为AI Agent时代核心基础设施的重要性,建议企业抓住窗口期构建知识图谱能力。

AI知识图谱

从技术架构到企业实践

🐠 小鱼技术笔记 • 2026年4月 • 15分钟阅读

当大语言模型(LLM)遇上知识图谱,AI Agent正在经历一场从"记忆碎片"到"结构化认知"的范式革命。2025年,微软GraphRAG 1.0正式发布,学术界提出ArchRAG等创新方案,知识图谱技术进入快速发展期。

1

为什么AI Agent需要知识图谱?

传统的RAG(检索增强生成)系统在处理简单问题时表现良好,但在面对需要多跳推理的复杂查询时却力不从心。例如:

“OpenAI的前员工中,有谁创立了自己的公司?”

这个问题需要连接两个独立的信息片段:1)识别OpenAI的前员工;2)判断他们是否创立了公司。纯向量搜索无法建立这种跨文档的关联。

知识图谱的价值在于:

- 将非结构化文本转化为实体-关系-实体的三元组结构

- 显式建模概念间的关联,支持多跳推理

- 提供可追溯的推理路径,增强AI的可解释性

- 减少LLM的幻觉问题,提升回答准确性

💡 核心洞察

GraphRAG(图检索增强生成)通过结合向量搜索的语义相似性和图查询的结构化推理,使AI Agent能够回答传统RAG无法处理的复杂问题。2025年2月,微软正式发布GraphRAG 1.0,同时学术界提出了ArchRAG等改进方案。

2

知识图谱在AI Agent中的四大应用场景

2.1 智能搜索与问答

企业级AI搜索正从关键词匹配转向语义理解。知识图谱使搜索系统能够:

- 理解查询的深层意图,而非表面词汇

- 通过实体关系扩展查询,发现隐含关联

- 支持"类似X但不是Y"的复杂筛选

- 提供答案的来源追溯和置信度评估

36.6%

知识图谱市场年增长率

$6.93B

2030年预计市场规模

80%

GraphRAG 1.0输出空间节省

2s

GraphRAG 1.0 CLI启动时间

2.2 AI数据分析与商业智能

知识图谱正在重塑企业数据分析的方式:

- **统一数据视图:**整合来自CRM、ERP、数据库等多源异构数据

- **关系洞察:**发现传统BI工具难以捕捉的间接关联(如"客户的客户的供应商")

- **实时推理:**支持基于图结构的动态分析和预测

- **自然语言查询:**将业务问题直接转化为图查询语言

2.3 多Agent协作系统

在Multi-Agent架构中,知识图谱充当共享的"集体记忆":

Multi-Agent知识共享架构

Agent A - 数据分析

提取业务指标

⬇️

共享知识图谱层

统一语义表示

实体对齐、关系推理、冲突消解

⬇️

Agent B - 报告生成

生成洞察报告

2.4 企业知识管理

SAP、Google Cloud AgentSpace等企业平台正在将知识图谱作为AI基础设施:

- 构建企业级语义层,统一业务术语定义

- 支持跨部门的知识共享和复用

- 实现基于权限的精细化访问控制

- 为AI Agent提供可信的知识基础

3

前沿技术方案:GraphRAG、ArchRAG与LazyGraphRAG

2024-2025年,GraphRAG领域出现了三个重要技术路线:微软官方的GraphRAG 1.0、学术界的ArchRAG创新方案,以及LazyGraphRAG的成本优化策略。

3.1 GraphRAG 1.0(微软官方)

🚀 GraphRAG 1.0 主要特性(2025年2月发布)

- **简化数据模型:**相比早期版本,输出Parquet格式磁盘空间节省80%,总磁盘空间减少43%

- **增量索引:**支持智能合并更新,无需完全重新索引

- **多向量存储支持:**原生支持LanceDB和Azure AI Search

- **CLI性能优化:**启动时间从148秒降至2秒

- **社区摘要:**基于Leiden算法生成层次化主题聚类

3.2 ArchRAG:学术界的创新方案

**重要说明:**ArchRAG(arXiv:2502.09891)是香港科技大学等学术机构的研究成果,并非微软GraphRAG的官方改进版,而是针对GraphRAG局限性提出的替代方案。

ArchRAG 的三个核心创新:

- **属性社区检测(Attributed Communities):**不仅考虑图结构,还结合节点属性相似性,解决GraphRAG社区质量低的问题

- **C-HNSW分层索引:**受HNSW算法启发,构建支持多粒度检索的层次化索引结构

- **自适应过滤机制:**在检索过程中动态选择最相关的社区和实体,显著降低Token消耗

📊 GraphRAG vs ArchRAG 技术对比

| 维度 | GraphRAG(微软) | ArchRAG(学术界) |

|---|---|---|

| 社区检测 | Leiden算法(仅结构) | 属性感知聚类(结构+语义) |

| 索引结构 | 单层社区索引 | C-HNSW分层索引 |

| 检索策略 | Global/Local分离 | 统一分层检索 |

| Token成本 | 较高(全社区遍历) | 显著降低(自适应过滤) |

| 开源状态 | 微软官方开源 | 学术研究代码 |

3.3 LazyGraphRAG:延迟摘要策略

**技术澄清:**LazyGraphRAG并非"查询时才动态构建图结构",而是采用"延迟摘要"策略——索引阶段仍预先构建基础图结构,但社区摘要按需生成,大幅降低前期成本。

索引策略对比

传统GraphRAG

预先为所有社区生成摘要

LazyGraphRAG

按需生成社区摘要

成本特点

传统GraphRAG

前期成本高,查询时低

LazyGraphRAG

前期成本低,查询时按需

适用场景

传统GraphRAG

高频查询、复杂推理

LazyGraphRAG

快速原型、成本敏感

4

LLM驱动的知识图谱构建流程

大语言模型正在革命性地改变知识图谱的构建方式,从传统的人工规则转向自动化抽取。2025年,Schema-Based和Schema-Free两种范式各有进展。

LLM驱动的知识图谱构建流水线

Step 1

文本分块与预处理

文档切分、嵌入生成、相似度连接

⬇️

Step 2

实体抽取(NER)

识别人名、组织、地点、概念

⬇️

Step 3

关系抽取(RE)

识别实体间的语义关系

⬇️

Step 4

实体对齐与消歧

合并重复实体、解决指代歧义

⬇️

Step 5

图谱存储与索引

Neo4j、Amazon Neptune等图数据库

4.1 两种构建范式深度对比

| 维度 | Schema-Based | Schema-Free |

|---|---|---|

| 前期投入 | 高(需定义本体) | 低(LLM自主发现) |

| 数据质量 | 高(有约束验证) | 低(需后处理) |

| 灵活性 | 低(模式固定) | 高(动态演化) |

| 适合场景 | 成熟业务领域 | 探索性项目 |

| 维护成本 | 中(模式变更需协调) | 高(需持续质量监控) |

| 代表方法 | CQbyCQ、Ontology-Grounded | EDC、OpenIE、GraphRAG |

💡 选型建议

- **企业级应用:**推荐Schema-Based,保证数据质量和一致性

- **快速原型验证:**推荐Schema-Free,快速探索数据模式

- **混合策略:**先用Schema-Free探索,再逐步收敛到Schema-Based

4.2 主流工具与平台(2025更新)

🛠️ 推荐工具栈

**图数据库:**Neo4j(最成熟)、Amazon Neptune(AWS生态)、TigerGraph(高性能)、NebulaGraph(开源)

**构建工具:**Neo4j LLM Knowledge Graph Builder(开源)、Microsoft GraphRAG、LangChain、LlamaIndex

**向量存储:**LanceDB(轻量)、Pinecone(托管)、Azure AI Search(企业)

**新兴方案:**KET-RAG(成本优化)、Think-on-Graph 3.0(多智能体推理)、HGNet(科学文献)

5

企业实践:构建实用知识图谱的关键要素

5.1 混合搜索架构(Hybrid Search)

最佳实践是将向量搜索和图搜索结合:

混合搜索流程: 1. 向量搜索:找到语义相似的初始文档/实体 2. 图扩展:从匹配节点出发,在图中查找关联实体 3. 多跳推理:遍历关系路径,收集相关上下文 4. 重排序:综合向量相似度和图结构重要性 5. 生成:将检索结果输入LLM生成答案

为什么需要混合?

- 向量搜索擅长语义匹配,但缺乏结构化推理能力

- 图搜索擅长关系推理,但可能错过语义相似但不直接连接的内容

- 混合方案在复杂查询上准确率显著提升(实验表明可提升15-30%)

5.2 多跳推理的实现

多跳推理是知识图谱的核心能力,2025年的典型实现包括:

- **Graph Chain-of-Thought:**让LLM在图上逐步推理,每步选择一个关系扩展

- **Think-on-Graph 3.0:**将推理过程显式建模为图上的路径搜索,支持多智能体协作

- **Beam Search:**维护多个候选路径,平衡探索与利用

- **C-HNSW(ArchRAG):**分层索引支持高效的多粒度检索

5.3 评估与优化指标

召回率

相关实体是否被检索到

准确率

检索结果的相关性

覆盖率

图谱对领域知识的覆盖

一致性

实体对齐和消歧质量

5.4 企业选型决策树

知识图谱技术选型指南

Step 1

是否需要多跳推理?

否

传统RAG足够,无需知识图谱

是

继续下一步评估

Step 2

数据规模如何?

小规模

Neo4j + LangChain,快速验证

中规模

Microsoft GraphRAG,成熟方案

大规模+成本敏感

ArchRAG / LazyGraphRAG

Step 3

领域是否成熟?

是

Schema-Based,保证质量

否

Schema-Free,快速探索

5.5 实施路线图建议

企业知识图谱实施阶段

Phase 1

**试点验证(1-2个月):**选择1-2个高价值场景,构建小规模概念验证,验证技术可行性

Phase 2

**领域扩展(3-6个月):**基于试点经验,扩展到相邻业务领域,建立Schema规范

Phase 3

**平台化(6-12个月):**建立企业级知识图谱平台,支持多业务线,实现增量更新

Phase 4

**智能化(12个月+):**集成AI Agent,实现自主知识发现、更新与推理

6

2025年最新趋势与前沿方向

知识图谱与AI Agent的融合仍在快速发展,以下是2025年值得关注的前沿方向:

6.1 技术趋势

- **神经符号融合:**结合深度学习的感知能力和符号推理的可解释性,如GNN-RAG

- **代码知识图谱:**用Tree-sitter解析代码AST构建图谱,支持软件工程智能体

- **多模态知识图谱:**整合文本、图像、视频、表格等多模态信息

- **实时增量构建:**从流数据中实时提取和更新知识,支持动态业务场景

- **多智能体协作建图:**多个LLM Agent分别负责抽取、验证、对齐等任务

6.2 主要挑战

- **质量控制:**LLM抽取的准确性仍有提升空间,错误会传播和放大

- **规模与性能:**超大规模图谱的存储和查询效率优化

- **Schema演化:**如何平滑处理知识模式的动态变化

- **成本优化:**在大规模应用中平衡构建成本与查询性能

- **人机协作:**设计有效的交互界面,让领域专家参与知识验证

知识图谱不是替代向量搜索,而是与之互补。未来的AI Agent将同时利用语义相似性和结构化关系,实现真正智能的信息处理。

最后

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?

答案只有一个:人工智能(尤其是大模型方向)

当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应聘者,月基础工资也能稳定在4万元左右。

再看阿里、腾讯两大互联网大厂,非“人才计划”的AI相关岗位应聘者,月基础工资也约有3万元,远超其他行业同资历岗位的薪资水平,对于程序员、小白来说,无疑是绝佳的转型和提升赛道。

如果你还不知道从何开始,我自己整理一套全网最全最细的大模型零基础教程,我也是一路自学走过来的,很清楚小白前期学习的痛楚,你要是没有方向还没有好的资源,根本学不到东西!

下面是我整理的大模型学习资源,希望能帮到你。

👇👇扫码免费领取全部内容👇👇

最后

1、大模型学习路线

2、从0到进阶大模型学习视频教程

从入门到进阶这里都有,跟着老师学习事半功倍。

3、 入门必看大模型学习书籍&文档.pdf(书面上的技术书籍确实太多了,这些是我精选出来的,还有很多不在图里)

4、 AI大模型最新行业报告

2026最新行业报告,针对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

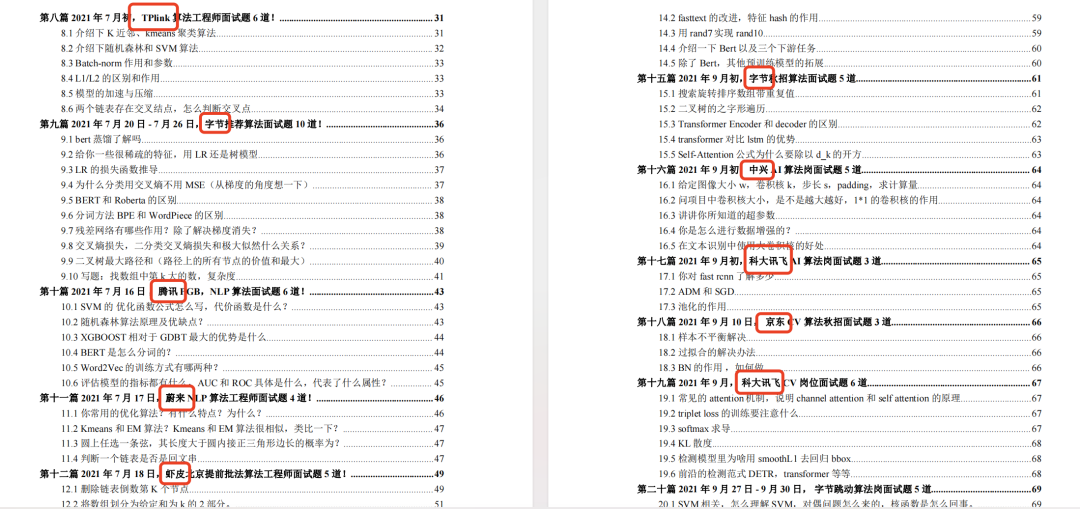

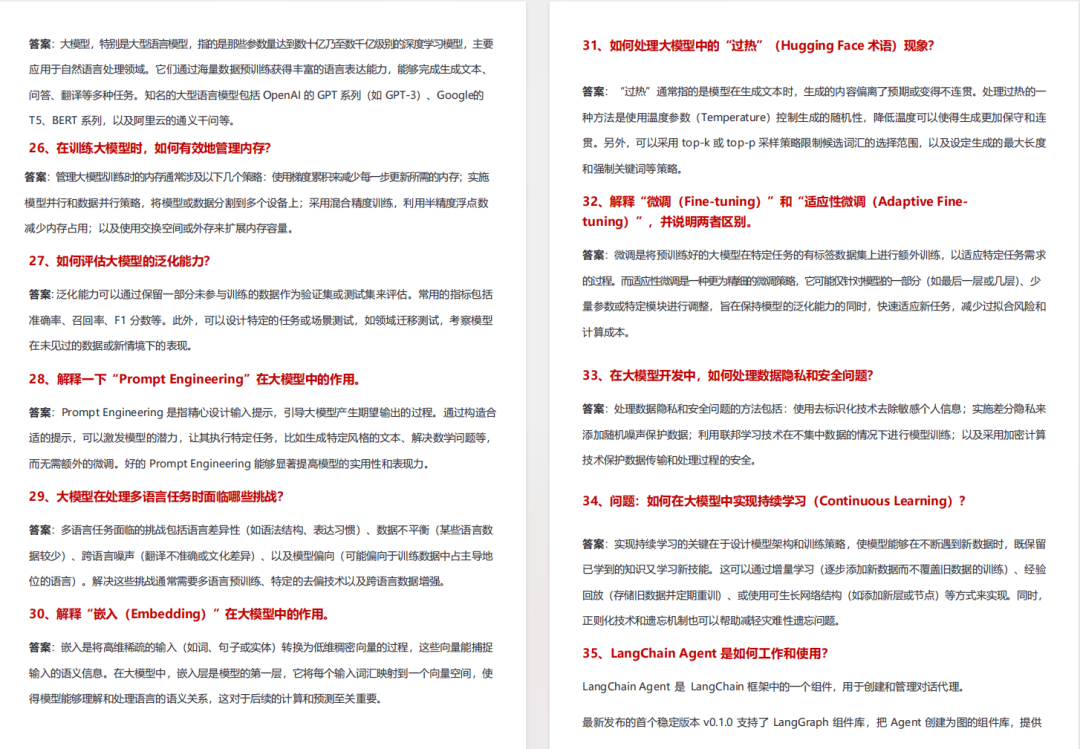

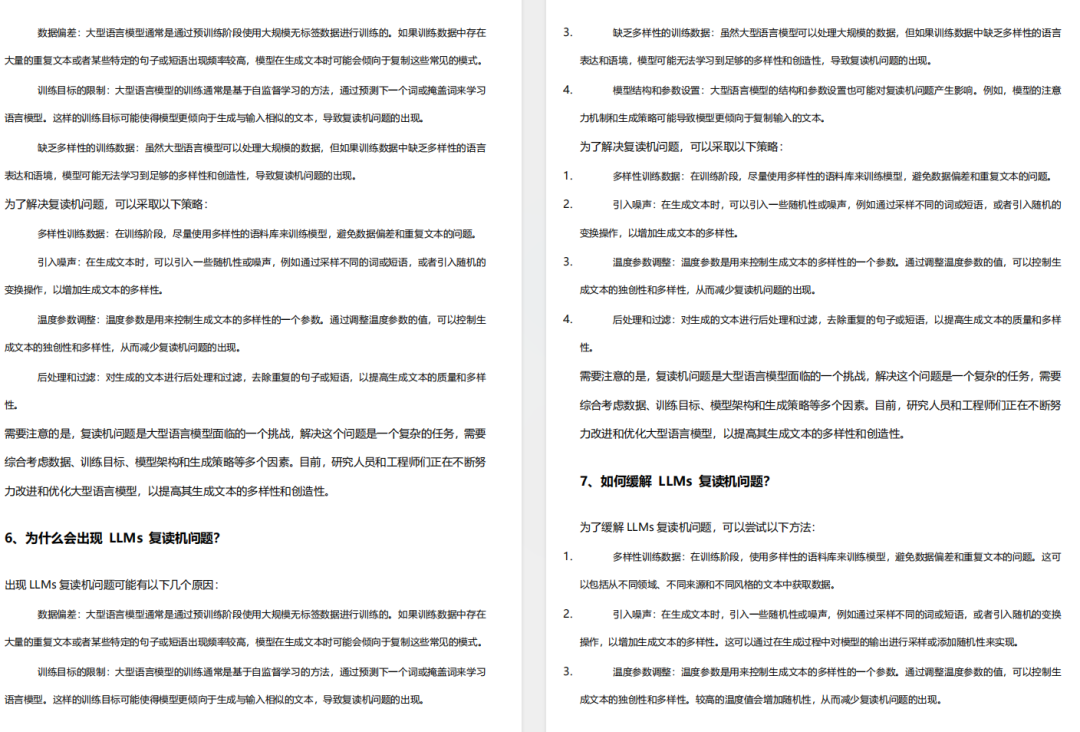

5、面试试题/经验

【大厂 AI 岗位面经分享(107 道)】

【AI 大模型面试真题(102 道)】

【LLMs 面试真题(97 道)】

6、大模型项目实战&配套源码

适用人群

四阶段学习规划(共90天,可落地执行)

第一阶段(10天):初阶应用

该阶段让大家对大模型 AI有一个最前沿的认识,对大模型 AI 的理解超过 95% 的人,可以在相关讨论时发表高级、不跟风、又接地气的见解,别人只会和 AI 聊天,而你能调教 AI,并能用代码将大模型和业务衔接。

- 大模型 AI 能干什么?

- 大模型是怎样获得「智能」的?

- 用好 AI 的核心心法

- 大模型应用业务架构

- 大模型应用技术架构

- 代码示例:向 GPT-3.5 灌入新知识

- 提示工程的意义和核心思想

- Prompt 典型构成

- 指令调优方法论

- 思维链和思维树

- Prompt 攻击和防范

- …

第二阶段(30天):高阶应用

该阶段我们正式进入大模型 AI 进阶实战学习,学会构造私有知识库,扩展 AI 的能力。快速开发一个完整的基于 agent 对话机器人。掌握功能最强的大模型开发框架,抓住最新的技术进展,适合 Python 和 JavaScript 程序员。

- 为什么要做 RAG

- 搭建一个简单的 ChatPDF

- 检索的基础概念

- 什么是向量表示(Embeddings)

- 向量数据库与向量检索

- 基于向量检索的 RAG

- 搭建 RAG 系统的扩展知识

- 混合检索与 RAG-Fusion 简介

- 向量模型本地部署

- …

第三阶段(30天):模型训练

恭喜你,如果学到这里,你基本可以找到一份大模型 AI相关的工作,自己也能训练 GPT 了!通过微调,训练自己的垂直大模型,能独立训练开源多模态大模型,掌握更多技术方案。

到此为止,大概2个月的时间。你已经成为了一名“AI小子”。那么你还想往下探索吗?

- 为什么要做 RAG

- 什么是模型

- 什么是模型训练

- 求解器 & 损失函数简介

- 小实验2:手写一个简单的神经网络并训练它

- 什么是训练/预训练/微调/轻量化微调

- Transformer结构简介

- 轻量化微调

- 实验数据集的构建

- …

第四阶段(20天):商业闭环

对全球大模型从性能、吞吐量、成本等方面有一定的认知,可以在云端和本地等多种环境下部署大模型,找到适合自己的项目/创业方向,做一名被 AI 武装的产品经理。

-

硬件选型

-

带你了解全球大模型

-

使用国产大模型服务

-

搭建 OpenAI 代理

-

热身:基于阿里云 PAI 部署 Stable Diffusion

-

在本地计算机运行大模型

-

大模型的私有化部署

-

基于 vLLM 部署大模型

-

案例:如何优雅地在阿里云私有部署开源大模型

-

部署一套开源 LLM 项目

-

内容安全

-

互联网信息服务算法备案

-

…

👇👇扫码免费领取全部内容👇👇

3、这些资料真的有用吗?

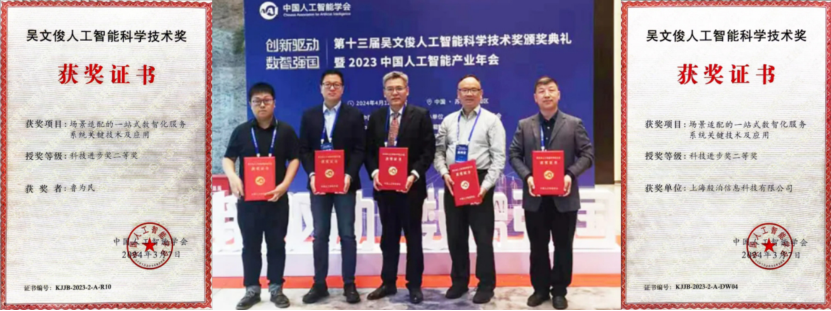

这份资料由我和鲁为民博士(北京清华大学学士和美国加州理工学院博士)共同整理,现任上海殷泊信息科技CEO,其创立的MoPaaS云平台获Forrester全球’强劲表现者’认证,服务航天科工、国家电网等1000+企业,以第一作者在IEEE Transactions发表论文50+篇,获NASA JPL火星探测系统强化学习专利等35项中美专利。本套AI大模型课程由清华大学-加州理工双料博士、吴文俊人工智能奖得主鲁为民教授领衔研发。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献805条内容

已为社区贡献805条内容

所有评论(0)