浙大等提出GAM分层图记忆:破解新旧知识冲突,赋予LLM Agent连贯长期记忆

为了维持连贯的长期交互,大语言模型(LLM)智能体必须在**获取新信息**与**保留先验知识**之间找到平衡。当前统一的流式记忆系统虽然便于更新上下文,但极易受到瞬时噪声的干扰;而离散的结构化记忆架构虽然在知识保留上表现稳健,却难以适应叙事的发展与变化。 为解决这一冲突,本文提出了 **GAM(Hierarchical Graph-based Agentic Memory,分层图基代理记忆)**

摘要 (Abstract)

为了维持连贯的长期交互,大语言模型(LLM)智能体必须在获取新信息与保留先验知识之间找到平衡。当前统一的流式记忆系统虽然便于更新上下文,但极易受到瞬时噪声的干扰;而离散的结构化记忆架构虽然在知识保留上表现稳健,却难以适应叙事的发展与变化。 为解决这一冲突,本文提出了 GAM(Hierarchical Graph-based Agentic Memory,分层图基代理记忆) 框架。该框架显式地将“记忆编码”与“记忆巩固”过程解耦。具体而言,GAM 将正在进行的对话隔离在一个“事件进展图(Event Progression Graph)”中,并且只有在发生“语义转变(semantic shifts)”时,才会将这些信息整合到全局的“主题关联网络(Topic Associative Network)”中。这种方法在保持长期一致性的同时最大程度地减少了干扰。此外,本文还引入了一种图引导的多因素检索策略以提升上下文精度。在 LoCoMo 和 LongDialQA 数据集上的实验表明,GAM 在推理准确性和计算效率上均持续优于现有的 SOTA 基线模型。

1. 引言 (Introduction)

尽管 LLM 智能体在自然语言理解和长视野复杂推理方面能力卓越,但让它们保持连贯的长期交互仍然是一个重大挑战。一个鲁棒的智能体记忆必须能快速捕捉实时交互,同时保护既有知识不遭受瞬时噪声的破坏。

现有架构往往难以解决这一冲突:

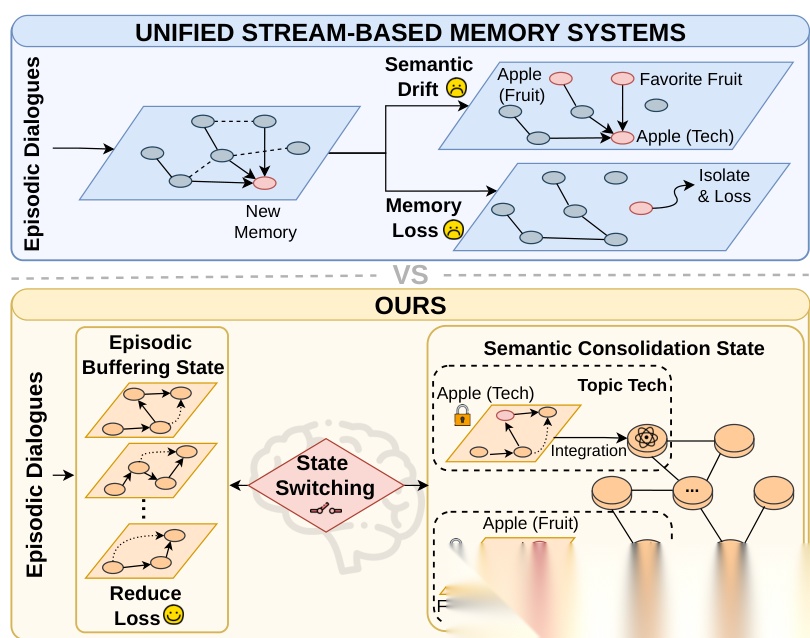

- 统一流式记忆系统(Unified Stream-based Memory Systems):例如 MemGPT、Mem0 等,直接在活跃的记忆流上进行持续更新。这种直接暴露带来了极高的记忆污染(Memory Contamination)风险,具体表现为记忆丢失(Memory Loss)(已建立的节点由于连接较弱而在结构上被孤立和遗忘)以及语义漂移(Semantic Drift)(不同主题被错误合并,扭曲了智能体的主题一致性)。

- 离散结构化记忆架构(Discrete Structured Memory Architectures):例如 GraphRAG 等,通过僵硬的模式组织信息以确保稳定性。但它们缺乏实时更新叙事流的敏捷性,导致话语表示碎片化,无法捕捉长对话的连续演变。

为了从根本上解决立即编码与长期巩固之间的冲突,GAM 明确地将这两个生命周期过程分离。

图1:统一流式记忆系统(上)与 GAM(下)的对比。统一架构在直接更新下容易遭受记忆丢失和语义漂移,而 GAM 使用状态切换来减少这两种情况。

图1:统一流式记忆系统(上)与 GAM(下)的对比。统一架构在直接更新下容易遭受记忆丢失和语义漂移,而 GAM 使用状态切换来减少这两种情况。

主要贡献:

- 提出了基于分层图记忆架构的 GAM 框架,通过物理隔离全局“主题关联网络”和局部“事件进展图”,实现了叙事缓冲的写入隔离。

- 设计了基于状态的记忆巩固机制,在情景缓冲与语义巩固状态间动态切换,仅在语义完整的边界进行更新以最小化污染。

- 引入了图引导的多因素检索策略,结合时间、置信度和角色信号进行自顶向下的遍历,实现精确的情景细节召回。

- 在 LoCoMo 和 LongDialQA 基准测试中,证明了该方法在推理精度和效率上优于现有基线。

2. 相关工作 (Related Work)

2.1 统一流式记忆

目前的 LLM 智能体(如 Generative Agents, MemGPT, MemoryOS, Mem0)采用统一的流式范式来最大化交互可塑性,并在工作上下文和外部存储之间交换信息。但这些方法缺乏“写入隔离(write isolation)”,新获取的噪声信息被直接追加到长期存储中,极易导致记忆污染。

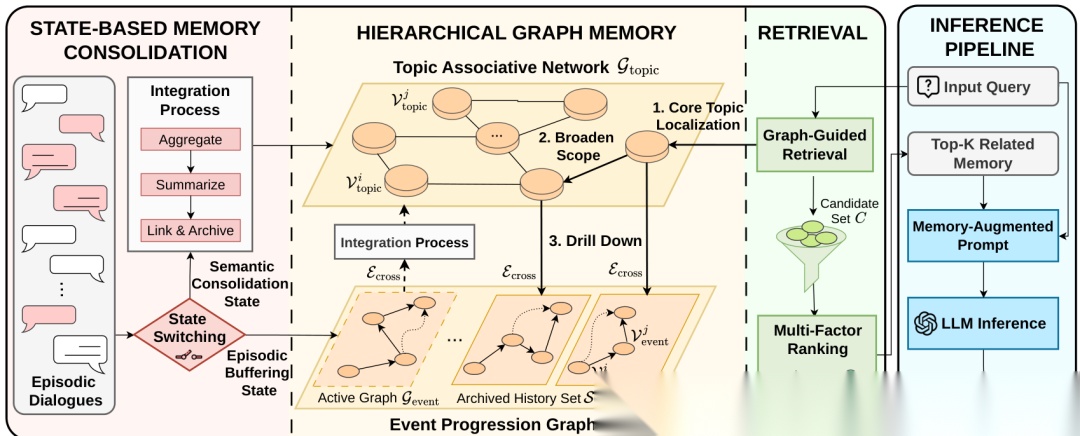

图2:GAM 的架构。最左侧模块基于主题边界在缓冲和巩固之间切换;中间的分层图记忆将存储解耦为全局主题关联网络和局部事件进展图;最右侧为结合多因素排名的图引导自顶向下检索。

图2:GAM 的架构。最左侧模块基于主题边界在缓冲和巩固之间切换;中间的分层图记忆将存储解耦为全局主题关联网络和局部事件进展图;最右侧为结合多因素排名的图引导自顶向下检索。

2.2 离散结构化记忆架构

此类架构(如 GraphRAG, StructRAG, LightRAG)通过构建静态知识图谱来实现精确的多跳推理。但传统知识图谱昂贵的索引构建过程使其难以适应开放域对话的流动叙事,往往只能产生碎片化的话语表示。

2.3 结构动态化方法

近期的研究(如 AriGraph, Zep)尝试引入动态元素。然而,它们主要针对具有明确离散状态转换的基于文本的游戏,或仅仅专注于检索基础设施的优化,未能从根本上解决认知层面的冲突。

3. 方法论 (Methodology)

3.1 问题定义与概述

记忆管理被形式化为推理时的在线决策过程。目标是在保持检索质量的同时,最小化更新记忆的操作成本 和预期干扰成本 :

通过引入语义发散指示器 作为低成本的策略触发器:

当 时,标志着结构性偏移,需要进行记忆巩固。GAM 包含三个协调阶段:情景缓冲、语义巩固和图引导检索。

3.2 分层图记忆架构

随时间变化的记忆结构 定义为组合图:

- **主题关联网络 (Topic Associative Network, 全局图)**:用于长期保留,通过 LLM 语义评分器量化深度语义相关性。

- **事件进展图 (Event Progression Graph, 局部活动缓冲)**:针对快速更新进行优化,捕捉交互原子的时序与因果演变。

- **归档集 与跨层关联 **:作为索引,将全局主题节点连接到历史事件图的归档快照。

3.3 基于状态的记忆巩固

- 语义边界检测:使用 LLM 作为神经代理来判断语义发散是否超过阈值 。为节省算力,检测器仅在稀疏维护事件(如会话结束、缓冲溢出)时触发。

- 情景缓冲状态:专注于捕获对话细节,将事件原子 附加到局部图中,实现严格的写入隔离。

- 语义巩固状态:当检测到 时触发,将缓冲子图合并为新的语义节点 (包含大语言模型生成的摘要 和拼接的原始细节 ):通过由粗到细的候选选择策略,建立新的语义边 更新全局拓扑:完成后,局部图被归档并建立跨层链接。

3.4 图引导的多因素检索

该机制分三步实现自顶向下的穿越检索:

- 语义锚定与扩展:在全局图中识别 Top-K 节点并扩展其一阶邻居:

- 结构化下钻:遍历跨层链接 提取具体的情景细节节点集合 :

- 多因素重排:结合交叉编码器的基础语义概率 ,以及时间()、置信度()、角色()三种启发式因子进行调节:

4. 实验 (Experiments)

4.1 实验设置

- 数据集:LoCoMo (长周期开放域对话多维推理) 和 LongDialQA (复杂多方交互,如《生活大爆炸》、《老友记》剧本)。

- 基线模型:ReadAgent, Memorybank, MemGPT, MemoryOS, Mem0, A-Mem 等。

- LLM 骨干:Llama-3.2-3B, Qwen2.5-7B/14B, GPT-4o-mini。所有模型均为免训练即插即用。

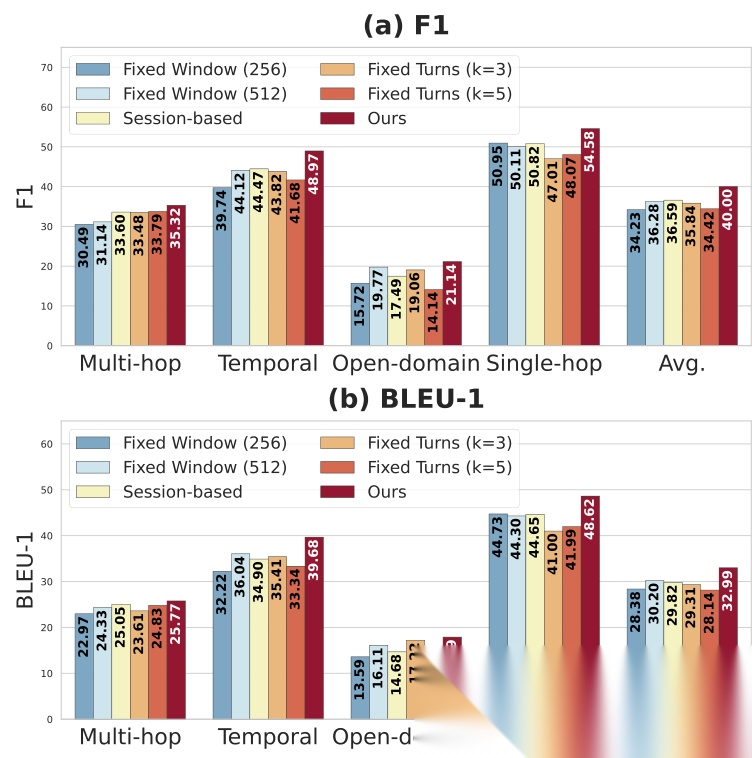

4.2 主要结果

在 LoCoMo(包含多跳、时序、开放域、单跳推理)以及 LongDialQA 测试中,GAM 在各种参数规模的模型上基本实现了最佳的 F1 和 BLEU-1 成绩。特别是在时序推理和处理多方对话方面,GAM 通过结构化的记忆有效弥补了小模型上下文容量有限的劣势。

4.3 消融实验

实验证明了各个组件的必要性。移除“事件进展图(EPG)”导致性能下降最为显著(证明叙事结构对时序鲁棒性至关重要);移除“状态切换机制(SSM)”导致的下降强调了解耦编码和巩固以防污染的必要性;移除 TAN 和 MFR 同样证实了顶层主题组织和多信号融合检索的价值。

4.4 主题划分策略分析

与固定窗口(256/512 tokens)、固定轮次或按会话划分的策略相比,GAM 基于“语义事件触发”的机制表现最佳,特别是在时序任务上优势明显。任意硬切断会破坏上下文和逻辑流,而 GAM 动态捕捉语义转移,避免了过度分块。

图3:划分策略对 LoCoMo 数据集的影响。本文基于语义边界的方法在多项指标上均优于启发式基线。

图3:划分策略对 LoCoMo 数据集的影响。本文基于语义边界的方法在多项指标上均优于启发式基线。

4.5 效率分析

GAM 实现了最低的 Token 消耗,相较于 Mem0 成本降低了 11%,且在推理延迟上与之相当,实现了极佳的效率-性能平衡。

5. 结论 (Conclusion)

本文提出的 GAM 框架有效缓解了 LLM 智能体在快速上下文感知与稳定知识保留之间的冲突。通过基于状态的切换分离缓冲与巩固过程,辅以图引导的多因素检索,GAM 在复杂推理与效率上优于当前强大的基线模型。未来工作将致力于把当前基于文本的系统扩展为原生多模态记忆框架。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献676条内容

已为社区贡献676条内容

所有评论(0)