主流大模型 API 快速上手

面向所有软件从业人员,手把手教你快速掌握五大主流 AI 大模型平台(OpenAI GPT、阿里通义千问、Anthropic Claude、Google Gemini、百度文心一言)的 API 调用。内容涵盖注册流程、API Key 获取、Python/Node.js 调用示例、计费说明、速率限制与重试机制。无论你是想将 AI 集成到产品中,还是自动化日常工作,这篇文章都能让你从零开始,快速上手。

一、引言

AI 大模型时代,每个软件从业者都必须掌握的 API 技能

如果你从事软件开发、运维、测试、数据分析、产品经理——任何与软件相关的岗位——那么过去两年你一定频繁听到一个词:大语言模型(Large Language Model, LLM)。

从 ChatGPT 的横空出世,到 Claude 在代码理解上的突破,再到通义千问、Gemini、文心一言等国产模型的迅速崛起,AI 大模型已经从"前沿技术实验"变成了"行业标准工具"。它正在重塑我们构建软件的方式:

- 智能客服 24/7 自动应答,大幅降低人工成本

- 代码助手 自动补全、代码审查、Bug 修复

- 内容生成 营销文案、技术文档、多语言翻译

- 数据分析 自然语言查询数据库,自动生成报表

- 知识管理 构建企业知识库,实现智能问答

而这一切的基础,都是 API 调用。

为什么你必须学会调用大模型 API?

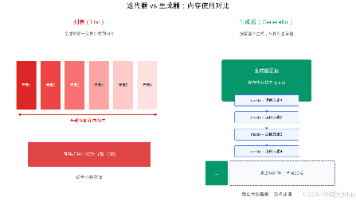

很多人会问:"我用 ChatGPT 网页版不就行了吗?为什么要学 API?"

答案很简单:网页版是玩具,API 才是生产力工具。

- 网页版只能一对一聊天,API 可以嵌入你的产品

- 网页版无法批量处理,API 可以自动化流水线

- 网页版无法定制,API 可以调整参数、接入自有数据

- 网页版无法规模,API 可以支撑百万级用户

无论你是想在产品中集成 AI 能力,还是想用 API 自动化日常工作中的重复任务,掌握大模型 API 调用都是一项必备技能。

这篇文章能帮你做什么?

本文将手把手带你完成从注册到调用的完整流程,覆盖目前主流的五大大模型平台:

| 平台 | 代表模型 | 特点 |

|---|---|---|

| OpenAI | GPT-5.4, GPT-5.4 mini | 生态最成熟,文档最完善 |

| 阿里通义千问 | Qwen-Max, Qwen-Plus | 中文能力强,国内访问快 |

| Anthropic | Claude Sonnet 4 | 代码理解出色,安全性高 |

| Gemini 2.0 | 多模态能力强,免费额度大 | |

| 百度 | ERNIE 4.0 | 中文理解好,国内生态完善 |

每个平台都会覆盖:注册流程、获取 API Key、Python/Node.js 调用示例、计费说明、速率限制。

准备好了吗?我们开始!

二、大模型 API 入门基础

在开始之前,你需要了解的核心概念

调用大模型 API 之前,有几个核心概念必须理解。它们是所有平台的通用语言,理解了这些,你才能高效使用任何大模型服务。

1. Token(词元)

Token 是大模型处理文本的基本单位。

大模型不是按"字"或"词"来处理文本的,而是按 Token。你可以粗略理解为:

- 英文:1 个 Token ≈ 0.75 个单词(约 4 个字符)

- 中文:1 个 Token ≈ 1 个汉字(不同模型有差异)

示例:"Hello, world!"→ 约 3-4 个 Token

示例:"今天天气很好"→ 约 6 个 Token

2. Context Window(上下文窗口)

Context Window 是模型一次能"记住"的最大文本量。

它包含了你发送的提示词(输入)加上模型生成的回复(输出)。常见模型的 Context Window:

| 模型 | Context Window | 约等于 |

|---|---|---|

| GPT-5.4 | 128,000 tokens | 约 96,000 个中文字 |

| Claude Sonnet 4 | 200,000 tokens | 约 150,000 个中文字 |

| Gemini 2.0 Flash | 1,000,000+ tokens | 约 750,000 个中文字 |

| Qwen-Max | 32,000 tokens | 约 24,000 个中文字 |

| ERNIE 4.0 | 7,000-21,000 tokens | 约 5,000-15,000 个中文字 |

3. Temperature(温度)

Temperature 控制生成内容的随机性和创造性。

- Temperature = 0:确定性最高,相同输入总是得到相同输出。适合:数据提取、分类、代码生成

- Temperature = 0.3-0.7:平衡创造性和准确性。适合:一般对话、文案撰写

- Temperature = 0.8-1.0:创造性最高,输出更随机。适合:创意写作、头脑风暴

4. Top-P(核采样)

Top-P 是另一种控制生成多样性的参数。

实用建议:通常只需要调整 Temperature,Top-P 保持 0.9 或 1.0 即可。两者不建议同时调整。

5. System Prompt(系统提示词)

System Prompt 是设定模型"角色"和"行为准则"的指令。

6. Stream(流式输出)

流式输出让模型逐字返回结果,而不是等全部生成完才返回。

API 调用的通用流程

1. 注册账号 → 2. 获取 API Key → 3. 安装 SDK → 4. 编写代码 → 5. 发起请求 → 6. 处理响应三、OpenAI GPT 系列 API

全球最流行的 AI 模型 API

OpenAI 是第一个将大语言模型 API 商业化的公司。它的生态最成熟、文档最完善、社区最大。如果你只能学一个平台的 API,选 OpenAI 准没错。

1. 注册流程

步骤 1:访问 platform.openai.com

步骤 2:点击 "Sign Up",支持 Google / Apple / Microsoft 账号登录或邮箱注册

步骤 3:验证邮箱地址

步骤 4:创建 API Key → Settings → API Keys → "Create new secret key"

⚠️ API Key 只在创建时显示一次,请务必立即保存!

2. Python 调用示例

# 安装:pip install openai

import os

from openai import OpenAI

client = OpenAI(api_key=os.environ.get("OPENAI_API_KEY"))

response = client.chat.completions.create(

model="gpt-5.4-mini",

messages=[

{"role": "system", "content": "你是一个有帮助的助手。"},

{"role": "user", "content": "用一句话解释什么是人工智能。"}

],

temperature=0.7,

max_tokens=100,

)

print(response.choices[0].message.content)3. Node.js 调用示例

// 安装:npm install openai

import OpenAI from "openai";

const openai = new OpenAI({

apiKey: process.env.OPENAI_API_KEY,

});

async function main() {

const response = await openai.chat.completions.create({

model: "gpt-5.4-mini",

messages: [

{ role: "system", content: "你是一个有帮助的助手。" },

{ role: "user", content: "用一句话解释什么是人工智能。" }

],

temperature: 0.7,

max_tokens: 100,

});

console.log(response.choices[0].message.content);

}

main().catch(console.error);4. 计费说明

| 模型 | 输入价格 | 输出价格 | 上下文 |

|---|---|---|---|

| GPT-5.4 nano | $0.20/百万 tokens | $1.25/百万 tokens | 128K |

| GPT-5.4 mini | $0.75/百万 tokens | $4.50/百万 tokens | 128K |

| GPT-5.4 | $2.50/百万 tokens | $15.00/百万 tokens | 128K |

| o3 | $10.00/百万 tokens | $40.00/百万 tokens | 200K |

5. 速率限制

免费层(Tier 1):GPT-5.4 mini 约 200 RPM / 40,000-200,000 TPM

付费层(Tier 2+):500-5,000 RPM / 50,000-800,000 TPM

四、阿里通义千问(Qwen)API

中文能力最强的国产模型

阿里通义千问由阿里巴巴达摩院研发,是国内最早开放的大语言模型之一。它对国内用户非常友好——无需科学上网,注册简单,还有免费额度。

1. 注册流程

步骤 1:访问 dashscope.console.aliyun.com

步骤 2:使用阿里云账号登录(支持手机号注册)

步骤 3:完成实名认证

步骤 4:创建 API Key → "API-KEY 管理" → "创建新的 API-KEY"

2. Python 调用示例(OpenAI 兼容格式)

# 安装:pip install openai

from openai import OpenAI

client = OpenAI(

api_key=os.environ.get("DASHSCOPE_API_KEY"),

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1",

)

response = client.chat.completions.create(

model="qwen-plus",

messages=[{"role": "user", "content": "用一句话解释什么是人工智能。"}],

temperature=0.7,

)3. 计费说明

| 模型 | 输入价格 | 输出价格 | 上下文 |

|---|---|---|---|

| Qwen-Turbo | 免费 | 免费 | 8K |

| Qwen-Plus | ¥0.0008/千 tokens | ¥0.002/千 tokens | 32K |

| Qwen-Max | ¥0.004/千 tokens | ¥0.012/千 tokens | 8K |

| Qwen-Long | ¥0.0005/千 tokens | ¥0.002/千 tokens | 10M |

五、Anthropic Claude API

代码理解和安全性的标杆

Claude 系列以出色的代码理解能力、安全对齐和长上下文处理能力著称。如果你需要处理复杂代码或文档,Claude 是首选。

1. 注册流程

步骤 1:访问 console.anthropic.com

步骤 2:使用 Google 账号或邮箱注册

步骤 3:创建 API Key → "API Keys" → "Create Key"

2. Python 调用示例

# 安装:pip install anthropic

from anthropic import Anthropic

client = Anthropic(api_key=os.environ.get("ANTHROPIC_API_KEY"))

message = client.messages.create(

model="claude-sonnet-4-20250514",

max_tokens=1024,

messages=[

{"role": "user", "content": "用一句话解释什么是人工智能。"}

],

temperature=0.7,

)

print(message.content[0].text)3. 计费说明

| 模型 | 输入价格 | 输出价格 | 上下文 |

|---|---|---|---|

| Claude 3.5 Haiku | $0.80/百万 tokens | $4.00/百万 tokens | 200K |

| Claude Sonnet 4 | $3.00/百万 tokens | $15.00/百万 tokens | 200K |

六、Google Gemini API

免费额度最大的多模态王者

Google Gemini 以多模态能力和超长的 Context Window 著称。它的免费额度是几大平台中最大的,非常适合学习和原型开发。

1. 注册流程

步骤 1:访问 aistudio.google.com

步骤 2:使用 Google 账号一键登录

步骤 3:"Get API Key" → "Create API Key in new project"

2. Python 调用示例

# 安装:pip install google-genai

from google import genai

client = genai.Client(api_key=os.environ.get("GEMINI_API_KEY"))

response = client.models.generate_content(

model="gemini-2.0-flash",

contents="用一句话解释什么是人工智能。"

)

print(response.text)3. 计费说明

| 模型 | 免费层 | 付费层(输入) | 付费层(输出) |

|---|---|---|---|

| Gemini 2.0 Flash | 15 RPM / 1M tokens/天 | $0.10/百万 tokens | $0.40/百万 tokens |

| Gemini 2.0 Pro | 2 RPM | $1.25/百万 tokens | $10.00/百万 tokens |

七、百度文心一言 API

国内生态完善的中文大模型

百度文心一言(ERNIE)由百度研发,在中文理解、知识问答等方面表现优异。通过百度智能云千帆平台提供服务。

1. 注册流程

步骤 1:访问 cloud.baidu.com

步骤 2:使用手机号注册百度账号

步骤 3:完成实名认证

步骤 4:进入千帆平台 → 创建应用 → 获取 API Key 和 Secret Key

2. Python 调用示例

# 安装:pip install requests

import os

import requests

def get_access_token():

api_key = os.environ.get("BAIDU_API_KEY")

secret_key = os.environ.get("BAIDU_SECRET_KEY")

response = requests.post(

"https://aip.baidubce.com/oauth/2.0/token",

params={

"grant_type": "client_credentials",

"client_id": api_key,

"client_secret": secret_key,

}

)

return response.json().get("access_token")

def call_ernie(prompt):

access_token = get_access_token()

url = f"https://aip.baidubce.com/rpc/2.0/ai_custom/v1/wenxinworkshop/chat/completions_pro?access_token={access_token}"

response = requests.post(url, json={

"messages": [{"role": "user", "content": prompt}],

"temperature": 0.7,

}, headers={"Content-Type": "application/json"})

return response.json().get("result", "")3. 计费说明

| 模型 | 输入价格 | 输出价格 | 上下文 |

|---|---|---|---|

| ERNIE Speed | ¥0.0008/千 tokens | ¥0.002/千 tokens | 7K |

| ERNIE Lite | 免费 | 免费 | 7K |

| ERNIE 4.0 | ¥0.03/千 tokens | ¥0.09/千 tokens | 7K |

| ERNIE 4.0 Turbo | ¥0.008/千 tokens | ¥0.024/千 tokens | 128K |

八、通用最佳实践

让你的 API 调用更稳定、更安全、更省钱

1. 错误处理与重试机制

| 错误类型 | HTTP 状态码 | 处理方式 |

|---|---|---|

| 网络超时 | - | 自动重试 |

| 速率限制 | 429 | 等待后重试 |

| 服务器错误 | 500/502/503 | 等待后重试 |

| 认证失败 | 401 | 检查 Key |

| 参数错误 | 400 | 检查代码 |

指数退避重试策略(Python)

import time, random

def chat_with_retry(client, messages, max_retries=3, base_delay=1.0):

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model="gpt-5.4-mini", messages=messages

)

return response.choices[0].message.content

except RateLimitError:

if attempt == max_retries - 1: raise

delay = (base_delay * (2 ** attempt)) + random.uniform(0, 1)

time.sleep(delay)2. API Key 安全管理

- 使用环境变量存储 API Key

- 使用 .env 文件 + .gitignore

- 生产环境使用密钥管理服务

- 定期轮换 API Key

3. 成本控制技巧

| 策略 | 说明 | 节省效果 |

|---|---|---|

| 选择合适的模型 | 简单任务用 mini/flash 模型 | 50-90% |

| 精简提示词 | 删除不必要的上下文 | 10-30% |

| 控制 max_tokens | 限制最大输出长度 | 20-50% |

| 缓存重复结果 | 相同的提示词只调用一次 | 30-70% |

| 使用免费额度 | 各平台的免费额度先用起来 | 100% |

九、快速参考表

各平台核心数据一目了然

| 特性 | OpenAI | 通义千问 | Claude | Gemini | 文心一言 |

|---|---|---|---|---|---|

| 注册门槛 | 中 | 低 | 高 | 低 | 低 |

| 代表模型 | GPT-5.4 | Qwen-Plus | Sonnet 4 | Gemini 2.0 | ERNIE 4.0 |

| 最大上下文 | 128K | 32K | 200K | 1M+ | 7K-21K |

| 流式输出 | ✅ | ✅ | ✅ | ✅ | ✅ |

| Python SDK | openai | dashscope | anthropic | google-genai | requests |

| Node.js SDK | openai | openai 兼容 | @anthropic-ai/sdk | @google/genai | axios |

SDK 安装命令速查

# Python

pip install openai # OpenAI

pip install dashscope # 通义千问

pip install anthropic # Claude

pip install google-genai # Gemini

pip install requests # 文心一言

# Node.js

npm install openai # OpenAI / 通义千问

npm install @anthropic-ai/sdk # Claude

npm install @google/genai # Gemini

npm install axios # 文心一言十、总结

关键要点回顾

- 五大主流平台(OpenAI、通义千问、Claude、Gemini、文心一言)的完整注册和调用流程

- Python 和 Node.js 双语言调用示例,包含错误处理和流式输出

- 计费规则和速率限制,帮你控制成本避免踩坑

- 通用最佳实践,写出生产级的 API 调用代码

如何选择适合你的 API?

| 场景 | 推荐 | 理由 |

|---|---|---|

| 国内用户 | 通义千问 / 文心一言 | 国内访问快,中文能力强 |

| 国际用户 | OpenAI / Claude | 生态成熟,全球覆盖 |

| 代码能力 | Claude | 代码理解出色 |

| 多模态 | Gemini | 原生多模态支持 |

| 预算有限 | Gemini 免费层 + 通义千问 | 免费额度最大 |

你的下一步

- 选一个平台,注册账号,获取 API Key

- 运行本文的代码示例,确保能跑通

- 在你的项目中集成,从小功能开始尝试

- 监控 Token 消耗,合理控制成本

- 探索高级功能:Function Calling、多轮对话、向量嵌入

AI 大模型 API 已经是非常成熟的工具了。与其观望,不如动手试试。最好的学习方式,就是现在调用你的第一个 API。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)