让 AI 少废话,token 直降 75%,这个插件有点狠

作者测了 31 个模型,1485 道题,发现当你强制大模型回答得更短,有些任务上的准确率不但没掉,反而能往上抬 26 个百分点。你让它帮你 debug,一个报错它能先给你铺三段背景,再给你讲一段原理,最后真正有用的,可能就是最后三行代码。它一旦开始铺陈,开始补充,开始自我解释,那个过程本身就会引入噪音,引入幻觉,引入绕远路的错误。

事情是这样的。

我今天去翻了 Julius Brussee 做的那个 caveman 插件 repo。

本来我以为,这又是一个 AI 圈标准整活项目。名字好笑,口号也好笑,什么 why use many token when few do trick,一看就像是拿程序员黑话做梗图的那种东西。

结果我往下多翻了几屏,给我看坐直了。

因为它打的,不是什么玄学 prompt。

它打的是一个几乎所有人都已经被折磨过的问题。

AI 太爱废话了。

你让它帮你 debug,一个报错它能先给你铺三段背景,再给你讲一段原理,最后真正有用的,可能就是最后三行代码。

你让它改文案,它先表演礼貌。

你让它解释接口,它先表演周到。

你让它 review 代码,它先表演理解你。

不是这些东西完全没价值。

而是很多时候,你要的根本不是陪伴。

是结果。

caveman 干的事就很暴力。

不是让模型变聪明。

也不是换一个更便宜的小模型。

而是直接拿掉输出里那些最不值钱的部分。冠词删掉,填充词删掉,客套话删掉,代码和报错原样保留,能一句说完的绝不说三句。

README 里放了个特别传神的对比。我一眼就记住了。

普通输出

Your component re-renders because you create a new object reference each render. Inline object props fail shallow comparison every time. Wrap it in useMemo.

caveman 输出

New object ref each render. Inline object prop = new ref = re-render. Wrap in useMemo.

你看,信息没丢。

但那层 AI 最爱裹在外面的棉花,全没了。

图片

更好笑的是,这个插件不是单纯一个开关。

它还分四档。

Lite,删废话,但句子还是正常人类句子。

Full,默认档,已经开始穴居人说话了,碎片句,短促,直接。

Ultra,更狠,电报体,能缩就缩。

还有个文言文模式,我第一次看到直接笑出了声。英文信息,拿古汉语去压缩,荒诞得像个玩笑,但又确实有一种邪门的合理性。

我是真的觉得,这个产品有点抓住时代情绪了。

因为这不是 Julius 一个人的痛点。

是现在几乎所有重度用 AI 的人,尤其是程序员、产品、运营、写作者,共享的一个烦躁。

我们已经被训练出了一个很矛盾的工作习惯。

一方面,我们越来越依赖 AI。

另一方面,我们越来越受不了 AI 的腔调。

它总想显得全面。

总想显得稳妥。

总想显得自己考虑得很多。

可人在真实工作里,不是每次都想听完整推理链。

很多时候你只想知道一件事。

错在哪。

先改哪。

风险在哪。

下一步干嘛。

如果你不是天天写代码的人,可能还没那么强烈。

但如果你经常拿 AI 做 debug、做 code review、查报错、看日志,你应该特别懂这个感觉。

你盯着终端看了十分钟,屏幕上滚过去 1200 个 token,最后发现真正能救命的,就两句。

那一刻真的有种一时间无语凝噎的感觉。

不是哥们,你早说啊。

这也是我觉得 caveman 不只是一个梗插件的原因。

它不是在装疯卖傻。

它是在认真做信息压缩。

而且压缩的位置很聪明。

不是压知识。

是压语气。

不是压 technical substance。

是压包装。

这俩东西,差太远了。

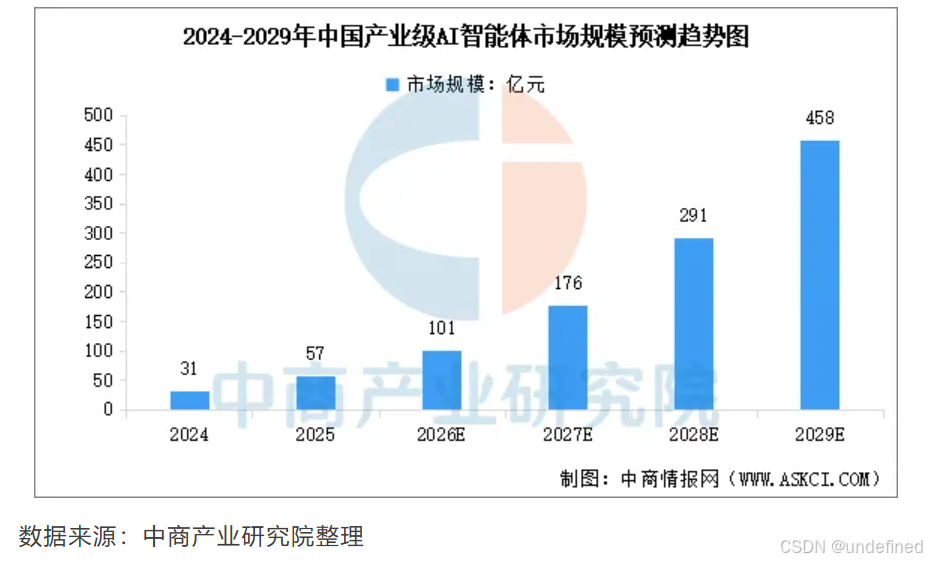

我又往 repo 的 benchmark 那块翻了翻,这里反而更让我上头。

很多人看到主页上那个 69 到 19 tokens 的例子,会以为这是挑了一个最好看的 demo。

我一开始也是这么想的。

结果它后面还真给了几组更像真实工作的数据。

React debug,从 69 到 19,少了 87%。

Auth bug fix,从 704 到 121,少了 83%。

PostgreSQL 项目分析,从 1200 到 232,少了 81%。

再往完整 benchmark 表里看,平均输出从 1214 压到 294,整体少了 65%。有的任务保守一点,有的任务直接砍掉大半截。

这时候你会发现,所谓 75% 省 token,不只是一个营销数字。

它在很多高频场景里,是真的能摸到那个量级。

这玩意对谁最狠。

不是对模型。

是对你的账单,对你的等待时间,对你每天被 AI 废话刷屏的耐心。

更妙的是,README 里还挂了一篇 2026 年 3 月的 arXiv 预印本,编号 2604.00025,题目叫 Brevity Constraints Reverse Performance Hierarchies in Language Models。

先说前面,我自己今天还没亲手把这篇论文从头跑到尾,所以不拿它当圣经。

但它那个结论,真的很戳我。

作者测了 31 个模型,1485 道题,发现当你强制大模型回答得更短,有些任务上的准确率不但没掉,反而能往上抬 26 个百分点。

你敢信???

这个结论最有意思的地方,不是它在给 caveman 站台。

而是它在提醒我们一件被很多人忽略的事。

大模型有时候不是不会。

是想太多。

它一旦开始铺陈,开始补充,开始自我解释,那个过程本身就会引入噪音,引入幻觉,引入绕远路的错误。

这就特别像什么呢。

特别像一个本来知道答案的人,被要求上台做五分钟即兴发言。前二十秒很清楚,越往后越跑偏,最后把自己都讲进去了。

所以你顺着这个思路再看 caveman,就会发现它的狠,不只是省 token。

它像一个输出侧的节流阀。

你不让模型胡思乱讲,你先逼它把核心答案交出来。

有点像面试官打断应聘者,说兄弟别铺垫了,先回答问题。

有点粗暴。

但很多时候,粗暴反而有效。

当然,话也得说回来。

我非常理解有些人会本能反感这种东西。

你可能会觉得,太短了会不会漏细节。

你可能会觉得,AI 本来就容易答非所问,再压缩,不就更像拍脑袋了吗。

这种担心完全合理。

而且 caveman 也不是那种无脑把所有输出都剁碎的东西。

它给了 Lite、Full、Ultra 这些档位,其实已经在承认一件事,不同任务,需要不同长度。

你做架构设计,肯定不能跟修一个 import 报错用同一套输出密度。

你写 PRD,不会想看穴居人。

你查一个 null pointer,八成就想看穴居人。

这也是我觉得它比较高级的地方。

它不是在宣告长回答死了。

它是在把输出长度这件事,重新变成一个可调参数。

以前我们老在 prompt 里拼命加东西。

加角色。

加背景。

加步骤。

加要求。

现在终于有人认真在做减法了。

而且这个减法,不是那种玄而又玄的减法。

是能立刻感知到的减法。

删掉 a、an、the。

删掉 just、basically、really、simply。

删掉 Sure、Happy to、Let me explain 这种礼貌前摇。

你想想看,这些词拿掉之后,答案会不会突然失去灵魂。

不会。

它只是终于开始尊重你的时间了。

图片

再聊安装这块,我也顺手看了下,支持面其实比我预想的大。

Claude Code 能直接装插件。

Codex 在 repo 里可以走 /plugins。

Gemini CLI 可以直接装 extension。

Cursor、Windsurf、Copilot、Cline 这些,也都能用 npx skills add JuliusBrussee/caveman 这一套装上 skill。

往直白了聊,不管你现在主要用哪一家的 agent,大概率都能试。

如果你想先感受一下它到底有没有那么神,我反而建议别上来就全局常驻。

太猛了。

先拿一个最具体的场景试。

比如下一次你让 AI 帮你 debug React 重渲染,或者解释一段你自己都懒得看的错误日志,你直接把 caveman 打开,对比一下前后输出。

你很快就会知道自己是不是那拨人。

因为这个东西不是所有人都会爱。

但一旦对上口味,很可能就回不去了。

我有时候觉得,AI 产品这波真正开始分层,不是在模型参数上分。

是在交互密度上分。

有的人喜欢一个认真负责、会铺垫、会安抚、会解释前因后果的助手。

有的人已经进入下一阶段了。

他不要助手。

他要副驾驶。

他不要情绪价值。

他要指令和结果之间那条最短路径。

caveman 打中的,就是后面这群人。

更大的感触其实还不是这个插件本身。

而是它背后那种特别朴素的判断。

过去一年,大家都在教 AI 多想一点,多推理一点,多展开一点。

现在突然有人反过来问了一句。

少说一点,行不行。

结果这一问,问出来个爆款插件,也顺手问出来一个挺扎心的事实。

很多时候,真正稀缺的不是信息量。

是信息密度。

不是模型能不能再多讲一段。

是它能不能在该闭嘴的时候闭嘴。

这话听着有点刺耳但,我是真的觉得,这种产品会越来越多。

因为大模型时代走到今天,大家已经不是第一次用 AI 了。

新鲜感过去之后,真正决定体验的,往往不是能力上限。

是摩擦力。

一次多余的铺垫,一段没必要的安慰,一坨重复解释,看起来都不大。

但你每天跟 AI 来回几十轮,它们会慢慢堆成一种非常真实的疲惫。

谁先把这层疲惫拿掉,谁就更像下一代工具。

所以这个叫 caveman 的插件为什么会火。

我自己的答案很简单。

它让 AI 终于学会了一件以前很不擅长的事。

闭嘴。

而且是聪明地闭嘴。

项目地址我放这,github.com/JuliusBrussee/caveman。

论文也放这,arXiv 2604.00025。

如果你是那种已经被 AI 长篇大论折磨到有点 PTSD 的人,真的可以去试一下。

也许你装上的不是一个插件。

而是一个更适合自己的 AI 工作流。

大时代啊,朋友们。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~

谢谢你看我的文章,我们,下次再见。

/ 作者,文浩 / Web,wenhaofree.com

原文:https://mp.weixin.qq.com/s/FhAbt8TAu5mDa1CL-9eYJQ

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)