2026年学AI,别再只会写Prompt:Agent开发完整入门,看这一篇就够了

2026年学AI,别再只会写Prompt:Agent开发完整入门,看这一篇就够了

很多工程师这两年学 AI,路径几乎一致:先学 Prompt,再学 RAG,然后开始接 function calling。问题是,到了 2026 年,如果你还把“会写 Prompt”当成 AI 开发的核心能力,基本已经落后了。

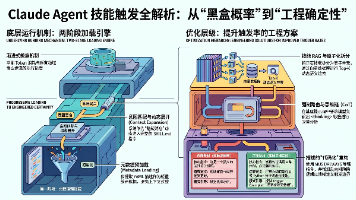

原因很简单:生产环境里的 AI 系统,越来越不是“问一句、答一句”的聊天程序,而是能读文件、调工具、跑命令、维护状态、支持审批、可恢复执行、可观测调试的 agent 系统。OpenAI、Anthropic、Google Cloud、LangChain 这一轮官方能力更新,几乎都在指向同一件事:AI 应用的竞争点,已经从 Prompt engineering,转向 Agent engineering。

本文不讲空泛概念,直接从工程视角带你把 Agent 开发的核心版图梳理清楚:什么是 agent、为什么 Prompt 不够、SDK 和托管平台怎么选、最小可落地架构怎么搭、代码怎么写、线上怎么排错。

摘要

摘要:2026 年 AI 工程的重点,已经从“优化提示词”升级为“构建可执行、可观测、可恢复的 agent 运行系统”。

本文核心观点有 5 个:

-

Prompt 只是输入接口,不是系统能力。

真正的 agent 开发,重点在 orchestration、tool execution、state、approval、runtime、observability。[2][6] -

Agent SDK 正在成为主流开发入口。

OpenAI Agents SDK、Claude Agent SDK 都明确支持在代码中构建 agent,并把工具、上下文、执行循环开放给开发者。[2][3] -

2026 年的 agent 已经具备“执行环境”。

OpenAI 新版能力强调 model-native harness、原生 sandbox 执行、文件与工具协作,以及 durable execution。[1] -

效果提升不只靠换模型,更靠 harness engineering。

LangChain 给出的案例表明,不换模型、只优化 harness,就能显著提高 agent 基准表现。[4] -

Agent 开发已经进入平台工程阶段。

Google Vertex AI Agent Builder / Agent Engine 把 build、scale、govern、runtime、observability、安全治理整合为完整平台。[5][7]

为什么“只会写Prompt”已经不够了

摘要:Prompt engineering 解决的是“怎么问”,Agent engineering 解决的是“系统如何完成任务”。

先看一个对比。

如果你做的是简单问答、文本分类、摘要生成,那么 Prompt 足够用。

但只要业务目标变成下面这类任务,Prompt 就会迅速失效:

- 读取项目目录下多个文件

- 调接口查数据,再写入数据库

- 执行 shell 命令验证结果

- 多轮调用工具后汇总输出

- 中断后恢复任务继续跑

- 某些动作必须人工审批

- 需要 trace 整个执行路径,定位失败步骤

这些都不是“提示词写得好不好”的问题,而是运行时能力的问题。

OpenAI 官方文档对 Agents SDK 的定义就很明确:当应用端需要自己掌控 orchestration、tool execution、approvals 与 state 时,应该走 Agents SDK 路线,而不是停留在最简单的 API 调用层。[2]

LangChain 在 2026 年也明确提出:agent framework 依然重要,因为真正难的是编排、可控性、durability、observability,而不是单次生成。[6]

换句话说:

- Prompt engineering:让模型回答得更像样

- Agent engineering:让系统真的把任务做完

这两者不是替代关系,而是层级关系。Prompt 是 agent 的一部分,但绝不是全部。

2026年Agent开发的核心能力版图

摘要:一个可落地的 agent,不是一个 Prompt,而是一套“模型 + harness + 工具 + 状态 + 运行时”的系统。

从各家官方能力看,2026 年 agent 的基础构成已经比较清晰。

1. 模型层

负责推理、计划、决策、生成结果。

但模型本身并不直接决定系统可用性,外围 harness 设计同样关键。[4]

2. Harness / Orchestration 层

这是 2026 年特别值得重视的概念。LangChain 把它叫 harness engineering:系统提示、工具选择、执行流设计、失败恢复、上下文注入方式,都属于 harness。[4]

OpenAI 在 2026-04-15 发布的新能力里,进一步提出 model-native harness,强调 agent 可以更自然地在文件、工具和 sandbox 中执行任务。[1]

3. Tool 层

包括:

- 搜索

- 文件系统

- 命令行

- HTTP/API

- 数据库

- 企业内部服务

- IDE / MCP 插件能力

Claude Agent SDK 明确提供与 Claude Code 同源的 tools、agent loop 与 context management,可让 agent 读文件、跑命令、搜网页、改代码。[3]

4. State / Memory 层

Agent 不是一次性调用,而是持续任务流,因此必须有状态。

OpenAI Agents SDK 文档和 Google Agent Builder 都强调 memory、state、snapshot、持久化运行的重要性。[1][2][5]

5. Runtime / Sandbox 层

2026 年的 agent 越来越像“受控执行程序”。

OpenAI 文档指出 Python Agents SDK 已提供 sandbox agents,可使用容器化环境、文件、命令、包、端口、快照与内存。[2]

6. Observability / Eval 层

LangChain 特别强调 tracing 能帮助定位 failure modes,并指出 agent 工程中“构建和测试正在合流”。[4][6]

所以,一个成熟 agent 的工程结构,不再是:

User -> Prompt -> LLM -> Result

而更像:

User Goal -> Planner/Policy -> Tools/Sandbox -> State/Memory -> Approvals -> Trace/Eval -> Result

Agent SDK、直连API、托管平台,到底怎么选

摘要:选型的关键不是“哪个更先进”,而是你要控制多少运行时细节。

OpenAI 官方把路径分成三类:[2]

- 直连 API client

- Agents SDK

- 托管式 Agent Builder

这是非常实用的分类方式,基本适用于所有厂商生态。

1. 直连 API client

适合:

- 单轮生成

- 轻量 function calling

- 低复杂度业务

- 快速验证想法

优点是简单、开发快。

缺点是当任务需要状态管理、审批流、恢复执行、复杂工具链时,代码很快会失控。

2. Agents SDK

适合:

- 你要自己控制 orchestration

- 要接自定义工具

- 要加审批与状态

- 要做 trace、eval、重试、恢复

- 要与现有系统深度集成

这类方式最适合工程团队。OpenAI 和 Anthropic 都在强化这条路线。[2][3]

3. 托管式 Agent Builder / Engine

适合:

- 企业级落地

- 多团队协作

- 强治理需求

- 托管运行与部署

- 云侧安全和审计要求高

Google Vertex AI Agent Builder 和 Agent Engine 明确把能力分为 Build、Scale、Govern,并提供 observability、IAM、安全隔离、托管 runtime 等完整企业配套。[5][7]

如果你是个人开发者或小团队,建议先从 SDK 模式入手;

如果你是中大型团队,目标是生产环境稳定运行,通常会逐步走向 SDK + 托管运行时 的组合。

Key Comparison Table

摘要:下面这张表可以帮助你快速做技术路线判断。

| Dimension | 直连 API Client | Agents SDK | 托管式 Agent Builder/Engine | 适用场景 |

|---|---|---|---|---|

| 开发复杂度 | 最低 | 中等 | 前期低、平台集成中高 | PoC、Demo、生产系统 |

| 编排控制力 | 弱 | 强 | 中到强,取决于平台开放度 | 复杂任务流优先 SDK |

| 工具执行能力 | 基础 function calling | 强,可接文件、命令、API、sandbox | 强,通常带托管工具链 | 文件处理、自动化任务 |

| 状态与记忆管理 | 需自行拼装 | 可系统化实现 | 平台通常内建支持 | 长任务、多轮协作 |

| Durable Execution | 一般需要自己做 | 可结合快照/持久化机制实现 | 平台支持更成熟 | 长耗时、容器易失环境 |

| 可观测性与 Trace | 依赖自建 | 可接 tracing/eval | 通常内建日志/监控/审计 | 生产排错与评估 |

| 安全治理 | 自己实现 | 自己主导 | 平台能力更完整 | 企业级合规 |

| 推荐对象 | 入门、轻应用 | 工程团队主力方案 | 企业平台团队 | 从验证到规模化上线 |

一个工程上靠谱的Agent最小架构

摘要:别一上来就做“全自动智能体”,先搭一个可控、可观察、可回退的最小闭环。

下面给一个比较实用的最小架构:

第 1 层:任务入口

输入不是 Prompt,而是目标对象,例如:

- 帮我分析某目录代码缺陷

- 根据订单数据生成日报

- 在测试环境执行回归脚本并汇总异常

第 2 层:任务计划器

由模型负责将目标拆成子任务,但要有明确限制:

- 最大步骤数

- 允许使用哪些工具

- 哪些动作必须审批

- 遇到异常如何回退

第 3 层:工具与执行环境

最小建议至少具备:

- 文件读写

- HTTP 请求

- shell 命令

- 结构化结果返回

如果涉及代码、文档、数据处理,sandbox 非常重要。OpenAI 官方已经把容器化 sandbox agent 作为标准能力之一。[2]

第 4 层:状态存储

至少保存:

- 当前目标

- 已执行步骤

- 工具调用结果

- 中间产物文件

- 人工审批记录

- 快照位置

OpenAI 新能力中的 durable execution 提到可通过 snapshotting 与 rehydration 恢复 agent 状态,在容器失效后继续执行。[1]

这对长任务非常关键。

第 5 层:观测与评估

至少记录:

- 每一步 prompt / policy

- 工具调用参数与结果

- 错误原因

- token / latency / cost

- 最终成功率

LangChain 强调 tracing 是定位 failure modes 的核心手段。[4]

一句话总结这个最小架构:

先让 agent 可控,再让它变强;先让它能调试,再让它更自动。

实战代码示例

摘要:下面给出两个最小示例,帮助你把“Prompt 调用”升级为“Agent 任务执行”。

示例一:Python 版最小 Agent 任务编排骨架

# 目的:演示一个最小 agent 骨架,包含目标、工具注册、步骤执行、状态记录

from dataclasses import dataclass, field

from typing import List, Dict, Any

import subprocess

import requests

@dataclass

class AgentState:

# 保存任务目标与执行痕迹,便于重试与排错

goal: str

steps: List[Dict[str, Any]] = field(default_factory=list)

artifacts: Dict[str, Any] = field(default_factory=dict)

def tool_http_get(url: str) -> str:

# 工具1:访问外部HTTP接口

resp = requests.get(url, timeout=10)

resp.raise_for_status()

return resp.text[:500]

def tool_shell(cmd: str) -> str:

# 工具2:执行受控命令;生产环境应放入 sandbox 中执行

result = subprocess.run(cmd, shell=True, capture_output=True, text=True, timeout=20)

return result.stdout[-1000:] if result.returncode == 0 else result.stderr[-1000:]

def run_agent(state: AgentState):

# 简化版策略:根据目标选择动作;真实项目中可由模型决策

if "检查服务状态" in state.goal:

output = tool_http_get("https://example.com/health")

state.steps.append({"tool": "http_get", "input": "/health", "output": output})

elif "查看当前目录" in state.goal:

output = tool_shell("ls -la")

state.steps.append({"tool": "shell", "input": "ls -la", "output": output})

else:

state.steps.append({"tool": "noop", "input": state.goal, "output": "未匹配到可执行策略"})

return state

if __name__ == "__main__":

# 入口:构造目标并运行

state = AgentState(goal="查看当前目录")

final_state = run_agent(state)

print(final_state.steps)

这个例子故意保持简单,但它体现了 agent 与普通 Prompt 调用的关键差别:

- 有明确的

state - 有可替换的

tool - 有执行记录

steps - 后续可以接入审批、快照、trace、重试

示例二:TypeScript 版带审批门禁的工具执行

// 目的:演示 agent 在调用高风险工具前加入 approval gate

type StepRecord = {

tool: string;

input: string;

approved: boolean;

output: string;

};

class AgentRunner {

private steps: StepRecord[] = [];

async requireApproval(action: string): Promise<boolean> {

// 关键步骤:生产环境这里可接审批系统、工单系统或人工确认UI

console.log(`待审批动作: ${action}`);

return action.startsWith("read:"); // 示例:仅允许读操作自动通过

}

async executeTool(action: string): Promise<string> {

// 简化工具层;真实项目应接 sandbox / 文件系统 / 外部 API

if (action === "read:config") {

return "config loaded";

}

if (action === "write:prod-config") {

return "write attempted";

}

return "unknown action";

}

async run(action: string) {

// 关键步骤:先审批,再执行,再记录

const approved = await this.requireApproval(action);

if (!approved) {

this.steps.push({ tool: "approval_gate", input: action, approved, output: "rejected" });

return this.steps;

}

const output = await this.executeTool(action);

this.steps.push({ tool: "tool_exec", input: action, approved, output });

return this.steps;

}

}

// 示例入口

(async () => {

const runner = new AgentRunner();

console.log(await runner.run("read:config"));

console.log(await runner.run("write:prod-config"));

})();

这个示例对应 OpenAI 文档里强调的 approvals 场景。[2]

很多团队做 agent 最大的问题,是一上来就“全自动”,结果在生产环境里很难控风险。工程上更推荐:

- 读操作自动通过

- 写操作需审批

- 外部系统变更必须记录 trace

- 高危工具只允许在 sandbox 执行

代码块注释规范

摘要:Agent 代码的注释重点不是解释语法,而是解释“为什么这样编排”。

写 agent 相关代码时,建议遵守下面 4 条规则:

1. 注释先写“目的”,再写“实现”

比如不要只写“调用工具”,而要写成:

- 目的:读取健康检查接口,验证服务是否可用

- 实现:通过 HTTP GET 调用

/health

这样更便于排查业务意图是否被正确执行。

2. 对高风险步骤必须注明边界

如 shell、文件写入、数据库更新、生产配置变更等,要在注释里明确:

- 是否需要审批

- 是否必须在 sandbox 执行

- 失败后的回滚策略是什么

3. 对状态字段写清恢复用途

例如 snapshot_id、artifacts、steps,建议注明:

- 用于断点恢复

- 用于 trace 回放

- 用于评估 agent 行为

4. 注释不要重复代码表面含义

比如 i += 1 上面写“变量加一”没有价值。

应优先注释:

- 业务约束

- 安全边界

- 编排策略

- 失败处理

观测、调试与Harness优化,才是Agent工程分水岭

摘要:2026 年 agent 效果提升的关键,不只是换大模型,而是系统性优化 harness 与 trace。

很多人做 agent,失败后第一反应是:

- 模型不够强

- Prompt 不够长

- 上下文不够多

但 LangChain 在 2026-02-17 的文章给出很有代表性的证据:

在保持模型不变的情况下,仅通过 harness 调整,就把 coding agent 在 Terminal Bench 2.0 上的成绩从 52.8 提升到 66.5。[4]

这说明什么?

说明 agent 的上限,不只取决于模型参数,而大量取决于这些工程因素:

1. System Prompt 是否约束清晰

比如:

- 什么时候先读文件再写

- 什么时候必须验证命令输出

- 失败时是重试还是求助用户

2. 工具选择是否合理

工具过多会增加决策噪声;

工具过少又无法完成任务。

工具设计必须围绕任务闭环,而不是“能接多少接多少”。

3. 执行流是否可控

要不要 planner?

是单 agent 还是 subagents?

是否允许并发?

是否设置最大步数?

这些都属于 harness 设计。

4. 是否有 trace

没有 trace,就很难回答:

- agent 为什么调用错工具

- 为什么陷入循环

- 为什么上下文污染

- 为什么在第 7 步失控

LangChain 认为 tracing 是定位 failure modes 的核心手段。[4]

5. 是否支持 durability

长任务最怕容器挂掉、超时、上下文丢失。

OpenAI 提到 durable execution 可借助 snapshotting 和 rehydration 恢复执行。[1]

这已经不是“高级功能”,而是生产必要能力。

所以,真正的 agent 调优顺序应该是:

先看 trace -> 再改 harness -> 再看工具设计 -> 最后才是换模型。

常见问题与排错

摘要:多数 agent 问题,不是模型“笨”,而是编排、工具和状态设计出了问题。

1. Agent 总是选错工具

先检查工具描述是否过于相似,输入输出是否不清晰;必要时减少工具数量,按场景分组暴露。

2. Agent 容易无限循环

给每轮任务设置最大步数、重复动作检测、失败退出策略;必要时加入人工确认点。

3. 跑到一半环境挂了,任务丢失

需要引入快照与状态持久化。OpenAI 已明确支持 durable execution 的 snapshotting / rehydration 思路。[1]

4. 线上问题无法复现

必须保存 trace,包括步骤、工具参数、关键中间结果、错误栈和最终输出。

5. 一接入 shell/文件工具就有安全风险

高风险操作放 sandbox;写操作加审批;限制目录、命令白名单和网络出口范围。[1][2][5]

6. 模型效果忽高忽低

先看 harness 是否稳定,再检查工具是否确定性过低,最后再考虑模型版本和参数波动。

结语:给工程师的下一步学习路线

摘要:2026 学 AI,最值得投入的不是“再背 100 条 Prompt 技巧”,而是掌握 Agent 的工程闭环。

如果你想真正具备 AI 应用落地能力,建议按下面顺序学习:

第一步:从“调用模型”升级到“任务编排”

先别追求复杂 autonomous agent,先把:

- 工具调用

- 状态管理

- 审批门禁

- trace 记录

这四件事做出来。

第二步:选一个 SDK 深入

建议在 OpenAI Agents SDK 或 Claude Agent SDK 中选一个,完成 2~3 个真实项目原型。[2][3]

第三步:补齐 runtime 与 sandbox

会调模型不够,必须理解:

- agent loop

- 文件与命令执行

- 容器化隔离

- 快照恢复

第四步:建立 eval 与 trace 思维

不要只看“回答像不像”,要看:

- 成功率

- 工具使用准确率

- 平均步骤数

- 失败类型分布

- 成本和时延

第五步:面向生产环境考虑平台化

如果团队进入规模化落地,再去评估 Vertex AI Agent Builder / Agent Engine 这类平台型能力。[5][7]

一句话收尾:

Prompt 是 AI 时代的输入技巧,Agent 工程才是 2026 年的核心生产力。

CSDN 发布建议(标签与专栏)

摘要:发布时建议突出“Agent工程化”和“AI应用开发”两个主线。

标签建议:AI Agent、Prompt Engineering、OpenAI、Claude、LangChain、Vertex AI、人工智能、Python、TypeScript、AI工程化

专栏建议:AI应用开发实战、Agent工程化落地、2026大模型技术进阶

参考资料

-

The next evolution of the Agents SDK | OpenAI

https://openai.com/index/the-next-evolution-of-the-agents-sdk/ -

Agents SDK | OpenAI API

https://developers.openai.com/api/docs/guides/agents -

Agent SDK overview - Claude Code Docs

https://code.claude.com/docs/en/agent-sdk/overview -

Improving Deep Agents with harness engineering

https://www.langchain.com/blog/improving-deep-agents-with-harness-engineering -

Vertex AI Agent Builder | Google Cloud

https://cloud.google.com/products/agent-builder -

On Agent Frameworks and Agent Observability

https://www.langchain.com/blog/on-agent-frameworks-and-agent-observability -

Vertex AI Agent Engine overview | Google Cloud Documentation

https://docs.cloud.google.com/agent-builder/agent-engine/overview -

Apple’s Xcode now supports the Claude Agent SDK | Anthropic

https://www.anthropic.com/news/apple-xcode-claude-agent-sdk

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)