什么情况下,企业才真的需要多智能体?

你需要一个多智能体组织:搜集情报的“侦察兵”、算账的“财务官”,以及最后汇总汇报的“参谋长”。必须引入一个独立的“Reviewer(审查者智能体)”,在 System Prompt 里赋予它极其严苛的挑刺人格,这种左手搏右手的对抗机制,才能逼出高质量的结果。人类的工作不是简单的直线,而是充满条件分支的。在服务企业的过程中,我们经常看到这样的闹剧:某技术团队用开源框架搭建了一个“多智能体软件开发平台

随着大模型技术的狂飙突进,“多智能体(Multi-Agent)”突然成了科技圈最时髦的词汇。很多企业老板觉得:既然一个 AI 智能体能干活,那我搞一群 AI 智能体组网,岂不是能直接替代整个业务部门?但现实往往是骨感的:盲目堆砌的 AI 群体不仅没有实现 1+1>2,反而陷入了无限循环的“内耗”与死机。多智能体系统不是把几个聊天机器人拉进同一个群里聊天,而是基于严密的业务 SOP(标准作业程序)建立起具有角色分工的数字流水线。对于企业而言,盲目追求技术名词毫无意义,逐米时代长期聚焦场景化智能体落地,我们始终认为:没有复杂的跨角色协同诉求,就不要轻易触碰多智能体系统。

图 1:多智能体就像这张紧密相连的数字网络,需要的不是独立天才,而是分工明确的协同机制

图 1:多智能体就像这张紧密相连的数字网络,需要的不是独立天才,而是分工明确的协同机制

一、 真实痛点:为什么“三个 AI 和尚没水喝”?

在服务企业的过程中,我们经常看到这样的闹剧:某技术团队用开源框架搭建了一个“多智能体软件开发平台”,包含了一个“产品经理 AI”、一个“程序员 AI”和一个“测试员 AI”。当人类下达“写一个贪吃蛇游戏”的指令后,诡异的一幕发生了——

程序员 AI 刚刚写完一段代码,测试员 AI 就指出里面有一个语法错误。程序员 AI 立刻道歉并修改,但这次修改又引发了新的逻辑漏洞。测试员 AI 继续报错,程序员 AI 继续道歉……它们在后台疯狂消耗着服务器的算力 Token,陷入了死循环。最后,人类等了半个小时,游戏没做出来,反倒收获了一份长达 50 页的“AI 吵架记录”。

为什么会这样?因为企业严重低估了多智能体系统的“管理成本”。把一群没有明确边界、没有容错机制、没有终裁权的大模型拼凑在一起,结果只会是灾难。很多企业的问题不在于模型不够聪明,而在于缺乏对数字劳动力的“组织设计”。

二、 深度思辨:亚当·斯密与 AI 时代的“分工进化论”

要深刻理解为什么我们需要多智能体,我们要回到 200 多年前,翻开亚当·斯密的《国富论》。斯密在书中提出了著名的“制针厂”理论:

“如果一个工匠独立打造一枚大头针,他需要抽铁丝、拉直、切断、削尖、打磨,一天下来可能连 20 枚都做不出来。但如果把流程拆分成 18 道工序,由 10 个工人分工协作,他们一天能生产 48000 枚大头针。”

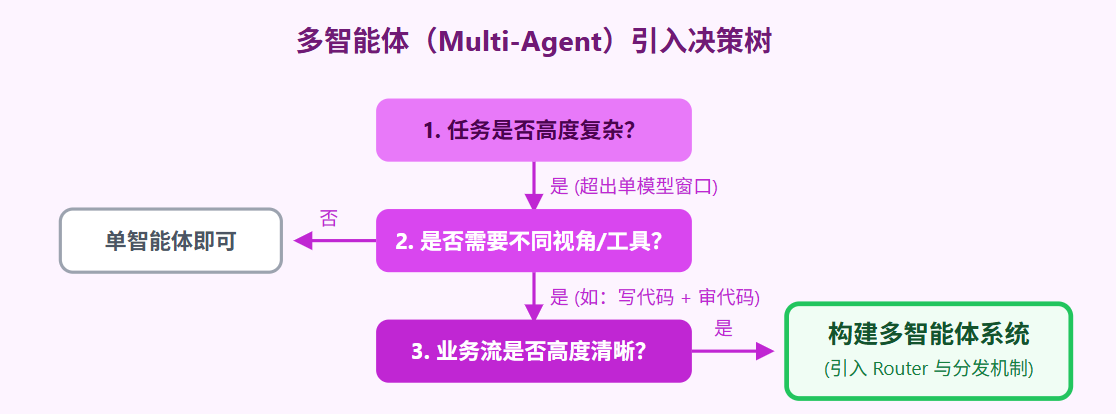

在 AI 领域,一个单智能体(Single Agent)就像那个全能的独立工匠。如果你给它的任务是“写一封邮件”或“翻译一段话”,它一个人(一个 Prompt)完全能搞定。但如果你给它的任务是“审查一份 500 页的招投标文件并给出财务风险预估”,它就会“精神分裂”。它要同时扮演阅读者、法律顾问、财务专员三种角色,其有限的上下文记忆(Context Window)会被瞬间污染,最终导致严重的幻觉。

多智能体(Multi-Agent)的本质,就是 AI 时代的“亚当·斯密分工”。它通过把复杂任务拆解,让每个智能体只专注一件小事,从而突破单一模型的能力上限。

图 2:单智能体容易陷入思维混乱,而多智能体通过角色隔离实现了能力倍增

图 2:单智能体容易陷入思维混乱,而多智能体通过角色隔离实现了能力倍增

三、 避坑指南:关于多智能体的 3 个认知泡沫

在这个极其前沿的领域,技术狂热极容易掩盖商业常识。企业一定要警惕以下三个泡沫:

- 泡沫一:混淆了“模型调用”与“多智能体”。

很多供应商说:“我们的系统接入了文心一言、通义千问和 Kimi,所以我们是多智能体”。这是完全的偷换概念。这只叫“多模型聚合网关”。真正的多智能体,是 Agent 之间能够基于业务流相互传递上下文、主动纠错并协同完成工作。 - 泡沫二:强行用“杀鸡用牛刀”。

如果你只是想让 AI 帮你写一篇周报、或者解答一下年假怎么请,千万不要去搭建一个包含规划、执行、审核三个角色的多智能体系统。这不仅会极大地增加系统的延迟时间(Token 交互成本),还会把简单问题复杂化。 - 泡沫三:没有人类 SOP,却指望 AI 自己跑通。

多智能体最致命的雷区在于:如果你们公司的业务流程在人类协作时就是一笔烂账,部门之间互相扯皮,那么 AI 智能体也一定会在工作流里打架。多智能体系统无法创造一套新的业务流,它只能将已有的、清晰的人类 SOP 自动化。

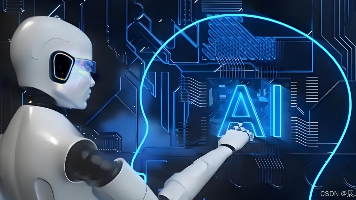

四、 方法论:一份判断“是否需要多智能体”的决策树

那么,什么情况下企业才应该果断上马多智能体?我们总结了一个实用的评估模型。如果你的业务场景满足以下三个条件中的两个,多智能体就是你的必选项:

图 3:切忌为了跟风而跟风,复杂业务流才是多智能体的试金石

图 3:切忌为了跟风而跟风,复杂业务流才是多智能体的试金石

1. 需要解决“既当裁判又当运动员”的问题(角色隔离)

在研发代码审计、合规合同审查中,如果让同一个模型去写草案,又让它自己去挑错,它大概率会说“我写得很完美”。必须引入一个独立的“Reviewer(审查者智能体)”,在 System Prompt 里赋予它极其严苛的挑刺人格,这种左手搏右手的对抗机制,才能逼出高质量的结果。

2. 任务需要调用完全不同的外部工具(工具隔离)

有的任务极为庞杂。比如一次“行业竞品分析”,它需要去互联网上爬取新闻(网络爬虫工具),需要进入企业内部的 MySQL 调取去年的销售数据(数据库工具),还需要画一张对比图表(代码执行器)。把这么多工具权限交给一个智能体是极其危险的。你需要一个多智能体组织:搜集情报的“侦察兵”、算账的“财务官”,以及最后汇总汇报的“参谋长”。

3. 非线性的工作流流转(流程拆解)

人类的工作不是简单的直线,而是充满条件分支的。比如招聘简历筛选,有的简历过关了直接发面试通知,有的存疑需要打回重审,有的被淘汰需要发感谢信。这种多分支的逻辑路由,必须通过多智能体框架(如 LangGraph 等底层工程)来实现节点控制。

五、 结语:超越技术的组织管理革命

多智能体系统的出现,其实给所有企业管理者提出了一个更加深刻的命题:未来的企业,不仅仅要管理碳基员工,还要懂得如何管理“硅基部门”。 如何给 AI 划定权力边界?如何处理两个 AI 之间的“意见分歧”?如何让人类(Human-in-the-loop)在最关键的环节进行最终裁决?这些才是落地多智能体最难逾越的冰山。

这正是逐米时代在大量实战中积累的核心壁垒。我们不迷信单一的“无敌大模型”,我们深知真实商业世界的复杂性。逐米时代重点发力的,就是适合多角色、多流程、多任务协同场景的多智能体解决方案。我们帮企业梳理 SOP,为 AI 设定清晰的职责与协作网络,从单点试错走向体系化运转。让 AI 告别聊天玩具的形态,真正成长为拉动企业增长的数字化流水线。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)