GPT刚更新Claude和Gemini也在卷开发者到底该选哪个

摘要: 开发者对比GPT5.4、Claude4.6和Gemini3.1三大模型,发现各有所长:Gemini在数据提取和多模态处理领先,Claude擅长中文生成和代码细节,GPT通用性强但成本较高。建议根据任务分层使用模型(高频低精度、中频中精度、低频高精度),并推荐聚合平台简化调用和管理。未来趋势包括多模型协同、Agent能力提升和成本战加剧,开发者应提前测试建立选型知识库。(149字)

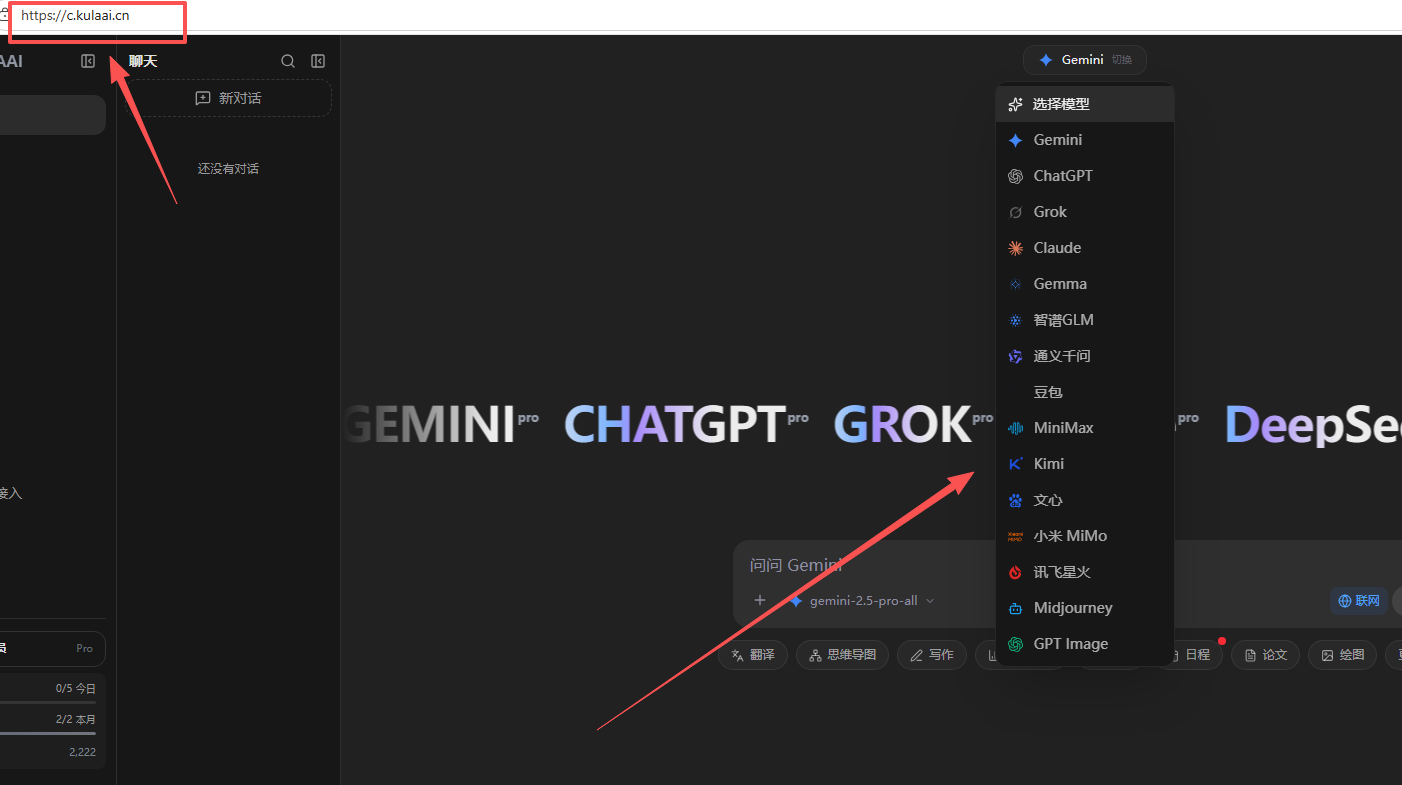

最近项目需要同时跑多个模型做对比,发现库拉(c.kulaai.cn)这类聚合平台可以直接统一调用Gemini 3.1、Claude 4.6、GPT 5.4,一个接口搞定,省了大量适配工作。

GPT 5.4刚推全量没多久,Claude和Gemini也都在密集更新。三个巨头卷成这样,开发者反而更纠结了。我从实际项目出发,给一个选型参考。

一、2026年4月三大模型核心参数速览

先上一张对比表,把关键指标拉到一起看:

| 维度 | GPT 5.4 | Claude 4.6 | Gemini 3.1 Pro |

|---|---|---|---|

| 上下文窗口 | 128K token | 200K token | 200万 token |

| 中文表达 | 规整,略模板化 | 最自然,有语感 | 偏硬,适合技术文档 |

| 数据提取准确率 | 中等,偶有编造 | 较高 | 最高,结构化输出强 |

| 代码生成 | 通用能力强 | 边界条件处理最细 | 注释清晰,可读性好 |

| 多模态 | 图文理解成熟 | 图文为主 | 4月新增3D/交互式图表 |

| 推理能力 | Thinking模式提升大 | 严谨但偶有绕弯 | 长链推理有进步 |

| 输出风格 | 发散,自信 | 谨慎,偏保守 | 工具感强,简洁 |

| Token价格(相对) | 较高 | 中等 | 较低 |

这张表不是绝对排名,而是帮你在不同任务场景下快速定位最优选。

二、按场景选模型,比选"最强的"更重要

4月初斯坦福出了份报告,说中美头部模型差距只剩2.7%。这个数字说明了一件事:模型能力本身已经不是瓶颈,选型策略才是。

下面按我实际高频使用的场景逐个说。

场景一:数据提取与结构化输出

首选Gemini 3.1 Pro。

200万token上下文窗口在这个场景下优势碾压。我之前处理一批三四十页的行业研报,用GPT跑经常出现表格错位、数据丢失的情况。换Gemini之后准确率明显提升,基本不需要人工校对。

GPT偶尔还会"补充"你没要求的信息,对数据准确性要求高的场景需要额外加校验层。

场景二:代码辅助与工程开发

Claude 4.6 > Gemini ≈ GPT。

Claude在边界条件处理上特别细致——空值判断、类型校验、异常捕获这些细节它会主动考虑。写复杂业务逻辑的时候这个特质很加分。

Gemini的代码可读性最好,变量命名和注释风格规范,适合团队协作场景。GPT通用能力不差,但偶尔会在不确定的地方"编"逻辑,需要人工review。

场景三:中文内容生成

Claude 4.6 > GPT > Gemini。

这个差距比较明显。Claude写出来的东西有语感、像人写的,GPT最规整但略模板化,Gemini还是偏"硬"。如果你的产品面向国内用户,中文表现必须作为核心评估指标。

场景四:多模态处理

Gemini 3.1 Pro目前领先。

4月10号Gemini刚更新了交互式3D模拟和动态图表生成功能,多模态能力又拉开了一截。PDF解析、扫描件识别、图表理解这些场景Gemini的表现最好。GPT图文理解成熟但迭代节奏不如Gemini快。Claude在多模态上相对保守。

三、成本不能忽略

4月10号有机构出了最新的Token价格横向对比,同等输出质量的模型,价格差3-5倍是常态。

对调用量大的项目来说,成本结构直接决定能不能跑通商业模型。我的做法是分三层:

| 层级 | 适用场景 | 推荐模型 |

|---|---|---|

| 高频低精度 | 日常对话、草稿生成 | 轻量模型 |

| 中频中精度 | 代码辅助、文档撰写 | Claude / Gemini |

| 低频高精度 | 数据提取、关键决策 | Gemini Pro / GPT Thinking |

按这个分层方案走,总成本比全押一个旗舰模型低40%以上。

四、聚合平台为什么成了刚需

早期我每家单独注册、单独维护API Key、单独写适配层。后来发现光管理这些碎片化配置就占了大量时间。

聚合平台的核心价值就两个字:统一。

统一接口、统一计费、统一模型切换。开发者不用关心底层实现差异,切换模型从"改代码"变成"改一行配置"。

而且好的聚合平台会做模型路由——根据任务类型自动选择最优模型。这个能力自己实现起来工作量不小,用现成方案性价比最高。

五、下半年趋势判断

三个方向值得关注:

第一,多模型协同成为标配。单一模型扛所有任务的模式已经过时,按场景分配模型是正解。

第二,Agent能力成为新战场。文本对话已经卷到头了,接下来拼工具调用、任务编排、跨模型协作。

第三,成本战不可避免。4月初国内AI日均Token消耗突破140万亿,体量在这摆着,价格下探是必然。

给一个实操建议:现在就找一个靠谱的聚合平台,把几个主流模型都跑一遍,建立自己的选型知识库。等下半年格局更清晰的时候,你已经有判断力了。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)