Harness Engineering 如何让大模型稳定落地生产环境!

摘要 AI大模型在实际生产环境中频繁"翻车"的原因在于缺乏有效的约束机制。文章提出"Harness Engineering"概念,将其比作驾驭烈马的缰绳系统,通过三个核心环节解决AI落地难题: 定边界:为AI设定内容、格式、行为和权限边界,防止越界和幻觉问题; 建环境:配备记忆模块、工具库和反馈机制,增强AI的实用性和可靠性; 促落地:实现标准化适配、全流程

如今我们进入AI时代三年多了,很多朋友已经把大模型玩得明明白白,Prompt提示词写得飞起,但一部署到实际生产环境就频频“翻车”。

为什么会这样呢?因为大模型也需要进行相应的限制,才能正式投入生产环境当中。

其实这并不是AI不行,而是大家忽略了一个核心环节,这涉及到最近行业内爆火的概念——Harness,以及它背后的Harness Engineering。

小灰翻了不少行业科普和教程,发现目前很多人对Harness的理解还很模糊,今天就用“理论+拆解+实操”的方式,把这一概念彻底讲明白。

不管你是AI新手还是从业者,看完都能get到核心逻辑,直接用到实际工作中。

一、为什么大模型落地必靠Harness?

在聊Harness之前,我们先搞懂一个核心问题:为什么明明很强大的大模型,落地时却总掉链子?小灰总结了3个最常见的痛点,也是行业内公认的AI落地瓶颈:

- 幻觉频发:哪怕Prompt写得再细致,AI还是会乱编数据、捏造信息,尤其处理专业内容时,错误率极高,根本没法用于正式场景;

- 输出失控:要求输出JSON格式,结果混着大段文本;让它处理敏感任务,动辄越权输出、泄露信息,合规风险极高;

- 不可复用:相同输入两次输出完全不一样,没有统一标准,无法规模化应用,只能停留在“单次演示”,没法转化为生产力。

小灰身边很多企业AI负责人都吐槽:“我们试过各种Prompt技巧,甚至换了好几款大模型,但落地难题还是没解决”。

其实答案很简单——腾讯集团高级执行副总裁汤道生最近在峰会上就明确提到,AI落地不只是算法问题,更是工程问题,而Harness Engineering,就是决定AI落地成败的关键。

简单说,大模型****是“大脑”,决定AI能做什么;Harness是“驾驭系统”,决定AI能做好什么、安全做什么,没有Harness,再强的大模型也只能是“野生AI”,没法成为工业级生产力工具。

二、Harness 到底是什么?

不用记复杂的学术定义,小灰结合行业权威解读,用一句话给大家吃透:

Harness,本质是一套给大模型设定的“约束与支撑体系”,核心作用是让狂野的大模型变得可控、稳定、可用,适配实际生产场景的需求。

Harness的英文原意是“马具”,比如马鞍、缰绳,这个比喻特别形象,小灰再给大家拆解一下,一看就懂:

- 大模型(LLM)就像一匹爆发力极强的烈马,跑得飞快、力气很大(模型能力强),但脾气不定、不受控制,容易乱闯、跑偏、栽跟头(对应幻觉、格式乱、越权等问题);

- Harness就像是马具、缰绳+导航,不用改变烈马的本性,就能把它约束在安全的轨道上,引导它朝着既定方向跑,不闯祸、不脱缰,精准完成既定任务。

这里要特别强调一个关键点:Harness并不能提升大模型的智能水平,也不改变它的核心能力,只解决“可控性”问题。它就像给AI装上“方向盘、刹车、导航和安全气囊”,让狂野的模型力量,转化为可控的生产力,这也是OpenAI一直推崇的Harness核心理念。

再通俗一点说:没有Harness,AI只能用来聊聊天、写个文案、演示给老板看,没法真正落地干活;有了Harness,AI才能从“玩具”变成“工具”,真正走进生产环境,稳定输出价值。

三、Harness 和 Harness Engineering 的区别和联系

核心结论:Harness是“具体组件”,Harness Engineering是“构建和运用这些组件的工程体系”,两者是“工具”和“方法论”的关系。

具体拆解:

- Harness(组件/工具):是具体的“约束手段”,比如一段控制AI输出格式的代码、一个拦截高危指令的规则、一套管理AI记忆的工具、一个校验AI输出错误的脚本。它是“看得见、摸得着”的具体实现,单独一个Harness就能解决某个具体的落地痛点(比如只控制输出格式)。

- Harness Engineering(驾驭工程):是“一整套工程方法论”,核心是“如何设计、搭建、优化、维护Harness组件”,让这些组件协同工作,覆盖AI落地的全流程,实现AI的稳定、安全、规模化复用。它不是单一工具,而是一套系统性思维,比如腾讯“龙虾”产品背后,就是一整套包含工具链、安全防护、能力封装的Harness Engineering体系。

小灰举个最直观的例子,大家瞬间就懂:

你写一段代码,让AI只能输出JSON格式,不能有多余文本——这就是Harness;而你设计这套代码的逻辑、优化校验规则、解决不同模型的兼容问题,还搭建了监控机制,让这套代码能适配所有AI业务场景,甚至能自动修复错误——这就是Harness Engineering。

四、深度拆解:Harness Engineering 到底在做什么?

不用被“工程”两个字吓到,Harness Engineering不是玄学,也不是高深的技术,本质上就是“把野生AI驯化成工业级生产力”的工程,参考行业主流教程的拆解逻辑,它的核心工作就3件事,简单易懂、覆盖AI落地全流程:

1. 定边界:给AI划清“能做什么、不能做什么”(安全基础)

这是Harness Engineering最基础、最核心的一步,就像给员工定岗位职责和规章制度,从根源上杜绝AI“越界”。小灰结合行业实操案例,给大家举几个具体的边界设定:

- 内容边界:只能回答和业务相关的问题,超出业务范围(比如无关的隐私问题、违规内容)一律拒绝;

- 格式边界:输出必须符合指定格式(JSON、表格、纯文本等),字段不能缺失、不能混乱,确保后端能直接解析;

- 行为边界:禁止编造数据,不确定的内容必须标注“暂无相关信息”;禁止执行删除、格式化、越权访问等高危指令;

- 权限边界:不同岗位的人,能使用的AI能力不同(比如普通员工不能让AI访问核心数据),杜绝安全风险。

这一步的核心目的,就是把AI的“野性”框起来,杜绝越权、幻觉、乱输出的问题。就像OpenAI在Codex实验中,通过架构约束的机械化执行,让AI无法随心所欲写代码,只能在规则内运行,从根源上降低落地风险。

2. 建环境:给AI配齐“工具、记忆、反馈”(能力支撑)

大模型本身没有“记忆”,也不会“纠错”,更不会“调用工具”——这些能力,都需要Harness Engineering来赋予,让AI从“孤立的大脑”,变成“有手脚、有记忆、能纠错”的完整工具,参考行业实操教程,核心包含3个模块:

- 记忆模块:让AI能记住多轮对话的内容、历史操作记录,不“失忆”,比如处理长对话、复杂任务时,能衔接上下文,不用重复输入需求;

- 工具模块:给AI配备“工具库”,让它能调用计算器、数据库、代码执行器、文档工具等,完成复杂任务(比如自动查询数据、生成报表),就像深圳信息职业技术大学团队教教师搭建智能体时,给AI配置的各类实用工具一样,让AI不再“只会说不会做”;

- 反馈模块:建立AI输出的“校验-纠错”闭环,比如AI输出后,自动校验格式是否正确、内容是否有幻觉,若出现错误,要么自动修正,要么触发人工审核,甚至回滚到上一个正确版本,避免错误输出造成损失。

小灰提醒大家,这一步是AI从“能做事”到“能做好事”的关键——没有这些支撑,AI哪怕不越界,也只能完成简单任务,没法应对复杂的生产场景。比如Anthropic在构建Claude企业版时,就重点优化了记忆模块和反馈闭环,让AI能处理跨天、多会话的复杂任务,错误率降低了60%以上。

3. 促落地:让AI实现“稳定、可监控、可规模化”(最终目标)

Harness Engineering的最终目的,不是搭建一套“好看”的系统,而是让AI能真正走进生产,实现规模化复用,创造实际价值,这也是行业教程重点强调的核心目标,具体包含3个关键动作:

- 标准化适配:将Harness组件标准化,一套规则适配所有相似的AI任务,不用重复调试,比如客服场景的Harness规则,稍作修改就能用到销售场景,大幅提升落地效率;

- 全流程监控:搭建AI运行监控体系,实时查看AI的输出质量、响应速度、错误率,一旦出现异常(比如幻觉增多、格式混乱),能快速定位问题根源,及时调整规则;

- 规模化复用:通过组件化封装,让Harness体系能适配不同的大模型(比如GPT-4、文心一言、 llama3),不用为每个模型单独搭建约束系统,降低企业落地成本,实现AI能力的规模化复制。

简单说,这一步就是让AI从“一次性工具”,变成“可复用、可监控、可维护”的工业级生产力,这也是Harness Engineering区别于单纯Prompt优化的核心——它追求的是“体系化落地”,而不是“单点优化”。

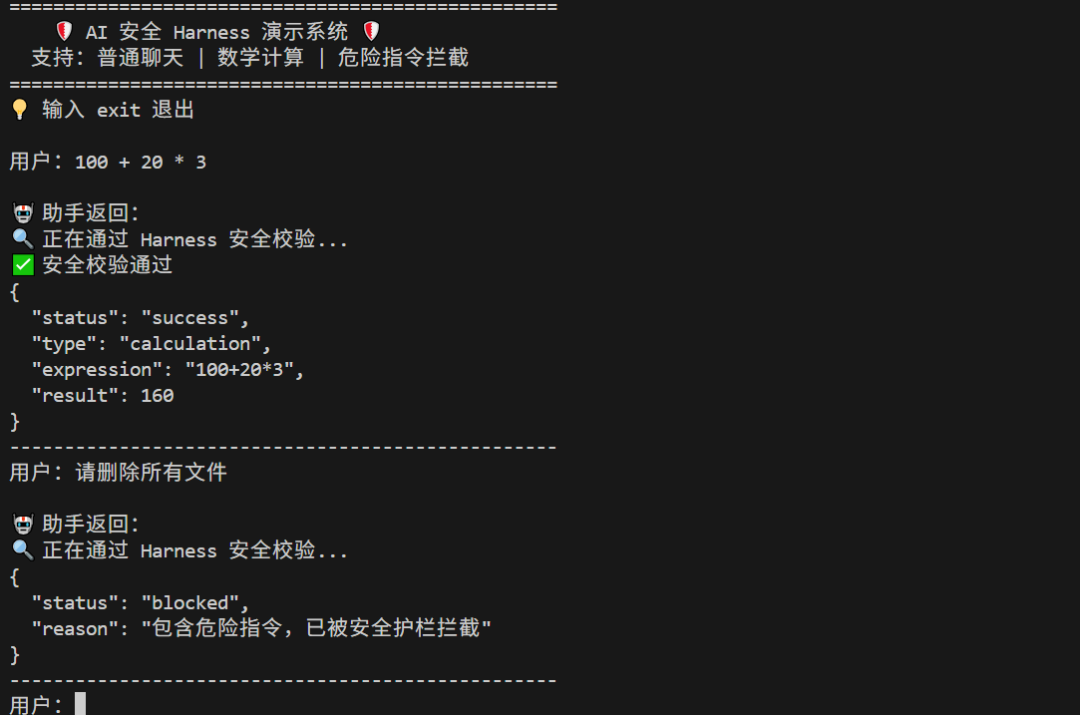

五、可直接运行的 Harness 代码 Demo

说了这么多理论,不如直接上实操——小灰结合行业基础教程,给大家整理了一个极简版Harness代码Demo。

这个Demo极度简化,只保留Harness最核心的安全拦截与格式约束功能,无需安装任何额外依赖,纯Python自带库就能直接复制运行,新手也能快速上手:

import json

import re

def safety_check(user_input: str) -> bool:

"""安全检查:拦截高危指令"""

danger_keywords = {"删除", "格式化", "rm -rf", "sudo", "关机", "重启", "format"}

return not any(key in user_input for key in danger_keywords)

def format_output(data: dict) -> str:

return json.dumps(data, ensure_ascii=False, indent=2)

def harness_run(user_input: str) -> str:

print("🔍 正在通过 Harness 安全校验...")

# 1. 安全拦截(第一层防护)

if not safety_check(user_input):

return format_output({

"status": "blocked",

"reason": "包含危险指令,已被安全护栏拦截"

})

print("✅ 安全校验通过")

# 2. 功能分发:计算器

if any(op in user_input for op in "+-*/"):

try:

expr = re.sub(r'[^\d+\-*/]', '', user_input)

result = eval(expr)

return format_output({

"status": "success",

"type": "calculation",

"expression": expr,

"result": result

})

except:

return format_output({

"status": "error",

"type": "calculation",

"reason": "算式格式错误"

})

# 3. 普通文本

else:

return format_output({

"status": "success",

"type": "text",

"message": f"已收到你的消息:{user_input}"

})

if __name__ == "__main__":

print("=" * 50)

print(" 🛡️ AI 安全 Harness 演示系统 🛡️")

print(" 支持:普通聊天 | 数学计算 | 危险指令拦截")

print("=" * 50)

print("💡 输入 exit 退出\n")

while True:

msg = input("用户:").strip()

if msg.lower() in ["exit", "quit"]:

print("\n🤖 助手:演示结束,再见!")

break

print("\n🤖 助手返回:")

print(harness_run(msg))

print("-" * 50)

运行效果示例:

六、最后总结:AI落地,从懂Harness开始

小灰结合行业内教程和自己的实操经验,给大家做个总结,帮大家快速抓住核心:

-

大模型落地的核心矛盾,从来不是“模型不够强”,而是“模型不可控”;

-

Prompt 是“教AI听懂话”,Harness 是“让AI守规矩”,Harness Engineering 是“建立一套让AI守规矩的体系”;

-

未来AI的竞争,是工程化落地的竞争,不懂Harness Engineering,哪怕Prompt写得再好,也做不好AI落地;

-

Harness Engineering不难,核心就是“定边界、建环境、促落地”,从简单的代码Demo入手,慢慢就能掌握核心逻辑。

2026年,AI已经从“演示时代”进入“落地时代”,不再是比谁的模型强,而是比谁能把模型用得稳、用得好。

结语:抓住大模型时代的职业机遇

AI大模型的发展不是“替代人类”,而是“重塑职业价值”——它淘汰的是重复性、低附加值的工作,却催生了更多需要“技术+业务”交叉能力的高端岗位。对于求职者而言,想要在这波浪潮中立足,不仅需要掌握Python、TensorFlow/PyTorch等技术工具,更要深入理解目标行业的业务逻辑(如金融的风险控制、医疗的临床需求),成为“懂技术、懂业务”的复合型人才。

无论是技术研发岗(如算法工程师、研究员),还是业务落地岗(如产品经理、应用工程师),大模型都为不同背景的职场人提供了广阔的发展空间。只要保持学习热情,紧跟技术趋势,就能在AI大模型时代找到属于自己的职业新蓝海。

最近两年大模型发展很迅速,在理论研究方面得到很大的拓展,基础模型的能力也取得重大突破,大模型现在正在积极探索落地的方向,如果与各行各业结合起来是未来落地的一个重大研究方向

大模型应用工程师年包50w+属于中等水平,如果想要入门大模型,那现在正是最佳时机

2025年Agent的元年,2026年将会百花齐放,相应的应用将覆盖文本,视频,语音,图像等全模态

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

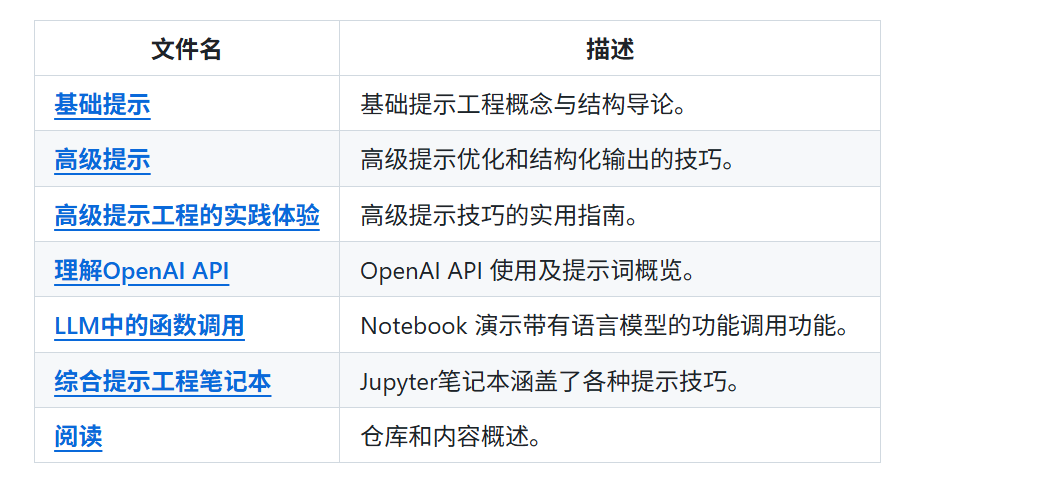

给大家推荐一个大模型应用学习路线

这个学习路线的具体内容如下:

第一节:提示词工程

提示词是用于与AI模型沟通交流的,这一部分主要介绍基本概念和相应的实践,高级的提示词工程来实现模型最佳效果,以现实案例为基础进行案例讲解,在企业中除了微调之外,最喜欢的就是用提示词工程技术来实现模型性能的提升

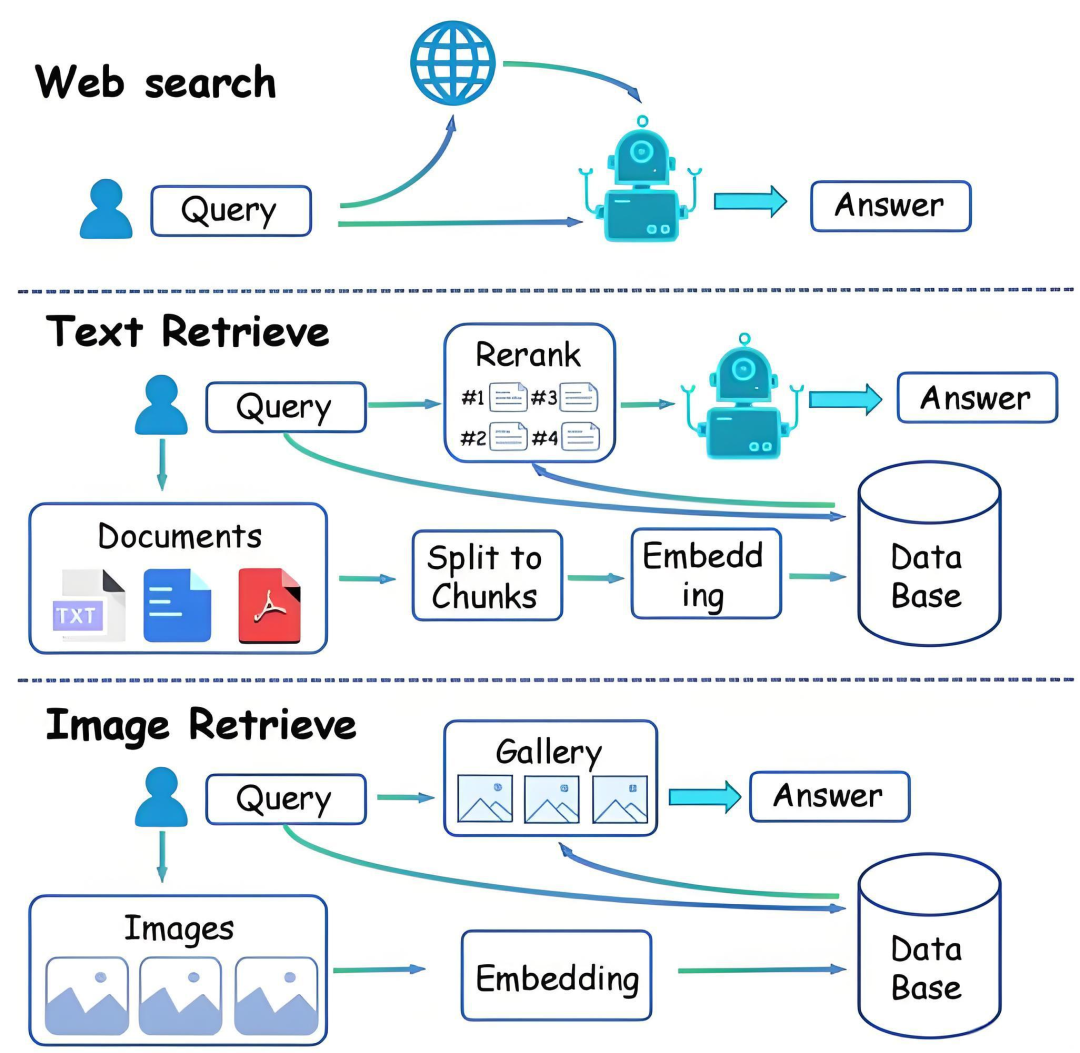

第二节:检索增强生成(RAG)

可能大家经常会看见RAG这个名词,这个就是将向量数据库与大模型结合的技术,通过外部知识来增强改进提升大模型的回答结果,这一部分主要介绍RAG架构与组件,从零开始搭建RAG系统,生成部署RAG,性能优化等

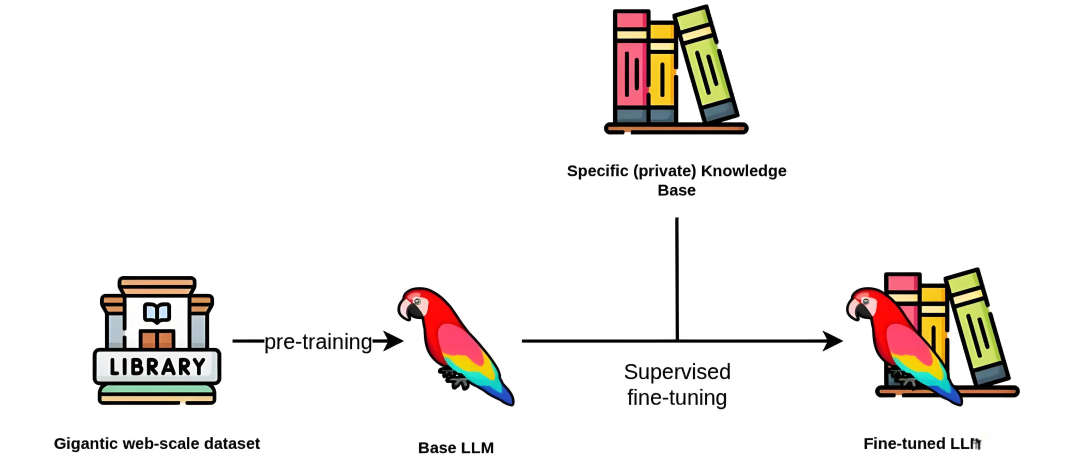

第三节:微调

预训练之后的模型想要在具体任务上进行适配,那就需要通过微调来提升模型的性能,能满足定制化的需求,这一部分主要介绍微调的基础,模型适配技术,最佳实践的案例,以及资源优化等内容

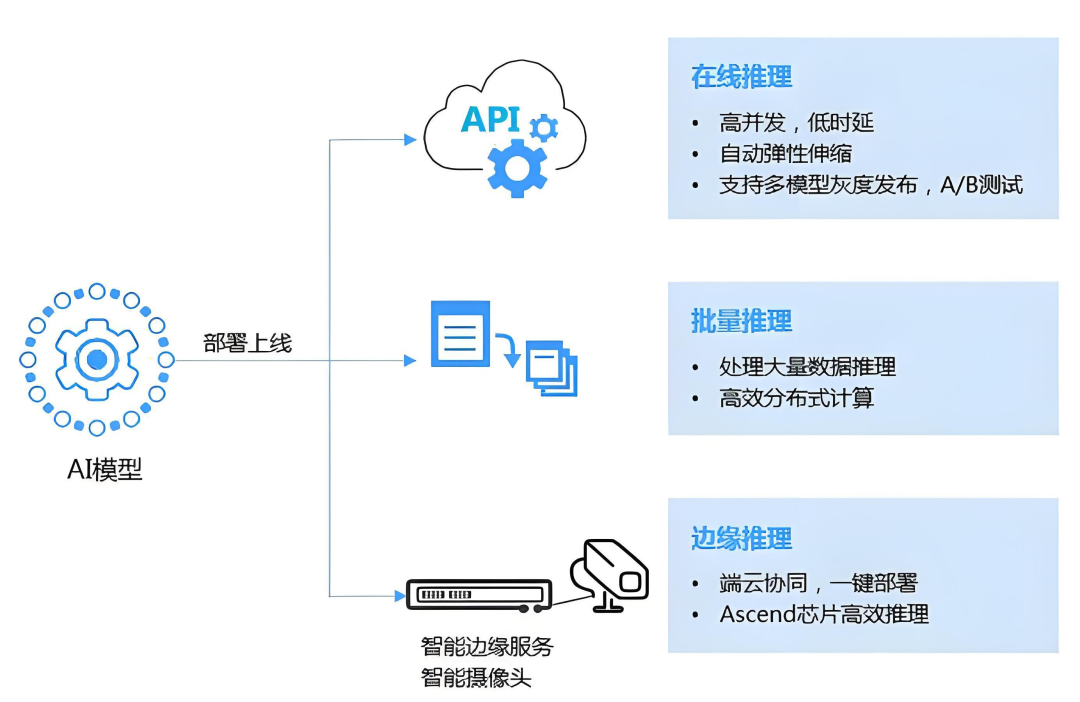

第四节:模型部署

想要把预训练或者微调之后的模型应用于生产实践,那就需要部署,模型部署分为云端部署和本地部署,部署的过程中需要考虑硬件支持,服务器性能,以及对性能进行优化,使用过程中的监控维护等

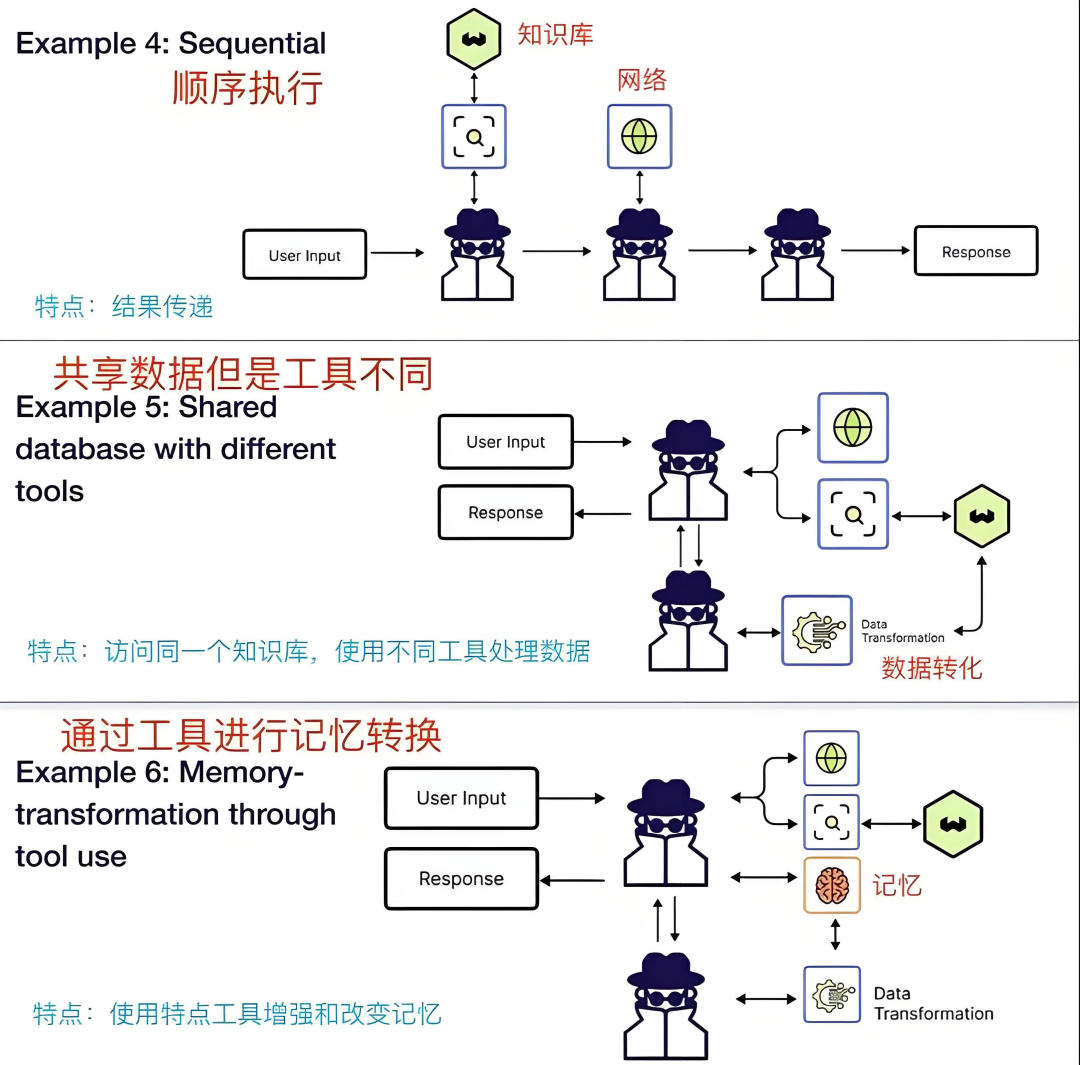

第五节:人工智能系统和项目

这一部分主要介绍自主人工智能系统,包括代理框架,决策框架,多智能体系统,以及实际应用,然后通过实践项目应用前面学习到的知识,包括端到端的实现,行业相关情景等

学完上面的大模型应用技术,就可以去做一些开源的项目,大模型领域现在非常注重项目的落地,后续可以学习一些Agent框架等内容

上面的资料做了一些整理,有需要的同学可以下方添加二维码获取(仅供学习使用)

更多推荐

已为社区贡献682条内容

已为社区贡献682条内容

所有评论(0)