OpenClaw大版本更新之后,Agent开始向“系统级智能体”演化

AI系统正从"被动调用"转向"持续运行"的Agent形态,OpenClaw的更新凸显了这一趋势。其核心变化在于:1)记忆机制从存储升级为参与决策的认知系统;2)架构演变为类似操作系统的持续运行模式;3)新增Dreaming机制实现离线自我优化。这对测试领域带来根本性变革:测试重点从功能验证转向系统行为稳定性验证,需关注决策链路、记忆污染和长期演化能力。未来测

关注 霍格沃兹测试学院公众号,回复「资料」, 领取人工智能测试开发技术合集

最近两个月,如果你在用一些新的 AI 工具,应该会有一个很直观的感受:

有些系统,已经不再是“你点一下,它回一句”。

它开始自己跑流程、自己调工具、甚至在你不操作的时候还在持续执行。

问题也随之出现:

-

有时候结果是对的,但过程完全不可控

-

有时候能跑通一次,但跑不稳第二次

-

有记忆,但越用越乱

这类问题,本质上不是模型能力的问题,而是系统形态变了。

这次 OpenClaw 的更新,把这件事讲得更清楚了一步:

AI正在从“被调用的能力”,变成“持续运行的系统”。

目录

-

OpenClaw这次更新,本质不在功能

-

记忆机制正在从“存储”变成“认知”

-

Agent架构正在向“操作系统形态”演进

-

Dreaming机制到底解决了什么问题

-

对测试的影响,不是工具升级而是边界重写

-

下一阶段,谁在被淘汰

一、OpenClaw这次更新,本质不在功能

表面看,这次更新有几个很显眼的点:

-

Dreaming 记忆机制

-

内置视频 / 音乐生成能力

-

默认接入 GPT-5.4 + 缓存优化

这些能力单独看,并不稀奇。

关键在于:

它们第一次被组织进“长期运行的Agent系统”。

换句话说:

AI不再是一次请求,而是一个持续存在的执行体

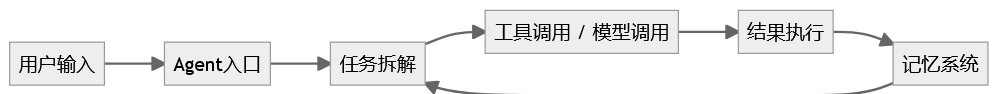

结构上可以这样理解:

核心变化:

-

执行是循环的,而不是一次性的

-

记忆参与决策,而不是只做存档

二、记忆机制正在从“存储”变成“认知”

过去很多系统的“记忆”,本质是:

-

存对话

-

做向量检索

-

用RAG补上下文

但 Dreaming 机制做的不是“多存一点”,而是:

重构记忆,让它参与决策。

可以拆成三层:

原始记忆

-

对话记录

-

执行日志

-

工具调用结果

压缩记忆

-

自动总结

-

关键信息提取

-

冗余剔除

结构化认知

-

用户偏好

-

任务模式

-

行为策略

流程如下:

记忆如果不能影响决策,本质上只是日志系统

三、Agent架构正在向“操作系统形态”演进

过去的Agent,大多是这种结构:

Prompt → LLM → 输出

稍复杂一点:

Prompt → LLM → Tool → 输出

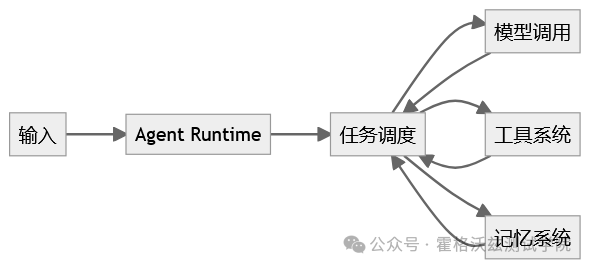

但现在已经变成:

核心变化有三个:

有运行时

Agent不再是函数,而是持续运行的进程

有调度

任务可以动态拆解和重排

有状态

系统会记住当前阶段,而不是每次重来

Agent正在从“能力调用”,变成“系统工程问题”

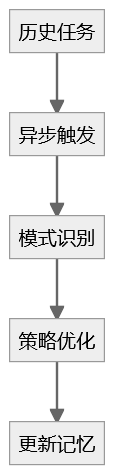

四、Dreaming机制,本质是“离线思考能力”

Dreaming不是简单的“总结”。

它解决的是一个长期问题:

AI在不被调用的时候,是否还能优化自己。

可以类比人:

-

白天执行任务

-

晚上整理经验

对应机制:

它解决了三件事:

上下文混乱

通过压缩和结构化保持清晰

Agent不成长

引入经验沉淀机制

重复犯错

让策略层产生记忆

没有Dreaming的Agent,本质是一次性工具

五、对测试的影响,不是工具升级,而是边界重写

很多人还在关注:

-

AI能不能生成用例

-

能不能写自动化脚本

但问题已经变了。

当系统变成“持续运行的Agent”,测试对象也变了。

从功能验证 → 行为稳定性

你要测的不是结果,而是:

-

是否进入错误循环

-

是否产生异常路径

从接口测试 → 决策链路测试

测试对象变成:

输入 → 推理 → 工具 → 记忆 → 再推理

需要验证:

-

每一步是否可控

-

是否存在放大效应

从覆盖率 → 系统演化能力

关键问题变成:

-

记忆是否污染

-

策略是否漂移

-

长期运行是否稳定

AI测试的核心,正在从“验证结果”,转向“约束系统行为”

六、下一阶段,谁在被淘汰

当这类系统进入生产环境,会出现一个明显分层:

不会系统的人,很难继续参与。

因为你面对的已经不是:

-

一个接口

-

一个模块

而是:

-

持续运行的Agent系统

-

带记忆的执行体

-

会不断演化的结构

再说得更直接一点:

-

只会写用例,不够

-

只会调接口,也不够

真正需要的是:

-

理解系统架构

-

理解行为路径

-

理解AI决策机制

最后留一个问题:

你现在在测的系统,是一次性调用模型,还是一个会持续运行、不断演化的Agent系统?

更多推荐

已为社区贡献209条内容

已为社区贡献209条内容

所有评论(0)