不抬杠不引战✨|我眼中的 AI 进化路(5 大时期 + Transformer + JEPA + 世界模型,个人拙见)

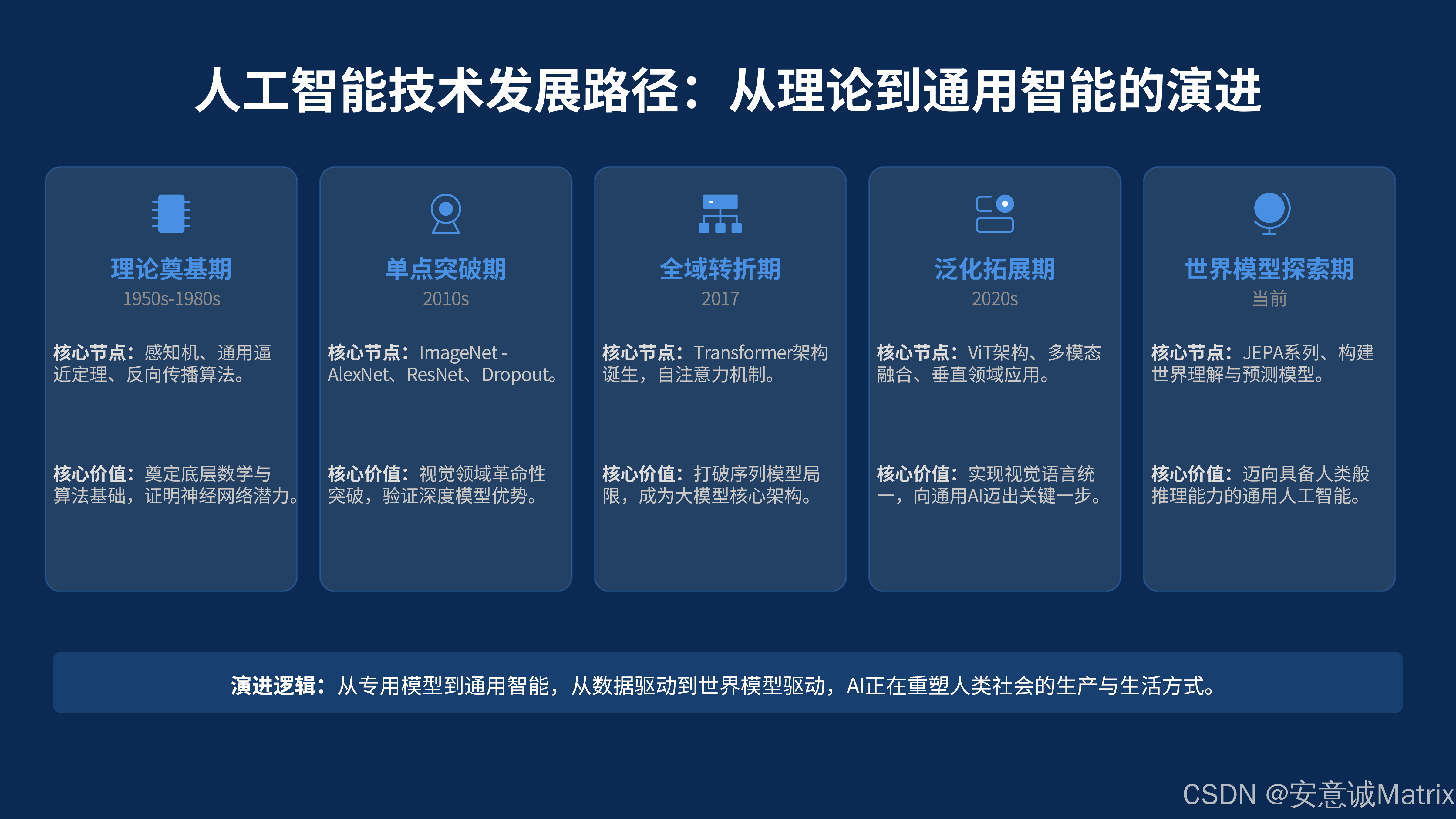

梳理完这五个时期,其实能清晰看到AI的进化逻辑——从“能学”(理论奠基),到“能看”(单点突破),再到“能懂”(全域转折)、“能举一反三”(泛化拓展),最后朝着“能理解世界”(前沿探索)稳步迈进。这不是一份严谨的学术报告,只是我这段时间学习、思考后,对AI发展的个人理解。没有复杂的术语,没有高深的理论,只想把AI的发展脉络,用最易懂的方式分享出来。AI的发展还在继续,从简单的感知机到复杂的世界模型

这段时间沉下心梳理了AI技术的发展脉络,没有复杂的公式,没有晦涩的专业术语,大部分是我自己对AI的理解和小结。这只是我的视角,仅供参考。

不知道你有没有过这样的疑问:为什么现在的AI能看懂图片、听懂我们说的话,甚至能预测事物变化?从一个简单的“感知机”,到能构建“世界模型”、逼近通用人工智能,AI到底走过了怎样的路?那些频繁出现的Transformer、JEPA、大模型,又分别在AI的进化中扮演了什么角色?今天,就用我梳理的5个核心时期,把这份AI发展小结分享给大家。

一、理论奠基期:搭建AI的“底层逻辑”(核心是解决“AI能学会规律吗”)

一切的开始,都是为了回答一个核心问题:AI真的能像人类一样,学会世界上的各种规律吗?这个时期,科学家们从基础理论入手,为AI搭建了最初的“骨架”。

| 核心节点 | 关键技术/事件(通俗解读) | 核心价值(本科生能懂的作用) |

|---|---|---|

| 1. 感知机与神经网络雏形 | 上世纪中叶,科学家提出“感知机”,模拟人类大脑神经元的工作方式,是最简单的AI模型。 | 奠定AI的核心思路——像大脑一样“学习”,为后续所有AI技术打下基础。 |

| 2. 通用逼近定理确立 | 科学家证明:只要搭建足够复杂的多层神经网络,就能拟合世界上几乎所有的规律(比如气温变化、物体运动)。 | 从理论上证明“AI能学会万物规律”,打破“AI只能做简单计算”的局限。 |

| 3. 反向传播算法完善 | 找到一种高效训练神经网络的方法:让模型“犯错后自我修正”,通过误差反向调整参数,越练越精准。 | 解决了“神经网络不会自我提升”的难题,让AI从“理论可行”变成“实际可用”。 |

| 4. 深度学习概念正式提出 | 2006年,科学家Hinton提出“深度学习”,本质是“更深、更复杂的神经网络”,能处理更复杂的数据。 | 明确了AI的发展方向,为后续图像识别、语言理解的突破埋下伏笔,是“大模型”的前身。 |

二、单点突破期:AI学会“看东西”(核心是解决“AI能识别图像吗”)

有了底层逻辑,AI开始朝着“落地应用”迈进,而第一个重大突破,就是让AI学会“看”——从看不懂一张图片,到能精准识别各种物体,这个时期实现了AI的第一次“能力跃迁”。

| 核心节点 | 关键技术/事件(通俗解读) | 核心价值(本科生能懂的作用) |

|---|---|---|

| 5. ImageNet数据集构建 | 李飞飞团队搭建了包含1500万张图片(2.2万个类别)的数据集,相当于给AI准备了“海量练习题”。 | 让AI有足够的“学习素材”,彻底解决了“AI没东西可学”的瓶颈。 |

| 6. AlexNet夺冠(深度学习落地) | 2012年,AlexNet模型在ImageNet图片识别比赛中夺冠,识别精度远超传统方法,一战成名。 | 正式宣告“AI能看懂图片”,拉开了AI在计算机视觉领域的应用序幕(比如手机人脸识别)。 |

| 7. 经典模型优化(ResNet、Dropout) | ResNet让神经网络“更深”(能处理更复杂的图像),Dropout让模型“不记死知识”(避免学错)。 | 让AI识别图片更精准、更稳定,比如能区分相似的动物、识别模糊的图片。 |

三、全域转折期:AI学会“懂语言”(核心是解决“AI能理解文字吗”)

AI能“看”之后,下一个难题就是“懂”——懂人类的语言,能和我们顺畅交流。这个时期的一个关键技术,直接重塑了AI的发展格局,让AI的“语言能力”实现了质的飞跃。

| 核心节点 | 关键技术/事件(通俗解读) | 核心价值(本科生能懂的作用) |

|---|---|---|

| 8. Transformer架构诞生 | 2017年,Google提出Transformer,核心是让AI能“看懂长文本的逻辑”(比如理解一句话中每个词的关联)。 | 打破了AI“看不懂长句子、不会连贯表达”的局限,是现在所有聊天机器人(如ChatGPT)的核心技术。 |

| 9. 大语言模型涌现 | 基于Transformer,诞生了BERT、GPT等模型,能读懂文字、生成句子,甚至写文章、答问题。 | 让AI从“看懂文字”变成“会用文字交流”,比如我们常用的AI聊天、AI写作业助手,都源于此。 |

四、泛化拓展期:AI能“举一反三”(核心是解决“AI能做更多事吗”)

能“看”能“懂”还不够,AI开始朝着“通用”迈进——不再局限于图像、语言单一领域,而是能把学到的能力“举一反三”,应用到生活、工作的各个场景中。

| 核心节点 | 关键技术/事件(通俗解读) | 核心价值(本科生能懂的作用) |

|---|---|---|

| 10. ViT架构落地(AI看懂图像+文字) | 将Transformer用于图像识别,让AI既能“看图片”,又能“懂文字”,实现“看图说话”。 | 打破AI“只能看或只能说”的局限,比如AI能识别图片内容并生成描述。 |

| 11. 多模态技术融合 | AI整合图像、文字、视频等信息,能完成“视频配字幕”“根据文字画图片”等任务。 | 让AI的感知能力更像人类,既能看、能听,又能说、能画。 |

| 12. 万物序列建模(泛化应用) | 科学家把各种数据(股市K线、建筑设计图、蛋白质序列)变成“AI能看懂的序列”,输入大模型找规律。 | 让AI从“专用”变“通用”,比如能预测股市趋势、自动画建筑图,应用到生活、工作多个领域。 |

| 13. 大模型规模化爆发(补充节点) | ChatGPT、文心一言等大模型出现,能处理多种任务,普通人也能轻松使用AI。 | 让AI走进日常生活,比如AI助手、AI设计、AI学习工具,成为我们的“帮手”。 |

五、前沿探索期:AI构建“世界模型”(核心是解决“AI能理解世界规律并预测未来吗”)

当AI能“举一反三”,科学家们开始追求更高的目标——让AI真正“理解世界”,甚至能预测未来的变化。这一阶段,李飞飞、杨立昆等AI领军人物,给出了通向通用人工智能的关键方向。

| 核心节点 | 关键技术/事件(通俗解读) | 核心价值(本科生能懂的作用) |

|---|---|---|

| 14. 世界模型理念提出与推动 | 李飞飞、杨立昆等AI领军人物提出世界模型,将其定义为通向通用人工智能的关键路径,两人分别从不同方向推动技术落地。 | 为AI发展指明新方向,让AI从“拟合数据”向“理解世界、预测未来”跨越,更接近人类的认知方式。 |

| 15. 杨立昆JEPA系列论文及模型 | 2022年杨立昆发表论文提出JEPA(联合嵌入预测架构),后续推出I-JEPA、V-JEPA、LeWM等系列模型,核心是让AI抓事物核心特征而非细枝末节,相关论文持续迭代优化。 | 解决传统AI“只记表面数据”的问题,让AI能预测事物变化(如医学影像分析),且训练更高效、抗干扰能力更强。 |

| 16. 李飞飞世界模型商业化落地 | 李飞飞创立World Labs,推出首款商用世界模型Marble,可通过多模态输入生成3D虚拟世界,相关研究聚焦AI空间智能。 | 让世界模型从理论走向应用,可用于游戏开发、影视视效等场景,推动AI从2D感知向3D交互升级。 |

总结:我的AI理解小结

梳理完这五个时期,其实能清晰看到AI的进化逻辑——从“能学”(理论奠基),到“能看”(单点突破),再到“能懂”(全域转折)、“能举一反三”(泛化拓展),最后朝着“能理解世界”(前沿探索)稳步迈进。

这不是一份严谨的学术报告,只是我这段时间学习、思考后,对AI发展的个人理解。没有复杂的术语,没有高深的理论,只想把AI的发展脉络,用最易懂的方式分享出来。

AI的发展还在继续,从简单的感知机到复杂的世界模型,每一步都离不开科学家们的探索,也让我们看到了通用人工智能的无限可能。

更多推荐

已为社区贡献70条内容

已为社区贡献70条内容

所有评论(0)