手把手教你从零训练ChatGPT大模型:数据到部署全攻略(内含代码)

本文详细介绍了从零开始训练大语言模型的全流程,包含数据收集、预处理、Transformer架构解析和模型训练部署。主要内容包括:数据来源(开源数据集和爬取方法)、清洗去重技术;Tokenization原理与自定义Tokenizer训练;Transformer核心架构与自注意力机制实现。学习需要Python和深度学习基础,预计2-3周实践时间。

想要理解 ChatGPT 背后的原理?想亲手训练一个属于自己的大模型?这篇指南将带你走完从数据搜集到模型部署的完整流程。

🎯 前言

ChatGPT、Claude、Kimi……这些大语言模型(LLM)正在改变我们的工作方式。但你有没有想过:如果我想自己训练一个类似的大模型,该怎么做?

本文将从零开始,手把手教你完成:

- ✅ 数据搜集与清洗

- ✅ 数据预处理与 Tokenization

- ✅ Transformer 架构原理

- ✅ 模型训练实战

- ✅ 推理与部署

阅读难度: ⭐⭐⭐⭐(需要 Python 基础和深度学习概念)

预计学习时间: 2-3 周实践

📚 第一章:数据搜集——模型的"食粮"

大语言模型的能力,很大程度上取决于训练数据的质量。优质的数据是模型成功的基石。

1.1 数据来源

开源数据集(推荐入门)

| 数据集 | 规模 | 特点 | 适用场景 |

|---|---|---|---|

| Common Crawl | PB 级 | 网页爬取数据,原始但量大 | 预训练基础语料 |

| C4 | 800GB | 清洗后的 Common Crawl | 高质量预训练 |

| The Pile | 800GB | 多领域学术+代码+书籍 | 通用大模型训练 |

| WikiText | 100MB+ | 维基百科高质量文本 | 小规模实验 |

| OpenWebText | 38GB | Reddit 点赞链接的网页 | GPT-2 复现 |

| CodeParrot | 50GB+ | GitHub 代码数据 | 代码能力训练 |

| WuDaoCorpora | 3TB | 中文多模态数据集 | 中文大模型 |

自行搜集数据

# 示例:使用 requests 爬取网页数据import requestsfrom bs4 import BeautifulSoupdefcrawl_article(url): """爬取单篇文章""" headers = { 'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.0' } response = requests.get(url, headers=headers) soup = BeautifulSoup(response.content, 'html.parser') # 提取正文(根据网站结构调整选择器) content = soup.find('article') or soup.find('div', class_='content') return content.get_text() if content else""# 批量爬取示例urls = ['https://example.com/article1', 'https://example.com/article2']for url in urls: text = crawl_article(url) # 保存到文件...

1.2 数据清洗

原始数据含有大量噪声,必须清洗:

import redefclean_text(text): """文本清洗流程""" # 1. 去除 HTML 标签 text = re.sub(r'<[^>]+>', '', text) # 2. 去除多余空白 text = re.sub(r'\s+', ' ', text) # 3. 去除特殊字符(保留基本标点) text = re.sub(r'[^\u4e00-\u9fa5a-zA-Z0-9\s\.\,\!\?\;\:\'\"\-\(\)]', '', text) # 4. 去除过短文本(少于 50 字符) iflen(text) < 50: returnNone # 5. 去除重复段落 lines = text.split('\n') unique_lines = list(dict.fromkeys(lines)) # 去重同时保持顺序 text = '\n'.join(unique_lines) return text.strip()

1.3 数据去重

大规模数据去重使用 MinHash + LSH 算法:

from datasketch import MinHash, MinHashLSHdefdeduplicate_documents(documents, threshold=0.8): """文档去重""" lsh = MinHashLSH(threshold=threshold, num_perm=128) unique_docs = [] for doc_id, text inenumerate(documents): m = MinHash(num_perm=128) # 将文本分词后建立签名 for word in text.split(): m.update(word.encode('utf8')) # 检查是否已存在相似文档 ifnot lsh.query(m): lsh.insert(doc_id, m) unique_docs.append(text) return unique_docs

🔧 第二章:数据预处理与 Tokenization

2.1 什么是 Tokenization?

Tokenization 是将文本切分成模型能理解的"词片"(tokens)的过程。

示例:

输入: "Hello world!"输出: ["Hello", " world", "!"]对应 ID: [15496, 995, 0]

2.2 主流 Tokenizer 对比

| 算法 | 代表 | 特点 |

|---|---|---|

| BPE | GPT-2/3/4 | 字节对编码,合并最频繁的字符对 |

| WordPiece | BERT | 从字符开始,逐步合并 |

| Unigram | T5/XLM | 从大量子词开始,逐步剪枝 |

| SentencePiece | LLaMA/Alpaca | 语言无关,直接处理原始文本 |

2.3 训练自己的 Tokenizer

使用 Hugging Face tokenizers 库:

from tokenizers import Tokenizer, models, trainers, pre_tokenizers# 1. 初始化 BPE 模型tokenizer = Tokenizer(models.BPE())# 2. 设置预分词器(按空格和标点分割)tokenizer.pre_tokenizer = pre_tokenizers.Whitespace()# 3. 配置训练器trainer = trainers.BpeTrainer( vocab_size=32000, # 词表大小(常见:32K-100K) min_frequency=2, # 最小词频 special_tokens=["<pad>", "<unk>", "<s>", "</s>"])# 4. 训练(从文件)files = ["train_data_1.txt", "train_data_2.txt"]tokenizer.train(files, trainer)# 5. 保存tokenizer.save("my_tokenizer.json")

2.4 数据编码示例

# 加载训练好的 tokenizerfrom tokenizers import Tokenizertokenizer = Tokenizer.from_file("my_tokenizer.json")# 编码文本encoding = tokenizer.encode("Hello, 世界!")print(f"Tokens: {encoding.tokens}")print(f"IDs: {encoding.ids}")# 解码回文本decoded = tokenizer.decode(encoding.ids)print(f"Decoded: {decoded}")

🏗️ 第三章:Transformer 架构深度解析

2017 年 Google 发表的《Attention Is All You Need》论文提出了 Transformer 架构,彻底改变了 NLP 领域。

3.1 Transformer 整体架构

┌─────────────────────────────────────────┐│ 输入 Embedding ││ + 位置编码 (Positional) │└──────────────────┬──────────────────────┘ ▼┌─────────────────────────────────────────┐│ ┌─────────┐ ┌─────────┐ ┌─────┐ ││ │ 多头注意力 │ → │ 前馈网络 │ → │ Layer │ │ × N 层│ │ (MHSA) │ │ (FFN) │ │ Norm │ ││ └─────────┘ └─────────┘ └─────┘ │└─────────────────────────────────────────┘ ▼┌─────────────────────────────────────────┐│ 输出层 (LM Head) │└─────────────────────────────────────────┘

3.2 核心组件:自注意力机制

自注意力(Self-Attention) 是 Transformer 的灵魂,让模型能够"关注"输入序列的不同部分。

import torchimport torch.nn as nnimport mathclassSelfAttention(nn.Module): def__init__(self, embed_size, heads): super().__init__() self.embed_size = embed_size self.heads = heads self.head_dim = embed_size // heads # Q, K, V 线性变换 self.values = nn.Linear(embed_size, embed_size) self.keys = nn.Linear(embed_size, embed_size) self.queries = nn.Linear(embed_size, embed_size) self.fc_out = nn.Linear(embed_size, embed_size) defforward(self, values, keys, query, mask=None): N = query.shape[0] # batch size value_len, key_len, query_len = values.shape[1], keys.shape[1], query.shape[1] # 线性变换并 reshape 为多头的形式 values = self.values(values).view(N, value_len, self.heads, self.head_dim) keys = self.keys(keys).view(N, key_len, self.heads, self.head_dim) queries = self.queries(query).view(N, query_len, self.heads, self.head_dim) # 注意力计算: Q @ K^T / sqrt(d_k) energy = torch.einsum("nqhd,nkhd->nhqk", [queries, keys]) if mask isnotNone: energy = energy.masked_fill(mask == 0, float("-1e20")) attention = torch.softmax(energy / math.sqrt(self.head_dim), dim=3) # 加权求和: attention @ V out = torch.einsum("nhql,nlhd->nqhd", [attention, values]) out = out.reshape(N, query_len, self.embed_size) returnself.fc_out(out)

3.3 完整的 Decoder-Only 架构(GPT 风格)

class TransformerBlock(nn.Module): """单个 Transformer 块""" def__init__(self, embed_size, heads, dropout, forward_expansion): super().__init__() self.attention = SelfAttention(embed_size, heads) self.norm1 = nn.LayerNorm(embed_size) self.norm2 = nn.LayerNorm(embed_size) self.feed_forward = nn.Sequential( nn.Linear(embed_size, forward_expansion * embed_size), nn.GELU(), nn.Linear(forward_expansion * embed_size, embed_size) ) self.dropout = nn.Dropout(dropout) defforward(self, value, key, query, mask): attention = self.attention(value, key, query, mask) x = self.norm1(attention + query) # 残差连接 forward = self.feed_forward(x) out = self.norm2(forward + x) returnself.dropout(out)classGPT(nn.Module): """GPT 风格的 Decoder-only 模型""" def__init__( self, vocab_size, embed_size=768, num_layers=12, heads=12, forward_expansion=4, dropout=0.1, max_length=512 ): super().__init__() self.word_embedding = nn.Embedding(vocab_size, embed_size) self.position_embedding = nn.Embedding(max_length, embed_size) self.layers = nn.ModuleList([ TransformerBlock(embed_size, heads, dropout, forward_expansion) for _ inrange(num_layers) ]) self.fc_out = nn.Linear(embed_size, vocab_size) self.dropout = nn.Dropout(dropout) defforward(self, x, mask=None): N, seq_length = x.shape positions = torch.arange(0, seq_length).expand(N, seq_length).to(x.device) out = self.dropout( self.word_embedding(x) + self.position_embedding(positions) ) for layer inself.layers: out = layer(out, out, out, mask) returnself.fc_out(out)

3.4 不同规模模型配置参考

| 模型 | 参数量 | 层数 | 注意力头数 | 隐藏维度 | 词表大小 |

|---|---|---|---|---|---|

| GPT-2 Small | 117M | 12 | 12 | 768 | 50K |

| GPT-2 Medium | 345M | 24 | 16 | 1024 | 50K |

| GPT-2 Large | 774M | 36 | 20 | 1280 | 50K |

| GPT-3 Small | 125M | 12 | 12 | 768 | 50K |

| GPT-3 Medium | 350M | 24 | 16 | 1024 | 50K |

| GPT-3 Large | 760M | 24 | 16 | 1536 | 50K |

| LLaMA-7B | 7B | 32 | 32 | 4096 | 32K |

| LLaMA-13B | 13B | 40 | 40 | 5120 | 32K |

🚀 第四章:模型训练实战

4.1 训练流程概览

数据加载 → Tokenization → 构建 DataLoader → 初始化模型 → 训练循环 → 保存检查点

4.2 完整训练代码

import torchimport torch.nn as nnfrom torch.utils.data import Dataset, DataLoaderfrom tqdm import tqdmclassTextDataset(Dataset): """文本数据集""" def__init__(self, texts, tokenizer, max_length=512): self.tokenizer = tokenizer self.max_length = max_length self.data = [] for text in texts: encoding = tokenizer.encode(text) # 截断或填充到固定长度 ids = encoding.ids[:max_length] ids += [0] * (max_length - len(ids)) # 填充 self.data.append(ids) def__len__(self): returnlen(self.data) def__getitem__(self, idx): x = torch.tensor(self.data[idx][:-1]) # 输入:除最后一个 token y = torch.tensor(self.data[idx][1:]) # 目标:除第一个 token return x, ydeftrain_model( model, dataloader, epochs=3, lr=3e-4, device='cuda', save_path='model.pt'): """训练循环""" model = model.to(device) optimizer = torch.optim.AdamW(model.parameters(), lr=lr) criterion = nn.CrossEntropyLoss() for epoch inrange(epochs): model.train() total_loss = 0 progress = tqdm(dataloader, desc=f"Epoch {epoch+1}/{epochs}") for batch_idx, (x, y) inenumerate(progress): x, y = x.to(device), y.to(device) # 前向传播 outputs = model(x) loss = criterion(outputs.reshape(-1, outputs.size(-1)), y.reshape(-1)) # 反向传播 optimizer.zero_grad() loss.backward() torch.nn.utils.clip_grad_norm_(model.parameters(), 1.0) # 梯度裁剪 optimizer.step() total_loss += loss.item() progress.set_postfix(loss=loss.item()) # 定期保存 if batch_idx % 1000 == 0: torch.save({ 'epoch': epoch, 'model_state_dict': model.state_dict(), 'optimizer_state_dict': optimizer.state_dict(), 'loss': loss.item(), }, f"{save_path}.checkpoint") avg_loss = total_loss / len(dataloader) print(f"Epoch {epoch+1} 平均损失: {avg_loss:.4f}") # 保存最终模型 torch.save(model.state_dict(), save_path) print(f"模型已保存到 {save_path}")# 使用示例# dataset = TextDataset(cleaned_texts, tokenizer)# dataloader = DataLoader(dataset, batch_size=16, shuffle=True)# model = GPT(vocab_size=32000)# train_model(model, dataloader, epochs=3)

4.3 分布式训练(多 GPU)

对于大模型,需要使用分布式训练:

import torch.distributed as distfrom torch.nn.parallel import DistributedDataParallel as DDPdefsetup_distributed(): """初始化分布式训练""" dist.init_process_group("nccl") local_rank = int(os.environ["LOCAL_RANK"]) torch.cuda.set_device(local_rank) return local_rankdeftrain_distributed(): local_rank = setup_distributed() model = GPT(vocab_size=32000).to(local_rank) model = DDP(model, device_ids=[local_rank]) # 训练代码... if __name__ == "__main__": train_distributed()# 启动命令(4 卡训练)# torchrun --nproc_per_node=4 train.py

4.4 学习率调度

from torch.optim.lr_scheduler import CosineAnnealingLR, LinearLR# 预热 + 余弦退火scheduler = torch.optim.lr_scheduler.SequentialLR( optimizer, schedulers=[ LinearLR(optimizer, start_factor=0.1, total_iters=warmup_steps), CosineAnnealingLR(optimizer, T_max=total_steps - warmup_steps) ], milestones=[warmup_steps])

💡 第五章:模型推理与部署

5.1 文本生成

def generate_text( model, tokenizer, prompt, max_new_tokens=100, temperature=1.0, top_k=50, top_p=0.95, device='cuda'): """自回归文本生成""" model.eval() # 编码输入 input_ids = tokenizer.encode(prompt).ids input_tensor = torch.tensor([input_ids]).to(device) with torch.no_grad(): for _ inrange(max_new_tokens): # 获取 logits outputs = model(input_tensor) logits = outputs[:, -1, :] / temperature # Top-k 采样 if top_k > 0: indices_to_remove = logits < torch.topk(logits, top_k)[0][..., -1, None] logits[indices_to_remove] = float('-inf') # Top-p (nucleus) 采样 if top_p < 1.0: sorted_logits, sorted_indices = torch.sort(logits, descending=True) cumulative_probs = torch.cumsum(torch.softmax(sorted_logits, dim=-1), dim=-1) sorted_indices_to_remove = cumulative_probs > top_p sorted_indices_to_remove[..., 1:] = sorted_indices_to_remove[..., :-1].clone() sorted_indices_to_remove[..., 0] = 0 indices_to_remove = sorted_indices_to_remove.scatter(1, sorted_indices, sorted_indices_to_remove) logits[indices_to_remove] = float('-inf') # 采样下一个 token probs = torch.softmax(logits, dim=-1) next_token = torch.multinomial(probs, num_samples=1) # 追加到序列 input_tensor = torch.cat([input_tensor, next_token], dim=1) # 检查是否生成结束符 if next_token.item() == tokenizer.token_to_id("</s>"): break # 解码输出 output_ids = input_tensor[0].tolist() return tokenizer.decode(output_ids)# 使用示例# generated = generate_text(model, tokenizer, "人工智能是", max_new_tokens=50)# print(generated)

5.2 模型导出与量化

# 导出为 ONNX(便于跨平台部署)torch.onnx.export( model, dummy_input, "model.onnx", input_names=['input'], output_names=['output'], dynamic_axes={'input': {0: 'batch_size', 1: 'sequence'}})# 使用 bitsandbytes 进行 8-bit 量化(减少显存占用)import bitsandbytes as bnbmodel_8bit = model.to('cuda').to(torch.float16)for module in model_8bit.modules(): ifisinstance(module, nn.Linear): module.weight = bnb.nn.Int8Params(module.weight, requires_grad=False)

5.3 使用 Hugging Face Transformers 加载

from transformers import GPT2LMHeadModel, GPT2Tokenizer, GPT2Config# 保存为 Hugging Face 格式defsave_hf_format(model, tokenizer, save_directory): """转换为 Hugging Face 格式并保存""" config = GPT2Config( vocab_size=len(tokenizer.get_vocab()), n_positions=512, n_embd=768, n_layer=12, n_head=12 ) hf_model = GPT2LMHeadModel(config) # 复制权重... hf_model.save_pretrained(save_directory) tokenizer.save_pretrained(save_directory)# 加载并推理model = GPT2LMHeadModel.from_pretrained("./my_model")tokenizer = GPT2Tokenizer.from_pretrained("./my_model")

📊 第六章:训练技巧与最佳实践

6.1 显存优化技巧

| 技术 | 显存节省 | 说明 |

|---|---|---|

| Gradient Checkpointing | ~70% | 时间换空间,重计算激活值 |

| Mixed Precision | ~50% | FP16/BF16 训练 |

| DeepSpeed ZeRO | 90%+ | 分布式优化器状态 |

| Activation Checkpointing | ~50% | 选择性存储激活值 |

# Gradient Checkpointingmodel.gradient_checkpointing_enable()# Mixed Precisionfrom torch.cuda.amp import autocast, GradScalerscaler = GradScaler()with autocast(): outputs = model(inputs) loss = criterion(outputs, targets)scaler.scale(loss).backward()scaler.step(optimizer)scaler.update()

6.2 超参数调优

学习率: 1e-4 ~ 5e-4( warmup 到峰值后余弦衰减)Batch Size: 尽可能大(1M-4M tokens 全局 batch)序列长度: 512-2048(视任务而定)Dropout: 0.0-0.1(大模型通常不用)权重衰减: 0.01-0.1

6.3 推荐的训练框架

| 框架 | 特点 | 适用场景 |

|---|---|---|

| Hugging Face Transformers | 生态完善,易上手 | 研究、实验 |

| DeepSpeed | 微软开源,支持 ZeRO | 大规模训练 |

| Megatron-LM | NVIDIA 出品,性能强 | 超大规模模型 |

| Colossal-AI | 国产,统一并行 | 中文社区友好 |

| vLLM | 推理优化 | 高吞吐部署 |

🎓 学习资源推荐

必读论文

- Attention Is All You Need (Transformer 开山之作)

- Language Models are Few-Shot Learners (GPT-3)

- LLaMA: Open and Efficient Foundation Language Models

- Scaling Laws for Neural Language Models

优质课程

- Stanford CS224N: NLP with Deep Learning

- Stanford CS324: Large Language Models

- 李宏毅机器学习 (B站)

开源项目

- nanoGPT[1] - Andrej Karpathy 的极简 GPT 实现

- minGPT[2] - 教学用 PyTorch GPT

- LLaMA-Factory[3] - 大模型训练一站式框架

- axolotl[4] - YAML 配置训练

📝 总结

训练一个大语言模型涉及以下关键步骤:

- 数据准备 → 搜集、清洗、去重

- Tokenization → 训练 tokenizer,编码数据

- 模型设计 → Transformer Decoder 架构

- 训练 → 分布式训练,学习率调度

- 推理 → 文本生成,模型部署

入门建议:

- 先从小规模实验开始(1亿参数以内)

- 使用开源数据集和预训练 tokenizer

- 复现 nanoGPT 或 minGPT 作为起点

- 逐步扩展到更大规模

训练大模型是一个系统工程,需要算力、数据和经验的积累。希望这篇指南能帮你迈出第一步!

2026年AI行业最大的机会,毫无疑问就在应用层!

字节跳动已有7个团队全速布局Agent

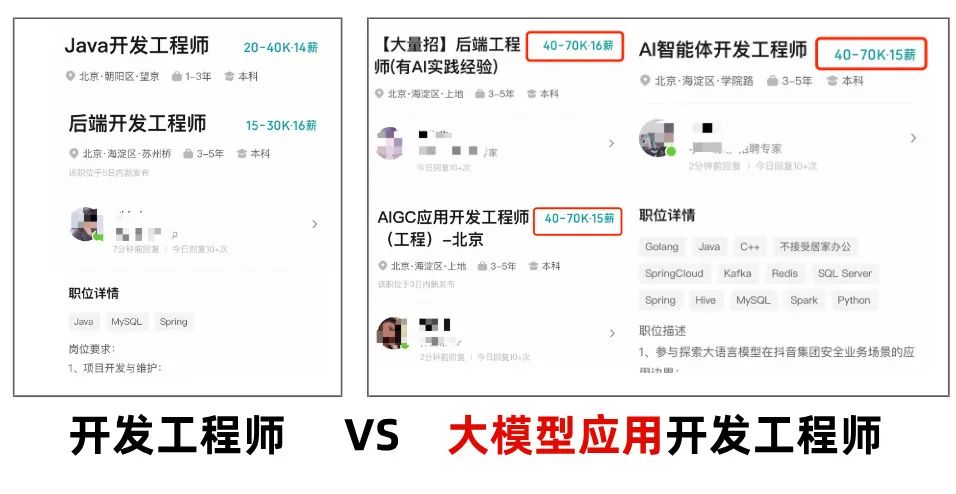

大模型岗位暴增69%,年薪破百万!

腾讯、京东、百度开放招聘技术岗,80%与AI相关……

如今,超过60%的企业都在推进AI产品落地,而真正能交付项目的 大模型应用开发工程师 **,**却极度稀缺!

落地AI应用绝对不是写几个prompt,调几个API就能搞定的,企业真正需要的,是能搞定这三项核心能力的人:

✅RAG:融入外部信息,修正模型输出,给模型装靠谱大脑

✅Agent智能体:让AI自主干活,通过工具调用(Tools)环境交互,多步推理完成复杂任务。比如做智能客服等等……

✅微调:针对特定任务优化,让模型适配业务

目前,脉脉上有超过1000家企业发布大模型相关岗位,人工智能岗平均月薪7.8w!实习生日薪高达4000!远超其他行业收入水平!

技术的稀缺性,才是你「值钱」的关键!

具备AI能力的程序员,比传统开发高出不止一截!有的人早就转行AI方向,拿到百万年薪!👇🏻👇🏻

AI浪潮,正在重构程序员的核心竞争力!现在入场,仍是最佳时机!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

⭐️从大模型微调到AI Agent智能体搭建

剖析AI技术的应用场景,用实战经验落地AI技术。从GPT到最火的开源模型,让你从容面对AI技术革新!

大模型微调

-

掌握主流大模型(如DeepSeek、Qwen等)的微调技术,针对特定场景优化模型性能。

-

学习如何利用领域数据(如制造、医药、金融等)进行模型定制,提升任务准确性和效率。

RAG应用开发

- 深入理解检索增强生成(Retrieval-Augmented Generation, RAG)技术,构建高效的知识检索与生成系统。

- 应用于垂类场景(如法律文档分析、医疗诊断辅助、金融报告生成等),实现精准信息提取与内容生成。

AI Agent智能体搭建

- 学习如何设计和开发AI Agent,实现多任务协同、自主决策和复杂问题解决。

- 构建垂类场景下的智能助手(如制造业中的设备故障诊断Agent、金融领域的投资分析Agent等)。

如果你也有以下诉求:

快速链接产品/业务团队,参与前沿项目

构建技术壁垒,从竞争者中脱颖而出

避开35岁裁员危险期,顺利拿下高薪岗

迭代技术水平,延长未来20年的新职业发展!

……

那这节课你一定要来听!

因为,留给普通程序员的时间真的不多了!

立即扫码,即可免费预约

「AI技术原理 + 实战应用 + 职业发展」

「大模型应用开发实战公开课」

👇👇

👍🏻还有靠谱的内推机会+直聘权益!!

完课后赠送:大模型应用案例集、AI商业落地白皮书

更多推荐

已为社区贡献700条内容

已为社区贡献700条内容

所有评论(0)