从大模型到具身无人系统:仿真驱动的云边协同与Sim2Real验证范式

随着AI技术的狂飙突进,大模型的终极归宿必然是跨界融合的具身智能。无人系统作为承载硅基智慧与现实物理世界互动的先锋载体,将在未来的通用人工智能版图中发挥不可估量的核心作用。在通往具身智能的浩瀚征途中,高保真仿真平台既是护航科研探索的安全底座,也是加速理论走向实践的催化剂。飞思实验室期望通过RflySim这一完整、高效、高扩展的实验基础设施,助力广大高校和科研团队搭建起从“大模型算法创新”到“真实机

近年来,大语言模型(LLM)与多模态大模型(VLM)正在以前所未有的速度重塑人工智能的技术范式。从纯粹的自然语言解析,跃升至兼备复杂逻辑推理、动态环境规划及深层视觉认知的新一代架构,AI正跨越“数字空间”的边界,强势进军能够改造物理世界的“具身智能(Embodied Intelligence)”。

在这一不可阻挡的浪潮下,无人机、无人控制平台等智能系统已成为大模型落地生根的关键载体。然而,当大模型这一“超强大脑”试图精准掌控智能系统的“物理躯干”时,却遭遇了跨维度的巨大鸿沟——物理实飞试错成本高昂、端侧边缘算力受限、复杂扰动环境难以可控复现,这些严峻的Sim2Real(仿真到现实)难题成为了制约技术落地的核心瓶颈。

如何构建一个兼具极致物理保真度与运行高安全性的实验验证环境,已成为学术界及工业界验证具身智能前沿算法的迫切诉求。直面这一行业痛点,飞思实验室自主研发了全新一代RflySim工具链。作为面向具身智能时代的无人系统仿真与快速开发基座,RflySim工具链以行业领先的底层物理引擎和灵活的软硬件架构设计,彻底打通了从纯软件在环验证、硬件在环仿真到无缝部署至物理真机的全链条验证闭环,为打破Sim2Real壁垒、加速大模型在无人系统领域的创新落地提供了极为硬核的基础设施支撑。

当“超强大脑”遇到现实物理法则

大模型以其惊人的“涌现能力”,在文本创作、代码生成等“试错成本为零”的数字领域取得了巨大成功。但将其接入真实世界的自主系统时,面临的挑战却大相径庭。

首先,物理世界的每一次决策失误都伴随着高昂的安全代价。大模型普遍存在“幻觉”现象,在文本生成中,幻觉只会产生一段不合逻辑的回答;但在无人机飞行控制中,一次由于环境理解错误或逻辑幻觉产生的避障指令失误,直接后果就是严重的坠机事故或造成危险。

其次,真实世界的物理数据与环境具有极强的不可重复性。科研人员在进行算法迭代时,需要对大模型的决策边界进行严格的对照实验。然而在户外真实环境中,风扰、光照变化、动态障碍物等测试条件瞬息万变,导致物理世界的数据采集犹如“开盲盒”,算法的稳定性和泛化能力难以得到科学的定量评估。

最后,大模型极其庞大的参数量与端侧设备的贫弱算力之间存在天然鸿沟。动辄数百亿甚至千亿参数的基础模型根本无法直接塞进轻量级的无人机机载伴飞电脑中;而如果完全依赖云端大模型进行远程控制,又面临着网络传输延迟的致命隐患。

因此,在无人系统跨入大模型时代的当下,一个高保真、可重复测试的虚拟仿真沙盒不再是可有可无的辅助选项,而是具身智能科研的“必经炼丹炉”。

技术演进 “看图说话”—“具身自治”

大模型技术的持续演进,为无人系统注入了前所未有的自主性。大模型在无人系统中的能力渗透,可以归纳为几个关键维度的跃升:

最初,大语言模型(LLM)赋予了无人系统高级的“逻辑中枢”。这使得研究人员能够告别繁琐的底层代码指令,直接通过自然语言下达宏观意图(例如:“飞向前方红色建筑物并在周边进行目标搜寻”)。LLM 强大的常识理解和代码生成能力,能够将这句自然语言精准解析分解为起飞、巡航、目标识别等一系列可执行的动作框架。

随后,多模态大模型(VLM)为系统装配了“智慧之眼”。无人系统可以通过机载摄像头获取实时画面,大模型直接对环境画面进行视觉问答式的语义理解,识别出哪里是可行进区域、何处有特定障碍物,从而摆脱了以往仅依赖硬编码规则的传统视觉识别系统的局限性。

发展至今,系统正逐渐升级为基于大模型的自主智能体(Agent)。大模型不仅能够感知当下,还能自主记忆环境、进行长远任务规划,并在执行中根据传感器的反馈动态调整策略流。人工智能正从被动的信息处理器,蜕变为能够主动探索、参与真实物理世界互动的高级具身实体。

破局之道 云边协同与RflySim验证闭环

面对上述挑战,“云边端协同” 已成为当前最具可行性的技术路径。这一框架将系统的任务进行解耦:在算力充沛的云端或地面站服务器中部署大语言模型,负责复杂的任务推理与宏观策略规划;在无人机的机载伴飞电脑(如Jetson系列)上部署轻量化的感知与控制模型,以高频率响应完成实时避障与飞行控制。未来,随着知识蒸馏等模型压缩技术的进一步成熟,大模型的核心能力也有望被“抽稀”为更精简的端侧专用模型,进一步释放边缘智能的潜力。

飞思实验室的RflySim工具链正是面向这一研发范式而构建的验证基础设施。工具链采用分布式架构设计,致力于实现对大模型驱动无人系统全流程的仿真闭环支持:

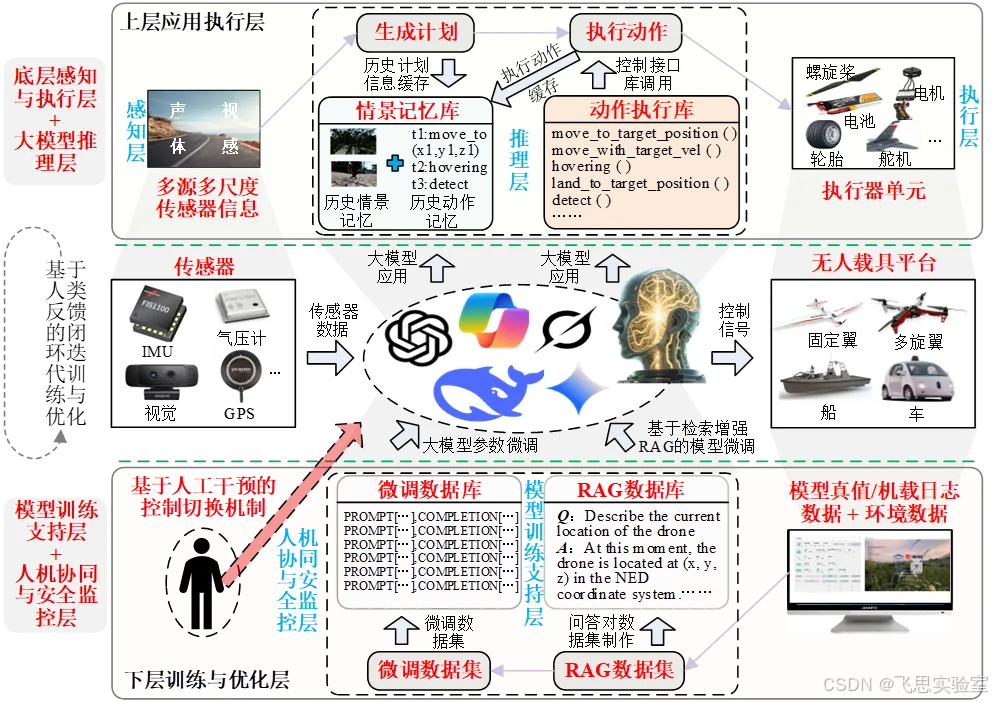

01底层感知与执行层+大模型推理层

底层传感器硬件(IMU、气压计、视觉、GPS)实时采集海量数据并回传至各主流大模型应用进行分析与决策;大模型下发的控制信号则直达无人载具平台(多旋翼、固定翼、无人车、无人船等)及其底层执行器单元(螺旋桨、电机、舵机等),实现“云端大脑”对“物理躯干”的精准微操。

02模型训练支持层+下层训练与优化层

RflySim不仅是测试工具链,更是大模型持续进化的语料工厂。它能源源不断地输出高保真模型真值、机载日志及环境数据,帮助研究人员自动制作微调数据集与检索增强(RAG)问答对,从而完成大模型在无人系统垂直领域的参数精调与专业知识内化。

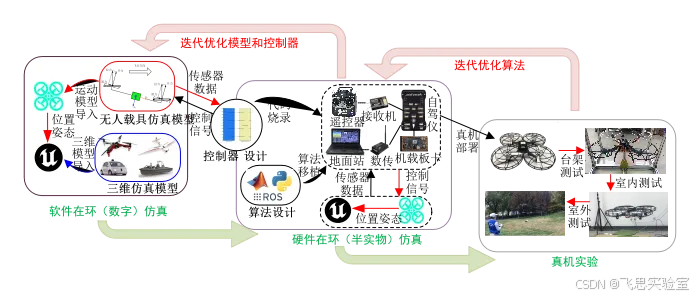

更核心的是,RflySim构建了一套从仿真到现实(Sim2Real)测试验证流水线:

-

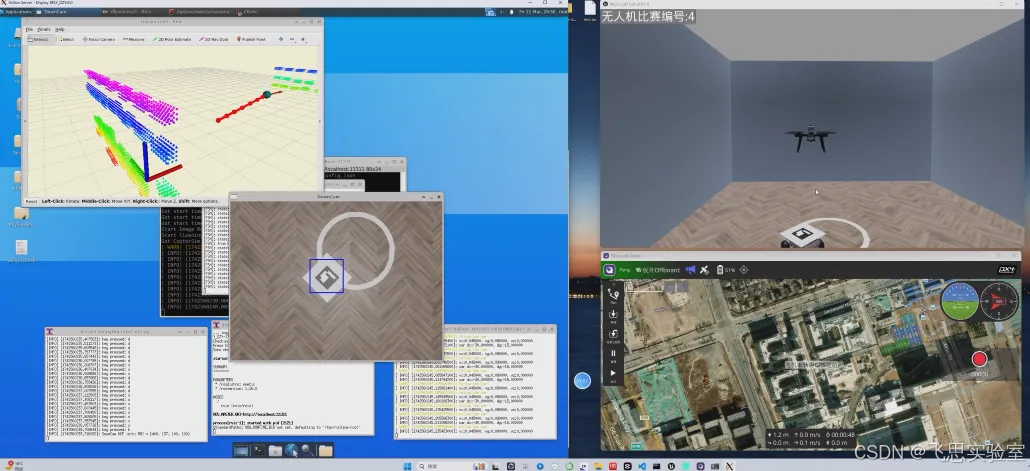

软件在环仿真(SIL)

通过一键启动脚本快速搭建PX4飞控仿真环境,让搭载大模型代码的系统在安全的三维虚拟世界中进行“试飞”。研究人员可通过自然语言指令(如“向前飞行1米”)驱动无人机,大模型将其解析为标准化控制命令并执行,充分暴露任务逻辑规划上的缺陷并低成本试错。 -

硬件在环仿真(HIL)

将算法部署到真实的自驾仪与机载伴飞电脑硬件中,通过网络接口接入 RflySim 仿真环境。无人机的“运动行为”在虚拟场景中飞翔,而“控制大脑”已是真实的物理硬件,借此精确验证端侧算力负载和云边通信延迟。 -

低代码修改的实飞验证

历经SIL和HIL的重重考验后,已被充分验证的算法代码只需简单切换数据来源(仿真→实物传感器),无需重构控制逻辑,即可平稳部署到真实的物理无人机上,显著降低炸机风险并大幅提高算法的部署效率。

结语

随着AI技术的狂飙突进,大模型的终极归宿必然是跨界融合的具身智能。无人系统作为承载硅基智慧与现实物理世界互动的先锋载体,将在未来的通用人工智能版图中发挥不可估量的核心作用。

在通往具身智能的浩瀚征途中,高保真仿真平台既是护航科研探索的安全底座,也是加速理论走向实践的催化剂。飞思实验室期望通过RflySim这一完整、高效、高扩展的实验基础设施,助力广大高校和科研团队搭建起从“大模型算法创新”到“真实机载系统验证”的坚实桥梁。

未来,在大模型持续进化与数字孪生仿真技术的双轮驱动下,具身无人系统必将在更加广阔、更加复杂的真实应用场景中展现其非凡潜力。

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)