AI Agent不是你以为的那样

AI Agent 不是你以为的那样。本文从 DeepMind DQN、OpenAI Five、AlphaStar 到腾讯绝悟,剖析了真正 Agent 的核心特征:Agent 是训练出来的模型本身,不是规则拼出来的工作流。我们探讨了 GOFAI 与真正 Agent 的本质区别,以及程序员在这个新范式下的角色——不是造司机,而是造车(Harness)。

系列:《AI Agent 从原理到实战 —— 解密 Claude Code 背后的工程智慧》 第1篇

引言

你大概有过这样的体验:打开 ChatGPT,说一句"帮我写封邮件,拒绝周五的会议邀请,语气委婉一点",几秒钟后一封措辞得体的邮件就出来了。复制,粘贴,发送,完事。

但如果你说的是"帮我把这个项目的测试覆盖率从 40% 提到 80%"呢?这不是写一段文字就能解决的事。它需要读代码、理解业务逻辑、找出没覆盖的分支、写测试用例、跑测试、看失败原因、改测试、再跑——可能要循环几十次。

前者是一个"工具"在帮你,后者才接近一个"Agent"在帮你。

这两件事的区别,远比大多数人以为的要大。而市面上很多自称"AI Agent"的产品,本质上还停留在第一种——只是把它包装得像第二种。

回到起点:最早的 AI Agent 长什么样

要理解什么是真正的 Agent,值得回头看几个里程碑。

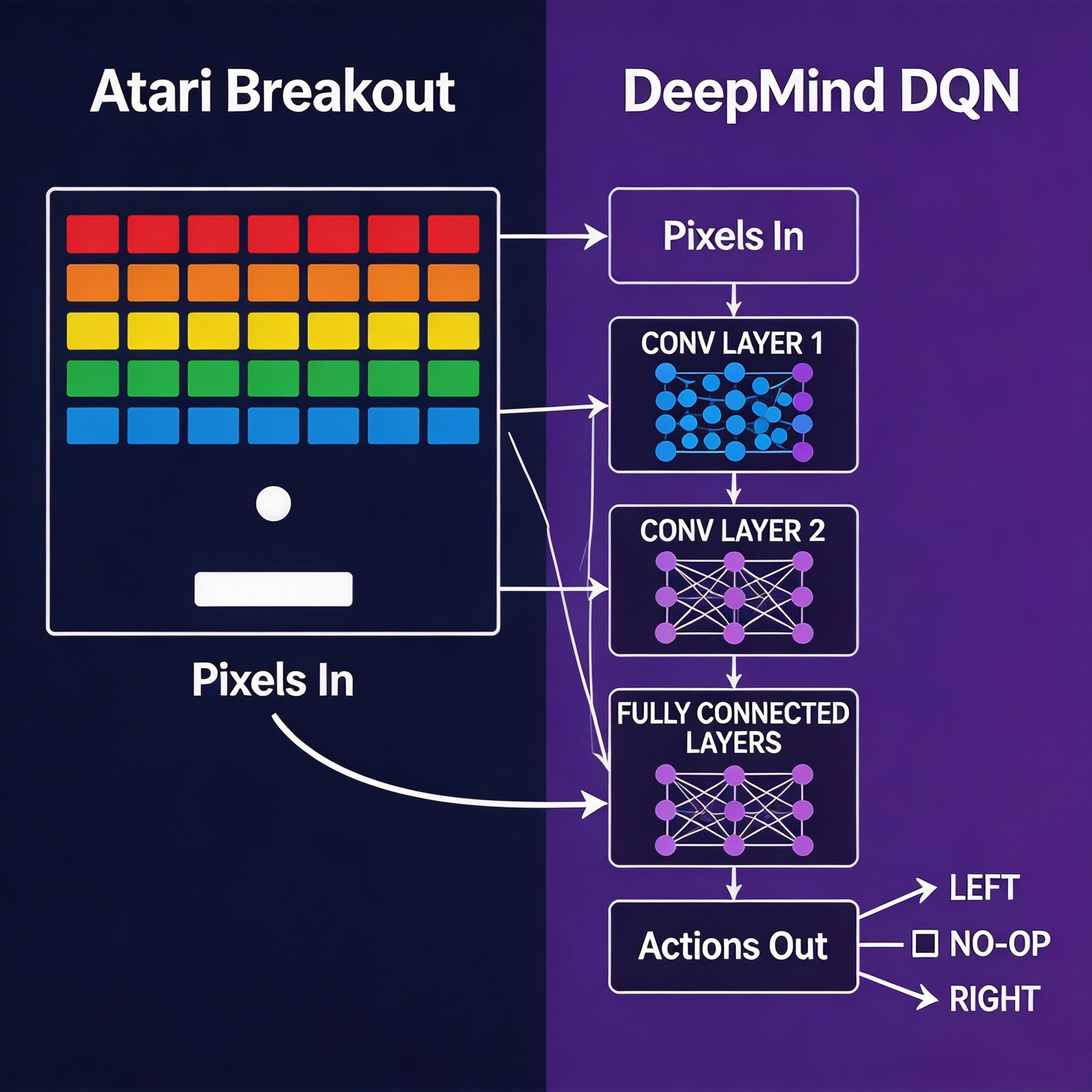

2013年,DeepMind 的 DQN 打 Atari 游戏。 一个神经网络,输入是游戏画面的像素,输出是手柄操作。没有人写规则告诉它"看到敌人要开枪",它自己从零开始,通过反复试错学会了玩几十款游戏——有些甚至超过了人类玩家的水平。

2019年,OpenAI Five 打 Dota 2。 五个 AI 组队,击败了 Dota 2 世界冠军 OG。Dota 2 是一个信息极其复杂的游戏:地图有战争迷雾,英雄有上百个技能,需要团队配合、资源分配、时机判断。OpenAI Five 没有任何硬编码的策略,全靠自我对弈训练出来。

同年,DeepMind 的 AlphaStar 打星际争霸。 星际争霸被认为是 AI 最难攻克的游戏之一——实时操作、不完全信息、长期规划缺一不可。AlphaStar 达到了欧服大师段位,超过 99.8% 的人类玩家。

还是2019年,腾讯的"绝悟"打王者荣耀。 在与 KPL(王者荣耀职业联赛)职业选手的对抗中取得了胜利。又一个纯粹靠训练、没有人工策略的 AI。

这些 Agent 的共同点

把这四个案例放在一起看,有一个关键共性:Agent 就是模型本身。

DQN 是一个神经网络。OpenAI Five 是五个神经网络。AlphaStar 是一个神经网络。绝悟也是。它们的"智能"不是外面套的代码给的,是训练出来的。没有人写了一个 if enemy_nearby then attack() 的规则——如果靠这种规则,它们不可能超越人类,因为写规则的人本身就是人类,天花板就在那里。

这就引出了一个核心观点。

Agent = 训练出来的模型,不是规则拼出来的工作流

现在市面上有大量"AI Agent 平台",它们的工作方式通常是这样的:

- 用户定义一个流程(比如"先搜索,再总结,再发邮件")

- 每一步调用一次 LLM

- 步骤之间用硬编码的逻辑串起来

这不是 Agent。这是一条流水线,LLM 只是流水线上的一个零件。决策权不在模型手里,在写流程的人手里。

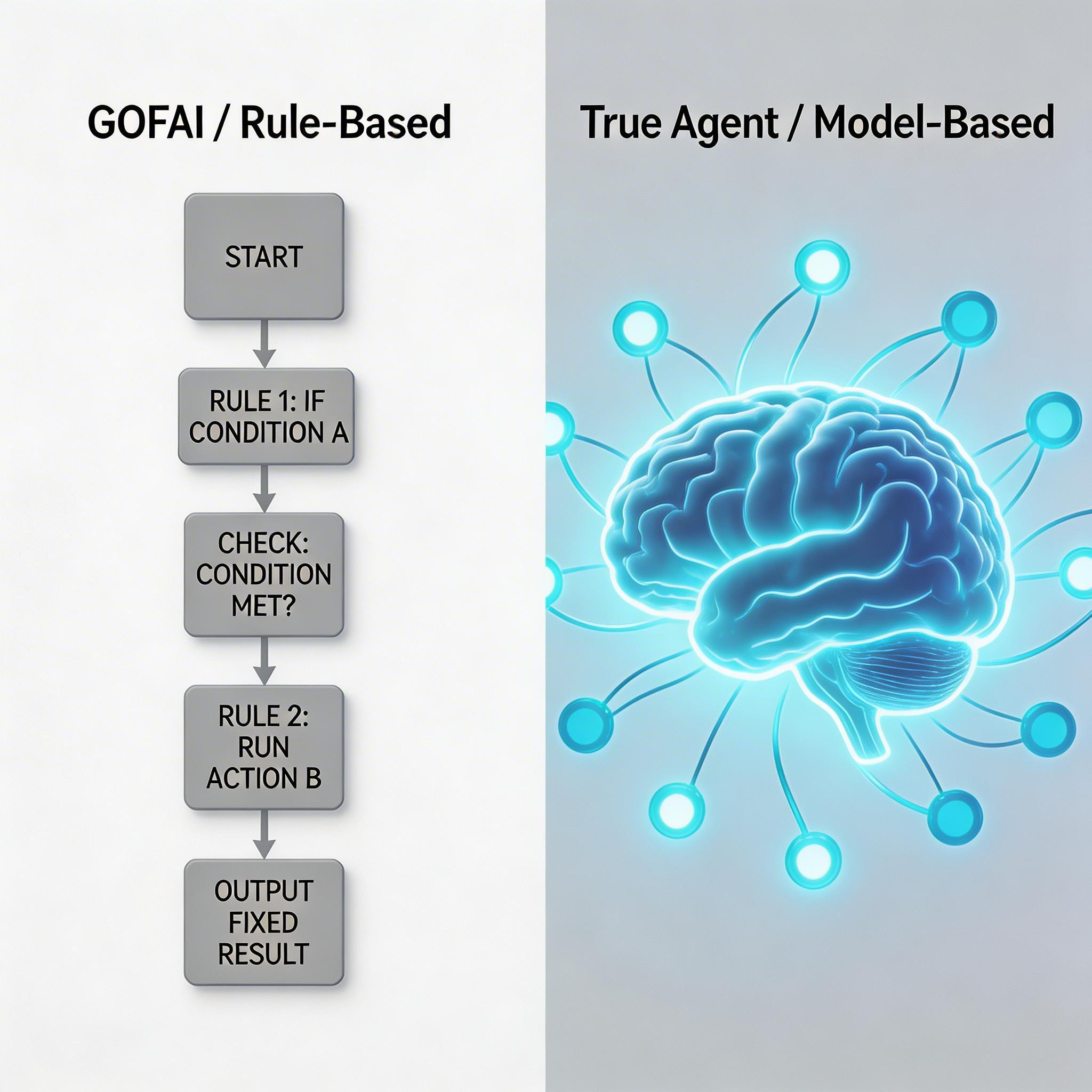

这种做法有一个学术名字,叫 GOFAI(Good Old-Fashioned AI),也就是"经典符号人工智能"。上世纪六七十年代的主流思路:把世界建模成规则和符号,用逻辑推理解决问题。专家系统就是这条路的产物。它能解决一些结构化的、边界清晰的问题,但碰到真实世界的复杂性就崩了——因为你不可能穷举所有规则。

给 LLM 套一个 if-else 外壳,本质上就是穿了新衣服的 GOFAI。它看起来时髦,但走的是同一条死胡同。

真正的 Agent 应该是:模型自己决定下一步做什么。 它看到当前状态,判断需要什么信息或操作,选择合适的工具执行,观察结果,再决定下一步。整个决策链条是模型的推理能力驱动的,不是预设的流程图驱动的。

那程序员的角色是什么?

如果 Agent 的智能来自模型,模型又不是我们训练的(那是 Anthropic、OpenAI 这些公司的事),那我们干什么?

这里有一个类比值得记住:

模型是司机,代码是车。你造的不是司机,你造的是车。

一个优秀的司机(模型),坐进一辆没有方向盘的车里,哪儿也去不了。而你的工作,就是造一辆好车——有方向盘、有仪表盘、有油门刹车、有导航系统——让司机能充分发挥能力。

这辆"车",在 AI Agent 领域有一个专门的名字:Harness。

Harness 这个词在中文里不太好直译。它的本意是"线具"或"挽具"——套在马身上的那套装备,让马的力量能被有效利用。在 AI Agent 语境下,你可以把它理解成"驾驶舱":它不提供动力(智能),但它决定了动力能不能被正确释放。

Claude Code 就是这样一个 Harness。它本身不是 Agent——Claude 模型才是 Agent。Claude Code 是给 Claude 造的那辆车,让它能在你的电脑上读文件、写代码、跑命令、搜索信息。

小结

回顾一下这篇文章的核心观点:

- AI Agent 的"智能"来自训练出来的模型,不是外面包的规则和流程

- 给 LLM 套 if-else 外壳的做法,本质是老式符号 AI 的翻版,有明确的天花板

- 我们(程序员、产品经理、各行各业的从业者)的角色不是造"司机",而是造"车"

- 这辆车叫 Harness

那这辆车到底长什么样?它最核心的结构是什么?下一篇,我们来看 AI Agent 最简单也最重要的一个机制——Agent Loop。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)