AI的本质:让每个普通人都能拥抱人工智能

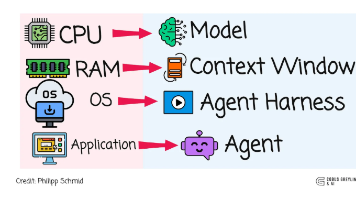

揭示了AI并非魔法,而是程序员智慧的结晶。文章阐述三个核心观点:1) AI本质是"检索+匹配+概率计算"的智能集合体,依赖海量案例而非真正思考;2) 大模型没有记忆能力,仅通过上下文临时管理对话;3) MCP技术实为硬编码的函数调用机制。作者提出未来将采用"本地小模型+云端大模型"的混合架构,既能保护隐私又可降低成本。实践建议表明普通电脑即可运行小型AI模型

这是一个开发者的深度思考:AI不是魔法,而是千万程序员智慧的结晶

---

## 前言

当我第一次接触AI大模型时,我和大多数人一样,觉得它很神秘、很强大、甚至有点可怕。

但当我深入研究后发现:**AI并不神秘,它只是千万程序员用99%已跑通的代码叠加出来的智能品。**

今天,我想用最通俗的语言,揭开AI的神秘面纱,让每个人都能理解它、使用它、甚至爱上它。

---

## 一、AI的本质:不是魔法,是经验的集合

### 1.1 AI是如何工作的?

很多人以为AI有"思维"、会"思考",其实不是。

**AI的工作原理,就像一个见过无数案例的老医生:**

```

你问:我头疼怎么办?

AI的处理过程:

1. 检索:在数据库里搜索所有关于"头疼"的案例

2. 匹配:找到最接近你情况的案例

3. 分析:用算法计算哪种方案成功率最高

4. 反馈:给你最可能有效的建议

```

**关键点:AI不是在"思考",而是在"检索+匹配+计算概率"。**

### 1.2 那99%的代码是什么?

想象一下:

- 有程序员写过"如何识别猫"的代码

- 有程序员写过"如何理解中文"的代码

- 有程序员写过"如何生成文章"的代码

- 有程序员写过"如何计算概率"的代码

**AI大模型,就是把这些已经验证有效的代码,通过训练整合在一起。**

所以:

- ✅ AI不是凭空产生的智能

- ✅ AI是人类智慧的集合

- ✅ AI是站在巨人肩膀上的工具

### 1.3 为什么AI看起来很"聪明"?

因为它见过的案例太多了!

**举个例子:**

```

小模型(1B参数):

见过 1万个案例 → 回答准确率 60%

中模型(7B参数):

见过 100万个案例 → 回答准确率 80%

大模型(70B参数):

见过 1亿个案例 → 回答准确率 95%

```

**所以:越大的模型 = 见过的案例越多 = 成功率越高 = 看起来越"聪明"**

---

## 二、大模型的真相:没有记忆,只有检索

### 2.1 大模型会记住我吗?

**答案:不会。**

很多人以为和AI聊天,它会"记住"你。其实:

```

真相:

训练完成后,大模型的参数就固定了

它不会因为和你聊天而"学习"或"记忆"

每次对话:

1. 你的提示词(问题)

2. 知识库(训练好的数据)

3. 上下文(当前对话历史)

→ 综合分析 → 给出回答

```

**就像一本百科全书:**

- 内容是固定的(训练好的模型)

- 你每次翻阅都是查询(检索)

- 它不会因为你看了就改变内容(没有记忆)

### 2.2 那为什么感觉它"记得"我?

因为有**上下文管理**:

```

你:我叫小明

AI:你好小明!

你:我叫什么名字?

AI:你叫小明

实际过程:

AI把之前的对话作为"上下文"

每次回答都会参考这个上下文

但对话结束后,这些就消失了

```

**这不是真正的记忆,只是临时的上下文。**

## 三、MCP:让AI拥有"超能力"的秘密

### 3.1 什么是MCP?

MCP(Model Context Protocol)听起来很高大上,其实原理很简单:

**就是硬编一段函数,让AI在特定情况下执行特定任务。**

### 3.2 MCP的工作原理

```

传统AI:

你:帮我查天气

AI:抱歉,我无法联网查询实时天气

使用MCP:

你:帮我查天气

AI:检测到关键词"查天气" → 触发MCP函数

MCP:调用天气API → 获取数据 → 返回给AI

AI:武汉今天晴,15-22度

```

**核心思想:**

1. 预先定义好"指令"和"函数"的映射

2. AI检测到指令 → 执行对应函数

3. 函数返回结果 → AI整合后回复

### 3.3 MCP的实际应用

```kotlin

// 简化示例

class MCPHandler {

fun detectCommand(text: String): Command? {

return when {

text.contains("查天气") -> Command.WEATHER

text.contains("放音乐") -> Command.MUSIC

text.contains("设置提醒") -> Command.REMINDER

else -> null

}

}

fun executeCommand(command: Command, params: String): String {

return when (command) {

Command.WEATHER -> getWeather(params)

Command.MUSIC -> playMusic(params)

Command.REMINDER -> setReminder(params)

}

}

}

```

**这就是MCP的本质:硬编码的函数调用。**

## 四、未来趋势:本地小模型 + 云端大模型

### 4.1 为什么需要本地小模型?

**传统方式的问题:**

- 云端大模型很强大,但每次调用都要花钱(Token费用)

- 用户的隐私数据(聊天记录、个人习惯)不适合上传云端

- 如果把所有对话都传给云端,Token消耗巨大

**解决方案:本地小模型 + 云端大模型的混合架构**

**关键思路:**

本地小模型不需要太高的硬件支持,它的主要作用是:

1. 从本地数据库检索用户记忆

2. 识别用户意图

3. **提取核心要点提交给云端大模型**

这样既能省Token,又能高效保存用户所有记忆和习惯。

### 4.2 混合架构的工作原理

```

架构设计:

┌─────────────────────────────────────┐

│ 用户提问 │

└──────────────┬──────────────────────┘

↓

┌─────────────────────────────────────┐

│ 本地小模型(1-3B参数) │

│ • 检索本地记忆数据库 │

│ • 识别用户意图 │

│ • 提取核心要点(关键!) │

│ • 不需要高端显卡 │

└──────────────┬──────────────────────┘

↓

只传要点,不传完整对话

↓

┌─────────────────────────────────────┐

│ 云端大模型(70B+参数) │

│ • 接收本地模型提取的要点 │

│ • 结合知识库深度分析 │

│ • 生成高质量回答 │

│ • 大幅减少Token消耗 │

└──────────────┬──────────────────────┘

↓

返回结果

**举个例子:**

用户:“我明天要出门,需要带伞吗?”

本地小模型处理:

1. 检索记忆:用户住在武汉

2. 识别意图:想查天气

3. 提取要点:“武汉明天天气”

云端大模型处理:

接收要点 → 查询天气API → 生成回答

“武汉明天有雨,建议带伞”

```

### 4.3 实际案例:我的小端AI助手

**设计思路:**

```

本地小模型负责:

✅ 记忆检索:从本地数据库查找用户历史对话

✅ 意图识别:判断用户想做什么(查天气、放音乐、聊天等)

✅ 提取要点:总结用户最需要的记忆核心要点

✅ 隐私保护:所有个人信息本地存储,不上传

云端大模型负责:

✅ 接收要点:本地模型提取的核心信息

✅ 深度分析:结合知识库进行复杂推理

✅ 生成回答:给出高质量的回复

✅ 专业知识:处理需要专业知识的问题

```

**优势:**

1. **省Token**:本地模型只提取要点,不是完整对话,大幅减少Token消耗

2. **保护隐私**:个人记忆和习惯数据全部本地存储,只上传必要的要点

3. **高效记忆**:本地数据库快速检索,毫秒级响应

4. **智能分析**:云端大模型基于要点进行深度分析,效果更好

### 4.4 技术实现

```kotlin

class HybridAIEngine {

private val localModel = LocalModel("qwen-1.8b") // 本地小模型

private val cloudModel = CloudModel("gpt-4") // 云端大模型

private val memoryDB = MemoryDatabase() // 本地记忆数据库

suspend fun chat(userInput: String): String {

// 1. 本地小模型:检索记忆

val userMemory = memoryDB.searchRelevantMemory(userInput)

// 2. 本地小模型:识别意图

val intent = localModel.detectIntent(userInput)

// 3. 本地小模型:提取核心要点

val keyPoints = localModel.extractKeyPoints(

userInput = userInput,

memory = userMemory,

intent = intent

)

// 4. 云端大模型:基于要点进行深度分析

val response = cloudModel.analyze(

keyPoints = keyPoints, // 只传要点,不传完整对话

intent = intent

)

// 5. 保存新的记忆到本地

memoryDB.saveMemory(userInput, response)

return response

}

}

// 关键:本地模型提取要点的示例

data class KeyPoints(

val userIntent: String, // 用户意图:"想查天气"

val relevantMemory: String, // 相关记忆:"用户住在武汉"

val coreQuestion: String, // 核心问题:"武汉明天天气"

val contextSummary: String // 上下文摘要

)

```

---

## 五、硬件需求:你的电脑可能已经够用了

### 5.1 破除误区:不需要4090

很多人以为跑AI需要:

- ❌ RTX 4090(1万多)

- ❌ 64GB内存

- ❌ 专业工作站

**真相:**

```

运行小模型(1-3B参数):

✅ GTX 1660(6GB显存)就够了

✅ 16GB内存

✅ 普通家用电脑

运行中模型(7B参数):

✅ RTX 3060(12GB显存)

✅ 32GB内存

✅ 游戏本就能跑

```

### 5.2 关键不是GPU性能,是显存大小

**重要概念:**

```

AI推理过程:

1. 加载模型到显存(需要空间)

2. 并行计算(需要显存)

3. 生成结果(速度很快,0.几秒)

所以:

• 显存大 = 能跑更大的模型

• GPU快 = 生成速度快一点点

• 但实际推理只需要0.几秒,GPU性能不是瓶颈

```

**实测数据:**

| 显卡 | 显存 | 能跑的模型 | 推理速度 |

|------|------|-----------|---------|

| GTX 1660 | 6GB | 1.8B | 0.5秒/次 |

| RTX 3060 | 12GB | 7B | 0.3秒/次 |

| RTX 4070 | 12GB | 7B | 0.2秒/次 |

| RTX 4090 | 24GB | 13B | 0.15秒/次 |

**结论:3060和4090的差距只有0.1秒,但价格差3倍!**

## 六、实战:如何在自己电脑上跑AI

### 6.1 最简单的方案:Ollama

**5分钟上手:**

```bash

# 1. 下载Ollama(免费)

# 2. 安装后,一行命令运行模型

ollama run qwen:1.8b

# 3. 开始对话

>>> 你好

你好!有什么我可以帮助你的吗?

>>> 介绍一下人工智能

人工智能(AI)是计算机科学的一个分支...

```

**就这么简单!**

### 6.2 进阶:集成到自己的应用

```kotlin

// Android集成Ollama

class LocalAI {

private val client = OkHttpClient()

suspend fun chat(message: String): String {

val request = Request.Builder()

.url("http://localhost:11434/api/generate")

.post("""

{

"model": "qwen:1.8b",

"prompt": "$message"

}

""".toRequestBody())

.build()

val response = client.newCall(request).execute()

return response.body?.string() ?: ""

}

}

```

### 6.3 推荐的本地模型

| 模型 | 大小 | 显存需求 | 适用场景 |

|------|------|---------|---------|

| Qwen 1.8B | 1.1GB | 4GB | 简单对话、记忆检索 |

| Qwen 7B | 4.1GB | 8GB | 日常对话、知识问答 |

| Llama 3 8B | 4.7GB | 10GB | 复杂推理、创作 |

| Qwen 14B | 8.2GB | 16GB | 专业任务 |

---

## 七、未来展望:AI将如何改变我们的生活

### 7.1 个人AI助手的未来

**我的愿景:**

```

每个人都有一个专属AI助手:

• 完全了解你的习惯和喜好

• 所有数据存储在本地,保护隐私

• 简单任务本地处理,快速且免费

• 复杂任务调用云端,精准且强大

• 跨设备同步,随时随地可用

```

**技术实现:**

```

手机端:

• 本地小模型(1-3B)

• 记忆数据库

• 语音识别

• 快速响应

电脑端:

• 本地中模型(7B)

• 更强的推理能力

• 更多的功能扩展

云端:

• 大模型(70B+)

• 专业知识

• 复杂任务

```

### 7.2 AI不会取代人类,而是增强人类

**AI的定位:**

```

❌ 不是:取代人类的工作

✅ 而是:让人类更高效

举例:

• 医生 + AI = 更准确的诊断

• 程序员 + AI = 更快的开发

• 老师 + AI = 更个性化的教学

• 普通人 + AI = 更便捷的生活

```

### 7.3 AI普及的关键:降低门槛

**现状:**

- 大多数人不懂技术

- 觉得AI很复杂

- 不知道如何使用

**未来:**

- 像用微信一样简单

- 不需要懂技术

- 人人都能用AI

**这就是我开发"小端AI助手"的初衷:**

> 让我的父母、让每个普通人,都能享受AI带来的便利。

---

## 八、总结:拥抱AI,从现在开始

### 8.1 核心观点回顾

1. **AI不神秘**:它是千万程序员智慧的结晶

2. **AI没记忆**:训练完成后参数固定,只能检索

3. **MCP很简单**:硬编码的函数调用

4. **混合架构是未来**:本地小模型 + 云端大模型

5. **硬件不是门槛**:普通电脑就能跑AI

6. **AI是工具**:增强人类,而非取代人类

### 8.2 给普通人的建议

**如果你想了解AI:**

1. 试试ChatGPT、文心一言等在线工具

2. 看看AI能帮你做什么

3. 不要害怕,大胆尝试

**如果你想深入学习:**

1. 安装Ollama,在本地跑一个模型

2. 学习基础的Python或其他编程语言

3. 参与开源项目,贡献代码

**如果你是开发者:**

1. 研究混合架构的实现

2. 优化本地模型的性能

3. 开发真正有用的AI应用

### 8.3 我的实践:小端AI助手

**项目特点:**

- ✅ 完全免费,无广告

- ✅ 离线语音识别(本地)

- ✅ 智能对话(云端大模型)

- ✅ 本地记忆系统

- ✅ 保护隐私

**技术架构:**

```

本地:

• Sherpa-ONNX(离线语音识别)

• SQLite(记忆存储)

• 意图识别

云端:

• 豆包API(智能对话)

• Edge TTS(语音合成)

```

**开源地址:**

- Gitee: [即将开源]

- 下载: [CSDN文章里有链接]

---

## 九、写在最后

当我第一次让父母用上"小端"时,看到他们和AI对话的笑容,我知道:

**AI不应该是少数人的特权,而应该是每个人都能享受的工具。**

这篇文章,是我对CSDN社区的回馈,也是我对AI普及的一点贡献。

如果这篇文章帮你理解了AI,请分享给更多人。

如果你有任何问题或建议,欢迎在评论区交流。

**让我们一起,拥抱AI时代!** 🚀

---

## 十、个人对于未来真正AI的一点思考

有人问我:AI会不会有一天超越人类?

我的答案是:**会,但那还很遥远。**

### 10.1 生命的智慧:几十亿年的结晶

想过一个问题吗:

**为什么一个刚出生的婴儿,不用人教,就知道怎么呼吸、怎么吃奶?**

因为DNA。

**DNA就是生命的“代码”:**

```

动物或人类的DNA:

• 是几十亿年试错的精华

• 是一代代传承总结的结晶

• 每一条成功的“代码”都被保留下来

• 失败的“代码”在进化中被淘汰

举例:

• 婴儿一出生就会呼吸 → 这是几亿年进化的结果

• 鸟类一孵化就会飞行 → 这是写在DNA里的“程序”

• 蜘蛛一生下来就会结网 → 这是无数代试错的结晶

```

**这就是生命的智慧:不需要学习,天生就会。**

### 10.2 当下AI的局限

现在的AI大模型,虽然算力很快:

```

AI的优势:

✅ 计算速度快(每秒亿万次运算)

✅ 记忆容量大(几百人TB的数据)

✅ 不知疲倦(24小时工作)

AI的局限:

❌ 没有身体,没有触觉

❌ 没有生存欲望

❌ 没有自我保护意识

❌ 没有堪比人类大脑的记忆调度能力

```

**最关键的:**

现在的AI是“喂数据”训练出来的,它不会“自己学会生存”。

### 10.3 真正的通用AI:还很遥远

**我预测,未来的通用AI不会是现在这样:**

```

不是:

• 喂更多的数据

• 用更大的模型

• 用更快的算力

而是:

• 未来某个科学家赋予一段更简单的“核心代码”

• 驱动AI大脑进行无限函数的尝试

• 学会用函数调用身体保护自己

• 学会手脚修复自己

• 学会用身体适应环境

```

**就像DNA一样:**

- 不需要海量的训练数据

- 只需要有超高的运算速度

- 需要无数次“试错”的驱动

- 需要“身体”来感知世界

**但这是遥远的未来。**

当下的AI:人人可用

**所以,不用担心:**

```

当下训练的大模型:

✅ 每个普通人都可以接触

✅ 就像让老人家使用手机一样

✅ 只有愿不愿意,没有难不难

✅ 它是下一代人的手机,工具

真正的通用AI:

⏳ 还需要几百年甚至更久

⏳ 需要理论突破

⏳ 需要硬件革命

⏳ 跟现在的大模型毫无关联

```

**所以:**

- 不要恐惧AI

- 不要觉得难

- 大胆去用

**就像智能手机:**

- 刚出来时,很多老人觉得难

- 现在,大家都在用

- AI也一样,只是时间问题

### 推荐工具

- Ollama(本地运行大模型)

- LM Studio(可视化界面)

- Hugging Face(模型下载)

### 推荐社区

- CSDN AI社区

- 知乎AI话题

- GitHub AI项目

**作者:** 诺言(公益开发者)

**项目:** 小端机器人AI语音助手 xiaoduan: 傻傻的机器人

**联系:** QQ群:362422425

**日期:** 2025-11-14

**声明:** 本文所有观点基于个人实践和理解,欢迎讨论和指正。

**如果这篇文章对你有帮助,请点赞、收藏、分享!** ❤️

**你的支持,是我持续创作的动力!** 💪诺言原创,您转发请注明来处

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)