OpenClaw × 88API:小白也能3分钟玩转小龙虾【2026最新教程】

本文介绍了一套简化AI接口调用的本地代理方案,通过OpenClaw+CCSwitch工具组合实现API渠道的无缝切换。配置流程包括:1)安装CCSwitch管理多个中转站账号;2)部署OpenClaw本地网关关联CCSwitch;3)将请求转发至本地端口实现统一调用。该方案优势在于业务代码无需修改即可切换渠道,支持多模型调用(如Claude/GPT/Gemini),且提供可视化界面监控请求状态。完

上周帮朋友调试项目,他的 Claude API 调用三天两头超时,换了个中转站又要改一遍 base_url,改完发现新渠道不支持他要的模型。后来我给他搭了个本地网关,现在切渠道只要点一下按钮,代码一行都不用动。

这套方案用的是 OpenClaw + CC Switch,前者是本地 API 代理,后者管理你的所有中转站账号。配置完之后,所有 AI 接口请求都走本地转发,想换渠道就在界面上点一下,代码层面完全无感知。本文记录一下完整配置流程,从安装到跑通大概 10 分钟。

工具准备:OpenClaw(本地网关)+ CC Switch(渠道管理)+ 一个能用的中转站账号(本文用 88API 演示,因为它支持 Claude/GPT/Gemini 用同一个 Key 切换,配置起来省事)。

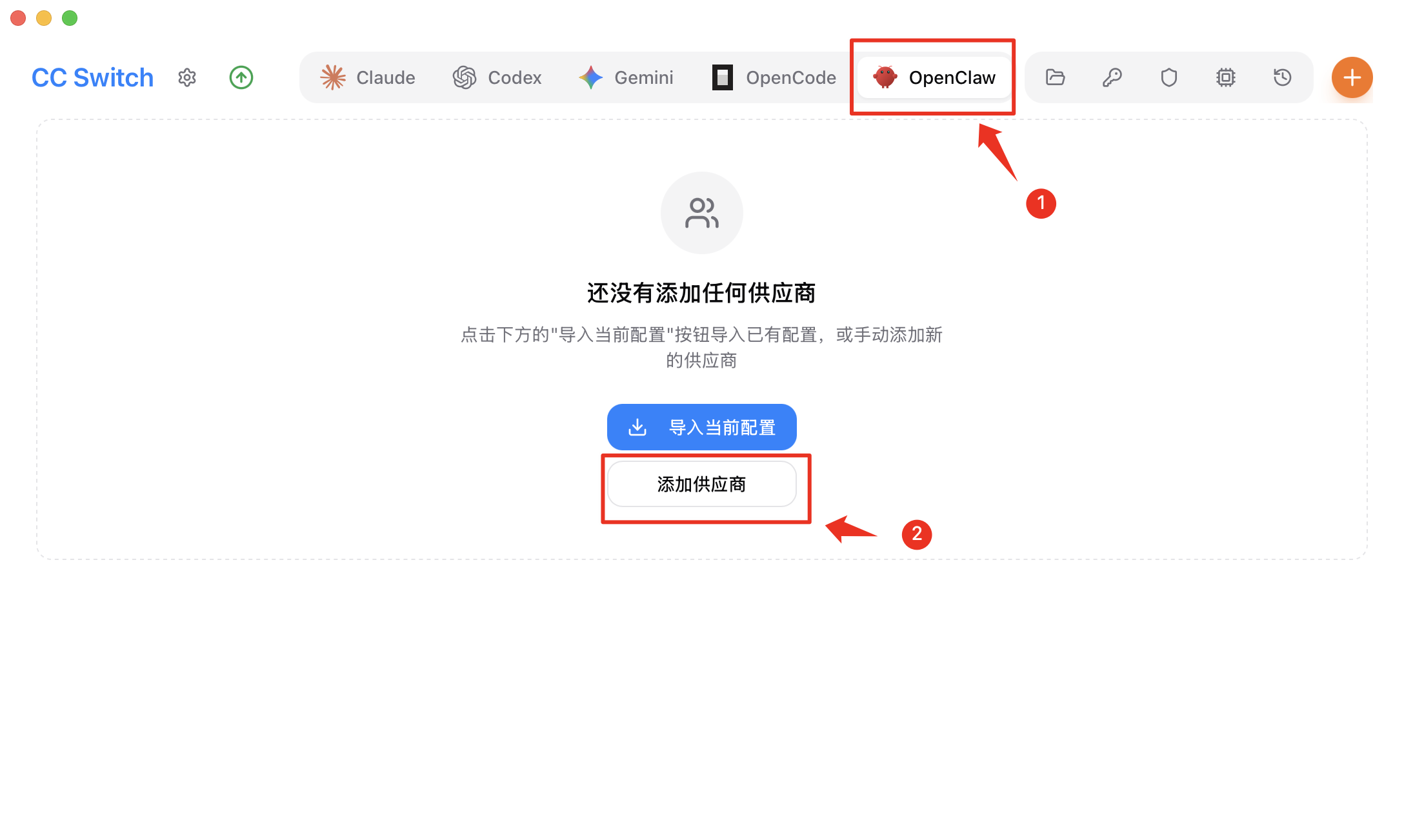

第一步:装 CC Switch,把中转站账号加进去

CC Switch 是个桌面应用,专门用来管理 AI 中转站账号。你可以把多个供应商的 API Key 都配进去,然后一键切换默认渠道。

操作:

- 去 GitHub Release 页面下载对应系统的安装包:

https://github.com/farion1231/cc-switch/releases - 安装后打开,进入「供应商管理」

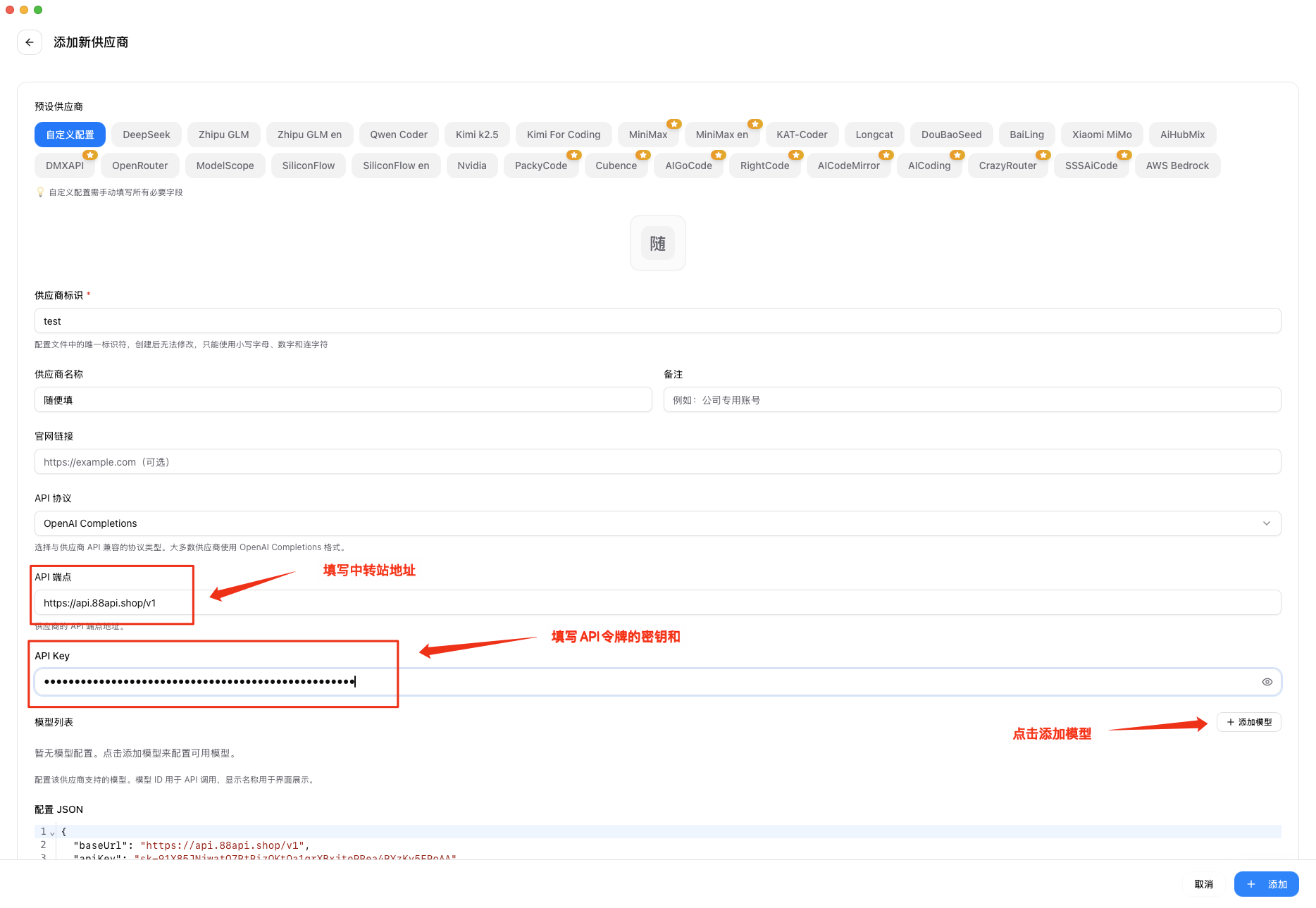

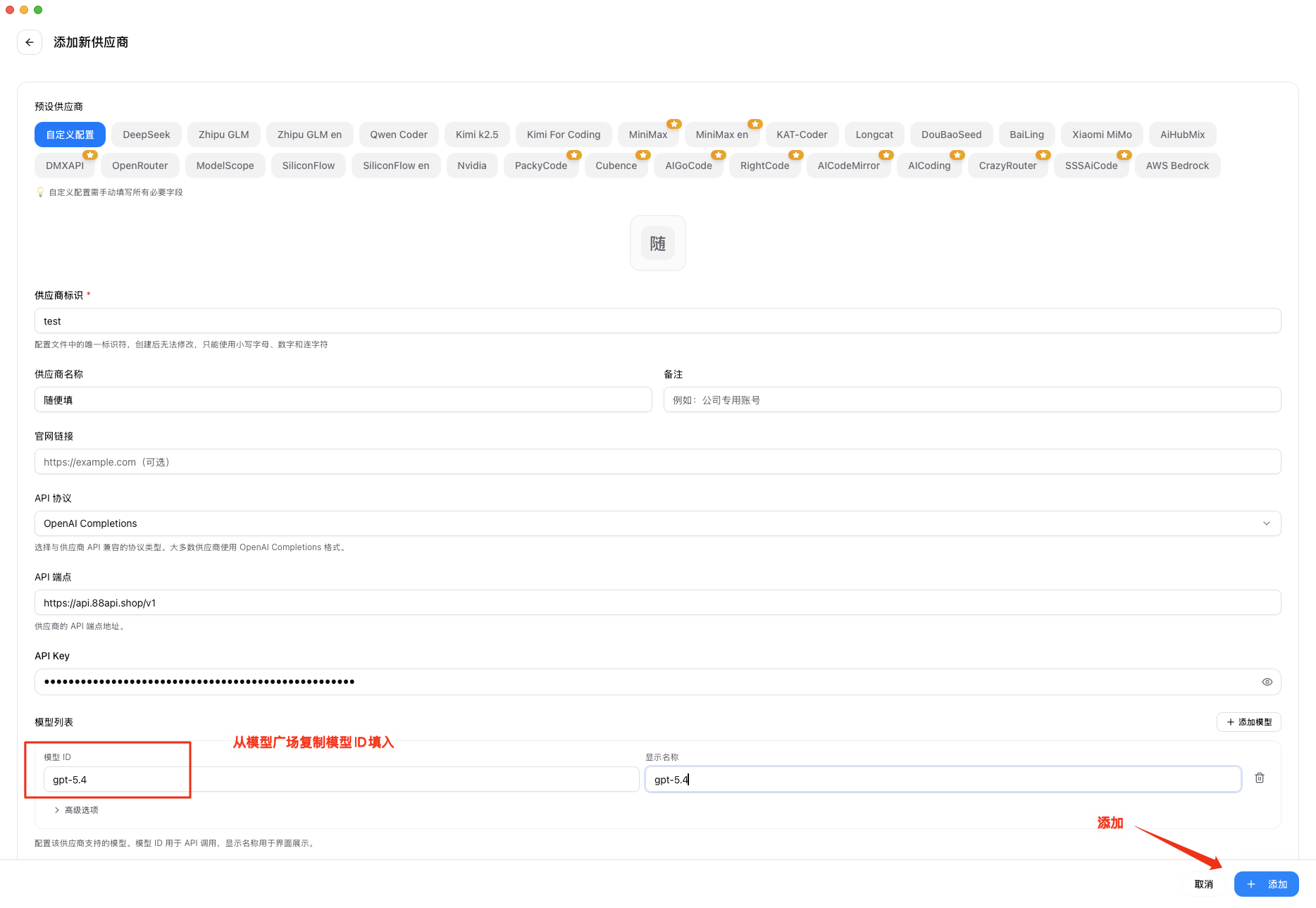

- 点「添加供应商」,填三个信息:

- 供应商名称:随便起,比如

88API - API Base URL:

https://api.88api.shop/v1 - API Key:去官网注册后在控制台创建密钥,复制过来

- 供应商名称:随便起,比如

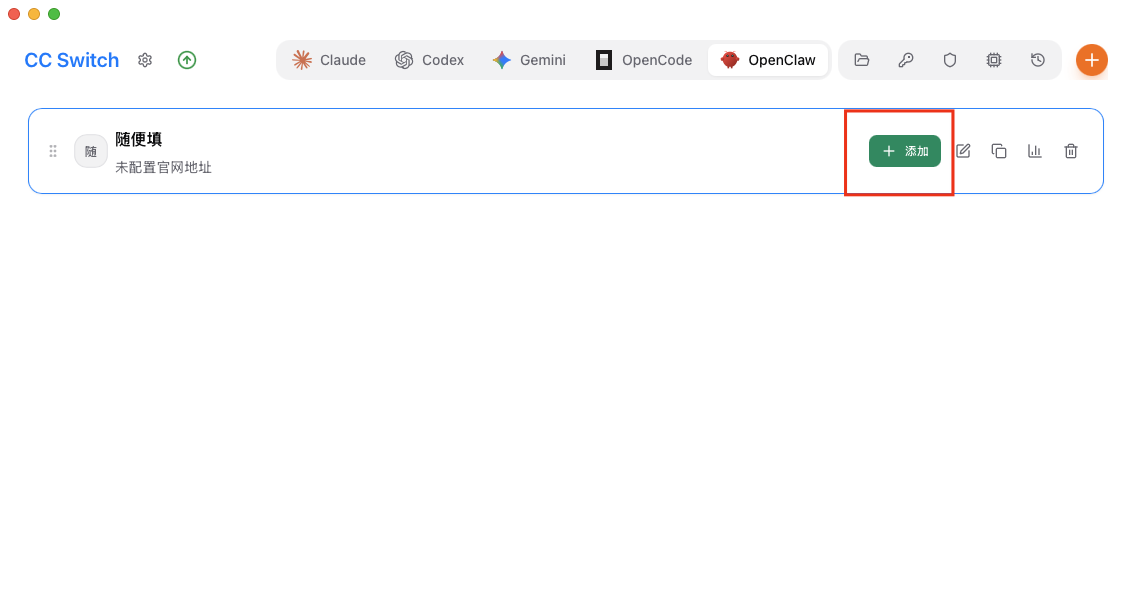

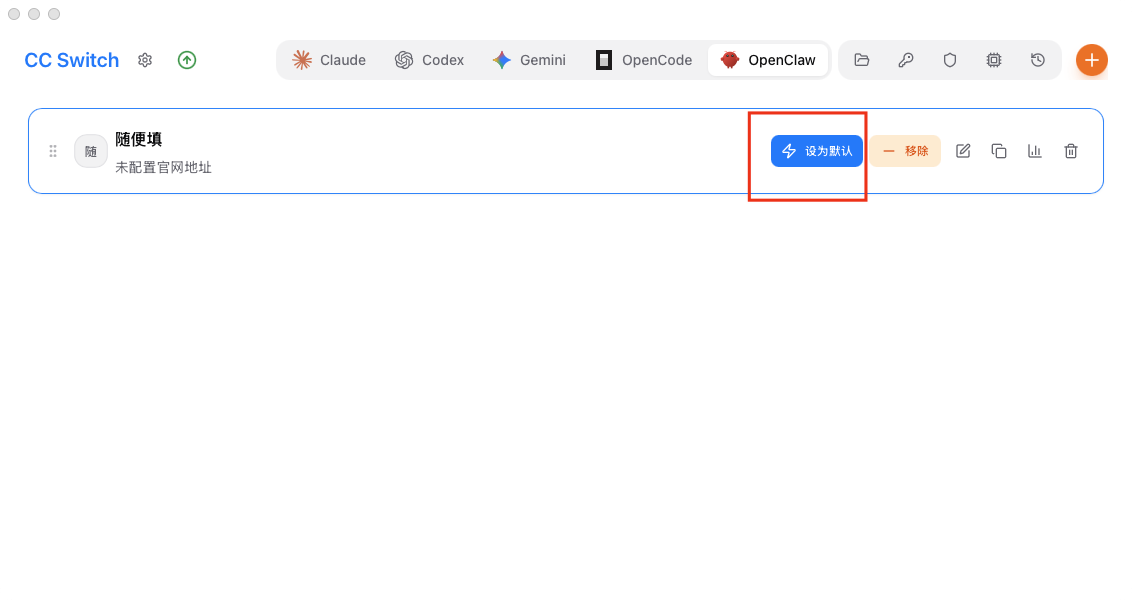

- 点「确认添加」,然后在列表里找到这个供应商,点「设为默认」

这步做完之后:你的中转站账号已经被 CC Switch 纳管了,后面 OpenClaw 会从这里读取渠道配置。

⚠️ 如果你有多个中转站账号,重复步骤 3-4 依次加进去就行。CC Switch 支持同时管理多个供应商,切换的时候直接点按钮。

第二步:装 OpenClaw,把它和 CC Switch 关联起来

OpenClaw 是本地网关的核心,它会在你电脑上起一个服务,监听某个端口,所有发到这个端口的 AI 请求都会被转发到 CC Switch 配置的渠道。

前置检查:OpenClaw 基于 Node.js,确认一下环境:

node -v # 输出版本号就行,要求 ≥ 18.x

npm -v

如果没装 Node.js,去官网下一个 LTS 版本装上。

安装 OpenClaw:

npm install -g openclaw@latest

openclaw --version # 输出版本号说明装好了

初始化配置:

openclaw onboard

执行后会进入交互式引导,按提示操作:

- 选择 Chat 模式:直接回车用默认值

- 配置默认模型:随便选一个,后面可以改

- 关联 CC Switch:这步会自动检测 CC Switch 的配置,确认关联即可

这步做完之后:OpenClaw 已经知道去哪读你的中转站配置了,接下来启动服务就能用。

⚠️ 初始化时选的模型不重要,后面调用接口时可以在代码里指定任意模型,只要你的中转站支持就行。

第三步:启动网关,验证能不能用

启动服务:

openclaw gateway --port 18789

终端会输出服务状态,看到 Gateway running 字样就说明起来了。这时候本地 18789 端口已经在监听,所有发到这个端口的请求都会走 CC Switch 配置的渠道转发。

打开控制台看一眼:

浏览器访问 http://127.0.0.1:18789/,你会看到 OpenClaw 的 Web 界面,里面有请求日志、渠道状态、支持的模型列表。后面调接口出问题了,来这里看日志能快速定位。

写段代码测试:

用 openai 官方 SDK,把 base_url 改成本地网关地址就行:

from openai import OpenAI

client = OpenAI(

api_key="your-api-key-here", # 填你在 CC Switch 里配的 Key

base_url="<http://127.0.0.1:18789/v1>"

)

response = client.chat.completions.create(

model="claude-opus-4-6",

messages=[{"role": "user", "content": "你好"}]

)

print(response.choices[0].message.content)

运行后如果终端输出了 AI 的回复,说明整条链路通了:

你的代码 → 本地 OpenClaw → CC Switch → 88API → Claude

到这里最难的部分已经过了。后面想换渠道,去 CC Switch 里点一下「设为默认」就行,代码不用动。

现在你的 AI 接口调用已经走本地网关了。去打开一个项目,把之前直连 API 的 base_url 改成 http://127.0.0.1:18789/v1,试试能不能正常跑。

这套配置最大的好处是接口层和业务层彻底解耦了。某个中转站挂了?在 CC Switch 里切到备用渠道,服务不中断。想试试 GPT-4o 和 Claude 哪个效果好?改一下 model 参数就行,88API 用同一个 Key 就能调这些模型。

如果配置过程中遇到端口被占用、401 认证失败之类的问题,去 OpenClaw 的控制台看请求日志,基本都能定位到是哪一步配错了。有问题留言,我帮你看看。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)