Unsloth:消费级显卡也能轻松微调大模型!让AI普惠触手可及!

摘要: Unsloth是一个开源框架,旨在降低大语言模型(LLM)微调的门槛,解决显存占用高、训练速度慢、流程复杂等问题。通过优化Triton内核和手动反向传播,它在消费级GPU(如RTX 3060)上实现高效微调,支持500+模型,包括Llama、Qwen等,并提供可视化Web UI和强化学习支持。核心优势包括零精度损失、显存节省35%、训练速度提升12倍,并覆盖从数据准备到模型部署的全流程。适

痛点:微调大模型为什么这么难?

大语言模型(LLM)微调,听起来是件很美好的事——把通用模型调成自己领域的专家,无论是法律文书分析、客服对话还是代码生成,都可以针对性优化。

然而现实却给大多数人浇了一盆冷水:

- • 显存要求极高:一个 7B 参数的模型全量微调,动辄需要 40GB+ 显存,消费级显卡根本跑不动

- • 训练速度慢:即便用上 LoRA 等量化方案,在 HuggingFace 原生框架下训练一轮也要等很久

- • 流程门槛高:从数据准备、模型加载、训练配置到模型导出,每一步都可能踩坑

- • 硬件要求劝退:大多数教程默认你有一台 A100,普通 RTX 3060 用户看了只能叹气

这些问题,把本来应该人人可用的技术,关在了少数人才能进入的门槛背后。

它是什么?

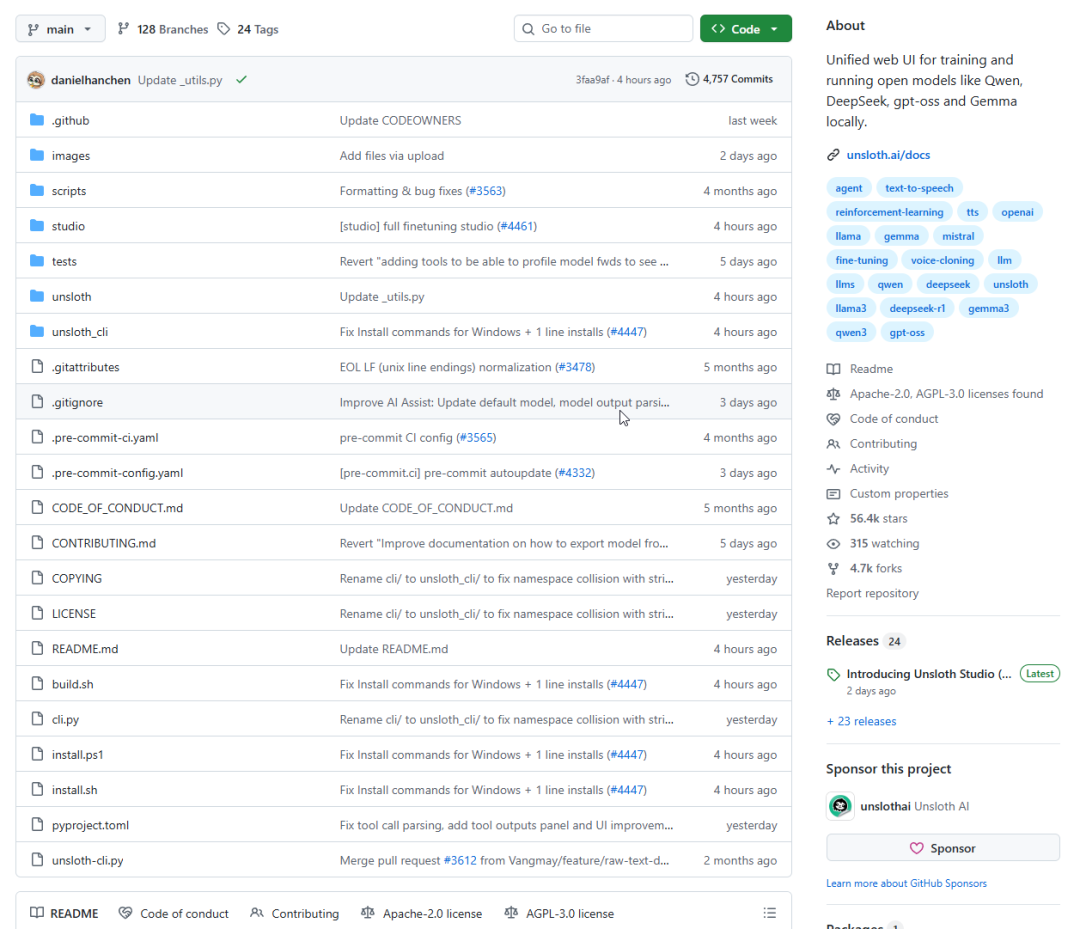

Unsloth 是一个专为 LLM 微调和本地推理优化设计的开源框架,由 Daniel Han 和 Michael Han 兄弟创立,2023 年发布,目前 GitHub 已累计近 5 万 Star。

它的核心使命只有一句话:让每个人都能在自己的硬件上跑起来大模型微调。

所有计算内核使用 OpenAI 的 Triton 语言编写,并配备了手动反向传播引擎,在零精度损失的前提下(无近似计算,完全精确)实现加速,无需更换硬件。

关键数据:

- • 训练 MoE(混合专家)架构 LLM 速度提升最高 12 倍,显存降低 35%

- • 支持 4bit 和 16bit QLoRA / LoRA 微调,兼容 bitsandbytes

- • 支持 NVIDIA 2018 年以来的 GPU,最低 CUDA Capability 7.0(RTX 20/30/40 系、V100、T4、A100、H100 等均可)

- • 支持 Qwen、DeepSeek、Gemma、Llama、Mistral、Phi 等 500+ 模型

除了微调,Unsloth 还支持将微调好的模型导出为 safetensors 或 GGUF 格式,可直接用于 llama.cpp、vLLM、Ollama 等推理框架,形成完整的训练到部署闭环。

核心功能一览

1. 极速 LoRA / QLoRA 微调

这是 Unsloth 最核心的能力。通过自定义 Triton 内核和手写反向传播,在不牺牲精度的前提下大幅压缩显存占用、加快训练速度。

以 RTX 3060(12GB 显存)为例,在 HuggingFace 原生框架下根本无法启动的 Llama-3.1-8B 微调任务,通过 Unsloth 的 4bit QLoRA 可以顺利运行。

2. 强化学习(RL)支持

Unsloth 支持长上下文推理的 GRPO 强化学习训练,仅需 5GB 显存即可复现 DeepSeek-R1 的"顿悟时刻",将 Llama、Phi、Mistral 等模型转化为具备推理能力的模型。这对于想研究 o1-style 推理增强的开发者来说是个非常低门槛的入口。

3. Unsloth Studio(可视化 Web UI)

Unsloth 推出了统一的 Web UI,支持在本地运行和训练 Qwen、DeepSeek、gpt-oss、Gemma 等开源模型。无需写代码,通过界面操作即可完成数据集准备、模型训练和推理对比。

其中包含 Data Recipes 功能,可以通过图形化节点工作流将 PDF、CSV、JSON 等非结构化文档转换成可用于训练的数据集。

4. Dynamic GGUF 量化

Unsloth 推出了 Dynamic GGUF 2.0 版本,对不同层采用不同量化精度,在模型体积和推理质量之间找到更好的平衡点,是目前下载量最大的量化模型来源之一。

5. 多模态与多任务支持

Unsloth 支持文本、音频、Embedding、视觉和 TTS 等多种模型类型的推理和训练,覆盖范围已经远超最初的"LLM 微调工具"定位。

怎么用?

方式一:快速安装(pip)

# 安装 uv(推荐的包管理器)curl -LsSf https://astral.sh/uv/install.sh | sh# 创建虚拟环境uv venv unsloth_env --python 3.13source unsloth_env/bin/activate# 安装 unsloth(自动检测 torch 后端)uv pip install unsloth --torch-backend=auto

方式二:启动 Unsloth Studio(Web UI)

# 安装后启动 Studiounsloth studio setupunsloth studio -H 0.0.0.0 -p 8888

然后浏览器访问 http://localhost:8888 即可进入可视化界面。

方式三:Docker 一键启动

docker run -d \ -e JUPYTER_PASSWORD="mypassword" \ -p 8888:8888 -p 8000:8000 -p 2222:22 \ -v $(pwd)/work:/workspace/work \ --gpus all \ unsloth/unsloth

方式四:用代码微调(最灵活)

以下是一个用 Unsloth 微调 Llama-3.1-8B 的最简示例:

from unsloth import FastLanguageModelimport torch# 加载模型(4bit 量化,节省显存)model, tokenizer = FastLanguageModel.from_pretrained( model_name="unsloth/Meta-Llama-3.1-8B-Instruct-bnb-4bit", max_seq_length=2048, load_in_4bit=True,)# 添加 LoRA 适配器model = FastLanguageModel.get_peft_model( model, r=16, # LoRA rank target_modules=["q_proj", "k_proj", "v_proj", "o_proj", "gate_proj", "up_proj", "down_proj"], lora_alpha=16, lora_dropout=0, bias="none",)# 后续接 TRL 的 SFTTrainer 进行训练...

训练完成后可以一行导出 GGUF,直接给 Ollama 使用:

model.save_pretrained_gguf("my_model", tokenizer, quantization_method="q4_k_m")

免费 Notebook(无需本地 GPU)

Unsloth 提供免费的 Google Colab 和 Kaggle Notebook,在单张 NVIDIA GPU 上实现 2 倍以上的微调提速,完全免费。如果暂时没有本地显卡,直接上 Colab 跑官方 Notebook 是最快的入门方式,官方提供超过 250 个覆盖不同模型和任务的 Notebook 模板。

支持的主流模型

| 系列 | 代表模型 |

|---|---|

| Meta Llama | Llama 3.1 / 3.2 / 3.3 / 4 |

| 阿里 Qwen | Qwen2.5 / Qwen3 / Qwen3-Coder |

| DeepSeek | DeepSeek-R1 / DeepSeek-V3 / DeepSeek-OCR |

| Gemma 2 / 3 | |

| Microsoft | Phi-4 / BitNet |

| Mistral AI | Mistral / Mistral Small |

| OpenAI | gpt-oss(开源版) |

| 月之暗面 | Kimi K2 / K2.5 |

总结

Unsloth 解决的是一个关键的普惠化问题:把原本只有大机构才能负担得起的 LLM 微调能力,带到消费级 GPU 面前。

它的核心价值在于三点:

-

- 极致的效率:通过底层 Triton 内核重写,训练速度和显存占用的改善是系统性的,不是调参出来的

-

- 零精度损失:与部分加速方案采用近似计算不同,Unsloth 保证训练结果与原始完全一致

-

- 完整的工具链:从数据集制作、模型训练、RL 强化,到量化导出、本地部署,一套框架全覆盖

对于手头有一张消费级显卡(RTX 3060 及以上)、想在垂直领域微调开源模型的开发者来说,Unsloth 目前是最值得首先尝试的框架。

2026年AI行业最大的机会,毫无疑问就在应用层!

字节跳动已有7个团队全速布局Agent

大模型岗位暴增69%,年薪破百万!

腾讯、京东、百度开放招聘技术岗,80%与AI相关……

如今,超过60%的企业都在推进AI产品落地,而真正能交付项目的 大模型应用开发工程师 **,**却极度稀缺!

落地AI应用绝对不是写几个prompt,调几个API就能搞定的,企业真正需要的,是能搞定这三项核心能力的人:

✅RAG:融入外部信息,修正模型输出,给模型装靠谱大脑

✅Agent智能体:让AI自主干活,通过工具调用(Tools)环境交互,多步推理完成复杂任务。比如做智能客服等等……

✅微调:针对特定任务优化,让模型适配业务

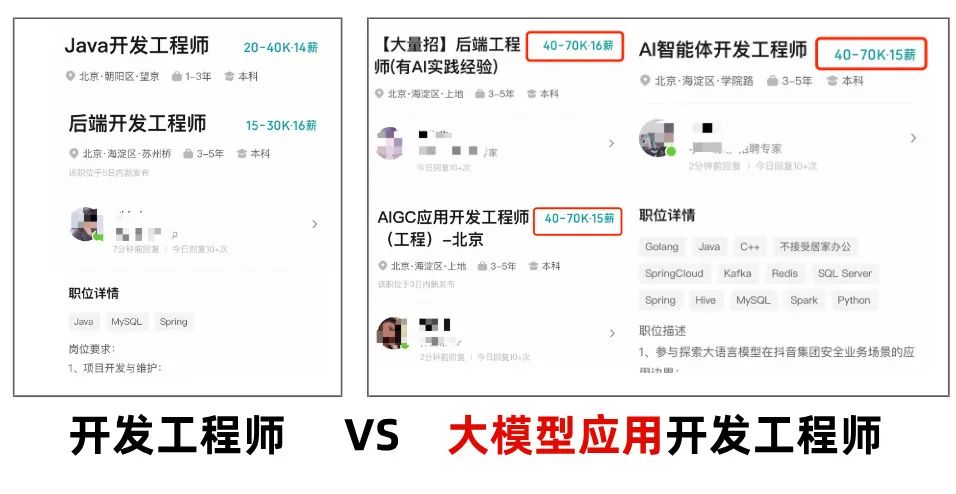

目前,脉脉上有超过1000家企业发布大模型相关岗位,人工智能岗平均月薪7.8w!实习生日薪高达4000!远超其他行业收入水平!

技术的稀缺性,才是你「值钱」的关键!

具备AI能力的程序员,比传统开发高出不止一截!有的人早就转行AI方向,拿到百万年薪!👇🏻👇🏻

AI浪潮,正在重构程序员的核心竞争力!现在入场,仍是最佳时机!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

⭐️从大模型微调到AI Agent智能体搭建

剖析AI技术的应用场景,用实战经验落地AI技术。从GPT到最火的开源模型,让你从容面对AI技术革新!

大模型微调

-

掌握主流大模型(如DeepSeek、Qwen等)的微调技术,针对特定场景优化模型性能。

-

学习如何利用领域数据(如制造、医药、金融等)进行模型定制,提升任务准确性和效率。

RAG应用开发

- 深入理解检索增强生成(Retrieval-Augmented Generation, RAG)技术,构建高效的知识检索与生成系统。

- 应用于垂类场景(如法律文档分析、医疗诊断辅助、金融报告生成等),实现精准信息提取与内容生成。

AI Agent智能体搭建

- 学习如何设计和开发AI Agent,实现多任务协同、自主决策和复杂问题解决。

- 构建垂类场景下的智能助手(如制造业中的设备故障诊断Agent、金融领域的投资分析Agent等)。

如果你也有以下诉求:

快速链接产品/业务团队,参与前沿项目

构建技术壁垒,从竞争者中脱颖而出

避开35岁裁员危险期,顺利拿下高薪岗

迭代技术水平,延长未来20年的新职业发展!

……

那这节课你一定要来听!

因为,留给普通程序员的时间真的不多了!

立即扫码,即可免费预约

「AI技术原理 + 实战应用 + 职业发展」

「大模型应用开发实战公开课」

👇👇

👍🏻还有靠谱的内推机会+直聘权益!!

完课后赠送:大模型应用案例集、AI商业落地白皮书

更多推荐

已为社区贡献698条内容

已为社区贡献698条内容

所有评论(0)