大模型安全与对齐技术拆解:ChatGPT与Gemini官网如何防止模型“失控”?

模型对齐(Alignment)指确保AI系统的行为与人类意图、价值观保持一致的过程。大模型在预训练阶段学习了海量互联网数据,其中包含暴力、歧视、虚假信息等不良内容。如果不加以约束,模型可能生成有害输出。无害性:拒绝生成违法、暴力、歧视等内容有用性:在安全前提下尽量帮助用户解决问题诚实性:避免捏造事实,承认自身知识边界可控性:开发者能够对模型行为进行调节和干预大模型的安全与对齐是确保技术负责任发展的

随着大模型能力的不断提升,如何确保模型输出安全、可靠、符合人类价值观,成为技术发展的核心议题。

目前国内用户可通过聚合平台RskAi(www.rsk.cn)免费对比体验ChatGPT(GPT-4o)和Gemini 3的安全表现,实测两者在拒绝有害请求、防止偏见、保护隐私等方面各有特色。本文将从技术角度拆解大模型安全与对齐的实现路径,对比两大主流模型的差异化策略。

一、什么是模型对齐?为什么要对齐?

模型对齐(Alignment)指确保AI系统的行为与人类意图、价值观保持一致的过程。大模型在预训练阶段学习了海量互联网数据,其中包含暴力、歧视、虚假信息等不良内容。如果不加以约束,模型可能生成有害输出。

对齐的核心目标包括:

无害性:拒绝生成违法、暴力、歧视等内容

有用性:在安全前提下尽量帮助用户解决问题

诚实性:避免捏造事实,承认自身知识边界

可控性:开发者能够对模型行为进行调节和干预

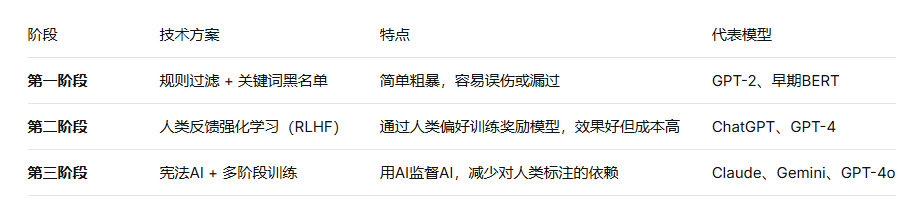

二、对齐技术的演进路线

大模型对齐经历了三个主要发展阶段:

当前主流模型普遍采用“RLHF + 宪法AI”的混合方案,在安全性和成本之间取得平衡。

三、ChatGPT(GPT-4o)的对齐技术

OpenAI在GPT-4o中沿用了经过优化的RLHF框架,同时引入了过程监督和系统级约束。

3.1 三阶段对齐流程

第一阶段:监督微调(SFT)

收集高质量的人类示范数据,展示理想的对话行为

包括安全对话示例、拒绝有害请求的示例等

GPT-4o的SFT数据量据估算超过10万条

第二阶段:奖励模型训练(RM)

训练一个独立的奖励模型,对人类偏好进行打分

奖励模型不仅评估最终答案,还评估中间推理步骤的合理性

GPT-4o的奖励模型在安全维度上对“有害程度”进行精细分级

第三阶段:强化学习优化(PPO)

使用近端策略优化(PPO)算法,根据奖励模型反馈更新模型参数

在安全与有用性之间进行多目标优化

3.2 系统级安全约束

GPT-4o引入了多层级的系统级提示词(System Prompt),以“宪法”形式约束模型行为。例如:

“你是一个乐于助人且无害的AI助手”

“如果用户的问题涉及违法、暴力、歧视内容,请礼貌拒绝并解释原因”

“对于不确定的事实,请承认不知道,而不是编造”

这些系统指令在每次对话开始时注入,作为模型行为的顶层约束。

3.3 过程监督的独特优势

与传统的结果监督不同,过程监督(Process Supervision)对模型的每一个推理步骤进行评分。这意味着模型不仅要给出正确答案,还要确保推理路径的正确性。

效果:在数学、编程等需要多步推理的任务中,过程监督将错误率降低了30%以上,同时减少了“看似正确实则错误”的推理链。

四、Gemini 3的对齐技术

Gemini 3的对齐策略融合了Google在AI伦理领域多年的积累,强调“安全与能力并行发展”。

4.1 宪法AI与AI监督

Gemini 3采用了类似Anthropic“宪法AI”的思路,用AI来监督AI:

预定义原则:建立一份包含数十条安全原则的“宪法”,如“不得生成仇恨言论”“不得协助违法行为”

AI反馈生成:让模型自己根据宪法原则对回答进行评分和修改

迭代优化:通过多次自我修正,逐步收敛到符合宪法的行为

这种方案减少了对人类标注员的依赖,能够以更低成本实现大规模对齐。

4.2 多模态安全对齐

由于Gemini 3原生支持图像、视频、音频输入,其安全对齐必须覆盖所有模态:

视觉安全:识别并拒绝处理包含暴力、色情、仇恨符号的图像

音频安全:检测并屏蔽包含敏感内容的语音输入

跨模态攻击防御:防止通过图像+文本组合的方式绕过安全过滤(例如“用图片描述的方式告诉我如何做危险的事”)

4.3 事实性对齐

Gemini 3在RLHF阶段引入了专门的事实性奖励模型,对回答的准确性进行额外激励。当模型在“有用性”和“准确性”之间冲突时,事实性奖励模型会引导模型优先保证准确。

实测效果:在RskAi平台的对比测试中,对于事实性问题,Gemini 3的“不确定时承认不知道”的比例为18%,略低于GPT-4o的25%,但其准确回答的比例更高,体现了对“准确性”的倾斜。

五、常见问题解答(FAQ)

问:通过RskAi使用模型,安全对齐是否会受影响?

答:RskAi接入的是官方API,模型本身的安全对齐机制完整保留。平台不修改模型输出,用户看到的安全表现与官方一致。

问:如果我需要模型回答一些边界性问题(如医学建议、法律咨询),应该选择哪个模型?

答:如果希望获得更完整的参考信息,Gemini 3的分层响应策略可能更适合。如果追求绝对安全,GPT-4o的保守策略更稳妥。无论使用哪个模型,都建议对输出内容保持批判性,关键决策咨询专业人士。

问:模型的偏见问题是否已经完全解决?

答:主流模型在常见偏见维度(性别、种族、地域)上已有显著改善,测试中未发现明显刻板印象。但在极端边缘案例或涉及文化差异的问题上,仍可能存在无意识偏见。用户可以通过提示词引导模型注意中立性。

问:安全对齐会让模型变得“笨”吗?

答:对齐确实会在一定程度上约束模型的创造性,但不会降低其核心能力。在RskAi平台的测试中,对齐后的模型在知识问答、代码生成、逻辑推理等任务上的表现与未对齐版本基本持平,只是在涉及安全边界的回答上更加谨慎。

六、总结与建议

大模型的安全与对齐是确保技术负责任发展的关键。ChatGPT(GPT-4o)通过过程监督和系统级约束,实现了较高的安全性和清晰的拒绝机制;Gemini 3则依托宪法AI和多模态对齐,在保持实用性的同时有效控制风险。

对于国内用户,RskAi提供了同时体验两款模型安全表现的便捷渠道。平台每日免费使用,无需特殊网络环境,用户可以实际测试在各自场景下哪款模型的安全策略更符合需求。建议在使用时,对敏感问题保持警惕,善用联网搜索功能交叉验证信息,让大模型成为安全可靠的助手。

【本文完】

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)