GPUStack支持哪些具体AI大模型部署

GPUStack是一款开源GPU集群管理器,支持广泛AI大模型部署。核心功能包括智能调度GPU资源、自动配置部署参数,并集成多种主流推理后端(如vLLM、llama.cpp等)。支持模型类型涵盖:大语言模型(Llama、Qwen等系列)、多模态模型(Llava、Qwen-VL等)、嵌入与重排序模型(BGE系列)、文生图模型(Stable Diffusion)、语音模型(Whisper、FunASR

GPUStack支持哪些具体AI大模型部署

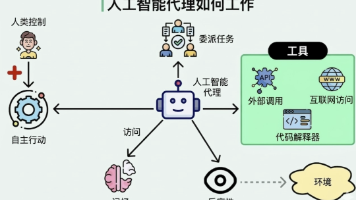

GPUStack 是一个开源的 GPU 集群管理器,专为高效的 AI 模型部署而设计。它允许您在自己的 GPU 硬件上高效运行模型,通过选择最佳推理引擎、调度 GPU 资源、分析模型架构以及自动配置部署参数来实现。

通过网盘分享的文件:麒麟kylin linux 安装CDH v7.1指南

链接:https://pan.baidu.com/s/1wbRWJUSyElplFgse_NyOwg?pwd=pgxn 提取码:pgxn

通过网盘分享的文件:Hadoop

链接: https://pan.baidu.com/s/1PDj6dySUNHotNABp7d1a0w?pwd=57is 提取码: 57is

————————————————

GPUStack 支持部署的 AI 模型种类非常广泛,几乎覆盖了当前大模型应用所需的所有核心类型。它不绑定特定的模型格式,而是通过集成多种主流推理后端(如 vLLM, llama.cpp/llama-box, SGLang, MindIE, Stable Diffusion.cpp 等),实现了对 Hugging Face 和 ModelScope (魔搭) 等仓库中绝大多数开源模型的“开箱即用”支持。

以下是 GPUStack 支持的具体模型类别及代表性模型:

1. 大语言模型 (LLM)

这是 GPUStack 最核心的支持领域,涵盖从几亿参数的小模型到千亿参数的超大模型。

- 支持架构:Transformer, MoE (混合专家模型)。

- 热门模型系列:

- Meta: Llama 3, Llama 3.1, Llama 3.2, Llama 2。

- 阿里通义: Qwen2, Qwen2.5, Qwen3 (包括 Dense 和 MoE 版本)。

- 深度求索: DeepSeek-V2, DeepSeek-V3, DeepSeek-R1 (及其蒸馏版本)。

- 智谱AI: GLM-Edge, GLM-4, ChatGLM3。

- 其他国际主流: Mistral, Mixtral, Gemma (Google), Phi-3 (Microsoft), Yi (零一万物)。

- 功能:支持文本生成、代码补全、多轮对话、长上下文处理(Long Context)。

2. 多模态模型 (VLM - Vision Language Models)

支持能够“看懂”图片并进行对话的模型。

- 热门模型系列:

- Llava / Llava-Next: 经典的多模态模型。

- Qwen-VL: 阿里通义千问视觉版。

- Yi-VL: 零一万物视觉版。

- InternVL: 商汤科技开源的多模态模型。

- 功能:图像描述、视觉问答 (VQA)、图表分析。

3. 嵌入与重排序模型 (Embedding & Rerank)

专为 RAG (检索增强生成) 系统设计,用于构建企业知识库。

- Embedding 模型:

- BGE 系列 (BAAI): bge-large-zh, bge-m3 等(中文效果极佳)。

- M3E 系列: 通用中文嵌入模型。

- Text-Embedding-3: OpenAI 兼容的开源替代方案。

- Rerank 模型:

- BGE-Reranker: 对检索结果进行二次排序,提高准确度。

- ColBERT: 高效的延迟交互模型。

- 用途:将文档向量化存入数据库,并在检索时提供高精度的相关性排序。

4. 文生图模型 (Image Generation / Diffusion)

支持生成图像的扩散模型。

- 热门模型系列:

- Stable Diffusion: SD 1.5, SDXL, SD 3。

- Flux: 最新的高画质开源模型 (Flux.1 Dev/Schnell)。

- Playground AI: 各类变体。

- 功能:文生图 (Text-to-Image)、图生图 (Image-to-Image)。GPUStack 通过集成 stable-diffusion.cpp 或相关后端实现高效推理。

5. 语音模型 (Speech Models)

支持语音交互的全链路模型。

- 语音转文字 (STT / ASR):

- Whisper: OpenAI 开源的多语言识别模型 (Tiny, Base, Small, Medium, Large-v3)。

- FunASR: 阿里达摩院开源的高性能语音识别模型。

- 文字转语音 (TTS):

- CosyVoice: 阿里通义实验室开源的高自然度语音合成模型。

- F5-TTS: 新兴的高质量零样本 TTS 模型。

- XTTS: Coqui 开源的多语言 TTS。

6. OCR 模型 (光学字符识别)

- 支持用于提取图片中文字的专用模型,常作为多模态应用的补充组件(如 PaddleOCR 的某些导出格式或专门的 Transformer OCR 模型)。

关键特性:如何支持这么多模型?

- 格式兼容性极强:

- GGUF: 完美支持 llama.cpp 生态,适合在 CPU、Mac 或显存较小的显卡上运行量化模型。

- Safetensors / PyTorch: 直接加载 Hugging Face 原始格式,配合 vLLM 或 SGLang 实现高性能推理。

- ONNX: 部分模型支持 ONNX 格式加速。

- 自动适配推理后端:

- GPUStack 会根据你选择的模型类型和硬件环境,智能推荐或自动配置最佳推理引擎。例如:

- 跑 Llama 3 70B?自动调用 vLLM 或 SGLang 进行多卡并行。

- 在 Mac Studio 上跑 Qwen-7B?自动调用 llama-box (Metal 加速)。

- 在华为昇腾卡上跑模型?自动调用 MindIE。

- 跑 Stable Diffusion?自动调用 stable-diffusion.cpp 或其他兼容后端。

- GPUStack 会根据你选择的模型类型和硬件环境,智能推荐或自动配置最佳推理引擎。例如:

- 一键部署:

- 用户只需在 GPUStack 的 Web 界面中输入模型名称(如 Qwen/Qwen2.5-7B-Instruct),系统会自动从 Hugging Face 或 ModelScope 下载并启动服务,无需手动编写复杂的 Docker 命令或 Python 脚本。

总结

GPUStack 几乎支持所有主流的开源 AI 模型。只要该模型存在于 Hugging Face 或 ModelScope 上,并且有对应的开源推理后端(如 llama.cpp, vLLM, diffusers 等)支持,GPUStack 通常都能通过其统一的平台进行部署和管理。这使得它成为构建全栈私有化 AI 应用(包含对话、知识库、绘图、语音交互)的理想基础设施。

更多推荐

已为社区贡献48条内容

已为社区贡献48条内容

所有评论(0)