亚马逊科学团队:告别传统分词器,让AI直接理解字节流的新突破

亚马逊科学团队:告别传统分词器,让AI直接理解字节流的新突破

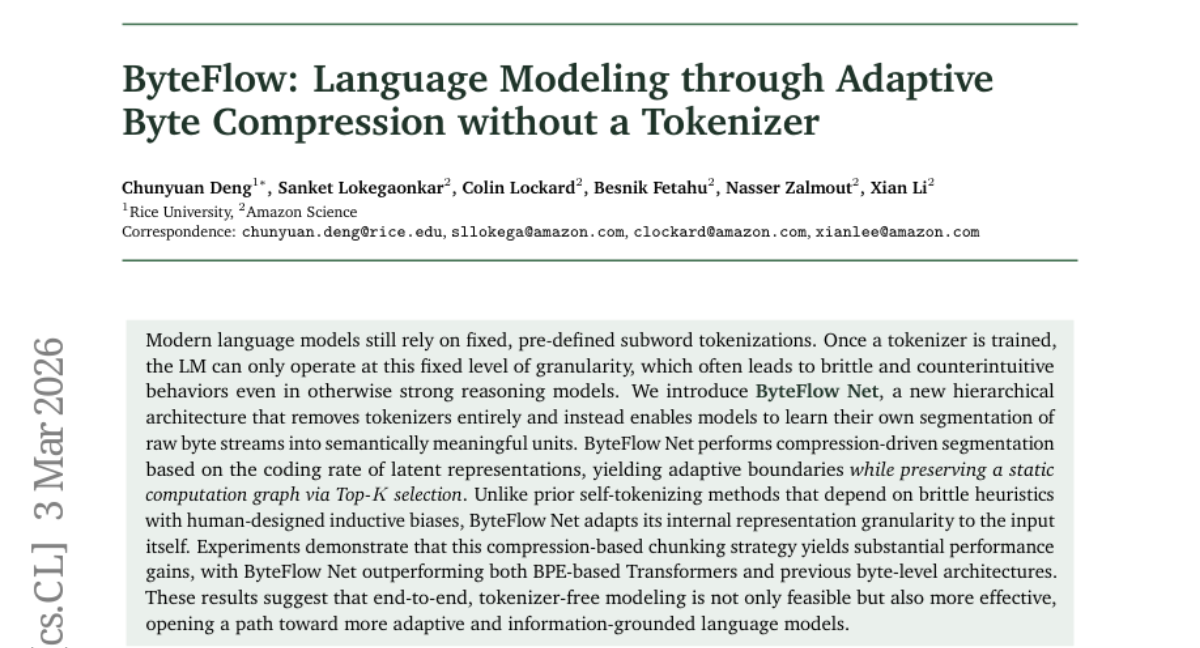

这项由亚马逊科学团队与莱斯大学合作完成的研究发表于2026年3月,论文编号为arXiv:2603.03583v1。这项研究提出了一种全新的语言模型架构ByteFlow Net,能够直接处理原始字节流而无需传统的分词器,为AI语言理解开辟了崭新道路。

ByteFlow Net就像一位不需要词典的天才读者。传统的AI语言模型工作时,首先需要一个叫做分词器的工具,将连续的文字切分成一个个词汇单元,就像厨师在烹饪前需要把食材切成合适的块状。然而这种预先切割的方式存在一个根本性问题:无论食材的实际特性如何,都必须按照固定的尺寸标准进行切割,这往往会破坏食材的天然结构和营养价值。

传统分词器面临的困境就像用统一规格的模具制作不同类型的点心。无论是制作精细的马卡龙还是朴实的饼干,都必须使用相同的模具尺寸,结果可想而知。这种刚性的处理方式导致AI在面对计数、算术、结构化数据和多语言文本时经常出现令人困惑的错误行为。更重要的是,分词器作为一个不可学习的固定环节,就像在整个烹饪流程中插入了一个无法调节的预处理步骤,阻断了从原料到成品的端到端优化。

研究团队意识到这个问题的核心在于:为什么要强制AI按照人为设定的固定规律来理解语言?能否让AI自己学会如何最佳地分割和理解文本内容?就像让一位经验丰富的大厨根据每种食材的特性来决定最合适的切割方式,而不是机械地遵循标准化的切割规程。

ByteFlow Net正是在这种思考下诞生的。它采用了一种分层架构,就像一个智能的食品加工系统。首先,本地编码器快速处理每个字节,为每个原始信息单元建立基础的理解表示。接着,一个基于编码率的分块模块会实时评估每个位置的信息价值,决定哪些位置应该被提升到更高层次的处理。这个过程就像智能筛选器,能够识别出信息密度最高的关键节点。

这种基于信息论的分块策略特别巧妙。它将边界选择转化为一个在线的信息理论优化问题,通过计算潜在表示的编码率来估计将某个位置提升到更高层次的表示成本。编码率高的位置包含更多信息,应该被保留作为分块边界,而编码率低的位置则可以安全地被压缩掉。这种方法让模型能够根据输入内容的复杂性动态调整分词粒度,实现真正的自适应处理。

一、突破传统束缚的全新设计理念

ByteFlow Net的设计哲学可以用一个生动的比喻来理解:传统的语言模型就像按照标准菜谱做菜的机器人,无论面对什么食材都严格按照预设的切割尺寸和烹饪时间执行。而ByteFlow Net则像一位灵活的大厨,能够根据每种食材的具体特性和当前的烹饪需求,实时调整处理策略。

在技术层面,ByteFlow Net包含五个主要处理阶段,它们像流水线上的智能工作站一样协同运作。首先是本地编码器,它负责对原始字节序列进行快速的上下文化处理。这个阶段就像食品加工的初步清洗和分类,为每个字节建立基本的语义表示。编码器采用滑动窗口注意力机制,显著降低了计算复杂度,同时配合Canon层来增强不同位置之间的信息交互。

Canon层是一个特别有趣的创新。它本质上是一个因果卷积层,核心大小为4,能够高效地实现token混合。可以把它想象成一个智能的信息传递网络,让相邻位置的信息能够自然地相互影响和融合。相比传统的注意力机制,Canon层提供了一种更轻量级但同样有效的信息整合方式。

接下来是下采样阶段,这是ByteFlow Net最核心的创新所在。系统会计算每个位置的边际编码率,这个数值反映了包含该位置能够带来多少额外的信息增益。就像品酒师能够敏锐地察觉出每一滴酒液的独特贡献一样,ByteFlow Net能够精确评估每个字节位置的信息价值。系统会选择信息增益最高的K个位置,将它们提升到全局变换器进行深度处理。

全局变换器是整个系统的大脑中枢。由于经过了有效的压缩,它可以使用深度和宽度都很大的结构,专门处理高层次的语义理解和推理任务。这种设计就像将最宝贵的计算资源集中投入到最关键的认知任务上,而不是浪费在重复性的基础处理中。

最后的上采样和解码阶段负责将高层次的理解结果重新映射回原始字节序列的长度,并生成最终的预测结果。整个流程形成了一个优雅的信息压缩、处理和重建循环,每个环节都经过精心设计以最大化效率和效果。

二、信息论指导的智能分块策略

ByteFlow Net的分块策略基于一个深刻的信息论洞察:最佳的分词边界应该是信息密度发生显著变化的位置。这种思路就像地质学家通过岩层密度的变化来识别不同地质年代的分界线一样自然而精确。

具体来说,系统使用有损编码率来量化表示序列的信息内容。对于本地编码器产生的上下文化表示h?:T,有损编码率的计算公式为:R_ε(h?:T) = 1/2 log det(I + d_local/ε? h?:T h?:T^T)。这个公式看起来复杂,但其核心思想很直观:当表示矩阵具有较大的特征值并且在表示空间中跨越多个方向时,编码率就会很大,说明这个位置包含丰富的信息,值得保留。

边际编码率ΔR_t = R_ε(h?:t) - R_ε(h?:t-1)衡量的是包含第t个字节所带来的信息增益。这就像评估在一道菜中加入某种调料会带来多大的味觉提升一样。当某个位置的边际编码率很高时,说明该位置引入了大量新信息,很可能是一个自然的语义边界。

这种方法相比其他动态分块策略具有明显优势。传统的基于熵值或余弦相似度的方法往往依赖于局部特征,容易受到噪声干扰。而编码率方法考虑的是整个序列的全局信息结构,能够更准确地识别出真正重要的语义转折点。

为了保持计算图的静态性质,ByteFlow Net使用Top-K选择策略,始终选择边际编码率最高的K个位置。这种设计巧妙地平衡了动态适应性和计算效率。在教师强制训练过程中,系统使用完整序列的重要性分布来分配全局计算资源,但因果掩码确保预测时不会访问未来的字节内容。

研究团队还提供了一个实用的L2范数近似方法,用于需要快速局部决策的流式应用。这个近似将复杂的行列式计算简化为简单的范数计算,在保持良好性能的同时大大提高了计算效率。

三、架构设计的精妙平衡

ByteFlow Net的架构设计体现了一种精妙的计算资源分配哲学。整个系统就像一个高效的工厂,将大部分高端设备和熟练工人分配给最关键的生产环节,而将标准化的基础工作交给轻量级的自动化设备处理。

在本地编码器部分,系统采用相对较浅较窄的结构,专门负责字节级别的快速处理。由于字节序列通常比传统token序列长约4倍,直接应用全注意力机制在计算上是不可行的。因此,系统采用滑动窗口注意力,将复杂度从O(T?)降低到O(T·w_local),其中w_local是窗口大小。

滑动窗口注意力虽然限制了远程依赖的直接建模,但这个限制通过Canon层得到了有效缓解。Canon层执行因果卷积操作:Canon(h_t) = w?⊙h_t + w?⊙h_{t-1} + w?⊙h_{t-2} + w?⊙h_{t-3},其中w_i是学习到的门控向量。这种设计让信息能够在相邻位置之间高效传播,弥补了滑动窗口的局限性。

理论上,如果仅使用滑动窗口注意力,要让序列中每个位置都能关注到其他所有位置,需要至少T/w_local层编码器。对于长序列,这会导致过深的本地编码器,增加计算成本并可能影响训练稳定性。Canon层作为高效的补充,引入的参数开销微不足道,却能显著改善信息流动。

上采样模块采用了一种巧妙的位置特定重建策略。系统首先确定每个位置属于哪个全局表示的影响范围,然后使用分仓机制共享上采样参数。具体来说,chunk(t) = argmax_i{s_i : s_i ≤ t}确定影响关系,bin(t) = ?t/(T/B)?确定参数分仓,然后执行重建:s_t = g_{chunk(t)}W_{bin(t)}。最终输出s_t = h_t + s_t包含了本地表示和全局上下文信息的融合。

四、实验验证的全面成功

为了验证ByteFlow Net的有效性,研究团队进行了大规模的实验比较。所有模型都在FineWeb-Edu-100B数据集上从零开始训练,这个数据集包含约5000亿字节的教育内容。实验采用标准的学术规模设置,在GPT-3 Large级别进行消融实验,在GPT-3 XL规模进行扩展实验。

实验结果令人印象深刻。在600M参数规模下,ByteFlow Net在训练约250亿字节后开始超越LLaMA基线,并在500亿字节的完整训练过程中保持领先优势。更引人注目的是1.3B参数规模的结果,ByteFlow Net展现出最佳的扩展轨迹,暗示着这种方法在更大规模下可能具有更明显的优势。

在下游任务评估中,ByteFlow Net同样表现出色。在600M规模下,它达到了50.89%的平均准确率,超过LLaMA的49.15%,提升了1.74个百分点。在1.3B规模下,这个优势进一步扩大到3.04个百分点,平均准确率达到63.19%,远超LLaMA的60.15%。这种随规模增长而扩大的性能差距表明,ByteFlow Net的优势可能在更大规模下变得更加显著。

特别值得关注的是字符级别的性能表现。在CUTE基准测试中,尽管训练数据比Llama 3变体少20-32倍,ByteFlow Net 1.3B在多个字符级任务上都显著超越了这些大规模模型。例如,在拼写逆序任务中,ByteFlow Net达到了95.1%的准确率,接近完美表现,而Llama 3和Llama 3.1分别只有30.1%和3.6%的准确率。这种卓越的正字法能力证明了架构设计能够在某种程度上补偿规模上的劣势。

五、深入的消融分析揭示关键因素

为了理解ByteFlow Net成功的根本原因,研究团队进行了详尽的消融研究。这些分析就像解剖一台精密机器,要弄清楚每个零件对整体性能的确切贡献。

关于分块策略的比较特别有启发性。研究团队在相同的ByteFlow Net架构下测试了七种不同的分块方法,包括固定步长、词边界、随机分块、神经边界、熵分块、余弦相似度分块,以及他们提出的有损编码率分块。

结果显示,随机分块完全是一场灾难,任务准确率只有41.34%,证明了分层架构本身并不神奇,分割必须是有意义的。令人惊讶的是,简单的词边界分块表现相当不错,几乎匹配了标准LLaMA基线的下游任务性能(49.38% vs 49.15%)。这个强有力的发现表明,基于语言学的分割有时比复杂的动态分块方法更有效。

其他动态方法,如基于神经预测或余弦相似度的方法虽然显示出潜力,但很难稳定地超越简单的词边界基线。这突出了一个关键挑战:在运行中学习有意义的边界是困难的。ByteFlow Net的编码率方法通过将决策框架化为压缩问题,在所有竞争者中表现最佳,验证BPB损失达到0.86,平均任务准确率50.89%,显著超越了其他策略。

编码率方法成功的原因在于两个方面:几何结构保持和动态FLOPs分配。如研究团队的可视化分析所示,糟糕的分块策略如随机选择会有效地粉碎数据在表示空间中的底层结构,让模型从支离破碎的混乱中学习。相比之下,编码率方法擅长保持连贯的潜在流形,让全局变换器更容易识别模式。

编码率准则本质上是一个重要性检测器。通过只提升具有高信息增益的字节到全局级别,模型被迫将珍贵的计算预算花在序列中真正重要的部分。它学会将深度、宽广的全局变换器聚焦于重要事件的压缩流,而不是在冗余或可预测的字节模式上浪费资源。

Canon层的消融研究揭示了它在分层架构中的关键作用。在600M参数规模下,移除Canon层导致平均准确率下降1.85个百分点(50.89% → 49.04%),在推理密集型任务如ARC-c上的性能下降尤其明显(28.36% → 26.73%)。在1.3B规模下,这个性能差距进一步扩大到2.13个百分点(63.19% → 61.06%)。

这种依赖规模的性能下降揭示了一个重要的架构洞察:随着模型变大并处理更长的序列,Canon层在促进信息流动方面的作用变得越来越关键。该层通过其因果卷积机制高效传播跨位置信息的能力,对于在分层架构中维持连贯表示似乎特别有价值。

六、训练效率与实际应用价值

除了性能优势,ByteFlow Net还展现出良好的训练效率。在8×A100-80GB的配置下进行的效率对比显示,ByteFlow Net在匹配FLOPs预算的前提下,训练速度达到7.9×10?词/秒,虽然略低于LLaMA的9.3×10?词/秒,但考虑到它需要处理更长的字节序列,这个效率水平是可以接受的。更重要的是,它在验证BPB指标上达到了0.86,显著优于所有对比方法。

ByteFlow Net的实际应用潜力巨大。首先,它彻底消除了对预训练分词器的需求,这意味着可以直接应用于任何语言和领域,无需额外的词汇表构建过程。这种通用性对于处理多语言文本、代码、结构化数据等多样化内容特别有价值。

其次,动态分块能力使得模型能够根据内容复杂性自适应调整处理粒度。对于信息密度高的复杂文本,系统会自动使用更细粒度的分析,而对于相对简单的内容,则可以采用更高效的粗粒度处理。这种自适应性是传统固定分词器无法实现的。

从计算资源分配的角度,ByteFlow Net的分层设计理念也具有重要的启发意义。通过将计算密集的全局变换器专门用于处理信息密度高的关键位置,而将大量的常规处理交给轻量级的本地编码器,整个系统实现了更高效的资源利用。

七、未来发展的广阔前景

ByteFlow Net的成功不仅在于解决了分词器的固有局限,更重要的是它开辟了一条全新的研究道路。这种端到端的、基于信息论的语言建模范式为未来的发展提供了丰富的可能性。

从理论角度,基于编码率的分块策略可以进一步扩展到更复杂的信息度量方法。例如,可以考虑互信息、条件熵等更精细的信息理论量,或者结合语言学知识设计更适合特定语言特性的分块准则。

在架构层面,分层处理的理念可以扩展到更多层次,构建真正的多尺度语言理解系统。也可以探索不同层次之间更复杂的信息交互机制,而不仅仅是简单的上采样和下采样。

对于实际应用,ByteFlow Net的无分词器特性使其特别适合处理混合模态内容,如包含文本、代码、数学公式的复杂文档。这种统一的字节级处理能力为构建真正通用的语言理解系统奠定了基础。

从扩展性角度,初步结果表明ByteFlow Net的优势随着模型规模增长而扩大,这暗示在更大规模下可能会有更显著的突破。这为未来的大规模语言模型研究提供了一个有前景的新方向。

说到底,ByteFlow Net代表的不仅仅是一种新的架构设计,更是一种全新的语言建模哲学。它告诉我们,与其强迫AI适应人为设定的固定规则,不如让AI自己学会如何最优地理解和处理语言。这种从固定规则到自适应学习的转变,可能会深刻影响整个自然语言处理领域的发展方向。对于普通用户而言,这意味着未来的AI助手将能够更自然、更准确地理解各种形式的文本内容,无论是日常对话、专业文档还是多语言材料,都能得到更好的处理和回应。

Q&A

Q1:ByteFlow Net相比传统分词器有什么优势?

A:ByteFlow Net最大的优势是能够根据内容自动调整分析粒度,而不像传统分词器那样机械地按固定规则切分文本。它就像一位经验丰富的大厨,会根据每种食材的特性来决定最合适的处理方式,而不是无论什么食材都用同一种切法。这种灵活性让AI在处理计数、算术、多语言文本时表现更好,同时彻底消除了词汇表限制,可以直接应用于任何语言和领域。

Q2:ByteFlow Net的编码率分块是如何工作的?

A:编码率分块就像智能筛选器,能够识别文本中信息密度最高的关键位置。系统会计算每个字节位置的信息价值,选择那些包含最多新信息的位置进行深度处理。这个过程类似于品酒师能敏锐察觉每一滴酒液的独特贡献,ByteFlow Net能精确评估每个字节的重要性,将计算资源集中投入到最关键的语义转折点上。

Q3:普通用户能从ByteFlow Net技术中获得什么好处?

A:对普通用户来说,ByteFlow Net意味着AI助手将能更自然准确地理解各种文本内容。无论是日常对话、专业文档还是多语言材料,都能得到更好的处理。特别是在处理包含数字、代码或特殊格式的复杂文本时,AI不再会出现传统分词器导致的奇怪错误。这就像拥有了一位真正理解语言精髓的助手,而不是只会机械执行规则的机器。

更多推荐

已为社区贡献743条内容

已为社区贡献743条内容

所有评论(0)