【Ollama】学习笔记 - P1

【Ollama】学习笔记 - P1

私有化大模型

1. 为什么要私有化大模型

1.1 企业数据隐私与安全的问题

使用公共大模型可能涉及敏感数据的泄露风险,因为公共模型在训练过程中可能接触到了来自不同来源的敏感数据。因此就有了私有大模型的市场需求,私有大模型允许企业或机构在自己的数据上训练模型,而且训练的结果只供内部或合作伙伴使用,从而确保了数据隐私和安全。

1.2 便于内部员工工作提效

1.3 大模型开发的投入

2. 私有化大模型方案

3. Ollama安装与使用

3.1 什么是Ollama

Ollama(羊驼)是一款旨在简化大型语言模型本地部署和运行过程的开源软件。它提供了一个轻量级、易于扩展的框架,让开发者能够在本地机器上轻松构建和管理LLMs(大型语言模型)。网址:https://ollama.com/

3.2 Linux系统安装Ollama

Window及Mac系统可直接从官网下载安装包进行安装,不做介绍,主要介绍Linux系统通过压缩包解压方式进行安装的过程:

- 执行

tar -xzvf ollama-linux-amd64.tgz -C /usr将软件压缩包解压至usr目录下,此时可执行ollama -v查看是否已安装。 - 添加开启自启服务:创建服务文件

vim /etc/systemd/system/ollama.service,并写入文件内容

生效服务:[Unit] Description=Ollama Service After=network-online.target [Service] ExecStart=/usr/bin/ollama serve User=root Group=root Restart=always RestartSec=3 [Install] WantedBy=default.target

启动服务:sudo systemctl daemon-reload sudo systemctl enable ollamasudo systemctl start ollama - 前往Ollama官网下载需要使用的大模型,例如

ollama run qwen2:0.5b - 开通远程访问Ollama,增加环境变量(可选)

1、在/etc/profile中增加环境变量: export OLLAMA_HOST=0.0.0.0:11434 export OLLAMA_ORIGINS=* 2、在/etc/systemd/system/ollama.service服务文件中增加服务变量 Environment="OLLAMA_HOST=0.0.0.0:11434" Environment="OLLAMA_ORIGINS=*" 3、添加完成后,生效修改后的配置 source /etc/profile systemctl daemon-reload systemctl restart ollama - 关闭防火墙(基于第四步需要操作)

systemctl stop firewalld systemctl disable firewalld - 调整Ollama模型下载地址:需要修改系统环境变量

OLLAMA_MODELS=对应地址

3.3 Ollama对话指令

3.3.1 /bye指令

退出当前控制台对话

3.3.2 /show指令

用于查看当前模型详细信息

[root@bogon ~]# ollama run qwen2:0.5b

>>> /show

Available Commands:

/show info 查看模型的基本信息

/show license 查看模型的许可信息

/show modelfile 查看模型的制作源文件Modelfile

/show parameters 查看模型的内置参数信息

/show system 查看模型的内置Sytem信息

/show template 查看模型的提示词模版

3.3.3 /? shortcuts 指令

查看在控制台中可用的快捷键

3.3.4 /set 指令

set指令主要用来设置当前对话模型的系列参数

3.3.5 /clear 指令

在命令行终端中对话是自带上下文记忆功能,如果要清除上下文功能,则使用/clear指令清除上下文内容

3.3.6 /load 指令

load可以在对话过程中随时切换大模型,例如Loading model 'deepseek-coder'

3.3.7 /save 指令

可以把当前对话模型存储成一个新的模型

3.3.8 “”" 指令

“”" 用于输入内容有换行时使用,如何多行输入结束也使用 “”"

3.4 Ollama客户端指令

3.4.1 run

下载(未下载过)并运行指定大模型,语法为:ollama run MODEL[:Version] [PROMPT] [flags],[:Version] 可以理解成版本,而版本信息常常以大模型规模来命名,可以不写,不写则模式成latest,例如:ollama run qwen2:1.5b

3.4.2 pull

仅下载,不自动运行大模型,例如:ollama pull qwen2:0.5b

3.4.3 show

不用运行大模型,查看模型的信息,与对话指令中的/show功能类似。

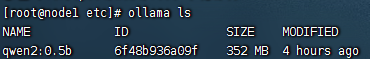

3.4.4 list(ls)

查看ollama当前的大模型列表

- NAME:名称

- ID:大模型唯一ID

- SIZE:大模型大小

- MODIFIED:本地存活时间

3.4.5 ps

查看当前运行的大模型列表,PS命令没其它参数

3.4.6 rm

删除本地大模型,RM命令没其它参数

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)