【Video Agent】(Arxiv2504)VideoExpert: Augmented LLM for Temporal-Sensitive Video Understanding

本文介绍VideoExpert,一种增强型多模态大语言模型(MLLM),用于时间敏感的视频理解任务。现有MLLM在时序定位等任务上表现不佳,主要依赖语言模式而非视觉线索生成时间戳。VideoExpert创新性地集成两个并行专家模块:Temporal Expert处理高帧率压缩特征以捕捉动态变化并实现精确事件定位;Spatial Expert专注于内容细节分析和指令跟随。通过特殊token <

【Video Agent】(Arxiv2504)VideoExpert: Augmented LLM for Temporal-Sensitive Video Understanding

写在前面:如果想了解更多关于长视频理解和视频智能体新工作,可以关注笔者的Github仓库:Awesome-Video-Agent。

论文简介 🍀

- 📖 题目:VideoExpert: Augmented LLM for Temporal-Sensitive Video Understanding

- 📅 来源:Arxiv

- 🏫 单位:无公开单位

- 🌍 主页:https://arxiv.org/pdf/2504.07519

- 💻 代码:无公开链接

- ✒️ 摘要:视频理解的核心挑战在于感知内容随时间变化的动态变化。然而,多模态大语言模型(MLLMs)在时间敏感型视频任务上表现不佳,例如视频时序定位,这类任务需要生成时间戳以标记特定事件发生的时刻。现有策略要求MLLM直接生成绝对或相对时间戳。论文观察到,这些MLLM在生成时间戳时往往更依赖语言模式而非视觉线索,从而影响其性能。为了解决这一问题,论文提出了VideoExpert,这是一种适用于多种时间敏感型视频任务的通用MLLM。受专家机制启发,VideoExpert集成了两个并行模块:Temporal Expert和Spatial Expert。Temporal Expert负责建模时间序列并执行时序定位。它处理高帧率但经过压缩的token,以捕捉视频中的动态变化,并包含一个轻量级预测头以实现精确的事件定位。Spatial Expert专注于内容细节分析和指令跟随。它处理专门设计的空间token和语言输入,旨在生成与内容相关的响应。这两个专家通过一个特殊token <LOC> 无缝协作,从而确保时序定位与内容生成的协调进行。值得注意的是,Temporal Expert和Spatial Expert保持彼此独立的参数集。这种参数解耦设计使各部分能够在互不干扰的情况下进行专门化学习。通过将时序定位从内容生成中剥离,VideoExpert避免了时间戳预测中的文本模式偏置。此外,论文还引入了一个Spatial Compress模块来获得空间token。该模块在保留关键信息的同时,对patch token进行筛选和压缩,为Spatial Expert提供紧凑但细节丰富的输入。在四个广泛使用的基准(即Charades-STA、QVHighlight、YouCookII和NextGQA)上的四项任务(时序定位、亮点检测、密集视频描述和带定位的问题回答)的大量实验表明,VideoExpert具有有效性和通用性。

一、论文阅读

1.1 引言(Introduction)

- 现有方法的不足:

- zzz

- 论文的核心思想(贡献):

- zzz

多模态大语言模型(MLLMs)通过执行字幕生成和问答等任务,为视频理解提供了一种独特的方法,使论文能够从新的视角在视觉流中解读跨越历史与文化的人类知识。然而,大多数表现最好的模型主要关注整体内容理解,缺乏识别事件之间边界和动态关系的能力。这一局限削弱了它们在时间敏感型任务中的表现,而这类任务需要精确的时刻边界来定位特定事件发生的时间,例如时序定位、亮点检测、密集视频描述以及带定位的问题回答。现有可用于时间敏感型视频任务的MLLM方法主要分为三种范式。

- 模态切换范式先通过字幕工具将视觉内容转换为文本,再由语言模型分析时间关系和内容细节。然而,由于缺乏直接的视觉感知,这种方法常常遭受上下文丢失和信息遗漏的问题。其性能也高度依赖于字幕工具的质量。

- 两阶段范式通过帧打分等技术识别相关片段,随后再应用基于图像的MLLM进行响应生成。尽管该范式有效,但由于两个阶段彼此独立运行,因此容易出现误差累积。

- 相比之下,微调范式通过在视频数据上微调LLM来获得边界感知能力。它们通过将时间戳映射为特殊token,把时序定位转换成文本生成任务。微调范式由于能够联合处理视频和文本输入、避免模态切换带来的信息损失,因此展现出更大的潜力。然而,它们在性能上仍然落后于任务专用方法。

微调范式中的性能差距主要可以归因于LLM的训练机制。作为概率生成模型,LLM在进行下一个token预测时,倾向于预测与已生成上下文相关的最“常见”模式。为说明这一点,论文将两种微调方法 TimeChat 和 VTimeLLM 的预测结果进行了可视化,如图2所示。这些方法在不同的视频—查询对上,经常预测出相似的时间范围。当视频输入是随机选取的或者缺失时,视觉线索无法为时间戳生成提供有意义的指导,这一现象会变得更加明显。由于使用了固定模板,这些模型在微调过程中可能记住了某些常见的时间范围表达,即时间token具有较高出现概率,而不是学会执行条件时间回归。因此,这些方法在生成时间戳时更多依赖于学习到的语言模式,而不是视觉线索。此外,MLLM的性能还受视觉输入质量的影响。为了模拟时间上下文,一些方法仅使用类token作为视觉输入,但这类输入过于抽象,难以提供足够的信息,尤其不利于细粒度生成任务。尽管密集视觉patch能够提供更丰富的信息,但由于视频帧之间存在冗余,它们的效率较低。因此,提升模型性能的关键挑战在于,在维持充分视觉细节的同时减少冗余,从而在信息丰富性与计算效率之间取得平衡。

图二:TimeChat,VTimeLLM 和论文VideoExpert 在Charades-STA 测试上的预测结果分布分裂。每个点代表预测的时间戳结果。更突出的点表示更频繁的预测。等高线图显示了Ground Truth分布,更高的区域反映更集中的注释。TimeChat和VTimeLLM经常预测相同的时间范围,视频查询对。当视觉信息不准确或缺失时,这种现象变得更加明显。这些方法在生成时间戳时更多地依赖于语言模式而不是视觉线索。

为应对这些挑战,论文提出了VideoExpert,这是一种适用于多种时间敏感型视频理解任务的多模态语言模型。其核心思想是将时间感知和内容生成委派给专门化模块。具体而言,VideoExpert集成了两个并行组件:Temporal Expert和Spatial Expert。Temporal Expert处理高帧率但高度压缩的特征输入,以捕捉视频中的动态信息。它专注于建模时间关系,例如事件序列和场景转换。此外,还引入了一个轻量级预测头,以确保准确的事件定位。与此同时,Spatial Expert专门负责捕捉细粒度内容细节并遵循指令。通过处理空间token和语言输入,它生成与内容相关的响应。在内容生成过程中,Spatial Expert通过一个特殊token <LOC> 与Temporal Expert协作,以指示何时以及什么事件应被定位。通过维持彼此独立的参数集,每个专家编码不同类型的信息,从而形成一个协作框架,以确保对视频内容的全面理解。重要的是,Spatial Expert仅生成特殊token,而不显式生成时间戳,并将所有时间定位请求委派给Temporal Expert。这种设计消除了时间戳预测中对文本模式偏置的依赖。此外,论文引入了patch token,以为模型提供更丰富的细粒度信息。然而,处理大量patch token会带来显著挑战。为此,论文实现了Spatial Compress模块。该模块在保留关键信息的同时,对大规模patch token进行筛选和压缩,为Spatial Expert提供紧凑而细节丰富的输入。

为验证VideoExpert,论文不仅在时序定位基准Charades-STA上进行实验,还在联合时序定位与亮点检测基准QVHighlights、密集视频描述基准YouCookII以及带定位的视频问答基准Next-GQA上进行了实验。作为一种面向时间敏感型视频任务设计的通用MLLM模型,论文方法取得了显著结果。它超越了现有基于MLLM的方法,甚至能够与任务专用模型竞争。论文的主要贡献总结如下:

- 论文提出了一种名为VideoExpert的通用MLLM,适用于多种时间敏感型视频任务。

- VideoExpert集成了两个并行模块:用于时间感知的Temporal Expert和用于内容生成的Spatial Expert。每个专家专注于特定任务类型,从而消除了时间戳预测中对文本模式偏置的依赖。

- 论文提出了Spatial Compress模块,用于在保留关键信息的同时筛选和压缩大规模patch token。该模块为Spatial Expert提供紧凑而细节丰富的输入,以增强其细节感知能力。

- 论文在四个具有挑战性的数据集、四类任务上进行了广泛实验,即Charades-STA、QVHighlights、YouCookII和Next-GQA,验证了所提方法的有效性。

1.2 方法(Method)

论文提出了VideoExpert,这是一种擅长处理时间敏感型视频任务的模型,如图3所示。本节首先对所提出的方法进行概述。Temporal Expert和Spatial Expert组件将在第B节中详细介绍,Spatial Compress模块将在第C节中说明,边界感知训练范式将在第D节中描述,最后,第E节将给出该模型所采用的训练目标。

1.2.1 模型概述(A. Model Overview)

与大多数现有模型类似,VideoExpert使用一个预训练编码器来处理视觉输入,并使用视觉-语言适配器将视觉特征映射到语言域中。随后,该模型依赖LLM生成响应并完成任务。该方法的关键创新在于,在LLM内部集成了两个并行专家模块,分别聚焦于视频相关任务中的时间感知和内容生成。此外,论文还引入了Spatial Compress模块,用于筛选和压缩大规模patch token,在保留关键信息的同时缓解输入token过多所带来的二次复杂度。该设计在保证计算效率的同时,极大提升了模型处理细粒度任务的能力。

1️⃣ 视觉处理(Visual Processing)

给定一个视频-问题对作为输入,视频 V = [ v 0 , v 1 , … , v n ] V=[v_0,v_1,\ldots,v_n] V=[v0,v1,…,vn]由 n n n帧组成。第一步是使用一个受语言监督的编码器,例如CLIP视觉模型,从每一帧中提取视觉特征。在大多数实现中,CLIP编码器在微调期间保持冻结,以保留其原始表征能力。类似地,论文的VideoExpert模型使用冻结的 CLIP ViT-L/14 作为视觉编码器。每一帧都独立地通过视觉编码器处理,以提取特征:

f i c l s , f i 1 , f i 2 , … , f i p = V i T ( v i ) , ( 1 ) {f_i^{cls}, f_i^1, f_i^2, \ldots, f_i^p}=\mathrm{ViT}(v_i), \quad(1) ficls,fi1,fi2,…,fip=ViT(vi),(1)

其中, i = { 0 , 1 , … , n } i=\{0,1,\ldots,n\} i={0,1,…,n}。类token f i c l s f_i^{cls} ficls编码第 i i i帧的语义信息。同时, f i p f_i^p fip表示从该帧中不同局部patch提取的特征,提供细粒度细节。这里, p p p表示每一帧中的patch数量。

大多数基于图像的MLLM将所有patch token作为输入,从而提供全面且细致的视觉信息。不幸的是,视频中的token数量通常比图像高出数个数量级。因此,研究者不得不将视频下采样到极低帧率,这会显著降低模型在时间敏感任务上的性能。为此,论文的目标是在一个计算高效的框架内,同时保留时间上下文和空间细节。具体而言,论文使用低分辨率、高帧率的T-token来模拟视频的完整时间上下文:

z i T = f i c l s , i = { 0 , 1 , … , n } ( 2 ) z_i^T=f_i^{cls},\ i=\{0,1,\ldots,n\} \quad(2) ziT=ficls, i={0,1,…,n}(2)

其中, z i T z_i^T ziT表示T-token。考虑到视频通常包含冗余token,论文提出Spatial Compress模块,从大量patch token中生成S-token,以尽可能捕获有价值的空间细节:

z 1 S , z 2 S , … , z m S = h ψ ( f 1 1 , f 1 2 , … , f 1 p , … , f n p ) ( 3 ) z_1^S,z_2^S,\ldots,z_m^S=h_{\psi}(f_1^1,f_1^2,\ldots,f_1^p,\ldots,f_n^p) \quad(3) z1S,z2S,…,zmS=hψ(f11,f12,…,f1p,…,fnp)(3)

其中, h ψ ( ⋅ ) h_{\psi}(\cdot) hψ(⋅)是Spatial Compression模块,共输出 m m m个S-token,且 m ≪ p × n m\ll p\times n m≪p×n。该设计同时保留空间信息与时间信息,并将二者结合起来,为VideoExpert提供稳健的视频表示:

Z = [ z 1 T , z 2 T , … , z n T , z 1 S , z 2 S , … , z m S ] ( 4 ) Z=[z_1^T,z_2^T,\ldots,z_n^T,z_1^S,z_2^S,\ldots,z_m^S] \quad(4) Z=[z1T,z2T,…,znT,z1S,z2S,…,zmS](4)

最后,T-token和S-token通过视觉-语言适配器被映射到与LLM相同的嵌入空间中。最终视觉特征记为:

X v i s u a l = g ϕ ( Z ) ( 5 ) X_{visual}=g_{\phi}(Z) \quad(5) Xvisual=gϕ(Z)(5)

其中, X v i s u a l ∈ R ( n + m ) × d X_{visual}\in\mathbb{R}^{(n+m)\times d} Xvisual∈R(n+m)×d是LLM能够理解的视觉序列。适配器 g ϕ g_{\phi} gϕ被实现为一个线性层。 d d d表示LLM的隐藏维度。

2️⃣ LLM输入(LLM Input)

在视觉处理之后,视频特征与文本token拼接,并共同作为LLM的输入。LLM F L L M \mathcal{F}_{LLM} FLLM生成一个响应序列作为输出。该过程可以表示为:

Y r e s p o n s e = F L L M ( X v i s u a l , X q u e s t i o n ) ( 6 ) Y_{response}=\mathcal{F}_{LLM}(X_{visual},X_{question}) \quad(6) Yresponse=FLLM(Xvisual,Xquestion)(6)

这种混合输入使各种时间敏感型视频任务都能够被重构为基于语言的指令与响应。例如,时序定位可以通过向模型提问“During which frames {} happened?”这类问题来解决。类似地,密集视频描述可以通过要求模型生成多句文本及其对应的起始和结束时间来实现。此外,VideoExpert还可以在提供相关视觉证据的同时处理标准的视频问答任务。

3️⃣ LLM输出(LLM Output)

现有方法通常生成绝对时间戳或相对时间token,但由于过度依赖已学习的语言模式而在性能上受限。论文提出的VideoExpert采用了不同的方法,将时间定位从内容生成中剥离出来,并将其完全委托给Temporal Expert。为实现这一点,原始LLM词表被扩展了一个新token,即<LOC>,它显式地表示对定位输出的请求。由VideoExpert生成的文本响应 Y r e s p o n s e Y_{response} Yresponse仅关注内容。当需要定位时,LLM生成一个<LOC> token,而不是在文本中直接插入时间戳。与<LOC> token相关联的特征会被提取出来,并作为提示送入Temporal Expert,引导其生成时间戳。该设计消除了文本响应中的显式时间戳,防止模型依赖文本来预测时间戳。通过将时间定位与文本生成解耦,并让每个组件专门处理各自任务,这一框架提升了时间戳预测的精度,并改善了文本响应的质量。

1.2.2 时间专家与空间专家(B. Temporal & Spatial Expert)

为了解决视频中时间信息管理的挑战,论文利用专家协作机制。Temporal Expert负责时间感知与时序定位,由LLM内部的一个适配器和一个轻量级的时序专家头组成。该适配器使用LoRA 实现,通过处理T-token使模型具备时间感知能力。时序专家头与该适配器紧密配合,利用由适配器和LLM联合编码的T-token来实现精确的时序定位。与此同时,Spatial Expert专注于生成与内容相关的响应。它以S-token和文本token作为输入,在遵循指令的同时为Temporal Expert提供引导。这种设计确保了时序定位与内容生成之间的无缝协调。

具体而言,输入的视觉-文本特征定义为 X = [ X v i s u a l , X q u e s t i o n ] ∈ R ( n + m + n q ) × d X=[X_{visual},X_{question}]\in\mathbb{R}^{(n+m+n_q)\times d} X=[Xvisual,Xquestion]∈R(n+m+nq)×d,其中 X v i s u a l = [ X T , X S ] X_{visual}=[X_T,X_S] Xvisual=[XT,XS]由T-token和S-token组成。 n q n_q nq表示文本token的数量。Temporal Expert的适配器仅接收T-token作为输入,并利用残差建模来微调一小部分参数,使模型能够形成时间感知能力。

[ X T ′ , X S ′ , X q u e s t i o n ′ ] = W o [ X T , X S , X q u e s t i o n ] , ( 7 ) [X'_T,X'_S,X'_{question}]=W_o[X_T,X_S,X{question}], \quad(7) [XT′,XS′,Xquestion′]=Wo[XT,XS,Xquestion],(7)

X T ′ = X T ′ + Δ W T X T , ( 8 ) X'_T=X'_T+\Delta W_T X_T, \quad(8) XT′=XT′+ΔWTXT,(8)

其中, W o W_o Wo是LLM的原始参数,并且始终保持冻结。 Δ W T \Delta W_T ΔWT表示Temporal Expert适配器的可训练参数。类似地,Spatial Expert的适配器处理文本token和S-token,使模型具备遵循指令的能力,并能够生成与内容相关的响应。

[ X S ′ , X q u e s t i o n ′ ] = [ X S ′ , X q u e s t i o n ′ ] + Δ W S [ X S , X q u e s t i o n ] , ( 9 ) [X'_S,X'_{question}]=[X'_S,X'_{question}]+\Delta W_S[X_S,X_{question}], \quad(9) [XS′,Xquestion′]=[XS′,Xquestion′]+ΔWS[XS,Xquestion],(9)

其中, Δ W S \Delta W_S ΔWS对应于Spatial Expert适配器的可训练参数。

模型像往常一样生成文本token作为响应。然而,当 Y r e s p o n s e Y_{response} Yresponse中出现 token时,它表示对定位输出的请求。来自LLM的<LOC> token的最终层嵌入会被提取出来,并通过一个多层感知机处理以生成 h l o c h_{loc} hloc。随后,由Temporal Expert和LLM联合编码的T-token会与 h l o c h_{loc} hloc一起送入时序专家头,以生成最终的定位结果。

X ′ ′ T = ϕ ( X T ′ , h l o c ) . ( 10 ) X''T=\phi(X'_T,h_{loc}). \quad(10) X′′T=ϕ(XT′,hloc).(10)

时序专家头首先按照函数(10)中定义的方式,利用 h l o c h_{loc} hloc 对T-token进行重新加权。随后,它通过两个分支完成定位任务:指示分支用于估计每个T-token被分类为前景或背景的概率,边界分支用于预测每个T-token相对于真实值的偏移量。具体来说,指示分支由三个 1 × 3 1\times3 1×3卷积层组成,每层具有 d d d个滤波器,并在其后接一个ReLU激活函数。最后,再连接一个sigmoid激活层,以输出每一帧的预测 k ~ i \tilde{k}_i k~i。边界分支具有与指示分支相似的结构,不同之处在于其最后一层具有2个输出通道,用于预测左右偏移量。给定 X T ′ ′ ∈ R n × d X''_T\in\mathbb{R}^{n\times d} XT′′∈Rn×d 作为输入,该分支生成逐帧偏移量 { d ~ i } i n \{\tilde{d}_i\}_i^n {d~i}in。

1.2.3 空间压缩(C. Spatial Compress)

论文已经探索了使用T-token来模拟视频的完整时间上下文。然而,过度压缩的T-token会导致细节的显著丢失。尽管稠密视觉patch能够提供更丰富的信息,但将所有patch输入MLLM会带来很高的计算成本。幸运的是,视频的信息密度远低于语言输入。所提出的Spatial Compression模块的核心目标是在保留视觉细节的同时减少冗余。

受H.264等现代视频压缩技术启发,论文借助帧内与帧间上下文对信息进行压缩,如图4所示。具体而言,首先将视频划分为图像组,即Groups of Pictures(GOPs)。论文从视频中均匀采样 u u u 帧作为IDR帧,然后根据相似性向前和向后扩展GOP边界,从而得到 u u u 个GOP。在每个GOP内,IDR帧被独立压缩,而其余帧被视为 P 帧,通过参考对应的IDR帧并采用帧间方法进行压缩。压缩token的过程按顺序执行以下四个步骤。

- (a) 关键token识别(Key Token Identification)。论文从IDR帧中选择某些token作为关键token。首先,CLS token汇聚了整幅图像中的关键信息,而受到CLS token更高注意力的patch token通常总是具有信息量。因此,论文利用CLS token的注意力分数来选择这些token作为关键token。此外,为了保留上下文信息,论文还从剩余token中均匀采样少量token作为上下文token,以确保不会遗漏任何潜在重要细节。

- (b) 信息量化(Information Quantification)。论文识别GOP中每个传递与所选关键token相似信息的token,并据此将它们分组

- (c) 移除静态patch(Removing Static Patches)。论文在这一步检测随时间重复出现的静态信息,使模型能够减少冗余并更多关注动态内容。具体而言,论文定义两个连续patch,它们位于相同的空间坐标 ( x , y ) (x,y) (x,y),但处于不同的时间位置 t 1 t_1 t1和 t 2 t_2 t2,其中 t 2 = t 1 + Δ t t_2=t_1+\Delta t t2=t1+Δt。如果它们的类别标签相同,则这些token被视为时间上重复的token。此类token会从P帧中移除,仅保留在IDR帧中。

- (d) token合并(Token Merging)。最后,论文将跨帧属于同一类别的token进行合并,生成后续供空间专家使用的S-token。

1.2.4 边界感知训练范式(D. Boundary-aware Training Paradigm)

除了模型架构之外,训练任务和数据对于塑造多模态大语言模型也至关重要。论文的训练数据由三个部分组成,且都来源于公开数据集。

时序定位(Temporal Grounding)。这一任务的目标是在视频中定位由问题句子描述的事件。为了生成与视觉问答格式相匹配的数据,论文采用了一个问答模板,例如:

这里,<Question>表示问题文本,而<VIDEO>作为视觉输入token的占位符。<LOC>会被替换为实际时间戳,作为最终结果。

密集视频描述(Dense Video Captioning)。每个视频都由一组句子进行描述,每个句子都附带对应事件的起始和结束时间戳。这种结构使得数据可以很容易地通过如下模板转换为问答对:

语言损失用于约束模型生成遵循预定义模板并与目标内容对齐的输出。每个时间戳都作为真实值,用于监督相应的定位结果。在训练期间,论文还使用了额外的模板来生成问答数据,以确保训练数据集的多样性。

视频问答(Video Question Answering)。为了保持多模态大语言模型原有的视频问答能力,论文在训练期间引入了视频问答数据集。遵循LLaVA,问答任务已经被表示为语言指令。这些数据集并不包含任何需要时间推理的定位式问答样本。令人惊讶的是,即使没有在复杂推理数据上进行训练,VideoExpert在基于推理的时序定位任务上仍表现出令人印象深刻的零样本性能,例如Grounding QA。

1.2.5 训练目标(E. Training Objectives)

模型使用文本生成损失 L t e x t \mathcal{L}_{text} Ltext和边界损失 L c e + L b \mathcal{L}_{ce}+\mathcal{L}_b Lce+Lb进行端到端训练。总体目标 L L L定义为:

L = λ t e x t L t e x t + L c e + L b , ( 11 ) \mathcal{L}=\lambda_{text}\mathcal{L}_{text}+\mathcal{L}_{ce}+\mathcal{L}_b, \quad(11) L=λtextLtext+Lce+Lb,(11)

其中, λ t e x t ∈ R \lambda_{text}\in\mathbb{R} λtext∈R是权衡超参数。 L t e x t \mathcal{L}_{text} Ltext是用于文本生成的自回归交叉熵损失。模型由LLM生成的语言进行驱动。论文采用标准的语言建模训练目标,其定义如下:

L t e x t = ∑ i = 1 L log p ( y i ∣ X , Y r e s p o n s e , < i ) , ( 12 ) \mathcal{L}_{text}=\sum_{i=1}^{L}\log p(y_i|X,Y_{response,<i}), \quad(12) Ltext=i=1∑Llogp(yi∣X,Yresponse,<i),(12)

其中, L L L表示模型响应序列的长度。边界损失鼓励模型生成高质量的定位结果。具体而言, L c e \mathcal{L}_{ce} Lce表示用于评估预测的 k ~ i \tilde{k}_i k~i是否被正确分类为前景或背景的交叉熵损失。

L b = λ L 1 L L 1 ( d ~ i , d i ) + λ i o u L i o u ( b ~ i , b i ) , ( 13 ) \mathcal{L}_b=\lambda_{L1}\mathcal{L}_{L1}(\tilde{d}i,d_i)+\lambda_{iou}\mathcal{L}_{iou}(\tilde{b}_i,b_i), \quad(13) Lb=λL1LL1(d~i,di)+λiouLiou(b~i,bi),(13)

L b \mathcal{L}_b Lb量化了真实时刻与预测时刻之间的差异。论文从预测偏移中导出边界 b ~ i \tilde{b}_i b~i,并采用平滑 L 1 L_1 L1损失与广义IoU损失的组合作为训练目标。

1.3 实验(Experiments)

1.3.1 任务与数据集(Tasks & Datasets)

基准。论文在四个涵盖不同任务的数据集上评估VideoExpert。对于每一种设置,论文都简要介绍了数据集及其对应的评估指标。

-

Charades-STA 包含6,672个视频,并为视频时序定位任务提供16,124个查询-时刻对。视频与目标时刻的平均长度分别为30.60秒和8.09秒。遵循以往工作,论文使用12,404个查询-时刻对进行训练,使用3,720个进行测试。指标:该基准的评估指标包括带IoU阈值的Recall@1,即R1@{0.3, 0.5, 0.7},以及mean IoU,即mIoU。更高的IoU值表示更精确的时刻匹配。

-

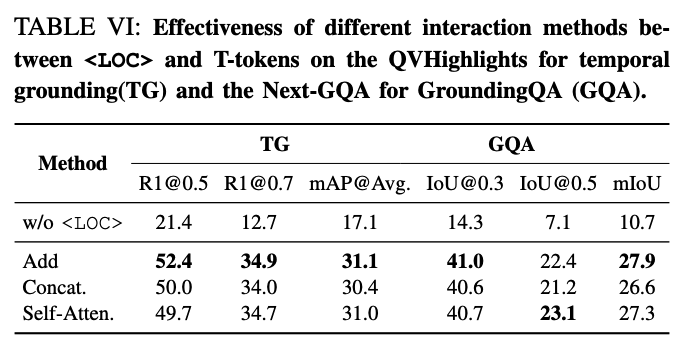

QVHighlights是一个较新的基准,旨在基于自然语言查询进行视频时序定位和亮点检测。它包含10,310个样本,并配有人类撰写的文本查询。每个查询都与视频中的多个时刻相关联。实验在标准划分上进行,即7,218个查询-时刻对用于训练,1,550个用于验证,1,512个用于测试。值得注意的是,QVHighlights提供了公平评估,因为测试集结果的评估需要提交到服务器。指标:按照惯例,时序定位使用R1@{0.5, 0.7}、mAP@{0.5, 0.75}以及平均mAP,即mAP@Avg进行评估。对于亮点检测,采用mAP和Hit@1指标,并将阈值设置为“Very Good”。

-

YouCookII 是一个为视频描述生成设计的数据集,包含超过2,000个来自YouTube的未裁剪烹饪视频,总时长超过176小时。平均而言,每个视频持续320秒,并标注了7.7个时间定位句子。视频被分割为多个片段,每个片段都对应特定时间戳和详细描述。指标:SODAc是为该任务设计的指标,它在考虑视频故事线的同时评估生成的描述。生成事件与真实值之间的时间对齐也会被纳入考虑。CIDEr和METEOR等描述指标则基于这些匹配对进行计算。

-

Next-GQA 是一个新的Grounding QA基准,它通过向Next-QA添加时间标注构建而成。它要求视觉语言模型在提供视觉证据的同时回答问题。该设置旨在判断模型预测究竟是基于相关视频内容,还是受语言中的伪相关和无关视觉上下文影响。指标:该基准的评估指标包括两部分。对于视觉证据定位,IoP和IoU等指标用于评估预测的时间窗口是否与真实值对齐。对于问答,结果以正确回答问题的百分比Acc@QA来报告。此外,还定义了Grounded QA准确率指标Acc@GQA,用于衡量那些既回答正确又在视觉上完成定位的问题比例,即IoP ≥ 0.5 \ge 0.5 ≥0.5。

-

1)Video-MME,共包含 2700 个问答对,视频平均时长为 17 分钟。

-

2)LVBench 是一个小时级基准,平均长度为 4101 秒(68 分钟),包含 1549 个问答对和四个多项选择选项。

-

3)HourVideo,论文使用其 dev 集,其中包含 50 个视频,平均时长为 47.2 分钟,包含 1182 个高质量的五选一问题。

-

4)Egoschema 是一个流行的、源自 Ego4D 的基准。它由基于视频的五选一问题组成,视频长度为 180 秒。论文在其子集上进行了消融实验。

实现细节。在论文的研究中,Vicuna-1.5 7B 被用作大语言模型。对于每个数据集,论文从每个视频中采样100帧。在整个训练过程中,总batch size为128。优化器采用AdamW,并使用余弦学习率衰减和预热阶段。两个专家LoRA 配置均使用rank为32,alpha为64。模型的最大响应长度默认设为512。

1.3.2 对比实验(Comparison with State-of-the-arts)

1.3.3 消融实验(Ablation Study)

二、论文理解&总结

暂时省略,用到再分析。

三、代码学习

暂时省略,用到再分析。

写在最后

由于笔者🖊️精力有限且本文更多的目的是通过📒博客记录学习过程并分享更多知识,因此文中部分描述不太具体,如有不太理解💫的地方可在评论区👀留言。非特殊赶deadline⏰或假期⛱️期间,笔者会经常上线回复💬。如有不便之处,请海涵~

如果想了解更多关于长视频理解和视频智能体新工作,可以关注笔者的Github仓库:Awesome-Video-Agent。

另外,创造不易,转载请注明出处💗💗💗~

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)