DeepSeek大模型 × 空间智能引擎镜像视界构建“人工智能+空间计算”新一代智能感知体系

镜像视界推出"人工智能+空间计算"智能感知系统,通过融合DeepSeek大模型与空间智能引擎,实现从视频到空间认知的全链路智能分析。系统核心技术包括视频空间反演、矩阵视频融合、动态三维重建等,可将像素转换为空间坐标,实现厘米级无感定位和行为预测。该系统支持跨摄像头追踪、风险预警等功能,适用于城市治理、公共安全、交通管理等场景,推动从二维监控向三维智能认知的升级。

DeepSeek大模型 × 空间智能引擎

镜像视界构建“人工智能+空间计算”新一代智能感知体系

副标题

融合 视频空间反演 × 矩阵视频融合 × 动态三维重建 × 无感定位 × 行为认知 × 风险预测

打造从 像素到空间坐标、从视频感知到智能决策 的全链路空间智能系统

发布单位:镜像视界(浙江)科技有限公司

一、人工智能与空间计算的时代机遇

随着人工智能技术的快速发展,大模型正在成为新一轮技术革命的重要基础设施。特别是在 DeepSeek 等通用大模型的推动下,人工智能正在从传统的数据分析阶段,迈向对复杂物理世界的理解与推演阶段。

与此同时,现实世界的数字化需求也在迅速增长。城市治理、交通管理、公共安全、工业制造、港口物流、机场通关等复杂场景,都需要能够 实时理解空间环境、识别动态目标、预测行为趋势的智能系统。

然而,目前大量视频系统仍停留在 二维监控阶段:

-

视频只用于“看见”

-

数据难以转化为空间坐标

-

无法建立完整空间模型

-

无法进行趋势级风险预测

这导致海量视频资源无法转化为真正的智能能力。

因此,一个关键问题正在浮现:

如何让视频从“图像数据”升级为“空间数据”?

镜像视界提出了全新的技术路径:

通过空间反演技术,将视频像素转换为真实空间坐标,并结合 DeepSeek 大模型,实现空间认知与智能决策。

这一体系构成了:

“人工智能 + 空间计算”新一代空间智能系统。

二、镜像视界空间智能系统总体架构

镜像视界提出的空间智能系统,是一个从视频感知到智能决策的完整技术体系。

系统核心理念:

像素即坐标

轨迹即数据

空间即智能

系统整体技术链路如下:

视频采集

↓

视频空间反演

↓

矩阵视频融合

↓

动态三维实时重建

↓

空间无感定位

↓

行为认知分析

↓

风险预测推演

↓

智能决策输出

通过这一体系,系统能够实现:

-

厘米级空间定位

-

动态目标三维实时重建

-

跨摄像头连续追踪

-

行为理解与趋势预测

-

智能预警与决策支持

最终形成 空间级智能感知系统底座。

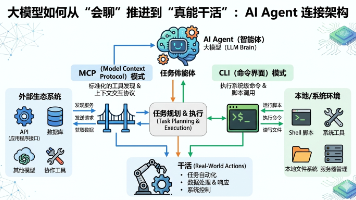

三、DeepSeek大模型驱动的空间认知能力

在传统视频系统中,算法主要用于目标检测或行为识别,但这些能力往往停留在 单帧图像层面。

镜像视界引入 DeepSeek 大模型能力,构建空间认知引擎,使系统具备更高层级的智能能力。

DeepSeek在系统中承担三类核心能力:

1 空间语义理解

DeepSeek可以对空间环境进行语义建模,例如:

-

人员行为理解

-

群体活动识别

-

场景状态识别

例如:

-

是否存在异常聚集

-

是否存在危险行为

-

是否存在异常移动模式

系统不再只是识别目标,而是 理解空间中的行为关系。

2 行为模式学习

通过大模型的学习能力,系统能够识别 长期行为模式:

例如:

-

正常通行模式

-

正常物流运输轨迹

-

正常巡逻路线

一旦出现偏离模式的行为,系统可以快速识别。

例如:

-

非常规移动

-

异常停留

-

突然加速

这使系统具备 趋势级行为识别能力。

3 风险预测与推演

在三维空间模型与行为数据基础上,DeepSeek可以进行:

多路径概率推演

例如:

-

人群拥堵风险预测

-

安全事件风险预测

-

目标未来路径预测

系统可以提前进行:

-

风险预警

-

动态布控

-

协同处置

从而实现:

从被动监控 → 主动预警。

四、视频空间反演技术(Pixel-to-Space)

视频空间反演是镜像视界空间智能系统的核心基础能力。

其核心目标是:

将视频像素坐标转换为真实空间坐标。

传统视频系统中:

像素 = 图像位置

而在镜像视界系统中:

像素 → 三维空间坐标

通过相机标定、空间几何计算与多视角融合,系统可以实现:

-

摄像头空间参数建模

-

像素坐标反演

-

空间坐标计算

最终建立:

视频 → 空间坐标映射关系。

这一能力使视频系统第一次具备 空间感知能力。

五、矩阵视频融合技术

在大型场景中,通常部署大量摄像头。

传统视频系统存在一个核心问题:

摄像头之间是孤立的。

镜像视界提出 矩阵视频融合技术。

其核心思想是:

将多个摄像头构建为统一空间网络。

系统通过:

-

相机空间标定

-

视频时序同步

-

多视角数据融合

构建 摄像头矩阵网络。

在这一体系下:

多个摄像头可以协同感知同一空间。

实现:

-

跨镜头连续追踪

-

空间位置统一计算

-

大场景空间感知

这一技术使系统能够覆盖:

-

城市级空间

-

园区级空间

-

港口码头

-

机场枢纽

等复杂环境。

六、动态目标三维实时重建

在多视角视频融合基础上,系统可以对动态目标进行 三维实时重建。

系统通过:

-

多视角目标识别

-

三角测量计算

-

时序轨迹重建

构建动态目标的 三维轨迹模型。

例如:

系统可以实时重建:

-

人员运动轨迹

-

车辆运行轨迹

-

无人机飞行轨迹

并形成:

完整的三维行为轨迹。

这一能力使系统从二维监控升级为 空间行为分析系统。

七、空间无感定位技术

传统定位系统通常依赖:

-

GPS

-

蓝牙

-

RFID

-

标签设备

这些系统存在明显局限:

-

需要设备

-

成本高

-

覆盖有限

镜像视界提出:

空间无感定位技术

其核心特点:

-

无标签

-

无信号

-

无设备

系统仅通过视频即可实现:

厘米级空间定位。

定位精度可达:

30cm以内

这一能力使系统适用于:

-

城市治理

-

公共安全

-

港口码头

-

工业制造

-

军事训练

等复杂场景。

八、空间行为认知与风险预测

在空间定位与轨迹数据基础上,系统可以构建 行为认知模型。

系统通过分析:

-

轨迹特征

-

行为模式

-

群体关系

识别多类行为状态:

例如:

-

正常行为

-

可疑行为

-

危险行为

进一步结合 DeepSeek 大模型,系统可以进行:

趋势级风险预测。

例如:

-

人群拥堵预测

-

安全风险预测

-

事故风险预测

系统能够提前进行:

-

风险预警

-

动态布控

-

处置决策

实现真正意义上的 智能安全体系。

九、核心应用场景

镜像视界空间智能系统适用于多类复杂场景。

公共安全

-

城市风险预测

-

人群聚集预警

-

异常行为识别

交通管理

-

路口交通行为分析

-

交通事故预测

-

车辆轨迹分析

港口与机场

-

物流路径监控

-

安全风险识别

-

人员空间管理

工业制造

-

生产线行为分析

-

设备空间监控

-

作业安全管理

应急救援

-

灾害现场人员定位

-

救援路径规划

-

实时态势重建

十、未来发展方向

未来,镜像视界将持续推进:

人工智能 × 空间计算 × 视频智能

三大技术融合。

重点发展方向包括:

-

空间智能操作系统

-

城市级空间智能网络

-

视频孪生系统

-

空间行为认知模型

最终目标是构建:

全球领先的空间智能技术体系。

结语

在人工智能时代,视频不再只是记录工具。

通过空间计算与大模型能力,视频正在成为:

理解世界的重要传感器。

镜像视界提出的空间智能体系,实现了:

从像素到空间坐标

从视频感知到智能决策

从二维监控到三维认知

这一技术体系,将成为未来智慧城市、公共安全与数字空间建设的重要基础设施。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)