【技术干货】大模型微调全攻略:让千亿参数AI模型为你服务,建议收藏

文章详解大模型微调四大技术家族:经典参数微调、高效参数微调(PEFT)、提示微调和强化学习微调。对比各技术参数量、计算成本及适用场景,指出LoRA等PEFT方法因性价比高成为生产环境首选。展望未来发展方向,强调对开发者而言,LoRA和QLoRA是最实用选择。

如何让千亿参数的AI模型"学会"你的专属任务?本文带你读懂大模型微调的核心技术。

一、为什么需要"微调"?

想象一下:你招聘了一位博学多才的博士(预训练大模型),他读过海量书籍,知识渊博。但当你让他处理公司特定的业务问题时,他可能需要了解你们公司的术语、流程和规则。

微调(Fine-tuning) 就是这样一个过程——在预训练好的大模型基础上,用特定领域的数据进行"再培训",让模型更好地适应具体任务。

微调的核心价值

| 优势 | 说明 |

|---|---|

| 节省成本 | 避免从零训练千亿参数模型的巨额开销 |

| 提升效果 | 在特定任务上表现更精准 |

| 快速部署 | 利用预训练知识,少量数据即可见效 |

二、大模型微调的四大家族

目前主流的大语言模型微调技术可分为四大类:

1️⃣ 经典参数微调(Full Fine-tuning)

全参数微调是最传统的微调范式, 原理类似于模型预训练,不同之处在于,所有的参数都已经有了一个较好的初始值,即使用较少数据继续在初始值的基础上继续训练模型更新参数。

就像让博士重新学习所有知识来适应新工作。虽然效果通常最好,但代价高昂——GPT-3有1750亿参数,全参数微调需要巨大的计算资源。

全参数微调目前主要指监督微调,主要应用在下游子任务的模型迁移中。

相关学者针对传统微调技术研究了改进方法,如下:

| 方法 | 创新点 | 优点 | 缺点 |

|---|---|---|---|

| MeZO | 零阶随机梯度下降; 梯度估计更新模型参数 | 节省训练空间; 减少内存消耗 | 训练步骤多; 实现复杂 |

| LOMO | 融合梯度计算与参数更新; 对目标函数采样和评估; 近似梯度更新参数 | 节省训练空间; 减少内存消耗 | 训练速度较慢 |

| UT | 稀疏数据重引; 数据混合 | 有效学习小规模未标记数据,具有一定泛化性 | 依赖于源数据和目标数据的性质与规模 |

| POUF | 使用未标记数据; 基于提示引导模型学习 | 在不增加数据标注的情况下提高模型性能,具备零射击能力 | 泛化能力难以保证; 依赖高质量的提示设计 |

全参数微调的训练目标:

给定预训练模型 ,其中 为预训练参数,微调的目标是在特定任务的标注数据集 上最小化损失函数:

,其中 为任务特定的损失函数(如交叉熵损失), 为正则化项, 为正则化系数。优化过程通常采用梯度下降法:

,其中 为学习率。

2️⃣ 高效参数微调(parameter-efficient fine-tuning,PEFT)

核心思想:只修改少量关键参数,其余参数保持冻结。

这是目前最热门的研究方向,可将训练参数减少到0.01%~3%,效果却接近全参数微调!

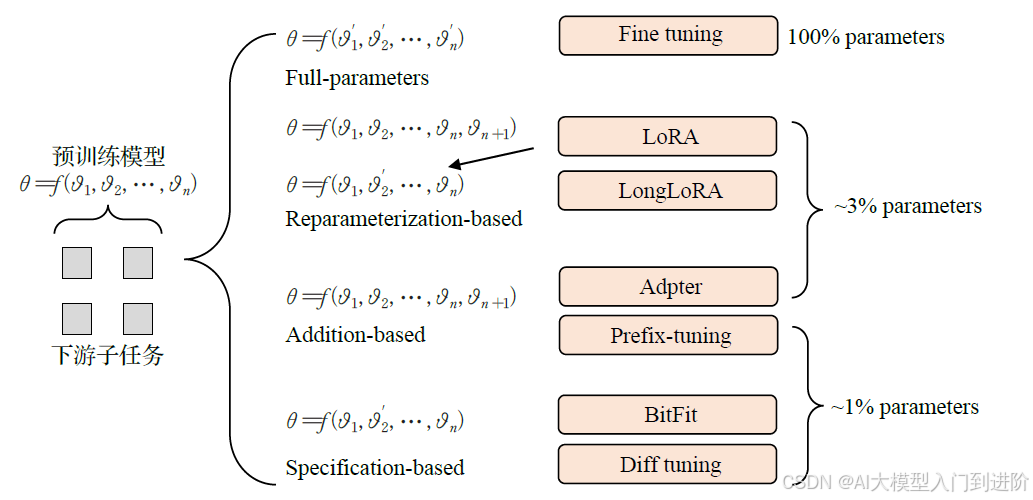

PEFT代表方法如图所示:

PEFT代表方法与参数量

🔹 增加式微调:给模型"加装插件"

优点是不修改原模型,插件即插即用,主要方法如下:

| 方法 | 创新点 | 参数量 |

|---|---|---|

| Adapter | 在Transformer层中插入小型适配器模块 | ~3.6% |

| Prefix-tuning | 在输入前添加可训练的前缀向量 | ~0.1% |

| IA3 | 学习缩放向量调整激活值 | ~0.01% |

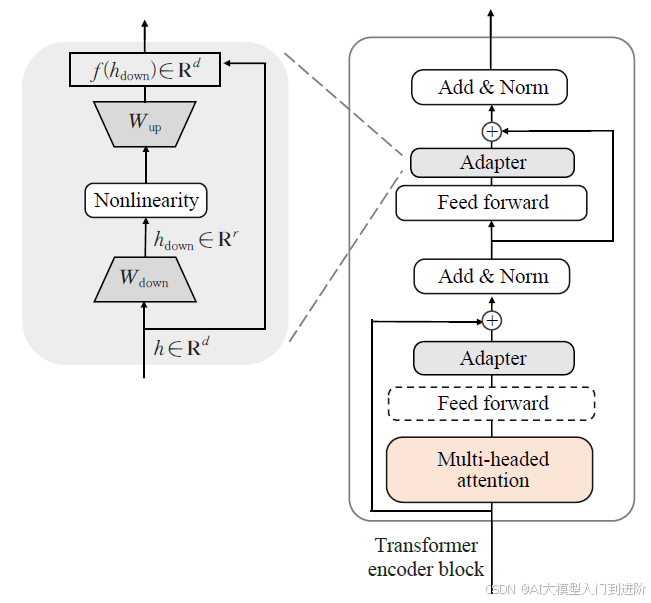

Adapter 原理架构图示例:

Adapter 原理架构图

Adapter-tuning 在Transformer的每个子层后插入轻量级适配器模块。设输入为 ,Adapter的计算过程为:

其中 ,, 为瓶颈维度, 为非线性激活函数。实验表明,仅增加3.6%的参数即可达到与全参数微调相当的GLUE基准性能。

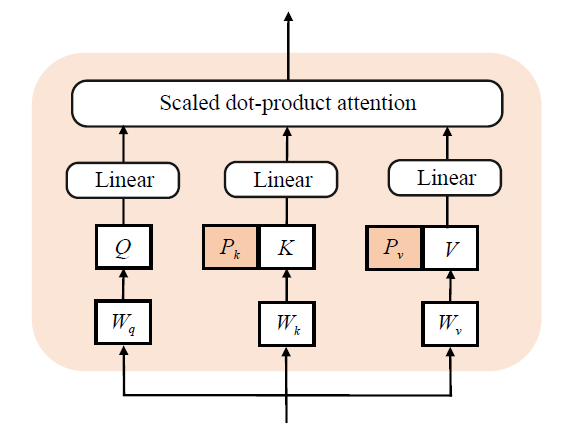

Prefix-tuning 原理架构图示例:

Prefix-tuning 原理架构图

Prefix-tuning 在注意力机制的键(Key)和值(Value)前添加可训练的前缀向量 。多头注意力计算修改为:

该方法仅需修改0.1%的参数,在表格到文本生成任务上表现优异。

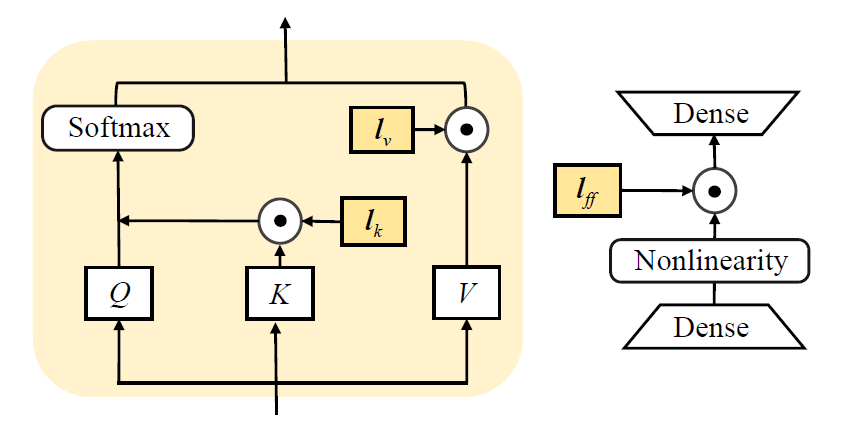

IA3 原理架构图示例:

IA3 原理架构图

IA3(Infused Adapter by Inhibiting and Amplifying Inner Activations)通过学习缩放向量 调整内部激活:

🔹 选取式微调:只调"关键参数"

主要方法如下:

| 方法 | 策略 |

|---|---|

| BitFit | 保持权重矩阵W 不变,只训练偏置(bias)参数,仅更新0.05%参数 |

| Diff-pruning | 将微调表述为学习一个差异向量δτ,该向量被添加到预先训练的固定模型参数中, 仅学习差异向量δτ,只修改0.5%参数 |

BitFit 仅优化模型的偏置项(bias),保持权重矩阵不变:

该方法仅更新约0.05%的参数,在低数据和中等数据场景下性能接近全参数微调。

Diff-pruning 将微调表述为学习稀疏差异向量 :

通过正则化约束差异向量的稀疏性,仅修改0.5%的参数即可达到全参数微调性能。

🔹 重参数化微调:LoRA及其变体

LoRA(低秩适配) 是目前最广泛使用的方法:基于内在维度(intrinsic dimension)假设,认为权重更新具有低秩结构。对预训练权重矩阵 ,约束其更新为低秩分解形式:

其中 ,,。训练时冻结 ,仅优化 和 。前向传播修改为:

简单来说就是权重更新具有"低内在秩",可以用两个小矩阵的乘积来近似大矩阵的更新。

LoRA 方法系列家族如下:

| 微调方法 | 创新点 | 优势 |

|---|---|---|

| LoRA | 引入低秩矩阵 | 参数量小;缩短训练时间 |

| LongLoRA | 移位稀疏注意力机制;优化参数更新计算过程 | 减少GPU内存消耗;缩短训练时间 |

| GLoRA | 引入了门控机制;动态调整低秩更新 | 更好的模型控制;更好的模型适应性 |

| AdaLoRA | 自适应性调整低秩更新 | 增强了模型在不同任务和数据集上的性能 |

3️⃣ 提示微调(Prompt Tuning)

核心思想不改变模型参数,而是通过优化输入提示来引导模型输出

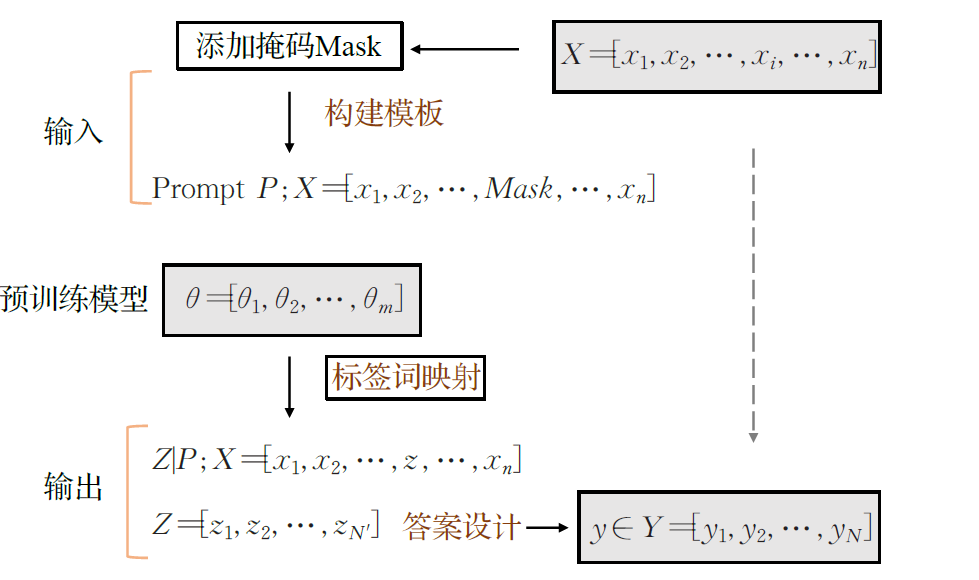

Prompt-tuning 原理图示例:

Prompt-tuning 原理图

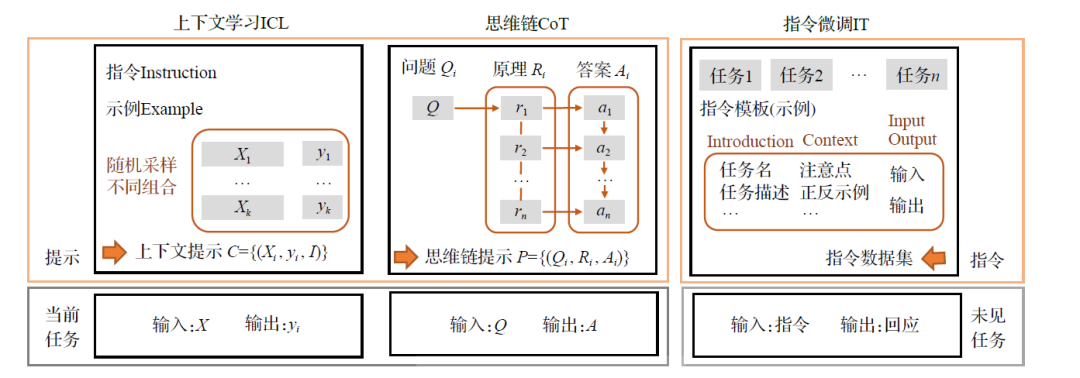

🔹 上下文学习(ICL)

GPT-3首创的"零参数"学习方法:

示例:问题:这部电影太精彩了!→ 正面问题:完全看不懂在讲什么 → 负面问题:演员演技很棒,推荐观看 → ?

模型通过"类比学习"自动推断答案,无需任何参数更新!

ICL通过构造包含任务示例的提示上下文,引导模型进行少样本学习。设演示集为 ,其中 为任务指令,则预测过程为:

ICL仅通过提示工程即可适应新任务,研究表明,ICL性能与预训练数据中的术语频率呈正相关,且可解释为隐式贝叶斯推理。

🔹 思维链(CoT)

针对数学推理等复杂任务,让模型"一步一步想":

问题:小明有5个苹果,给了小红2个,又买了3个,现在有几个?CoT提示:让我们一步步思考:- 开始时有5个苹果- 给了小红2个,剩下5-2=3个- 又买了3个,现在有3+3=6个- 答案:6个

CoT通过引入中间推理步骤增强模型性能。提示结构扩展为三元组 ,其中 为推理原理。根据贝叶斯公式:

CoT的进阶版本有:

- • ToT(树状思维):构建树状推理过程,允许回溯

- • GoT(图状思维):用图结构表示复杂依赖关系

- • PoT(程序思维):生成程序代码来解决问题

🔹 指令微调(Instruction Tuning)

用指令格式的数据集训练模型,大幅提升零样本能力:

指令:请将以下中文翻译成英文输入:今天天气很好输出:The weather is nice today

指令微调通过构建指令格式的数据集 ,其中 为指令, 为上下文,训练模型遵循人类指令:

代表性指令数据集包括FLAN、P3、Self-Instruct等。代表模型包括Alpaca、Vicuna、ChatGLM

ICL、CoT与IT原理对比图:

ICL、CoT与IT原理对比图

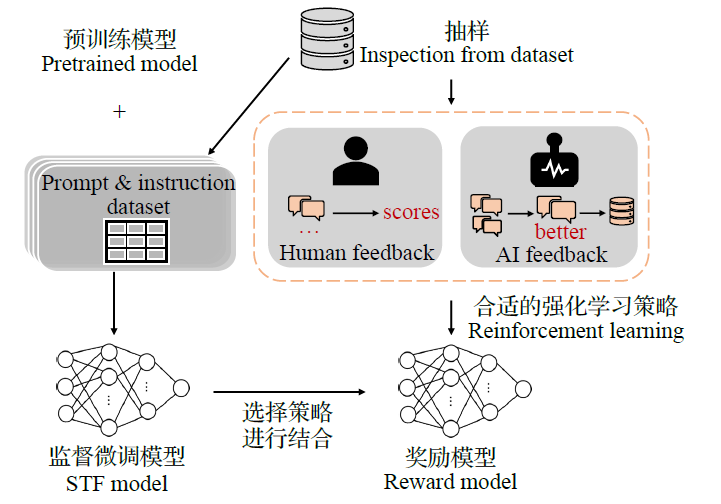

4️⃣ 强化学习微调(RL)

🔹 RLHF(Reinforcement Learning from Human Feedback):人类反馈强化学习

ChatGPT背后的核心技术,分为三个阶段:

┌─────────────────┐ ┌─────────────────┐ ┌─────────────────┐│ 1. 监督微调 │ → │ 2. 训练奖励模型 │ → │ 3. 强化学习优化 ││ (SFT) │ │ (RM) │ │ (PPO) │└─────────────────┘ └─────────────────┘ └─────────────────┘

流程:

-

- 用人工标注数据微调模型

-

- 训练奖励模型学习人类偏好

-

- 用PPO算法优化策略

阶段一:监督微调(SFT)

阶段二:奖励模型训练

收集人类偏好比较数据 ,其中 为偏好输出,训练奖励模型 :

阶段三:强化学习优化

采用PPO(Proximal Policy Optimization)算法优化策略:

其中 为优势函数, 为裁剪系数。

🔹 RLAIF:AI反馈强化学习

用AI代替人类进行反馈标注,降低成本:

- • 让AI模型评估和排序输出

- • 构建AI偏好数据集

- • 训练奖励模型

研究表明,RLAIF可达到与RLHF相当甚至更好的效果!

RLHF 和RLAIF 原理图:

RLHF 和RLAIF 原理图

三、技术对比一览

| 微调技术 | 参数量 | 计算成本 | 适用场景 |

|---|---|---|---|

| 全参数微调 | 100% | 极高 | 数据充足、追求最佳性能 |

| Adapter | ~3.6% | 低 | 多任务场景 |

| Prefix-tuning | ~0.5% | 低 | 生成任务 |

| LoRA | ~0.5% | 低 | 最广泛使用 |

| BitFit | ~0.08% | 极低 | 快速实验 |

| ICL | 0% | 极低 | 零样本/少样本场景 |

| RLHF | 视方法而定 | 高 | 对齐人类偏好 |

四、未来发展方向

1. 计算资源优化

- • 开发更高效的微调算法

- • 降低部署成本,推动普及

2. 特定任务性能提升

- • 针对医疗、法律、金融等垂直领域优化

3. 无监督微调

- • 摆脱对标注数据的依赖

- • 利用自监督、对比学习等技术

4. 多模态微调

- • 整合文本、图像、音频等多种模态

- • 开发通用跨领域微调策略

5. 伦理性与安全性

- • 保障数据隐私

- • 消除模型偏见

- • 提升可解释性

6. 反馈机制优化

- • 提高RLHF/RLAIF效率

- • 减少对大量人工标注的依赖

五、总结

- • 经典微调:效果最佳但成本高昂

- • 高效微调(LoRA等):性价比之王,生产环境首选

- • 提示微调:零参数灵活应用

- • 强化学习微调:对齐人类价值观

对于开发者而言,LoRA和QLoRA是目前最实用的选择。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

更多推荐

已为社区贡献493条内容

已为社区贡献493条内容

所有评论(0)