Claude Code 使用 OpenAI Codex(GPT-5.3-Codex)完整配置教程

通过 LiteLLM 可以让 Claude Code 调用任何模型,包括:OpenAIDeepSeekGemini本地模型↓↓优点:不依赖 Anthropic API可自由切换模型支持统一 AI Gateway这种“LLM Gateway 架构”正在成为 AI 开发工具的主流实践。

Claude Code 使用 OpenAI Codex(GPT-5.3-Codex)完整配置教程

本文介绍如何让 Claude Code 调用 OpenAI 的 Codex 模型(如 gpt-5.3-codex)。

核心思路是通过 LiteLLM 代理层实现模型协议转换。

原因:

-

Claude Code 只支持 Anthropic API

-

OpenAI 使用 OpenAI API

-

LiteLLM 可以做 API协议转换和模型路由

官方文档也提到:Claude Code 可以通过 LLM Gateway(例如 LiteLLM)连接其他模型提供商。 (Claude API Docs)

一、最终架构

整体调用链如下:

Claude Code

↓

LiteLLM Proxy

↓

OpenAI API

↓

gpt-5.3-codex

解释:

| 层 | 作用 |

|---|---|

| Claude Code | AI coding agent |

| LiteLLM | 协议转换和模型网关 |

| OpenAI | 提供 Codex 模型 |

| GPT-5.3-Codex | 代码生成模型 |

一些开源项目已经使用这种方式让 Claude Code 调用 GPT-Codex。 (GitHub)

二、准备环境

需要准备:

1 安装 Node.js

Claude Code 是 Node CLI:

node >= 18

2 安装 Claude Code

安装 CLI:

npm install -g @anthropic-ai/claude-code

安装完成测试:

claude --version

3 安装 LiteLLM

安装 Python 版 LiteLLM:

pip install litellm

验证:

litellm --help

4 准备 OpenAI API Key

从 OpenAI 获取:

sk-xxxxxx

设置环境变量:

Linux / macOS:

export OPENAI_API_KEY="sk-xxxx"

Windows PowerShell:

$env:OPENAI_API_KEY="sk-xxxx"

三、创建 LiteLLM 配置

创建文件:

config.yaml

内容如下:

model_list:

- model_name: sonnet-4

litellm_params:

model: openai/gpt-5.3-codex

api_key: ${OPENAI_API_KEY}

- model_name: haiku-4

litellm_params:

model: openai/gpt-4o-mini

api_key: ${OPENAI_API_KEY}

解释:

| Claude Code模型 | 实际调用模型 |

|---|---|

| sonnet-4 | gpt-5.3-codex |

| haiku-4 | gpt-4o-mini |

这样 Claude Code 会认为自己在调用:

sonnet-4

但实际上调用:

gpt-5.3-codex

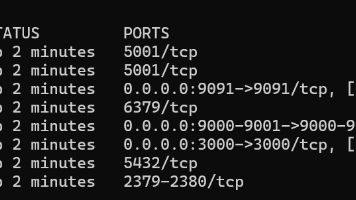

四、启动 LiteLLM

运行:

litellm --config config.yaml --port 1234

成功后会看到:

Uvicorn running on http://0.0.0.0:1234

测试:

http://localhost:1234/v1/models

如果返回模型列表说明代理正常。

五、配置 Claude Code

Claude Code 的配置文件:

.claude/settings.json

添加:

{

"env": {

"ANTHROPIC_BASE_URL": "http://localhost:1234",

"ANTHROPIC_AUTH_TOKEN": "dummy",

"ANTHROPIC_MODEL": "sonnet-4",

"ANTHROPIC_SMALL_FAST_MODEL": "haiku-4",

"CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC": "1"

}

}

解释:

| 配置 | 作用 |

|---|---|

| ANTHROPIC_BASE_URL | 指向 LiteLLM |

| ANTHROPIC_AUTH_TOKEN | 占位key |

| ANTHROPIC_MODEL | 主模型 |

| ANTHROPIC_SMALL_FAST_MODEL | 快速模型 |

六、运行 Claude Code

进入项目目录:

claude

Claude Code 启动后:

/status

应该看到类似:

Model: sonnet-4

但实际调用的是:

gpt-5.3-codex

七、验证 Codex 是否生效

测试:

Write a Python FastAPI server with JWT auth

如果模型生成:

-

多文件项目结构

-

tests

-

requirements

说明 Codex 已经工作。

八、常见问题

1 API 400 错误

原因:

Claude Code 会发送:

reasoning.effort

一些 OpenAI 模型不支持。

解决:

使用推理模型:

o3

o3-mini

2 OpenAI 连接失败

错误:

Cannot connect to api.openai.com

解决:

配置代理:

HTTP_PROXY

HTTPS_PROXY

3 Claude Code 认证问题

如果 CLI 已登录:

claude /logout

然后重新启动。

九、进阶:多模型网关

推荐的 LiteLLM 配置:

model_list:

- model_name: sonnet-4

litellm_params:

model: openai/gpt-5.3-codex

api_key: ${OPENAI_API_KEY}

- model_name: haiku-4

litellm_params:

model: openai/gpt-4o-mini

api_key: ${OPENAI_API_KEY}

- model_name: opus-4

litellm_params:

model: openai/o3

api_key: ${OPENAI_API_KEY}

效果:

| Claude Code | 实际模型 |

|---|---|

| sonnet | codex |

| haiku | 4o-mini |

| opus | o3 |

这样可以:

-

降低成本

-

提升稳定性

-

自动路由模型

十、总结

通过 LiteLLM 可以让 Claude Code 调用任何模型,包括:

-

OpenAI

-

DeepSeek

-

Gemini

-

本地模型

最终架构:

Claude Code

↓

LiteLLM Gateway

↓

OpenAI Codex

优点:

-

不依赖 Anthropic API

-

可自由切换模型

-

支持统一 AI Gateway

这种 “LLM Gateway 架构” 正在成为 AI 开发工具的主流实践。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)