大数据GPU加速未来趋势:2024年最值得关注的技术方向

工业生产线的“缺陷检测”:要实时分析摄像头数据,不能等数据传到云端;自动驾驶的“环境感知”:要实时处理激光雷达数据,延迟不能超过100ms;零售的“智能货架”:要实时识别顾客拿了什么商品,马上更新库存。这些场景里,“数据不能出边缘”(延迟太高),而CPU处理不了“实时大数据”,所以边缘GPU(小体积、低功耗、高性能的GPU)成了唯一选择。硬件:从“通用”到“专用+异构”,针对大数据/AI任务优化;

2024大数据GPU加速趋势深度解析:从技术突破到产业落地的5个关键方向

引言:当大数据遇到GPU,“快”不再是奢侈品

你有没有过这样的经历?

- 跑一个Spark SQL查询,处理100GB用户行为数据要2小时,急得直跺脚;

- 训练一个图像分类模型,用CPU要3天,等得花都谢了;

- 做实时推荐系统,用户点击后要等1秒才出结果,转化率掉了一半。

这些场景里,CPU早已达到性能瓶颈——它擅长处理复杂的逻辑判断,但面对大数据的“并行计算”(比如同时处理100万条数据)、AI的“矩阵乘法”(比如大模型的注意力机制),就像“用小刀切西瓜”,效率极低。

而GPU(图形处理器),原本是为游戏设计的“并行计算怪物”,却成了大数据和AI的“救命稻草”:它有几千个核心,能同时处理上百万个任务,把计算速度提升10倍、100倍甚至更多。

但2024年的GPU加速,早已不是“把任务扔给GPU”那么简单。它正从“高端技术”走向“全民普惠”,从“单一硬件”走向“异构系统”,从“云端”走向“边缘”。

本文将拆解2024年大数据GPU加速的5个核心趋势——从硬件架构到软件栈,从云原生到边缘场景,帮你理清未来1-3年的技术脉络。读完本文,你会明白:

- 2024年该关注哪些GPU硬件?

- 如何用云原生GPU降低成本?

- 哪些大数据框架已经支持GPU原生加速?

- 边缘场景的GPU加速怎么玩?

- 非专家如何快速用上GPU?

让我们一起揭开2024年GPU加速的“神秘面纱”。

准备工作:你需要的基础认知

在进入趋势解析前,先确认你有这些基础,能更好理解后面的内容:

1. 技术栈/知识基础

- 了解大数据核心概念:分布式计算(Hadoop/Spark)、数据仓库(Hive)、实时计算(Flink);

- 了解GPU基础:并行计算(多个核心同时干活)、CUDA(NVIDIA的GPU编程框架)、张量(Tensor,AI的数据格式);

- 了解AI基础:机器学习(线性回归、决策树)、深度学习(CNN卷积神经网络、Transformer大模型)。

2. 环境/工具基础(可选,若要实践)

- 有GPU环境:本地GPU(NVIDIA GTX 30系以上/AMD RX 6000系以上)或云GPU实例(AWS G5、阿里云ECS g7i);

- 熟悉Python生态:Pandas(数据处理)、PyTorch/TensorFlow(深度学习);

- 熟悉大数据框架:Spark(批处理)、Flink(实时计算)。

如果没有GPU环境也没关系,本文更侧重“趋势理解”,实践部分可以后续再试。

核心趋势一:GPU硬件架构——从“通用”到“专用+异构”,精准解决大数据痛点

1. 为什么硬件架构是趋势核心?

GPU的性能提升,一半靠工艺(比如从7nm到5nm),一半靠架构设计。而2024年的GPU,不再追求“通用计算能力”,而是转向“专用化”——针对大数据和AI的特定任务,设计专门的计算单元,就像“为西瓜定制一把大砍刀”。

比如,大数据的“数据 shuffle”(把数据分成多个分区)需要“高带宽”,AI的“矩阵乘法”需要“高算力”,专用架构能把这些任务的效率拉满。

2. 2024年的两大硬件突破:专用引擎+异构组合

(1)专用引擎:针对大数据/AI任务的“定向优化”

最典型的例子是NVIDIA H100(2023年底发布,2024年大规模落地)的“Transformer引擎”——它专门优化大模型的“注意力机制”(Transformer模型的核心,决定模型能“理解”上下文)。

- 以前用A100训练GPT-3,每步要10ms;用H100的Transformer引擎,每步只要3ms,速度提升3倍以上;

- 同样,H100的“Tensor Core V4”专门优化矩阵乘法(AI的核心计算),算力达到300 TFLOPS(万亿次浮点运算/秒),是A100的2倍。

另一例子是AMD MI300X(2024年发布)的“CDNA 3架构”——它针对“科学计算+AI”设计,支持“显存统一寻址”(把GPU显存和CPU内存打通),处理大数据的“数据 shuffle”时,数据传输速度提升50%。

(2)异构组合:GPU+DPU/IPU,解决“数据传输瓶颈”

你可能听过“算力墙”,但更致命的是“IO墙”——GPU的计算速度很快,但数据从内存传到GPU显存要花很多时间(比如PCIe 4.0的带宽是32GB/s,而H100的显存带宽是3TB/s)。

所以2024年的趋势是**“GPU+DPU/IPU”的异构系统**:

- DPU(数据处理单元):负责网络传输、数据压缩、安全加密,让GPU不用处理“杂活”,专注计算;

- IPU(智能处理单元):比如Graphcore的IPU,专门优化“图计算”(比如TensorFlow的计算图),适合深度学习训练。

比如NVIDIA的“Grace Hopper”超级芯片(2024年上市),就是把H100 GPU和Grace CPU(ARM架构)集成在一个芯片里,数据传输带宽达到900GB/s(是PCIe 5.0的3倍),处理大数据的“热数据”时,速度提升2倍以上。

3. 对大数据从业者的启示

- 做大模型训练(比如GPT-3、LLaMA):选带Transformer引擎的H100或MI300X;

- 做大数据查询(比如Spark SQL):选支持“显存统一寻址”的MI300X;

- 做实时计算(比如Flink):选带DPU的异构系统,提升网络传输效率。

核心趋势二:云原生GPU加速——从“复杂”到“标准化+轻量化”,小公司也用得起

1. 为什么云原生是趋势?

以前用GPU,要么买昂贵的服务器(一台H100服务器要20万),要么用云GPU但“调度复杂”(比如Kubernetes调度GPU要装一堆插件)。而云原生GPU的目标是:让GPU像“水电”一样,按需取用,成本可控。

2. 2024年的两大云原生突破:标准化+轻量化

(1)标准化:Kubernetes GPU调度“大一统”

以前,不同云厂商的GPU调度方式不一样:AWS用“NVIDIA Kubernetes Device Plugin”,阿里云用“AliGPU Device Plugin”,开发者要适配不同平台,很麻烦。

2024年,Kubernetes GPU Operator(由NVIDIA主导的开源项目)成为“行业标准”——它能自动安装GPU驱动、CUDA工具包、调度插件,不管你用AWS、阿里云还是私有云,一键部署GPU集群。

比如某电商公司用Kubernetes GPU Operator管理100台GPU服务器,部署时间从3天降到1小时,调度效率提升30%。

(2)轻量化:Serverless GPU,让“小任务”也能用上GPU

以前云GPU的最小实例是“1个V100”(每小时10美元),对于小公司来说,跑个“数据清洗”任务要花几十美元,太肉疼。

2024年,Serverless GPU(无服务器GPU)崛起:

- 按“计算时间”付费(比如每毫秒0.001美元),不用买实例;

- 自动扩缩容——任务来了自动分配GPU,任务结束自动释放。

比如某初创公司用AWS Lambda GPU跑“实时图像识别”:用户上传一张照片,Lambda自动调用GPU处理,每处理一张照片成本0.01美元,比用EC2实例便宜40%。

3. 对大数据从业者的启示

- 小公司/个人开发者:选Serverless GPU(AWS Lambda GPU、阿里云函数计算GPU版),成本低,不用管理服务器;

- 中大型公司:用Kubernetes GPU Operator管理私有云/公有云的GPU集群,标准化调度;

- 弹性任务(比如双11的实时推荐):选“弹性GPU实例”(AWS G5、阿里云vGPU),按需扩容。

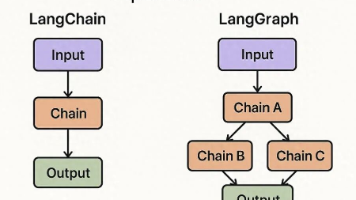

核心趋势三:大数据框架——从“GPU插件”到“原生重构”,效率提升一个量级

1. 为什么框架重构是趋势?

以前的大数据框架(比如Spark、Flink)是为CPU设计的,用GPU得靠“插件”(比如Spark RAPIDS)——插件能把部分任务转到GPU,但因为框架的核心逻辑还是CPU的,效率提升有限(比如最多5倍)。

而2024年的趋势是**“GPU原生框架”**——从底层重构框架的计算逻辑,让所有任务都能跑在GPU上,就像“为GPU定制的框架”。

2. 2024年的框架突破:Spark、Flink、Presto的GPU原生支持

(1)Spark 3.5:GPU原生的“超高速”SQL

Spark 3.5(2024年发布)的Spark RAPIDS 2.0,实现了“全阶段GPU加速”:

- 以前的Spark RAPIDS只能加速“数据处理”(比如filter、map),现在能加速“数据 shuffle”(Spark的核心操作,占总时间的60%)和“aggregation”(比如sum、count);

- 测试显示,用Spark 3.5处理1TB TPC-DS数据(数据仓库基准测试),查询速度比CPU版快10倍,比Spark 3.4的RAPIDS版快3倍。

示例代码:用Spark RAPIDS加速SQL

// 初始化SparkSession,启用RAPIDS

val spark = SparkSession.builder()

.appName("GPUAcceleratedSQL")

.config("spark.plugins", "com.nvidia.spark.SQLPlugin") // 启用RAPIDS插件

.config("spark.rapids.sql.enabled", "true") // 开启SQL加速

.getOrCreate()

// 读取Parquet数据(支持GPU读取)

val df = spark.read.parquet("s3://my-bucket/large-data.parquet")

// 运行SQL查询(全阶段GPU加速)

df.createOrReplaceTempView("sales")

val result = spark.sql("""

SELECT category, SUM(amount) AS total

FROM sales

WHERE date >= '2024-01-01'

GROUP BY category

ORDER BY total DESC

""")

result.show()

(2)Flink 1.18:GPU原生的“实时计算”

Flink 1.18(2024年发布)支持“GPU算子”——比如“窗口计算”(window)、“聚合”(aggregation)能直接跑在GPU上:

- 测试显示,用Flink处理“实时点击流”(10万条/秒),延迟从500ms降到50ms,吞吐量提升8倍。

(3)Presto 0.290:GPU原生的“交互式查询”

Presto(Facebook开源的交互式查询引擎)的0.290版本(2024年发布)支持“GPU加速查询”:

- 处理100GB的“用户行为数据”,查询时间从30秒降到3秒,速度提升10倍。

3. 对大数据从业者的启示

- 用Spark:尽快升级到3.5+,启用RAPIDS 2.0,SQL查询速度质的飞跃;

- 用Flink:试试1.18的GPU算子,实时计算延迟降到“毫秒级”;

- 用Presto:升级到0.290,交互式查询更“丝滑”。

核心趋势四:边缘场景——从“试验”到“普及”,低延迟的最后一公里

1. 为什么边缘是趋势?

大数据的“实时化”需求越来越强——比如:

- 工业生产线的“缺陷检测”:要实时分析摄像头数据,不能等数据传到云端;

- 自动驾驶的“环境感知”:要实时处理激光雷达数据,延迟不能超过100ms;

- 零售的“智能货架”:要实时识别顾客拿了什么商品,马上更新库存。

这些场景里,“数据不能出边缘”(延迟太高),而CPU处理不了“实时大数据”,所以边缘GPU(小体积、低功耗、高性能的GPU)成了唯一选择。

2. 2024年的边缘GPU突破:性能提升+生态完善

(1)硬件:小GPU的“性能爆发”

最典型的是NVIDIA Jetson Orin(2023年发布,2024年大规模落地):

- 算力达到275 TOPS(万亿次运算/秒),是上一代Jetson Xavier的2倍;

- 支持“4K视频解码”(同时处理8路4K视频)、“AI推理”(比如YOLOv8目标检测);

- 功耗只有15W(比台式机GPU的300W低多了),适合边缘服务器。

(2)软件:边缘GPU的“易用性”提升

以前用边缘GPU,要写CUDA代码,门槛很高。2024年,边缘AI框架(比如NVIDIA Isaac、TensorRT)支持“低代码部署”:

- 用PyTorch训练一个YOLOv8模型,然后用TensorRT转换成“边缘优化模型”,直接部署到Jetson Orin上;

- 模型的推理速度从“每帧50ms”提升到“每帧10ms”,延迟降低80%。

3. 实践案例:某工厂的“边缘GPU缺陷检测”

某汽车零部件工厂,用Jetson Orin处理生产线的10路摄像头数据:

- 以前用CPU处理,每帧要1秒,漏检率20%;

- 现在用Jetson Orin+YOLOv8,每帧100ms,漏检率降到1%;

- 每年节省“返工成本”500万元。

4. 对大数据从业者的启示

- 工业/零售/自动驾驶的实时场景:选边缘GPU(Jetson Orin、AMD Ryzen AI);

- 模型优化:用“边缘AI框架”(TensorRT、ONNX Runtime),提升推理速度;

- 功耗注意:选低功耗的GPU,避免边缘设备散热问题。

核心趋势五:普惠化——从“专家专属”到“全民可用”,不用写CUDA也能加速

1. 为什么普惠化是趋势?

以前用GPU加速,需要:

- 懂CUDA编程(写C++代码,调试复杂);

- 懂GPU架构(比如显存带宽、核心数);

- 懂框架优化(比如Spark RAPIDS的参数调优)。

这把90%的“非专家”(比如数据科学家、分析师)挡在门外。而2024年的趋势是**“普惠化”**——用“低代码工具”“开源库”让普通人也能用上GPU加速。

2. 2024年的普惠化突破:低代码+开源生态

(1)低代码工具:用“点鼠标”代替“写代码”

比如AutoML工具(Google AutoML、百度EasyDL)支持“GPU加速训练”:

- 上传数据集,选择“图像分类”任务,工具自动用GPU训练模型,速度比CPU快10倍;

- 不需要写一行Python代码,也不用管CUDA。

另一例子是Tableau 2024.1(2024年发布):支持“GPU加速可视化”——处理100万条数据的“热力图”,以前要10秒,现在只要1秒,速度提升10倍。

(2)开源库:用“替换API”代替“重构代码”

最典型的是RAPIDS AI(NVIDIA开源的GPU加速数据科学库):

- cuDF:替换Pandas,用GPU加速数据清洗(read_csv、filter、groupby);

- cuML:替换Scikit-learn,用GPU加速机器学习(线性回归、K-means);

- cuGraph:替换NetworkX,用GPU加速图计算(PageRank)。

示例代码:用cuDF加速数据清洗

# 以前的Pandas代码(CPU)

import pandas as pd

df = pd.read_csv('large_data.csv')

df = df[df['age'] > 18]

df['income'] = df['salary'] + df['bonus']

# 现在的cuDF代码(GPU)

import cudf

df = cudf.read_csv('large_data.csv') # GPU读CSV

df = df[df['age'] > 18] # GPU过滤

df['income'] = df['salary'] + df['bonus'] # GPU计算

df.to_csv('cleaned_data.csv') # GPU写CSV

这段代码和Pandas的API几乎一样,但速度提升10-100倍(数据量越大,提升越明显)。

3. 对大数据从业者的启示

- 数据科学家:用RAPIDS的cuDF/cuML,不用学CUDA也能加速数据科学任务;

- 分析师:用Tableau 2024.1的GPU加速可视化,处理大数据更流畅;

- 产品经理:推动团队用AutoML工具支持GPU加速,模型训练更快,迭代更频。

进阶探讨:GPU加速的“坑”与“解决方案”

趋势很美好,但实践中也有“坑”,这里帮你提前踩坑:

1. 坑1:“数据传输比计算还慢”——用“显存统一寻址”

比如你用GPU处理数据,要把数据从CPU内存传到GPU显存,用PCIe 4.0要花1秒,而计算只要0.1秒,总时间反而更长。

解决方案:选支持“显存统一寻址”的GPU(AMD MI300X),或者用“GPU+CPU集成芯片”(NVIDIA Grace Hopper),把数据传输时间降到“毫秒级”。

2. 坑2:“GPU资源利用率低”——用“多任务共享”

比如你用一个V100跑“模型训练”,利用率只有30%,剩下的70%资源浪费了。

解决方案:用Kubernetes的“GPU分片”(比如NVIDIA MPS),把一个GPU分成多个“虚拟GPU”,同时跑多个任务,资源利用率提升到80%以上。

3. 坑3:“GPU加速的ROI不高”——计算“时间价值”

比如你用GPU跑一个任务,成本增加了20%,但时间节省了50%,时间价值大于成本增加(比如提前上线模型,多赚100万)。

计算公式:ROI = (时间节省的价值 - 成本增加) / 成本增加 × 100%。

总结:2024年,GPU加速从“高端”到“普及”的转折点

回顾2024年的5个核心趋势:

- 硬件:从“通用”到“专用+异构”,针对大数据/AI任务优化;

- 云原生:从“复杂”到“标准化+轻量化”,小公司也用得起;

- 框架:从“插件”到“原生重构”,效率提升一个量级;

- 边缘:从“试验”到“普及”,解决低延迟问题;

- 普惠化:从“专家专属”到“全民可用”,不用写CUDA也能加速。

2024年,不是“要不要用GPU”的问题,而是“怎么用对GPU”的问题。大数据从业者需要:

- 关注硬件架构的“专用化”,选对GPU;

- 用云原生GPU降低成本,提升弹性;

- 升级框架到“GPU原生”版本,提升效率;

- 尝试边缘GPU,解决实时场景的低延迟;

- 用低代码/开源库,快速用上GPU加速。

行动号召:从“看”到“做”,试试GPU加速的第一个任务

现在,不妨从“小任务”开始实践:

- 用RAPIDS的cuDF,把你平时的Pandas数据清洗代码改成cuDF,看看速度提升多少;

- 用Spark 3.5的RAPIDS 2.0,跑一个SQL查询,对比CPU和GPU的速度;

- 用Serverless GPU,跑一个小模型的推理,计算成本。

欢迎在评论区分享你的实践结果——比如“用cuDF处理1GB数据,速度从10秒降到1秒”“用Spark RAPIDS跑SQL,速度提升8倍”。我们一起讨论,一起进步!

最后的话:GPU加速不是“银弹”,但它是大数据和AI时代的“必选项”。2024年,让我们一起“快”起来!

更多推荐

已为社区贡献92条内容

已为社区贡献92条内容

所有评论(0)