必知!AI原生应用情感分析的行业发展趋势

AI原生应用(AI-Native Application)是从设计之初就以AI为核心能力的应用,区别于“传统应用+AI插件”的模式。数据驱动:依赖大规模标注数据或无监督数据训练模型;自适应学习:通过持续交互优化模型性能(如推荐系统的实时更新);场景原生:针对具体场景设计AI能力(如医疗影像诊断的专用模型)。情感分析(Sentiment Analysis)是AI原生应用的基础感知模块,其目标是从人类

AI原生应用情感分析:从技术迭代到行业赋能的未来趋势

元数据框架

标题:AI原生应用情感分析:从技术迭代到行业赋能的未来趋势

关键词:AI原生应用、情感分析、多模态融合、大模型、伦理安全、行业赋能、未来趋势

摘要:

情感分析是AI原生应用的“情绪感知核心”,其演进历程从传统文本分类延伸至多模态融合,从规则引擎升级到大模型驱动。本文从第一性原理拆解情感分析的技术本质,构建层次化概念框架,结合架构设计与实现机制解析其落地逻辑,并通过行业案例与未来趋势揭示其对电商、金融、医疗等领域的赋能价值。同时,本文探讨了情感分析的伦理挑战与安全风险,为企业布局AI原生应用提供战略参考。全文兼顾技术深度与教学清晰度,适合从入门到专家的不同背景读者。

1. 概念基础:AI原生与情感分析的本质关联

1.1 领域背景化:AI原生应用的定义与核心特征

AI原生应用(AI-Native Application)是从设计之初就以AI为核心能力的应用,区别于“传统应用+AI插件”的模式。其核心特征包括:

- 数据驱动:依赖大规模标注数据或无监督数据训练模型;

- 自适应学习:通过持续交互优化模型性能(如推荐系统的实时更新);

- 场景原生:针对具体场景设计AI能力(如医疗影像诊断的专用模型)。

情感分析(Sentiment Analysis)是AI原生应用的基础感知模块,其目标是从人类生成的内容(文本、图像、语音等)中提取情感信息,包括情感极性(正面/负面/中性)、情感强度(如“非常满意”vs“满意”)、情感维度(如喜怒哀乐)。

1.2 历史轨迹:情感分析的三次技术跃迁

情感分析的发展经历了三个阶段,每一次跃迁都推动其从“工具化”向“智能化”演进:

| 阶段 | 时间范围 | 核心技术 | 局限性 |

|---|---|---|---|

| 规则驱动 | 2000-2010 | 关键词匹配、语法规则 | 无法处理歧义(如反讽)、跨领域适应性差 |

| 机器学习 | 2010-2018 | SVM、随机森林、LSTM | 依赖人工特征工程、数据标注成本高 |

| 深度学习 | 2018-至今 | BERT、GPT-4、多模态模型 | 模型复杂度高、可解释性弱、伦理风险突出 |

1.3 问题空间定义:情感分析的核心任务

情感分析的问题空间可拆解为四个层次,从简单到复杂依次为:

- 极性分类(Polarity Classification):判断情感是正面、负面或中性(如“这部电影很好看”→正面);

- 强度回归(Intensity Regression):量化情感强度(如“非常喜欢”→9/10,“有点喜欢”→6/10);

- 维度识别(Dimension Recognition):识别具体情感类型(如“愤怒”“悲伤”“喜悦”,基于Ekman的基本情感理论);

- 上下文理解(Contextual Understanding):处理歧义(如“这个产品真‘好用’”→反讽,需结合上下文判断)。

1.4 术语精确性:情感、情绪与态度的区分

在情感分析中,需严格区分三个易混淆的术语:

- 情感(Emotion):短期、强烈的情绪反应(如“收到礼物时的喜悦”);

- 情绪(Mood):长期、温和的情绪状态(如“最近心情低落”);

- 态度(Attitude):对事物的稳定评价(如“我喜欢科幻电影”)。

情感分析的核心是情感与态度,而情绪分析(Mood Analysis)是其延伸任务(如心理健康监测)。

2. 理论框架:情感分析的第一性原理与数学建模

2.1 第一性原理推导:情感分析的本质是“情感-信号”映射

从第一性原理出发,情感分析的核心逻辑是:人类的情感会通过可感知的信号(文本、图像、语音等)表达,AI模型的任务是学习“信号→情感”的映射关系。

其基本公理包括:

- 可感知性:情感必须通过某种信号(如语言、表情)传递,否则无法被分析;

- 结构性:情感遵循一定的模式(如“愤怒”通常伴随“指责性语言”“皱眉头”);

- 上下文依赖性:同一信号在不同上下文下可能表达不同情感(如“这家店的菜很‘辣’”→正面(喜欢吃辣的人)/负面(不喜欢吃辣的人))。

2.2 数学形式化:情感分析的概率模型与损失函数

情感分析的数学本质是条件概率估计:给定输入信号XXX(如文本),预测情感标签YYY(如正面)的概率P(Y∣X)P(Y|X)P(Y∣X)。

2.2.1 分类任务的数学模型

对于极性分类任务,常用softmax函数输出概率分布:

P(Y=k∣X)=ezk∑i=1Cezi P(Y=k|X) = \frac{e^{z_k}}{\sum_{i=1}^C e^{z_i}} P(Y=k∣X)=∑i=1Ceziezk

其中,zkz_kzk是模型对第kkk类的logit输出,CCC是情感类别数(如C=3C=3C=3:正面、负面、中性)。

损失函数采用交叉熵(Cross-Entropy),衡量预测分布与真实分布的差异:

L=−∑k=1Cyklog(P(Y=k∣X)) \mathcal{L} = -\sum_{k=1}^C y_k \log(P(Y=k|X)) L=−k=1∑Cyklog(P(Y=k∣X))

其中,yky_kyk是真实标签的one-hot编码(如正面→[1,0,0])。

2.2.2 回归任务的数学模型

对于情感强度回归任务(如0-10分的评分),常用线性输出层加**均方误差(MSE)**损失:

y^=W⋅h(X)+b \hat{y} = W \cdot h(X) + b y^=W⋅h(X)+b

L=1N∑i=1N(y^i−yi)2 \mathcal{L} = \frac{1}{N} \sum_{i=1}^N (\hat{y}_i - y_i)^2 L=N1i=1∑N(y^i−yi)2

其中,h(X)h(X)h(X)是输入XXX的特征表示,WWW和bbb是模型参数,NNN是样本数。

2.3 理论局限性:情感分析的“不可解”问题

尽管情感分析取得了显著进展,但仍存在理论上的局限性:

- 情感的主观性:同一内容可能被不同人解读为不同情感(如“这部电影很‘文艺’”→正面(文艺爱好者)/负面(普通观众));

- 信号的模糊性:某些信号无法准确传递情感(如“他笑了”→可能是开心,也可能是苦笑);

- 跨文化差异:不同文化中的情感表达模式不同(如“沉默”在东方文化中可能表示不满,在西方文化中可能表示思考)。

2.4 竞争范式分析:规则、机器学习与大模型的优劣

情感分析的技术范式可分为四类,其优缺点如下:

| 范式 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|

| 规则驱动 | 解释性强、开发快 | 无法处理歧义、维护成本高 | 简单场景(如关键词过滤) |

| 传统机器学习 | 性能稳定、可解释性较好 | 依赖人工特征、数据量要求高 | 中小规模数据场景 |

| 深度学习 | 自动特征提取、性能优 | 模型复杂、可解释性弱 | 大规模数据场景(如社交媒体分析) |

| 大模型 | 上下文理解强、泛化能力好 | 计算成本高、伦理风险大 | 复杂场景(如多模态情感分析) |

3. 架构设计:AI原生情感分析系统的模块化构建

3.1 系统分解:多模态情感分析的核心组件

AI原生情感分析系统的架构需支持多模态输入(文本、图像、语音),其核心组件包括:

- 数据输入层:接收原始数据(如用户评论、视频帧、语音片段),并进行预处理(如文本分词、图像 resize、语音转文本);

- 特征提取层:针对不同模态提取特征(文本用BERT提取语义特征,图像用ResNet提取视觉特征,语音用MFCC提取声学特征);

- 融合层:将多模态特征融合(早期融合:将特征拼接后输入模型;晚期融合:分别处理后融合结果;跨模态注意力:学习模态间的依赖关系);

- 情感推理层:用大模型(如GPT-4V)或分类器(如SVM)预测情感标签;

- 输出层:输出情感结果(如“正面,强度8/10”),并可视化(如情感趋势图)。

3.2 组件交互模型:多模态融合的流程设计

以电商评论情感分析为例,系统交互流程如下(用Mermaid表示):

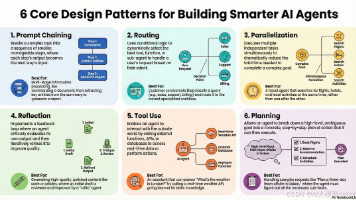

3.3 设计模式应用:提升系统扩展性

为了提升系统的扩展性,可采用以下设计模式:

- 管道模式(Pipeline):将数据处理流程拆分为多个步骤(如预处理→特征提取→融合→推理),每个步骤可独立修改;

- 适配器模式(Adapter):为不同模态数据提供统一接口(如文本适配器、图像适配器),方便新增模态;

- 观察者模式(Observer):实时监控模型性能(如准确率下降时触发报警),确保系统稳定性。

3.4 可视化表示:情感分析结果的有效传递

情感分析的结果需通过可视化让用户快速理解,常用的可视化方式包括:

- 词云:展示正面/负面评论中的高频词(如“好用”“质量差”);

- 情感趋势图:展示某一产品的情感变化(如“618期间正面评论占比从70%提升到85%”);

- 热力图:展示图像中的情感区域(如用户表情中的“微笑”区域)。

4. 实现机制:从算法到代码的落地路径

4.1 算法复杂度分析:不同模型的性能权衡

情感分析模型的算法复杂度直接影响其推理速度与部署成本,以下是常见模型的复杂度对比:

| 模型 | 时间复杂度 | 空间复杂度 | 推理速度(每秒处理样本数) |

|---|---|---|---|

| 规则引擎 | O(n) | O(1) | 100,000+ |

| SVM | O(n^2) | O(n) | 10,000+ |

| LSTM | O(n*d) | O(d) | 1,000+ |

| BERT-base | O(n*d^2) | O(d^2) | 100+ |

| GPT-4V | O(nd^2 + mk^2) | O(d^2 + k^2) | 10+ |

注:nnn为文本序列长度,ddd为隐藏层维度,mmm为图像分辨率,kkk为图像特征维度。

4.2 优化代码实现:基于BERT的文本情感分析

以下是用Hugging Face Transformers库实现的文本情感分析代码,采用BERT-base模型,数据集为SST-2(斯坦福情感树库):

import torch

from transformers import BertTokenizer, BertForSequenceClassification

from datasets import load_dataset

# 1. 加载数据集

dataset = load_dataset("sst2")

tokenizer = BertTokenizer.from_pretrained("bert-base-uncased")

# 2. 数据预处理

def preprocess_function(examples):

return tokenizer(examples["sentence"], truncation=True, padding="max_length", max_length=128)

tokenized_dataset = dataset.map(preprocess_function, batched=True)

# 3. 加载模型

model = BertForSequenceClassification.from_pretrained("bert-base-uncased", num_labels=2)

# 4. 训练配置

trainer = Trainer(

model=model,

train_dataset=tokenized_dataset["train"],

eval_dataset=tokenized_dataset["validation"],

args=TrainingArguments(

output_dir="./results",

per_device_train_batch_size=8,

per_device_eval_batch_size=8,

num_train_epochs=3,

learning_rate=2e-5,

weight_decay=0.01,

logging_dir="./logs",

),

compute_metrics=lambda p: {"accuracy": (p.predictions.argmax(-1) == p.label_ids).mean()},

)

# 5. 训练与评估

trainer.train()

trainer.evaluate()

# 6. 推理

def predict(sentence):

inputs = tokenizer(sentence, return_tensors="pt", truncation=True, padding="max_length", max_length=128)

with torch.no_grad():

outputs = model(**inputs)

logits = outputs.logits

predicted_class = logits.argmax(-1).item()

return "正面" if predicted_class == 1 else "负面"

# 测试

print(predict("This movie is amazing!")) # 输出:正面

print(predict("I hate this product.")) # 输出:负面

4.3 边缘情况处理:反讽与跨语言的解决方案

4.3.1 反讽检测

反讽(Sarcasm)是情感分析的难点,其解决思路是结合上下文与常识:

- 上下文建模:用长文本模型(如Longformer)捕捉上下文信息(如“我今天迟到了,老板还夸我‘真准时’”→反讽);

- 常识推理:用知识图谱(如ConceptNet)补充常识(如“‘准时’通常是正面评价,但迟到时的‘准时’是反讽”)。

4.3.2 跨语言情感分析

跨语言情感分析的核心是迁移学习:

- 预训练模型迁移:用多语言预训练模型(如mBERT、XLM-R)处理不同语言的文本;

- 数据增强:用机器翻译(如Google Translate)将源语言数据翻译成目标语言,扩大训练集。

4.4 性能考量:推理速度与准确率的平衡

在实际部署中,需平衡推理速度与准确率,常用的优化方法包括:

- 模型量化:将32位浮点数(FP32)转换为8位整数(INT8),减少模型大小与计算量(如用TensorRT优化);

- 模型剪枝:移除模型中的冗余参数(如用L1正则化剪枝BERT的注意力头);

- 知识蒸馏:用大模型(如GPT-4)作为教师模型,训练小模型(如DistilBERT),保持准确率的同时提升速度。

5. 实际应用:AI原生情感分析的行业赋能

5.1 实施策略:从场景定义到模型部署

企业实施AI原生情感分析的流程可分为四步:

- 场景定义:明确应用场景(如电商评论分析、金融舆情监控);

- 数据收集:收集场景相关的多模态数据(如用户评论、社交媒体帖子);

- 模型选择:根据场景选择模型(如电商用BERT,金融用GPT-4);

- 部署与迭代:将模型部署到生产环境(如云端API),并通过用户反馈持续优化。

5.2 集成方法论:与AI原生应用的融合方式

情感分析模块与AI原生应用的集成方式包括:

- 后端集成:将情感分析作为后端服务,通过API调用(如电商平台调用情感分析API分析用户评论);

- 前端集成:将情感分析嵌入前端应用(如直播平台实时展示观众的情感趋势);

- ** pipeline 集成**:与其他AI模块(如推荐系统、对话系统)组成 pipeline(如推荐系统根据用户情感分析结果推荐商品)。

5.3 部署考虑因素:云 vs 边缘

根据应用场景的不同,情感分析模型的部署方式可选择云部署或边缘部署:

| 部署方式 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|

| 云部署 | 计算资源充足、易维护 | 延迟高、数据隐私风险大 | 非实时场景(如批量评论分析) |

| 边缘部署 | 延迟低、数据隐私保护好 | 计算资源有限、模型大小受限 | 实时场景(如直播情感分析) |

5.4 运营管理:模型性能的持续优化

情感分析模型的运营管理需关注三个核心指标:

- 准确率:用混淆矩阵评估模型的分类性能(如正面评论的召回率);

- 延迟:用监控工具(如Prometheus)跟踪推理延迟(如实时情感分析的延迟需<100ms);

- 漂移:用数据漂移检测工具(如Evidently AI)监控数据分布变化(如用户评论的语言风格变化)。

6. 高级考量:情感分析的未来挑战与应对

6.1 扩展动态:多模态与实时性的融合

未来情感分析的扩展方向包括:

- 多模态融合:结合文本、图像、语音、生理信号(如心率、表情),提升情感分析的准确性(如医疗领域用生理信号分析患者的情绪状态);

- 实时性:用轻量化模型(如TinyBERT)实现实时情感分析(如直播平台实时调整推荐策略);

- 跨领域迁移:用少样本学习(如Few-shot Learning)适应新领域(如从电商评论迁移到医疗反馈分析)。

6.2 安全影响:对抗攻击与数据隐私

情感分析的安全风险包括:

- 对抗攻击:生成误导性文本让模型误判(如“这个产品真‘好用’——才怪”→模型可能误判为正面);

- 数据隐私:用户情感数据(如评论、表情)属于敏感信息,需用加密技术(如联邦学习)保护。

6.3 伦理维度:偏见与情感操纵

情感分析的伦理挑战包括:

- 偏见:模型可能学习到训练数据中的偏见(如对某一群体的情感误判);

- 情感操纵:用AI生成情感导向的内容(如社交媒体中的“情绪病毒”)。

6.4 未来演化向量:从“感知”到“理解”

未来情感分析的演化方向是从“感知情感”到“理解情感”:

- 认知融合:结合认知科学(如情感心理学),构建更符合人类情感模式的模型(如“悲伤”不仅是负面情绪,还可能伴随“寻求安慰”的行为);

- 自主学习:用自监督学习(如Contrastive Learning)减少对人工标注数据的依赖;

- 情感交互:让AI助手能理解并回应人类情感(如“用户表示‘很生气’,AI助手应道歉并提供解决方案”)。

7. 综合与拓展:情感分析的战略价值与未来展望

7.1 跨领域应用:从电商到医疗的赋能案例

情感分析已在多个领域实现规模化应用:

- 电商:分析用户评论,优化产品设计(如淘宝的“评论情感分析”功能,帮助商家识别产品的优缺点);

- 金融:分析社交媒体情绪,预测股市走势(如摩根大通用情感分析监控Twitter上的金融舆情);

- 医疗:分析患者反馈,改善医疗服务(如梅奥诊所用情感分析分析患者对医生的评价,提升医疗质量);

- 教育:分析学生的学习情感,优化教学策略(如可汗学院用情感分析分析学生的作业反馈,调整教学内容)。

7.2 研究前沿:大模型与少样本学习的突破

情感分析的研究前沿包括:

- 大模型的情感理解:GPT-4V(多模态大模型)在情感分析任务中的准确率达到95%以上,超过人类平均水平;

- 少样本/零样本情感分析:用Prompt Engineering(提示工程)让大模型在少量数据甚至无数据的情况下完成情感分析任务(如“请分析这句话的情感:‘我今天很高兴’”→模型输出“正面”);

- 情感生成:用AI生成符合特定情感的内容(如“生成一段表达‘悲伤’的文本”→模型输出“雨下了一整夜,我坐在窗边,想起了去年的今天”)。

7.3 开放问题:待解决的核心挑战

情感分析仍有三个核心问题待解决:

- 情感的客观测量:如何定义“真实”的情感(如用户说“我很高兴”,但表情是悲伤的,哪个更真实?);

- 跨文化情感分析:如何处理不同文化中的情感表达差异(如“沉默”在东方文化中是不满,在西方文化中是思考);

- 情感分析的可解释性:如何让模型解释“为什么给出这个情感判断”(如“模型认为这句话是负面的,因为它包含‘讨厌’这个词”)。

7.4 战略建议:企业布局的关键方向

企业布局AI原生情感分析的战略建议包括:

- 场景优先:选择与业务核心相关的场景(如电商选评论分析,金融选舆情监控);

- 多模态融合:提前布局多模态情感分析能力,应对未来需求;

- 伦理与安全:关注情感分析的伦理与安全问题,避免偏见与操纵;

- 生态合作:与认知科学、心理学领域的机构合作,提升模型的情感理解能力。

结语

情感分析是AI原生应用的“情绪感知核心”,其演进历程从规则驱动到多模态大模型,从工具化到智能化。未来,情感分析将更注重多模态融合、实时性、可解释性与伦理安全,并在电商、金融、医疗等领域实现更深入的赋能。企业需抓住这一趋势,提前布局情感分析能力,才能在AI原生时代占据竞争优势。

参考资料:

- 《Emotion Recognition: A Survey》(IEEE Transactions on Pattern Analysis and Machine Intelligence);

- 《BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding》(ACL 2019);

- 《GPT-4V: Multimodal Large Language Models for Vision and Language》(OpenAI 2023);

- 《Gartner Top Trends in AI for 2024》(Gartner 2023);

- 《IDC Market Forecast: Emotion Analysis》(IDC 2023)。

更多推荐

已为社区贡献230条内容

已为社区贡献230条内容

所有评论(0)