详解InternVLA-A1:机器人操作中统一理解、生成和动作

上海AI Lab提出InternVLA-A1模型,通过统一理解、生成与动作的混合Transformer架构,解决机器人操作中认知不足与自适应能力缺乏的瓶颈问题。模型采用理解、生成、动作三位专家协同工作:理解专家处理多模态输入获取语义信息,生成专家预测未来视觉状态,动作专家结合预测动态生成控制指令。训练采用两阶段策略,结合仿真与真实数据优化视觉预测与流匹配动作生成目标。实验在10项静态和动态操作任务

论文:InternVLA-A1: Unifying Understanding, Generation and Action for Robotic Manipulation

机构:上海AI Lab

1. 介绍

现有策略的泛化瓶颈源于两个主要问题:物理世界认知不足和缺乏自适应操作能力。解决第一个挑战需要集成基础模型,如多模态大型语言模型(MLLM)或世界模型,为了增强认知能力,同时解决后者需要大规模和多样化的机器人动作数据集用于技能学习。实现通用策略需要一种协同策略,既推进模型架构,又推进训练数据。

关于模型架构,流行的通用策略,如𝜋0,𝜋0.5和GR 00 T N1/N1.5,是建立在MLLM上的,通过LLM将视觉数据映射到文本特征空间,赋予了它们强大的语义理解能力,但文本令牌无法有效建模物理定律,导致在物理动力学推理上存在缺陷。因此,这些策略通常用于感知到动作的映射,而不是推理在运动和接触下的状态演变。因此,开发一种将语义理解与鲁棒预测动态紧密耦合的统一体系结构对于可靠的动态感知操纵至关重要

关于训练数据,现有的VLA模型通过扩大大型真实机器人数据集而获得了适应性,而当前的通用策略严重依赖于大规模真实机器人数据。真机数据可以捕捉端到端学习所必需的真实物理动力学。常见的真机数据包括RT-1、RT-1、Open X-Embodiment等,但进一步扩展真实机器人数据集并覆盖大规模长尾场景变化是昂贵且低效的。InternData-A1验证了大规模和高保真的仿真数据可以有效地支持VLA模型的预训练。然而,仿真数据不可避免地存在模拟与真实的差距,特别是在接触丰富的动态。因此,协同仿真的多样性与真实世界数据的物理保真度提出了一个有前途的途径,以克服这些各自的局限性。

2. 模型架构

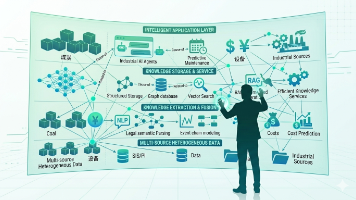

InternVLA-A1采用MoT(The Mixture-of-Transformers)架构,将场景理解,视觉预见和动作执行无缝集成在单个框架中。

-

理解专家首先处理多模态输入以捕获语义上下文信息

-

生成专家通过预测未来的视觉状态来模拟任务的演变。

-

动作专家将这些预测动态与语义上下文相结合,利用流匹配生成精确的机器人控制命令。

InternVLA-A1中的三位专家都采用了仅解码器的Transformer架构。

理解专家:采用了InternVL 3或Qwen 3-VL。处理管道:多视图观察被视觉编码器编码为视觉token,而语言指令𝑙使用文本标记器被转换为文本token。这些视觉和文本token随后由理解专家的Transformer块处理,生成语义embeddings。这些embeddings充当共享的上下文记忆,下游专家通过masked self-attention可访问该共享的上下文记忆,使得生成和动作专家在预测未来的潜伏和控制命令时能够关注语义场景上下文。

生成专家:主流图像或视频生成架构,无论是基于diffusion还是next-token prediction,对于端到端控制来说通常计算量太大,对于高动态场景缺乏足够的实时性能。

Generation Expert的详细架构设计如图3所示。具体来说,我们将扩展三个关键细节:输入令牌化、令牌压缩和并行解码。

- 输入令牌化:输入图像包括一个头部视图和两个手腕视图。为了捕捉时间动态,我们从两个时间戳中采样帧:当前时间步长𝑡和历史时间步𝑡-15。这导致总共6个输入图像,每个图像的分辨率为256 × 256。为了保留细粒度的空间结构和像素级保真度,生成专家采用了基于VAE的tokenizer。具体来说,我们利用COSMOS CI 8 ×8连续VAE图像标记器来编码这些输入图像,每个图像都被编码为32 × 32的潜在网格,导致每个图像有1024个token。将这1024 × 6个潜在标记直接输入生成专家会导致序列长度过大,影响推理效率和训练收敛,因此需要对标记进行压缩

- token压缩:应用8×8内核的卷积层来进行下采样,将每个图像的表示减少到4 × 4(16个token)。因此,6幅图像的输入序列(3个视图× 2个时间戳)被压缩为96个token。然后这些令牌通过投影仪与Transformer块的隐藏维度对齐。在Transformer块内,来自生成专家的token通过统一的masked 自注意机制来关注自身和理解专家的token,利用前面的理解专家标记作为KV缓存。

- 并行解码:在Transformer处理之后,输出仍然是96个标记的序列。我们沿时间轴应用时间平均池化沿着来聚合来自两个时间戳的信息,从而产生表示三个视图的48个标记(每个视图16个toke)。这些标记由投影仪处理,随后经由反卷积层上采样回到32 × 32。最后,COSMOS VAE解码器重建预测的未来帧(对应于𝑡+15)。值得注意的是,我们的方法避免了自回归下一个令牌预测。相反,我们采用单向前并行解码策略,同时生成未来帧的所有令牌。

动作专家:动作专家根据理解专家和生成专家产生的潜在特征,结合本体感受状态信息,预测出目标动作组块。采用一个流匹配目标来训练VLA模型。

注意力机制:信息流按照理解→生成→动作顺序,在后面的块中的token可以参与所有前面的块,而前面的块不能参与前面的块(如图所示)。在理解专家和生成专家的Transformer块中,token是完全双向参与的,不是 causal mask。由动作专家的Transformer块处理的令牌被分成状态令牌和动作令牌。状态令牌只关注自己和来自先前块的令牌,而动作令牌关注状态令牌、先前块令牌和彼此。

3. 目标优化

训练过程包括两个连续的阶段:预训练和后训练。

尽管这两个阶段使用不同的数据源和训练超参,但它们共享统一的优化框架和相同的目标。在两个阶段中,共同优化模型的两个关键目标:视觉预测生成和动作预测。

-

视觉预测生成。为了赋予模型对未来视觉状态的预测能力,我们训练生成专家来预测未来帧的潜在表示。让𝜙cosmos表示COSMOS VAE编码器,𝑧𝑡 = 𝜙 cosmos(𝑜𝑡)表示COSMOS潜在特征。在当前和历史观测{ot-m,ot}以及理解前缀hund的条件下,生成专家预测未来时间步t+m的潜在特征 Zt+m。

其中,𝑓gen表示生成专家,预测的未来 latent。sg[·]表示停止梯度操作,因为COSMOS VAE encoder 是冻结 的,不希望更新它。hund=𝑓und(𝑙,𝑜𝑡),代表视觉和文本token经过理解专家的Transformer块处理生成的 emdeddings。𝜉1=(𝑜𝑡−𝑚, 𝑜𝑡, 𝑜𝑡+𝑚, 𝑙)核心:训练 Generation expert 根据当前视觉状态和场景理解,预测未来视觉 latent,并用 MSE 监督。

-

基于流匹配的动作预测。由于同一个视觉状态可能对应多个合理动作(multi-modal),采用直接回归会进行平均,所以采用流匹配。

训练阶段:

构造 噪声-动作插值:

其中,ϵ∼N(0,I)。当τ = 0时,aτ = 真实动作,当τ = 1,aτ = 纯噪声。这个路径是:action → noise

优化目标如下:

𝑞t是机器人状态,动作预测依赖:视觉理解,未来预测,机器人状态。

模型学会:当前 noisy action 应该往哪里移动,可以使得:noise → action

推理阶段:

-

损失函数: Ltotal = λ ·Lgen + Lact

Lgen学会预测未来视觉,Lact学会生成动作。能够确保跨模态的表征一致性,实现动作-环境动态的隐式因果建模,并促进跨模态知识迁移,从而增强泛化能力,让模型学会:动作 → 环境变化→ 下一步动作

4. 实验细节

详细配置和参数见表

分两个阶段训练InternVLA-A1:在异构数据集上进行大规模的预训练阶段,然后是特定于任务的后训练阶段。

历史帧和当前帧之间以及未来帧和当前帧之间的间隔m被设置为15

5. 数据集

在混合的异构数据源上预训练模型,包括合成仿真数据、真实世界的机器人数据和人类视频

仿真数据:InternData-A1,RoboTwin中提出的仿真数据集

真机数据:开源的AgiBot-World数据集和RoboMind,有助于弥合模拟到真实的差距。

自我中心的人类视频:EgoDex数据集,这类视频在类似机器人的环境中具有相似的视角和多样化的交互功能

注意:人类视频只参与生成专家的更新和损失计算,忽略动作专家的损失Lact

6. 实验

物理机器人:Agibot Genie-1、ARX Lift-2和ARX AC One

任务设置:

-

静态操作任务:拉链袋,拧开瓶盖,做三明治,操作烤箱,分类零件,分类垃圾,清扫垃圾,擦拭污渍,放置马克笔,放置鲜花。

-

动态操作任务:快速排序任务和动态配料拣选任务

6.1 静态操作任务的评估

6.2 动态操作任务的评估

-

在快速排序任务中,机器人必须首先确定包装标签是否朝上。如果标签朝下,则启动四步序列:右臂首先沿输送机运动的方向沿着执行“追逐”抓取,接着翻转包装,之后左臂执行“等待”抓取。最后,当标签朝上时,机器人将跳过翻转过程,直接进入最后两个步骤。

-

在In-motion自动配料拣选任务中,两个机器人协调抓取组装牛肉三明治所需的配料,由两片面包、一块牛排和一片生菜组成

结果显示了InternVLA-A1对环境动态和运动诱导的分布变化的鲁棒性,将前瞻性指导决策转化为动态场景中的可靠闭环控制。

6.3 仿真基准的评估

还在RoboTwin 2.0上评估了InternVLA-A1基准测试,涵盖轻松(clean)和困难(域随机化)下的50个双手任务所有模型都在总共27500个演示中进行了微调,包括2500个干净和25000个随机episodes。如图7所示,InternVLA-A1(3B)在简单和困难设置中均𝜋以9.4%和10.1%的裕度显著优于0,并且超过强𝜋0.5基线2.6%。

6.4 消融实验

-

数据集

异构数据源上进行联合预训练(人类视频,合成数据和真实世界的演示)实现了最佳的整体性能,并大大提高了真实世界的操作性能

-

生成专家的影响

删除生成专家将平均成功率从77.0%显著降低到57.6%,

6.5 可视化

由InternVLA-A1生成的头视未来预测如图10所示。如示例所示,预测牺牲了一些高频视觉细节。这是一个故意的设计选择,优先考虑推理效率而不是像素级粒度。尽管如此,该模型准确地捕获了基本的运动趋势和动态。我们认为,当将视觉预见生成模块集成到操作策略中时,高频细节或视觉清晰度是次要的;最重要的是潜在特征封装了足够的指导信息来指导动作执行。

7. 总结

提出了InternVLA-A1,这是一个统一的框架,通过混合变形transformer(MoT)设计集成了场景理解,视觉预见生成和动作执行。

该架构将语义推理与动态预测相结合,能够在异构数据源(人类视频、合成数据和真机数据)上进行有效的联合训练,因此,InternVLA-A1在静态操作、动态操作和仿真基准测试中实现了一致的鲁棒性,在高度动态的场景中具有特别强的增益。

尽管取得了这些进步,但仍然存在两个主要局限性。首先,理解专家没有与大规模多模态VQA数据联合训练,这削弱了一般语义推理和复杂的指令遵循。其次,为了确保视觉预见生成模块的有效推理,我们牺牲了图像预测的保真度,限制生成的未来帧的粒度。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)