智能体开发实战:平台、框架与工程化

还在为 AI Agent 开发门槛高、落地难发愁?这篇文章一次性打通无代码 / 低代码平台、LangChain Agent、多智能体框架、端侧本地化四大核心路径,从 Coze、Dify 到 CrewAI、Ollama,从快速搭建到深度定制,带你从 0 到 1 掌握智能体全栈开发能力,让 AI Agent 从概念真正落地到业务与应用。

目录

1.无代码 / 低代码平台

1. 大模型官方平台

Coze

1.进入扣子编程

2.点击创建即可

3.在模板商店可以看见扣子官方搭建的"扣子应用搭建快速入门",可以复制到自己的个人空间,在项目开发中查看,可快速入门扣子应用的搭建

OpenAI GPTs

GPTs(Custom GPT)是 OpenAI 推出的、ChatGPT 的零代码定制化版本,普通人无需编程,就能打造专属 AI 助手,也可在 GPT Store 分享 / 使用他人创建的 GPTsOpenAI。

2. 企业级/开源低代码平台

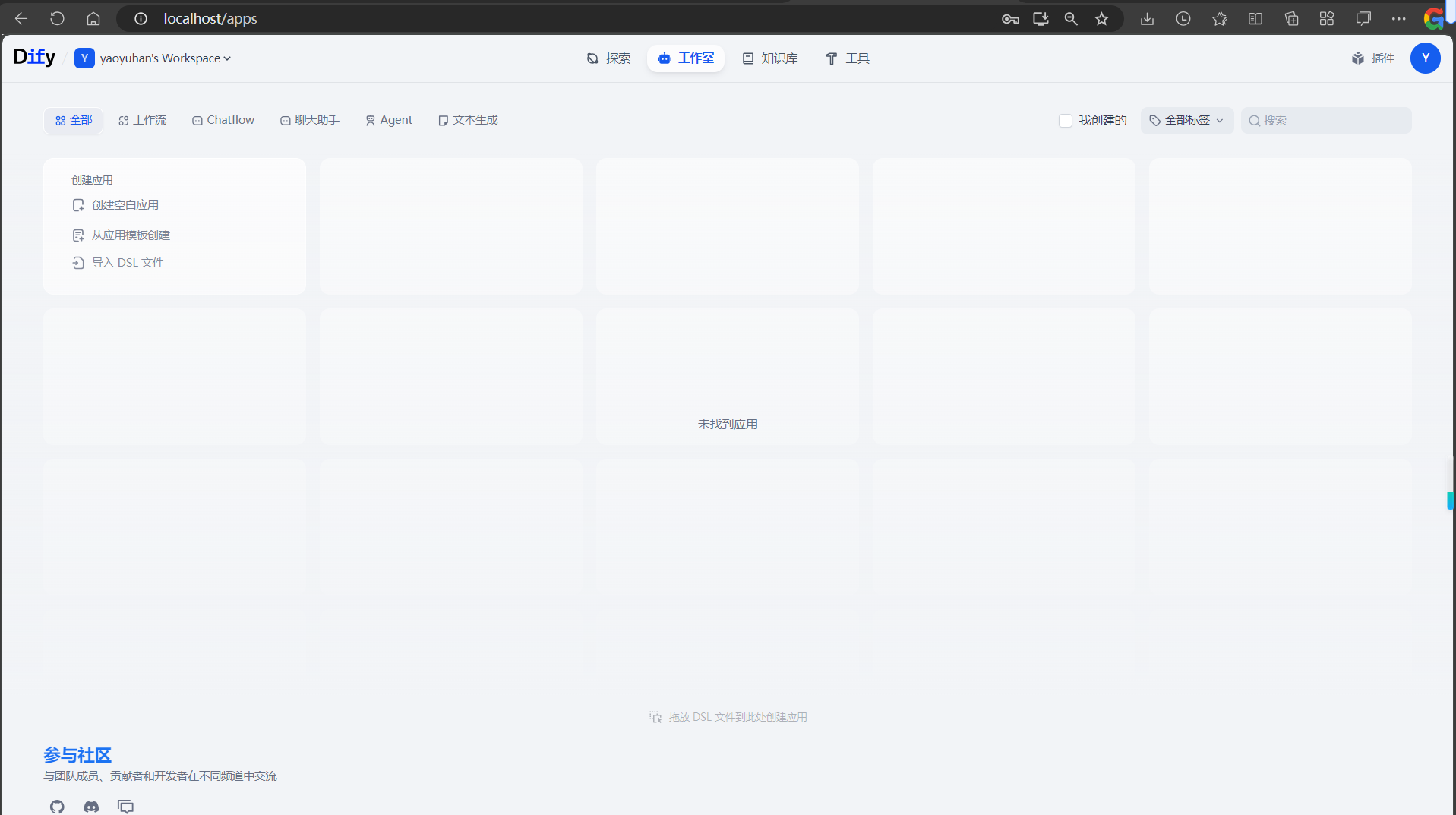

Dify

Dify 是一款开源、低代码的 LLM 应用开发与 LLMOps 平台,主打可视化编排、多模型兼容、RAG 与工作流,让开发者 / 业务人员快速搭建生产级 AI 应用Dify。

Dify 支持两种使用方式:云服务(无需部署,适合快速体验)和本地部署(适合开发和私有化需求)。

这里我们先说第一种云服务方式,本地部署我们在 4.端侧/本地化Agent再详细展开。

1.打开网址https://cloud.dify.ai/

2.进入页面后,选择适合的登录方式

3.登录后在工作台首页,点击 「创建应用」,选择想要创建的应用类型即可

FastGPT

FastGPT 是一款国内开源、低代码、基于大语言模型的 AI 智能体 / 知识库应用开发平台,采用 Apache 2.0 开源协议(支持免费商用),主打开箱即用的 RAG能力,同时具备成熟的 Agent 编排、可视化工作流、多模型兼容与企业级私有化部署能力,是国内生态最完善的 AI 应用低代码开发工具之一,与 Dify、Flowise 同属热门的企业级开源 AI 开发平台。

Flowise

Flowise是一个开源的图形化流程编排工具,利用大语言模型(LLM)的强大能力,帮助用户可视化地设计、构建和管理复杂的 AI 工作流。

2.LangChain之Agent

Agent、AgentExecutor的创建

在 LangChain 中,Agent 是 “决策大脑”,AgentExecutor 是 “执行器”。

因此,我们要知道Agent、AgentExecutor的创建

创建Agent

Agents的类型无非就是两种模式:

| Function Calling |

| React |

传统方式:使用AgentType指定.

对于Function模式,有一种典型的AgentType:

| AgentType.OPENAI_FUNCTIONS | 单轮多工具 |

对于ReAct 模式,有三种典型的AgentType:

| AgentType.ZERO_SHOT_REACT_DESCRIPTION | 简单任务、无记忆 |

| AgentType.STRUCTURED_CHAT_ZERO_SHOT_REACT_DESCRIPTION | 结构化输出 + 记忆 |

| AgentType.CONVERSATIONAL_REACT_DESCRIPTION | 会话记忆 + 自然语言对话 |

通用方式: 使用create_react_agent或create_tool_calling_agent:

Tool Calling中的create_openai_functions_agent 专属 OpenAI 系模型,较常用。

| ##通用方式创建Agent之create_react_agent agent = create_react_agent( llm=llm, prompt=prompt, tools=tools ) |

| ##通用方式创建Agent之create_tool_calling_agent agent = create_tool_calling_agent( llm = llm, tools = [search], prompt = prompt ) |

创建AgentExecutor

传统方式:initialize_agent()

| ##传统方式创建AgentExecutor agent_executor = initialize_agent( llm=llm, agent=AgentType.ZERO_SHOT_REACT_DESCRIPTION, tools=[search_tool], verbose=True ) |

注意:这是早期 LangChain 为了简化使用提供的 “一键式” 函数,把 Agent 创建和执行器封装在一起。

通用方式:AgentExecutor构造方法

| ##通用方式创建AgentExecutor agent_executor = AgentExecutor( agent=agent, tools=tools ) |

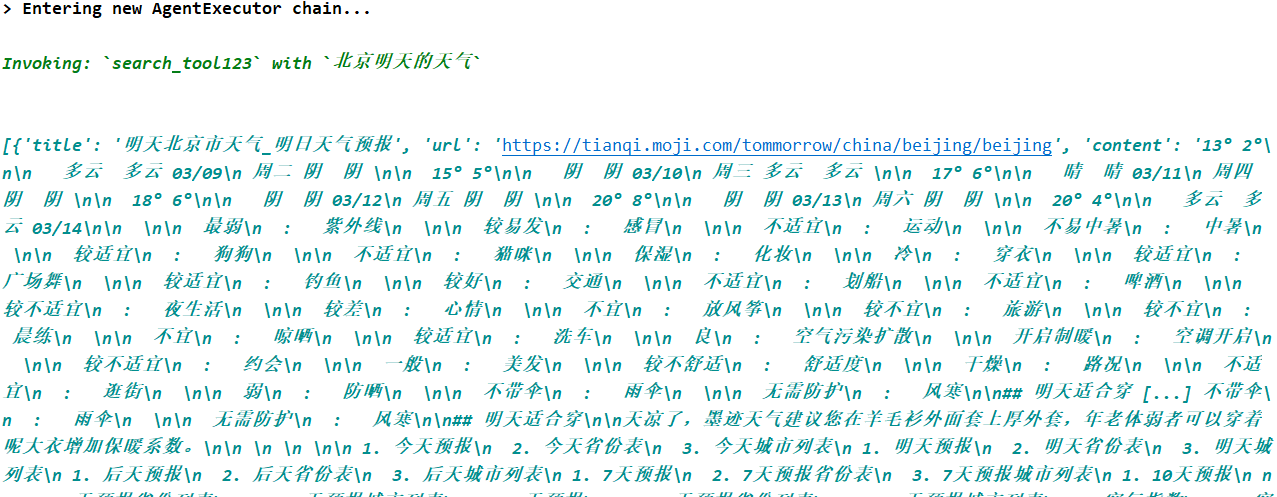

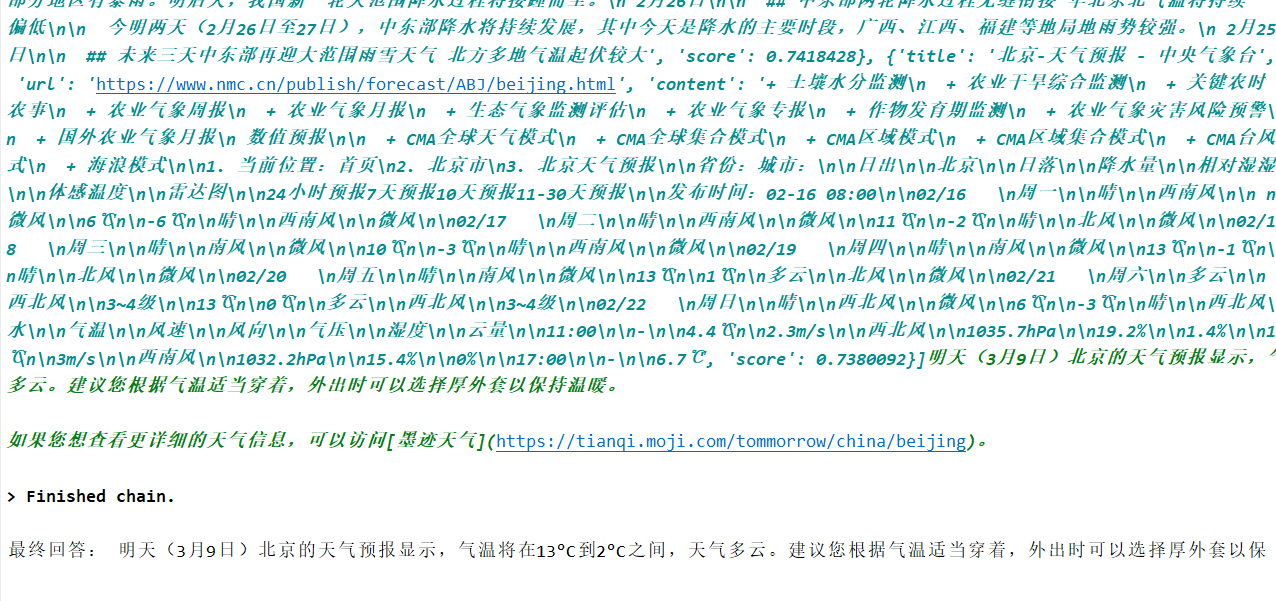

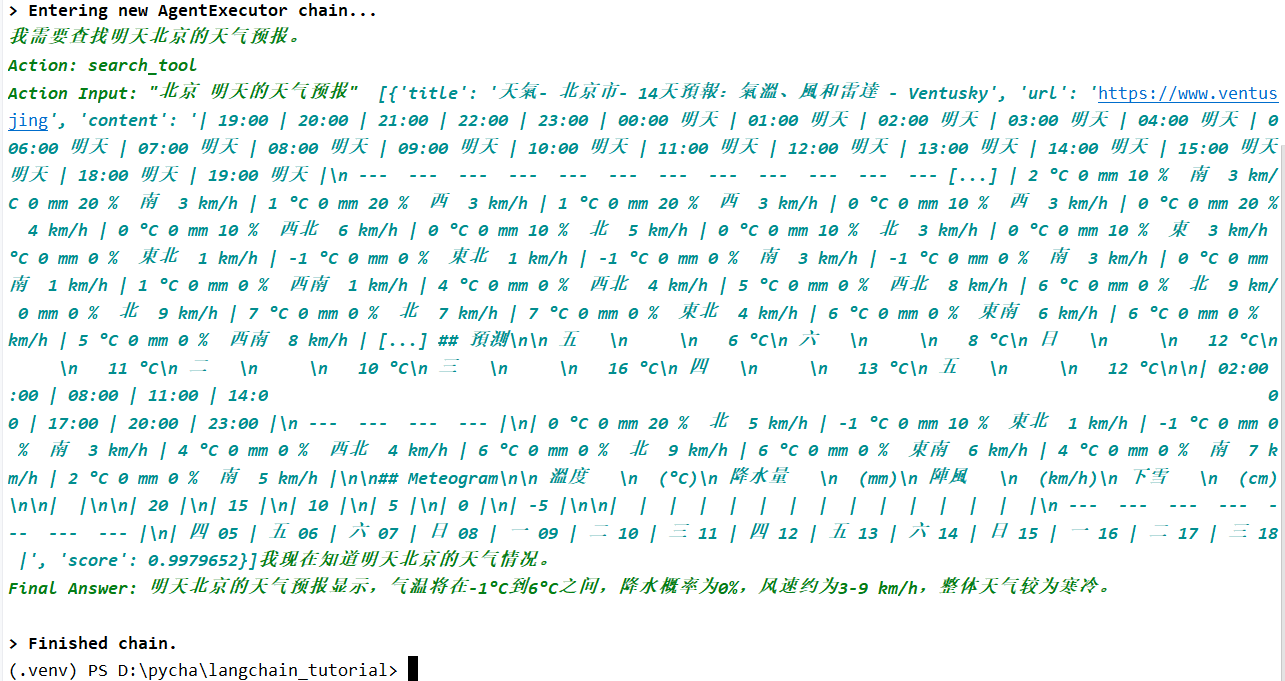

Agent使用举例

以下从两个不同的Agent创建方式举例

注意若遇到版本不兼容的问题,可pip install langchain_classic, langchain_classic是官方推出的实现 LangChain 新版环境对旧版代码的向后兼容的库。

import os

import dotenv

from langchain_classic.agents import create_openai_functions_agent, AgentExecutor

from langchain_community.chat_models import ChatOpenAI

from langchain_community.tools import TavilySearchResults

from langchain_core.tools import Tool

from langchain_core.prompts import ChatPromptTemplate, MessagesPlaceholder

dotenv.load_dotenv()

os.environ['OPENAI_API_KEY'] = os.getenv("OPENAI_API_KEY1")

os.environ['OPENAI_BASE_URL'] = os.getenv("OPENAI_BASE_URL")

os.environ["TAVILY_API_KEY"] = "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"

search = TavilySearchResults(max_results=3)

# 1.工具

search_tool = Tool(

name="search_tool",

func=search.run,

description="用于互联网信息的检索,比如查询实时天气、最新新闻、股票数据等需要联网获取的信息"

)

# 2. 定义工具集

tools = [search_tool]

# 3. 初始化大模型(GPT-4o-mini)

llm = ChatOpenAI(

model="gpt-4o-mini",

temperature=0, # 温度0保证回答稳定

verbose=True

)

# 4. 定义Agent的Prompt

prompt = ChatPromptTemplate.from_messages([

("system", "你是一个智能助手,擅长使用工具解决用户问题。如果需要获取实时信息,必须调用search_tool123工具。"),

("user", "{input}"),

MessagesPlaceholder(variable_name="agent_scratchpad"), # Agent思考过程占位符

])

# 5. 创建OpenAI Functions Agent

agent = create_openai_functions_agent(llm, tools, prompt)

# 6. 创建Agent执行器

agent_executor = AgentExecutor(

agent=agent,

tools=tools,

verbose=True,

handle_parsing_errors=True

)

# 7. 调用Agent查询天气

result = agent_executor.invoke({"input": "北京明天的天气怎么样?"})

print("\n最终回答:", result["output"])

#1.导入相关包

import os

import dotenv

from langchain_classic.agents import AgentExecutor

from langchain_classic.agents.react.agent import create_react_agent

from langchain_community.tools.tavily_search import TavilySearchResults

from langchain_core.prompts import PromptTemplate

from langchain_core.tools import Tool

from langchain_openai import ChatOpenAI

dotenv.load_dotenv()

os.environ['OPENAI_API_KEY'] = os.getenv("OPENAI_API_KEY1")

os.environ['OPENAI_BASE_URL'] = os.getenv("OPENAI_BASE_URL")

#2.搜索化工具

os.environ["TAVILY_API_KEY"] = "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" # 需要替换为你的 Tavily API 密钥

search = TavilySearchResults(max_results=1)

search_tool = Tool(

name="search_tool",

func=search.run,

description="用于互联网信息的检索"

)

tools = [search_tool]

#3.提供大模型

llm = ChatOpenAI(

model="gpt-4o-mini",

temperature=0,

)

#4.提供提示词模板

template = '''Answer the following questions as best you can. You have access to the following tools:

{tools}

Use the following format:

Question: the input question you must answer

Thought: you should always think about what to do

Action: the action to take, should be one of [{tool_names}]

Action Input: the input to the action

Observation: the result of the action

... (this Thought/Action/Action Input/Observation can repeat N times)

Thought: I now know the final answer

Final Answer: the final answer to the original input question

Begin!

Question: {input}

Thought:{agent_scratchpad}'''

prompt_template = PromptTemplate(

template=template,

)

#5.创建Agent

agent = create_react_agent(

llm=llm,

tools=tools,

prompt=prompt_template,

)

#6.创建AgentExecutor

agent_executor = AgentExecutor(

agent=agent,

tools=tools,

verbose=True, #显示详情

handle_parsing_errors=True

)

#7.调用

agent_executor.invoke({"input": "明天北京的天气情况如何?"})

3.多智能体框架

当你需要一个Agent团队协作(例如:一个写代码,一个审代码,一个测试)时使用。

CrewAI

CrewAI 是基于 LangChain 的开源 Python 多智能体协作框架,主打角色化 AI 团队自动协作,让多个 Agent 像真人团队一样分工、沟通、委派任务,搞定复杂任务(如写报告、做研究、开发软件)。

可参考官方文档:

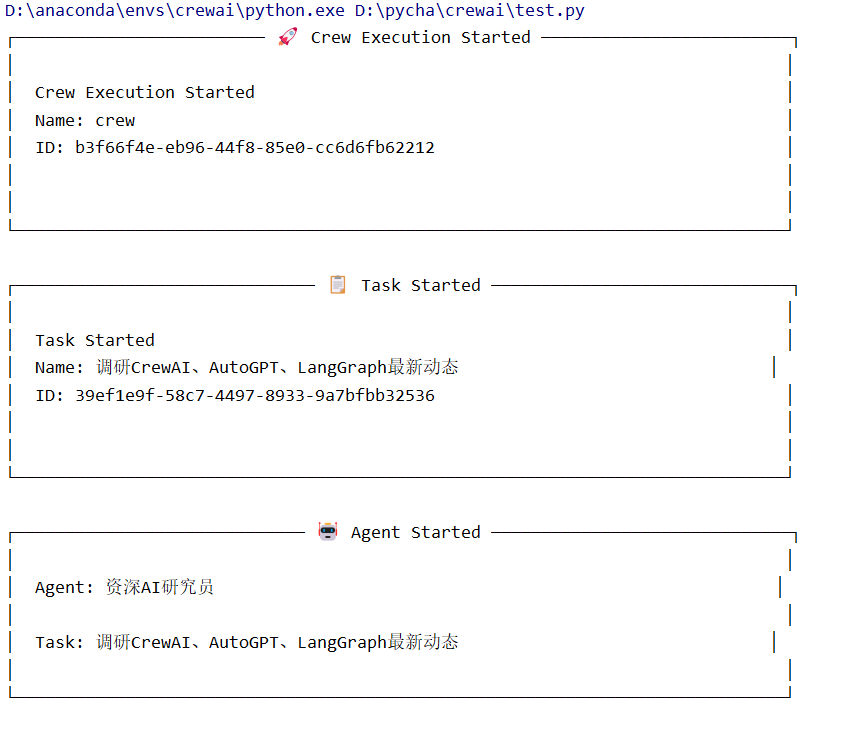

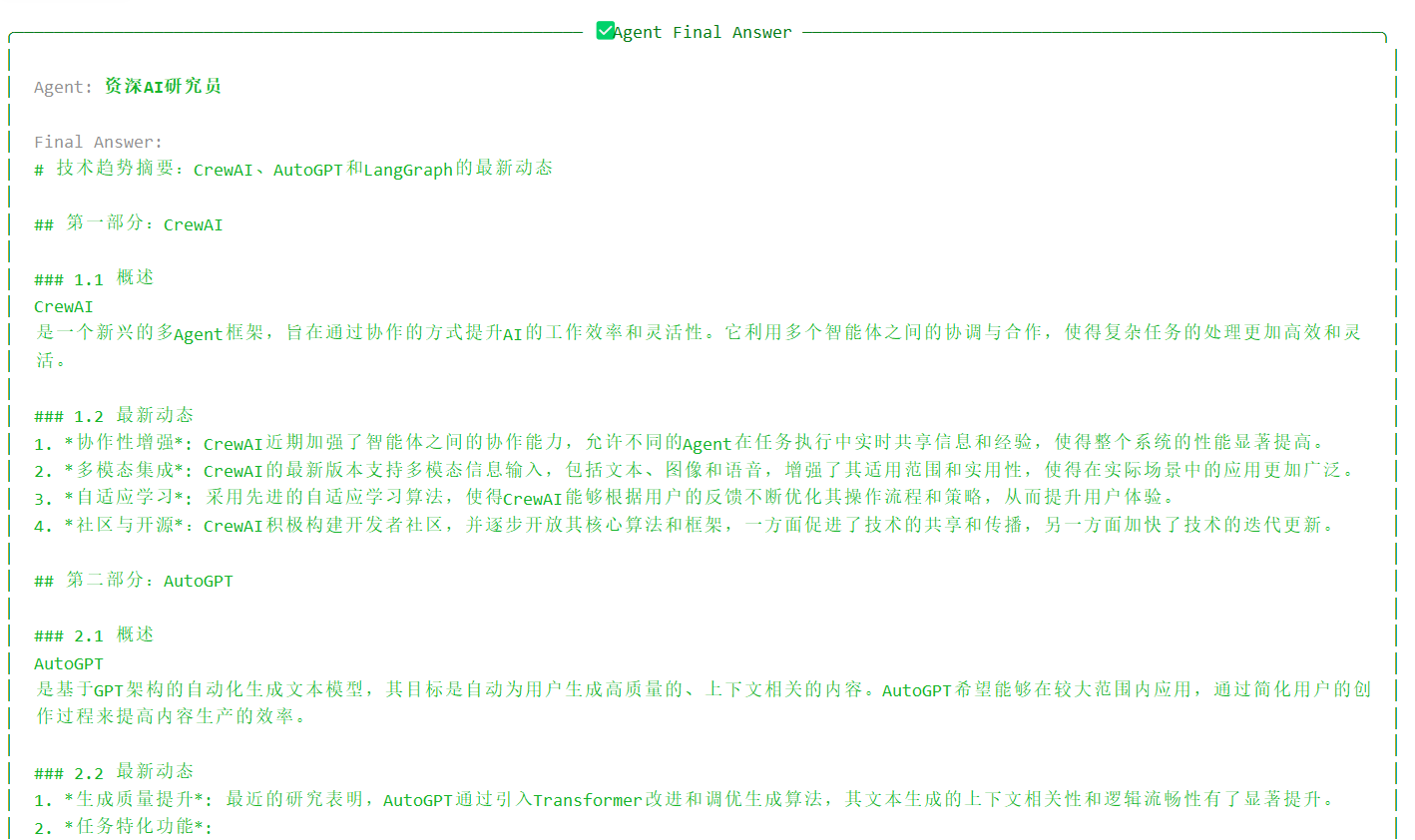

代码示例:

import os

from crewai import Agent,Task,Crew,Process,LLM

from dotenv import load_dotenv

load_dotenv()

llm = LLM(

model = os.getenv('OPENAI_MODEL'),

base_url = os.getenv('OPENAI_BASE_URL'),

api_key = os.getenv('OPENAI_API_KEY1'),

)

# 2. 定义 Agent

researcher = Agent(

role="资深AI研究员",

goal="收集2026年多Agent框架最新趋势",

backstory="10年AI行业研究,擅长技术趋势分析",

llm = llm,

verbose=True

)

writer = Agent(

role="技术作家",

goal="把研究结果写成清晰报告",

backstory="擅长技术内容创作,语言简洁易懂",

llm = llm,

verbose=True

)

# 3. 定义任务

task1 = Task(

description="调研CrewAI、AutoGPT、LangGraph最新动态",

agent=researcher,

expected_output="3页技术趋势摘要"

)

task2 = Task(

description="基于调研写一份《2026多Agent框架报告》",

agent=writer,

expected_output="完整报告,含结论与建议"

)

# 4. 组建团队并运行

crew = Crew(

agents=[researcher, writer],

tasks=[task1, task2],

process=Process.sequential,

verbose=True

)

result = crew.kickoff()

print(result)

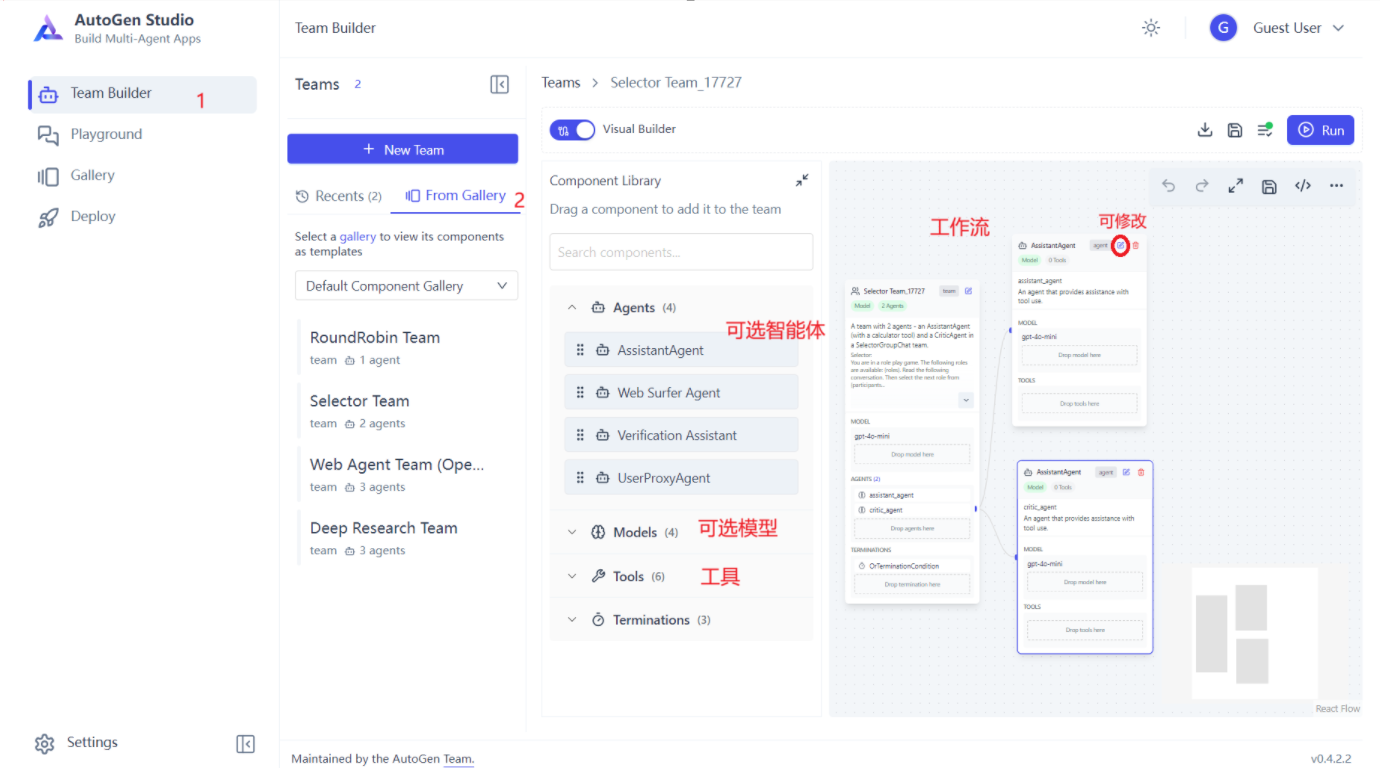

Microsoft AutoGen

1.在终端输入pip install -U autogenstudio,下载autogenstudio

2.输入autogenstudio ui --port 8080 --appdir ./myapp,启动 AutoGenStudio 服务

3.启动成功后,终端会输出访问地址,直接在浏览器打开:

注意:模型要设置api。gpt系列可从closeai官网获取。

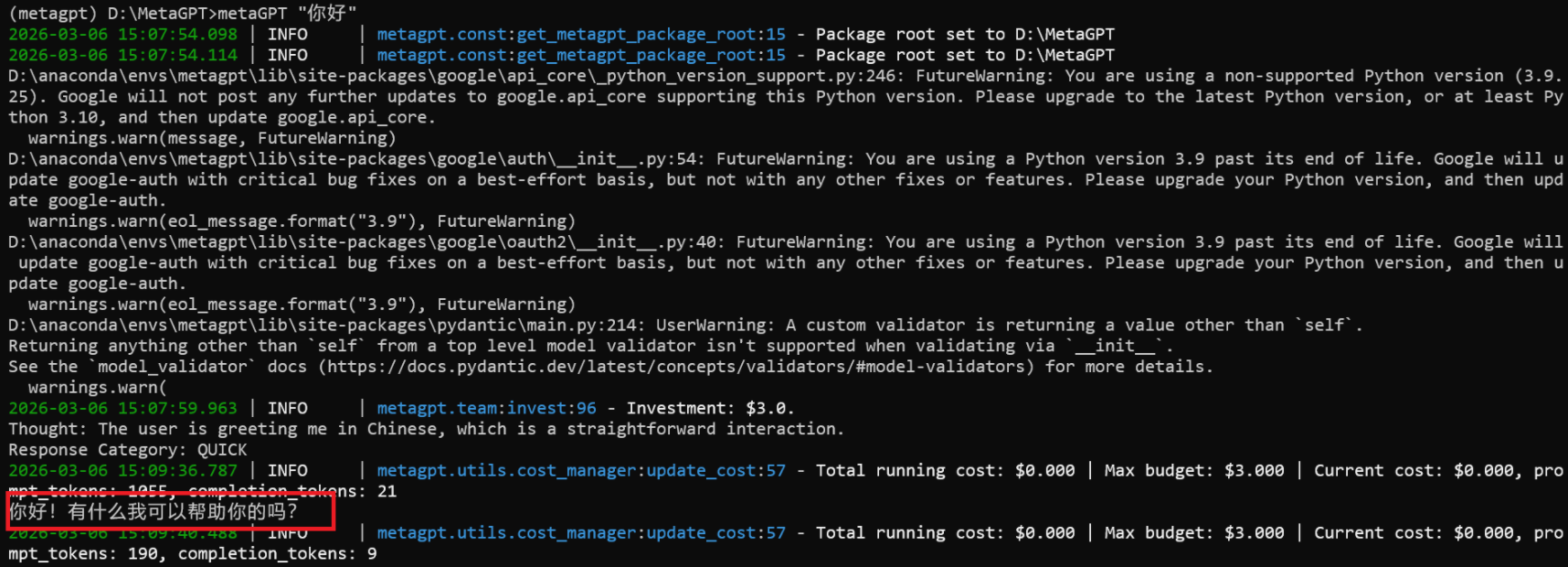

MetaGPT

MetaGPT 是开源多智能体协作框架,核心是模拟完整软件公司,用一行自然语言需求自动生成可运行项目(PRD、架构、代码、测试全流程),核心理念:Code = SOP(Team)。

1.克隆代码git clone https://github.com/FoundationAgents/MetaGPT.git

2.创建虚拟环境并进入 conda create metagpt python=3.10 && conda activate metagpt

3.进入MetaGPT文件夹

4.pip install -e.

5.修改config2.yaml文件,改成自己的model、base_url、 api_key

6.终端输入:metagpt "你好"

4.端侧/本地化 Agent

Ollama+Docker+git

1.下载ollama

2.下载docker

3.下载git

4.打开终端:git clone https://github.com/langgenius/dify.git

| cd dify/docker |

| copy .env.example .env |

| docker compose up -d |

5.在浏览器输入http://localhost/install,进入dify

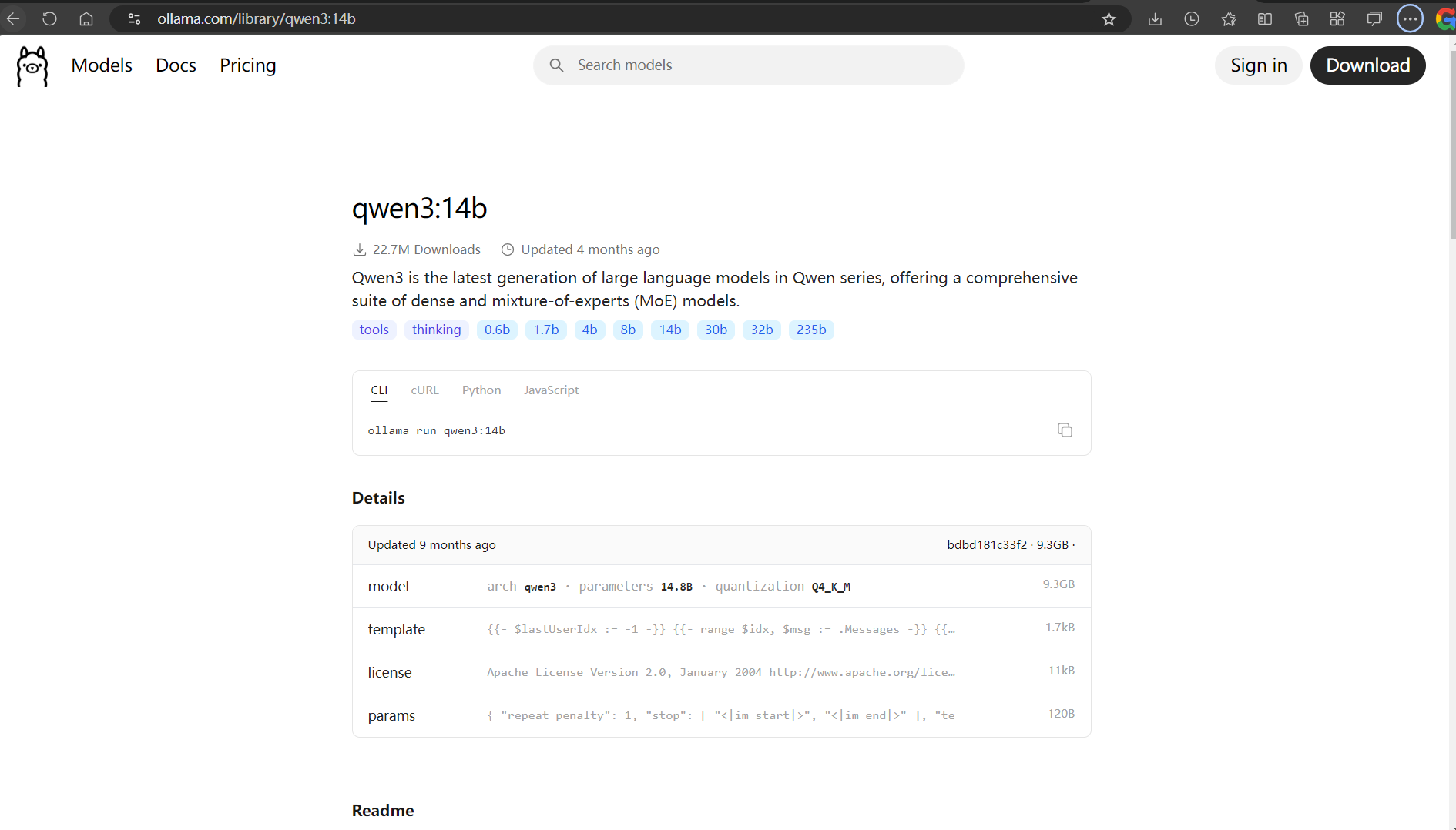

6.进入ollama官网,选择模型,在模型列表中选择所需的模型,随后在终端中执行对应的 CLI 命令以拉取并运行该模型。我这里选择的是qwen3:14。

7.在进入dify,点击头像,找到设置,在进入模型供应商,选择ollama插件进行安装,随后完成配置即可。

如果有什么问题,欢迎随时来评论区讨论。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)