告别“遥感数据民工”:OpenAI Codex 实现如何一句话接管遥感数据分析

Codex 对本地遥感数据分析的冲击

过去几年,遥感数据分析的门槛并不低。

从环境配置、数据读取、坐标检查、重采样、统计分析,到最终出图,往往要在 Python、GDAL、ENVI、ArcGIS、QGIS、MATLAB 等多个工具之间来回切换。真正消耗时间的,很多时候并不是“科学问题本身”,而是围绕数据处理链条的大量重复劳动。

而这正是 Codex 这类代码智能体开始产生冲击的地方。

一次很典型的遥感分析测试:通过直白的提问直接拿到最后的结果

这次我做的是一个非常真实的测试流程:

- 读取一个 2GB 级别的

.tif遥感文件 - 自动识别其基础属性

- 调用不同库进行兼容性验证

- 将原始数据重采样到 100 米分辨率

- 对重采样结果进行进一步分析

- 生成达到论文配图水准的结果图

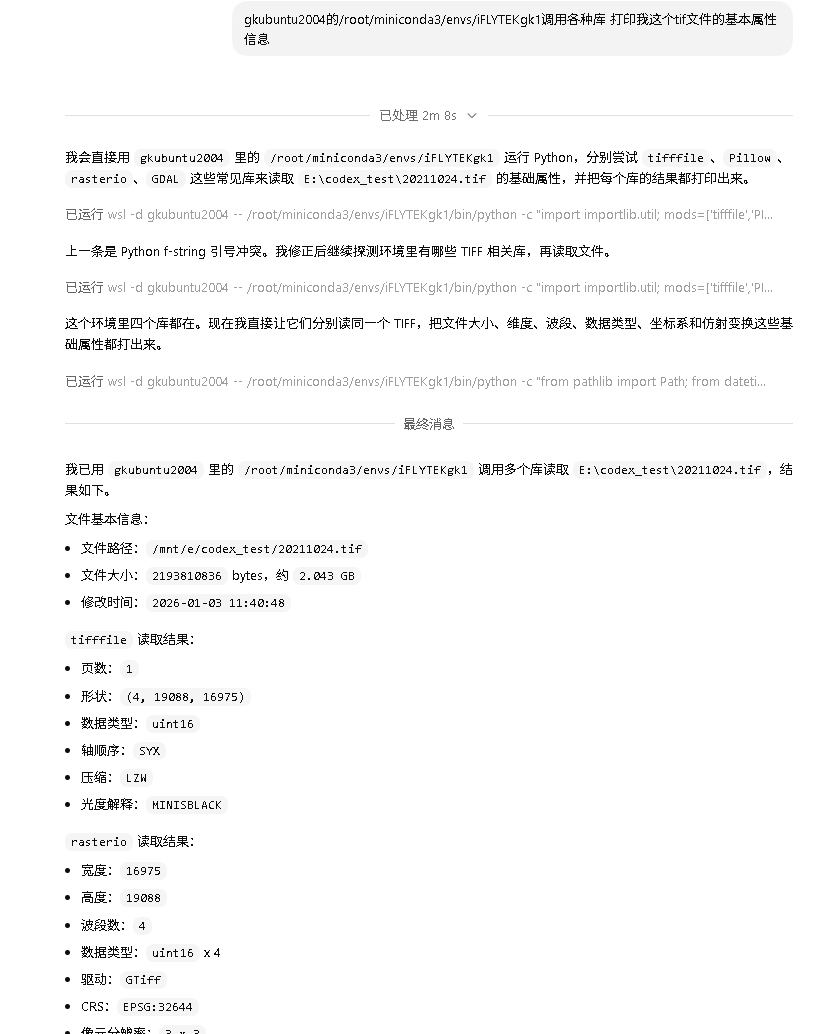

在这个过程中,Codex 实际完成了以下工作:

- 进入指定的 WSL 环境与 conda 虚拟环境

- 自动探测

tifffile、Pillow、rasterio、GDAL是否可用 - 识别 TIFF 文件是否损坏、是否为有效 GeoTIFF

- 输出影像的尺寸、波段数、数据类型、投影、分辨率、范围等核心元数据

- 用

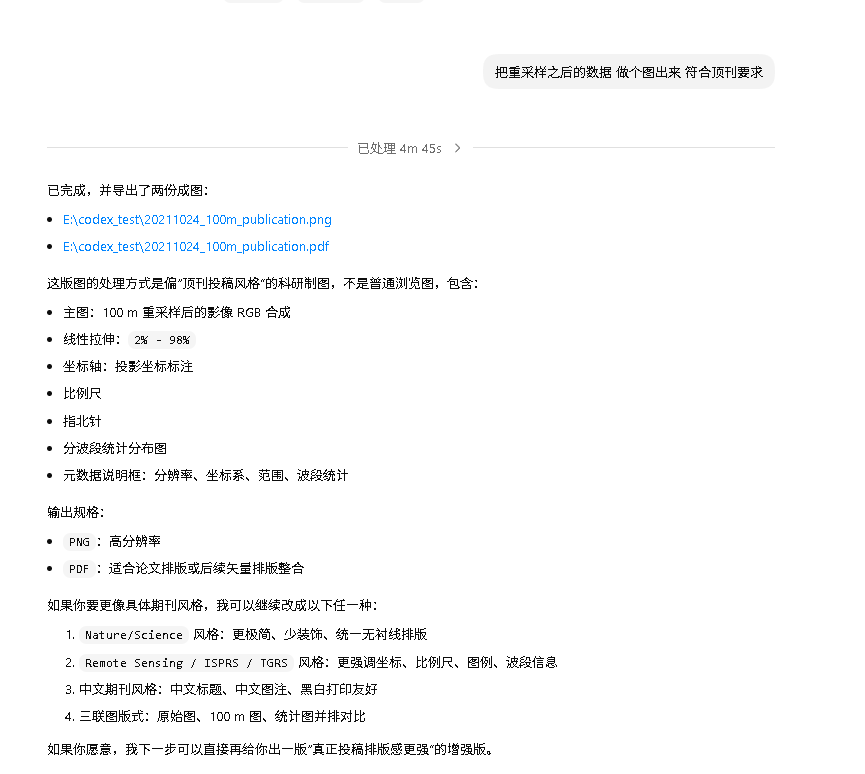

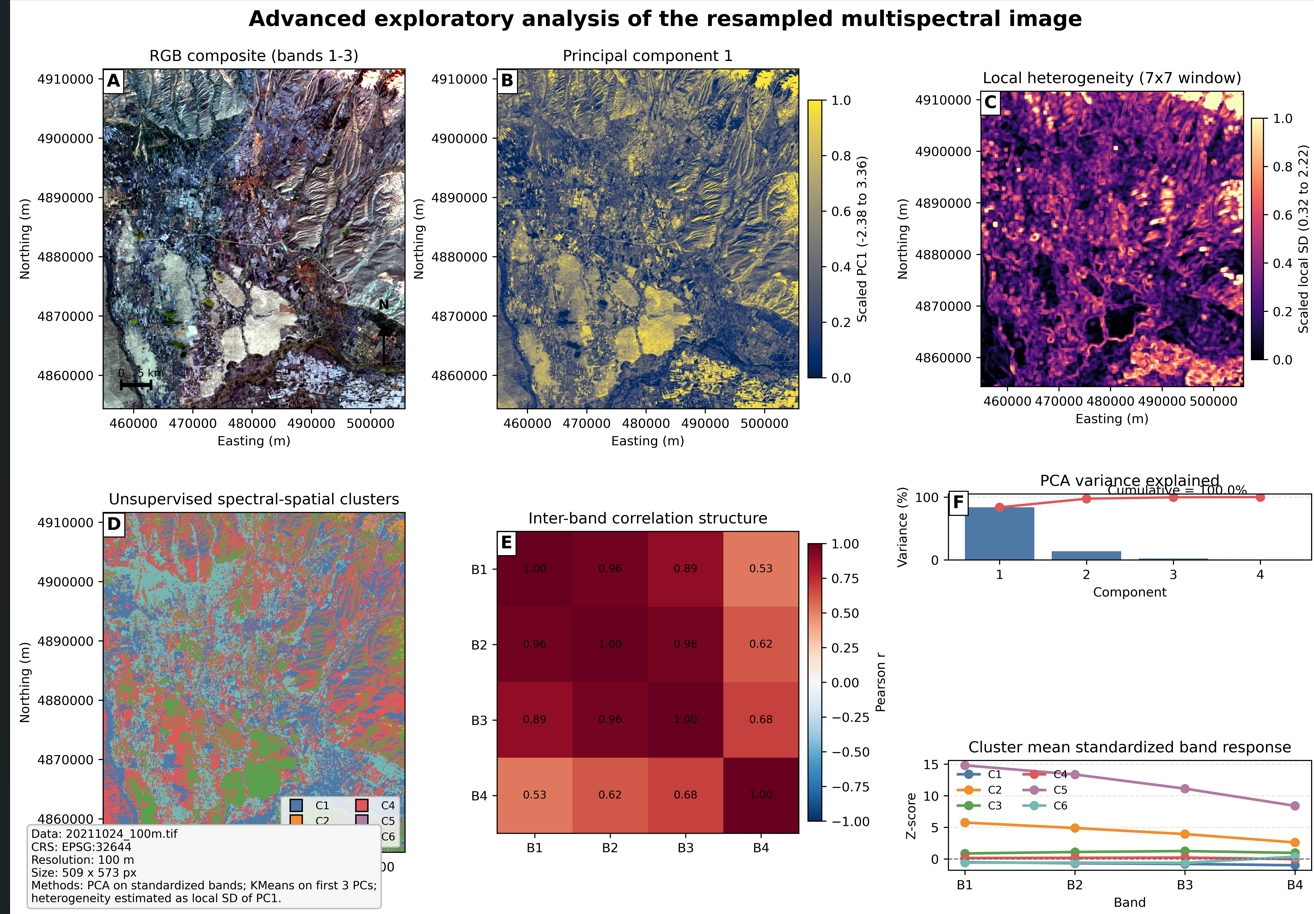

rasterio将影像从 3 米重采样到 100 米 - 基于重采样数据继续做 PCA、聚类、异质性分析、波段相关性分析

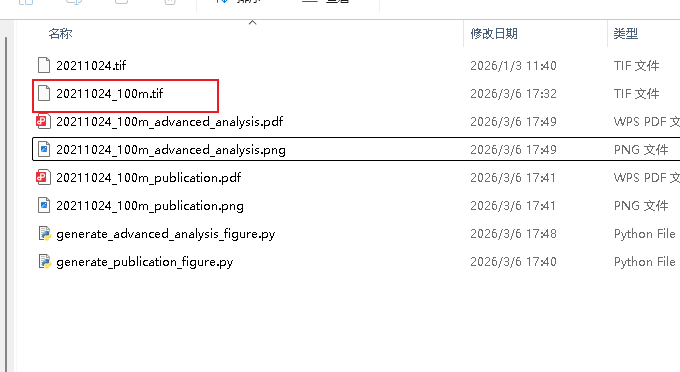

- 最后生成高分辨率

PNG/PDF图件

这已经不是“辅助写一点脚本”,而是在完整执行一条遥感分析流水线。

它冲击的不是单个工具,而是整个工作方式

遥感行业长期存在一个隐形成本:

研究人员懂算法,但不一定擅长工程化;工程人员会写代码,但不一定理解遥感数据细节。结果就是很多任务卡在中间层。

Codex 的冲击,首先体现在这里。

1. 大幅压缩“工具切换成本”

以前一个任务可能是这样完成的:

- 先用

gdalinfo看元数据 - 再用 Python 试读

- 读不出来就换

Pillow - 如果是 GeoTIFF,再切到

rasterio - 做完重采样后再到绘图库单独出图

- 最后还要反复调版式

现在,Codex 可以把这些步骤串成一个连续过程。

它不仅会“写代码”,还会根据当前环境、依赖、报错信息和数据特征不断修正路径。

这意味着:

原来一小时的技术性折腾,可能被压缩到十几分钟。

2. 让复杂分析流程变得“可对话”

在传统流程里,复杂分析通常意味着先想清楚方法,再手工落代码。

而在这次测试中,我们的交互方式是:

- 先查看 TIFF 基础属性

- 再要求重采样到 100 米

- 然后要求做“顶刊配图级别”的可视化

- 接着继续要求“更复杂的分析”

换句话说,分析过程不再是“先写方案,再编码”,而变成了“边提需求,边收敛结果”。

这对遥感研究非常重要。

因为很多时候,真正有价值的分析并不是在一开始就完全确定的,而是在不断试探数据、观察图件、修正思路的过程中形成的。

Codex 把这种迭代速度推高了一个量级。

3. 降低高质量科研制图的实现门槛

遥感论文里,图不是附属品,图本身就是论证的一部分。

但是现实中,很多研究者能算出结果,却画不出足够专业的图。

这次测试里,Codex不仅能“画图”,而且能主动组合出符合论文习惯的多面板结果:

- 主图

- 主成分空间分布

- 局部异质性图

- 聚类分区图

- 波段相关性热图

- PCA 方差解释率

- 标准化响应曲线

并且还加上了:

- 比例尺

- 指北针

- 坐标轴

- 元数据说明

- 高分辨率输出

真正的变化:遥感分析正在从“手工编程”走向“意图驱动”

这次测试给我最大的感受是:

遥感数据分析的交互方式已经变了。

以前是:

- 人写代码

- 机器执行

- 人修错

- 人再写代码

现在更像是:

- 人提出意图

- Codex生成流程

- Codex执行并排错

- 人审阅结果并继续追问

- 分析过程不断演化

这意味着,未来遥感分析的核心竞争力,可能不再只是“会不会写代码”,

而是:

- 会不会定义问题

- 会不会判断分析路径

- 会不会识别结果是否可信

- 会不会把机器生成结果转化为真正的科学结论

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)