SpringAI入门(对话机器人一)

本文介绍了使用SpringAI快速开发对话机器人的入门指南。主要内容包括:1)SpringAI概述,支持19种对话模型,重点推荐OpenAI和Ollama;2)创建SpringBoot工程并配置Ollama依赖;3)配置模型参数信息;4)通过ChatClient实现与大模型的交互;5)演示同步调用和流式调用两种方式;6)如何通过System设定自定义AI角色特征。文章提供了完整的代码示例和配置说明

目录

前言:

SpringAI整合了全球(主要是国外)的大多数大模型,而且对于大模型开发的三种技术架构都有比较好的封装和支持,开发起来非常方便。

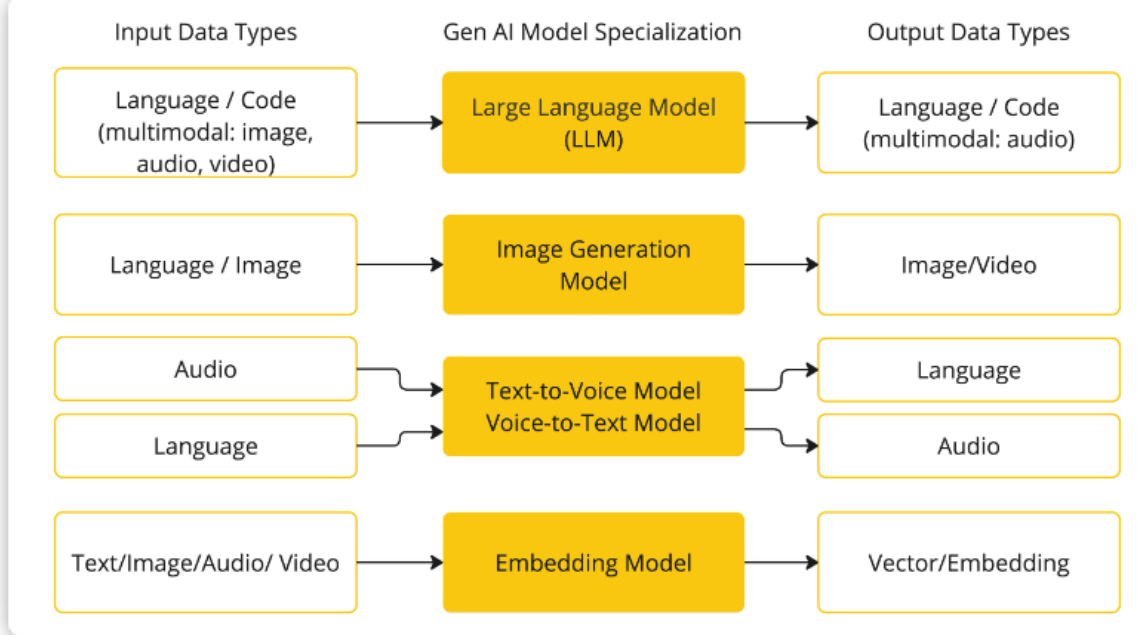

不同的模型能够接收的输入类型、输出类型不一定相同。SpringAI根据模型的输入和输出类型不同对模型进行了分类:

大模型应用开发大多数情况下使用的都是基于对话模型(Chat Model),也就是输出结果为自然语言或代码的模型。

目前SpringAI支持的大约19种对话模型,以下是一些功能对比:

| Provider | Multimodality | Tools/Functions | Streaming | Retry | Built-in JSON | Local | OpenAI API Compatible |

|---|---|---|---|---|---|---|---|

| Anthropic Claude | text, pdf, image | ✔ | ✔ | ✔ | ❌ | ❌ | ❌ |

| Azure OpenAI | text, image | ✔ | ✔ | ✔ | ✔ | ❌ | ✔ |

| DeepSeek (OpenAI-proxy) | text | ❌ | ✔ | ✔ | ✔ | ✔ | ✔ |

| Google VertexAI Gemini | text, pdf, image, audio, video | ✔ | ✔ | ✔ | ✔ | ❌ | ✔ |

| Groq (OpenAI-proxy) | text, image | ✔ | ✔ | ✔ | ❌ | ❌ | ✔ |

| HuggingFace | text | ❌ | ❌ | ❌ | ❌ | ❌ | ❌ |

| Mistral AI | text, image | ✔ | ✔ | ✔ | ✔ | ❌ | ✔ |

| MiniMax | text | ✔ | ✔ | ✔ | ❌ | ❌ | ❌ |

| Moonshot AI | text | ✔ | ✔ | ✔ | ❌ | ❌ | ❌ |

| NVIDIA (OpenAI-proxy) | text, image | ✔ | ✔ | ✔ | ❌ | ❌ | ✔ |

| OCI GenAI/Cohere | text | ❌ | ❌ | ❌ | ❌ | ❌ | ❌ |

| Ollama | text, image | ✔ | ✔ | ✔ | ✔ | ✔ | ✔ |

| OpenAI | In: text, image, audio Out: text, audio | ✔ | ✔ | ✔ | ✔ | ❌ | ✔ |

| Perplexity (OpenAI-proxy) | text | ❌ | ✔ | ✔ | ❌ | ❌ | ✔ |

| QianFan | text | ❌ | ✔ | ✔ | ❌ | ❌ | ❌ |

| ZhiPu AI | text | ✔ | ✔ | ✔ | ❌ | ❌ | ❌ |

| Watsonx.AI | text | ❌ | ✔ | ❌ | ❌ | ❌ | ❌ |

| Amazon Bedrock Converse | text, image, video, docs (pdf, html, md, docx …) | ✔ | ✔ | ✔ | ❌ | ❌ | ❌ |

其中功能最完整的就是OpenAI和Ollama平台的模型了。

1.SpringAI入门(对话机器人一)

接下来,我们就利用SpringAI发起与大模型的第一次对话。

1.1.快速入门

1.1.1.创建工程

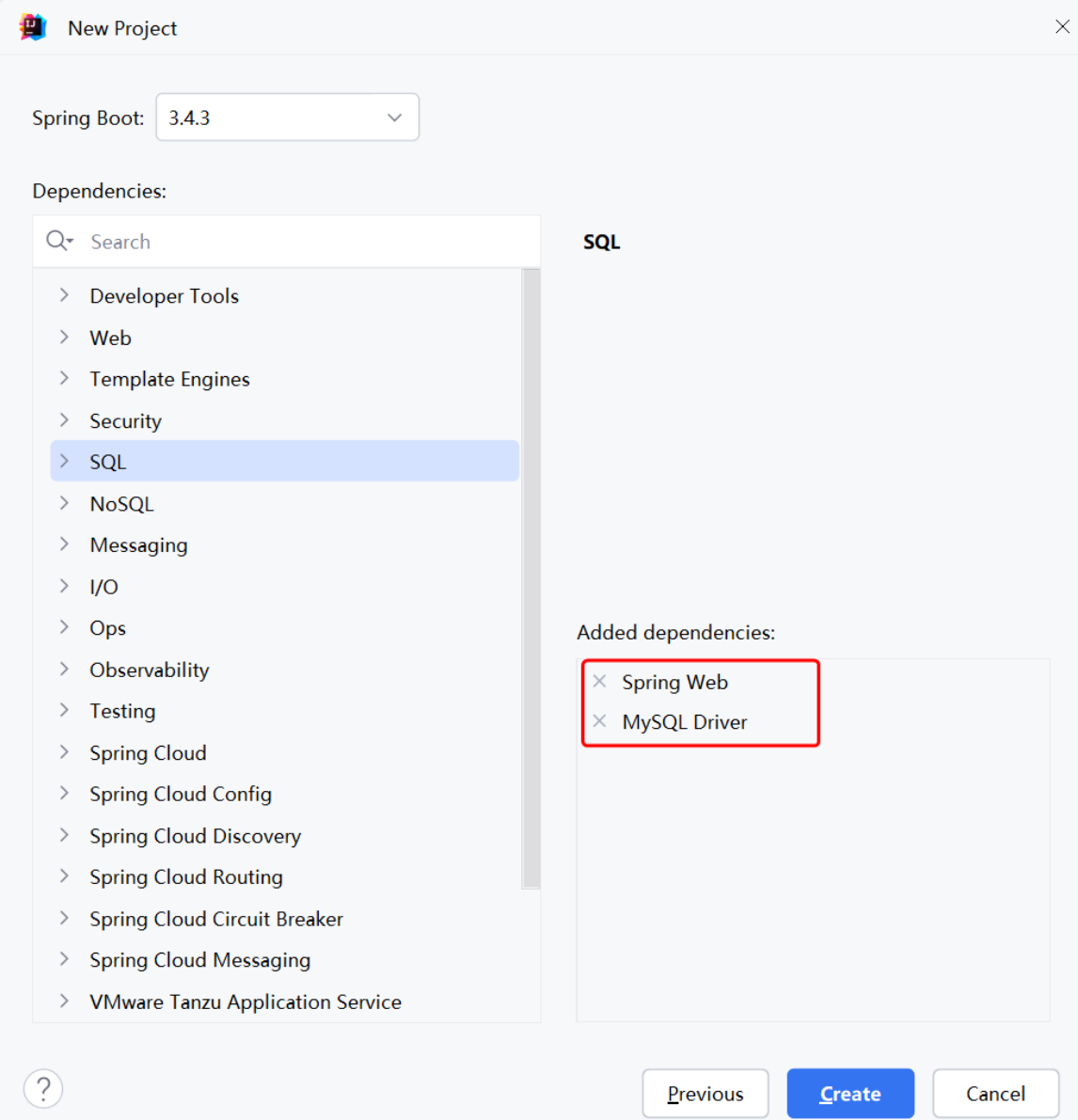

创建一个新的SpringBoot工程,勾选Web、MySQL驱动即可:

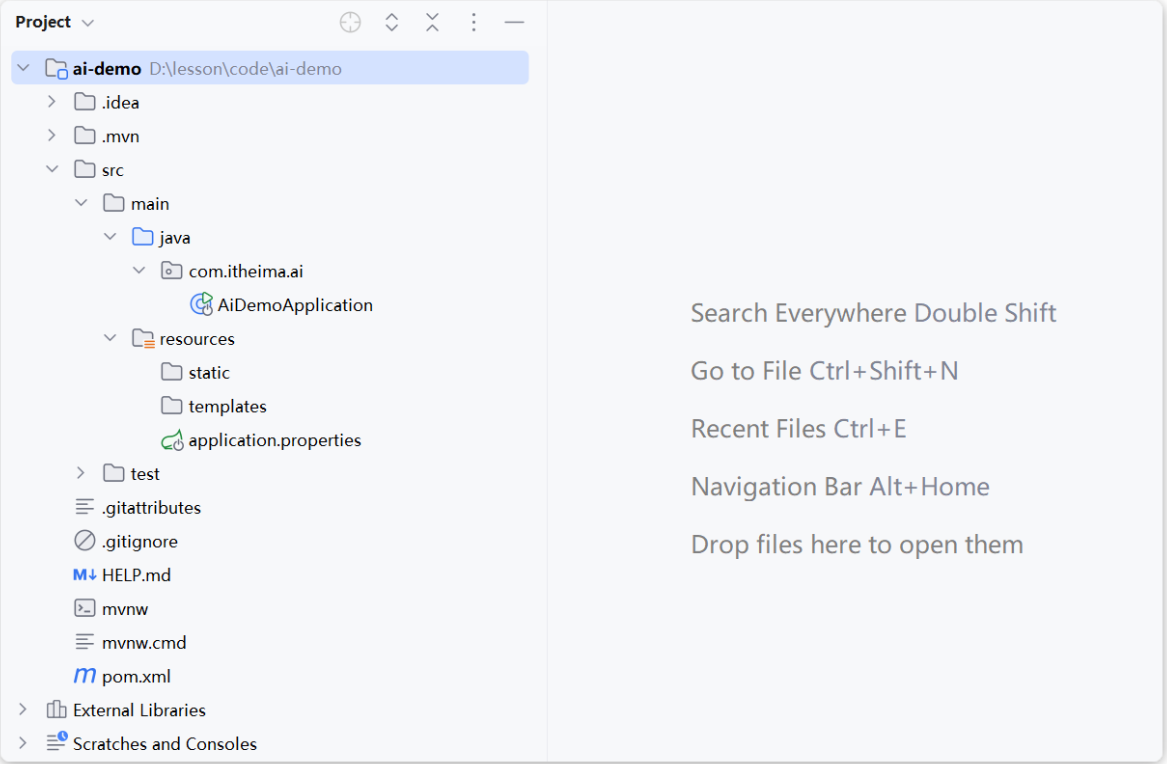

工程结构如图:

原始pom.xml如下:

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 https://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<parent>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-parent</artifactId>

<version>3.4.3</version>

<relativePath/> <!-- lookup parent from repository -->

</parent>

<groupId>com.itheima</groupId>

<artifactId>ai-demo</artifactId>

<version>0.0.1-SNAPSHOT</version>

<name>ai-demo</name>

<description>ai-demo</description>

<url/>

<licenses>

<license/>

</licenses>

<developers>

<developer/>

</developers>

<scm>

<connection/>

<developerConnection/>

<tag/>

<url/>

</scm>

<properties>

<java.version>17</java.version>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>com.mysql</groupId>

<artifactId>mysql-connector-j</artifactId>

<scope>runtime</scope>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

</plugin>

</plugins>

</build>

</project>1.1.2.引入依赖

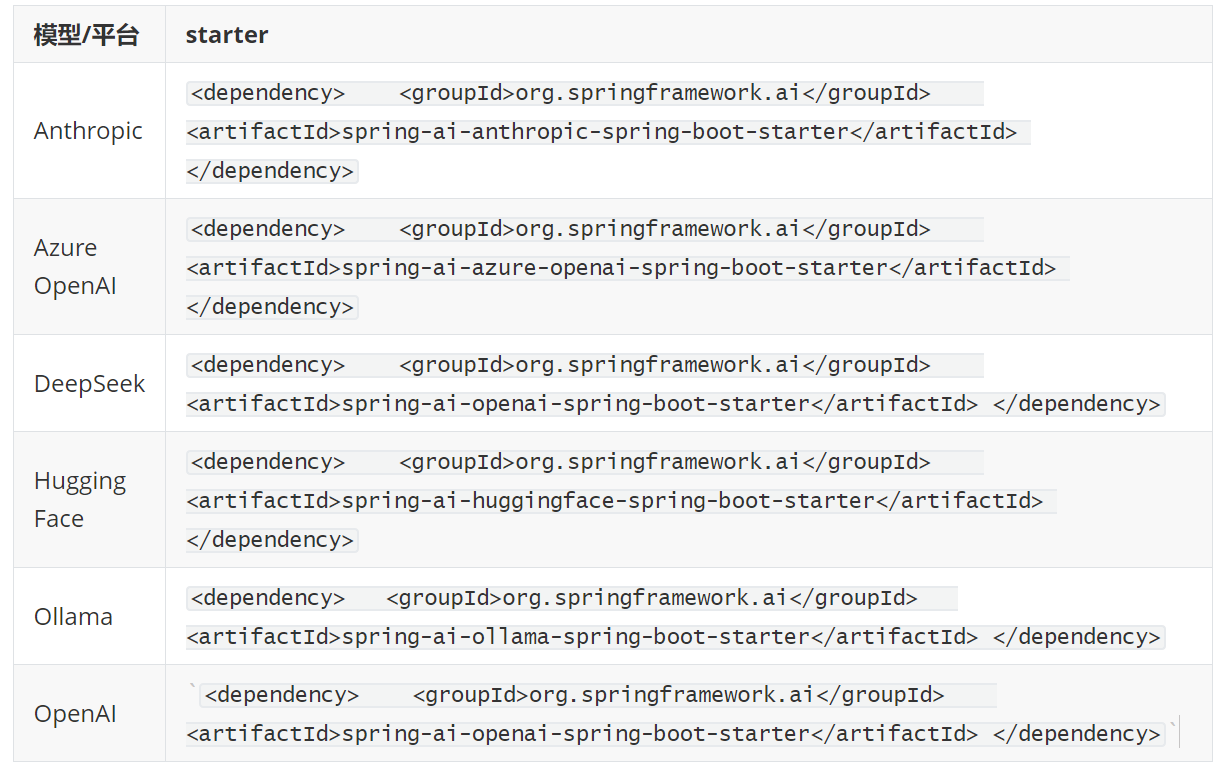

SpringAI完全适配了SpringBoot的自动装配功能,而且给不同的大模型提供了不同的starter,比如:

我们可以根据自己选择的平台来选择引入不同的依赖。这里我们先以Ollama为例。

首先,在项目pom.xml中添加spring-ai的版本信息:

<spring-ai.version>1.0.0-M6</spring-ai.version>然后,添加spring-ai的依赖管理项:

<dependencyManagement>

<dependencies>

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-bom</artifactId>

<version>${spring-ai.version}</version>

<type>pom</type>

<scope>import</scope>

</dependency>

</dependencies>

</dependencyManagement>最后,引入spring-ai-ollama的依赖:

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-ollama-spring-boot-starter</artifactId>

</dependency>为了方便后续开发,我们再手动引入一个Lombok依赖:

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<version>1.18.22</version>

</dependency>最终,完整依赖如下:

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 https://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<parent>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-parent</artifactId>

<version>3.4.3</version>

<relativePath/> <!-- lookup parent from repository -->

</parent>

<groupId>com.itheima</groupId>

<artifactId>ai-demo</artifactId>

<version>0.0.1-SNAPSHOT</version>

<name>ai-demo</name>

<description>ai-demo</description>

<url/>

<licenses>

<license/>

</licenses>

<developers>

<developer/>

</developers>

<scm>

<connection/>

<developerConnection/>

<tag/>

<url/>

</scm>

<properties>

<java.version>17</java.version>

<spring-ai.version>1.0.0-M6</spring-ai.version>

</properties>

<dependencyManagement>

<dependencies>

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-bom</artifactId>

<version>${spring-ai.version}</version>

<type>pom</type>

<scope>import</scope>

</dependency>

</dependencies>

</dependencyManagement>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<version>1.18.22</version>

</dependency>

<dependency>

<groupId>com.mysql</groupId>

<artifactId>mysql-connector-j</artifactId>

<scope>runtime</scope>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-ollama-spring-boot-starter</artifactId>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

</plugin>

</plugins>

</build>

</project>1.1.3.配置模型信息

接下来,我们还要在配置文件中配置模型的参数信息。

以ollama为例,我们将application.properties修改为application.yaml,然后添加下面的内容:

spring:

application:

name: ai-demo

ai:

ollama:

base-url: http://localhost:11434 # ollama服务地址, 这就是默认值

chat:

model: deepseek-r1:7b # 模型名称

options:

temperature: 0.8 # 模型温度,影响模型生成结果的随机性,越小越稳定1.1.4.ChatClient

ChatClient中封装了与AI大模型对话的各种API,同时支持同步式或响应式交互。

不过,在使用之前,首先我们需要声明一个ChatClient。

在com.itheima.ai.config包下新建一个CommonConfiguration类:

完整代码如下:

package com.itheima.ai.config;

import org.springframework.ai.chat.client.ChatClient;

import org.springframework.ai.chat.client.advisor.SimpleLoggerAdvisor;

import org.springframework.ai.ollama.OllamaChatModel;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class CommonConfiguration {

// 注意参数中的model就是使用的模型,这里用了Ollama,也可以选择OpenAIChatModel

@Bean

public ChatClient chatClient(OllamaChatModel model) {

return ChatClient.builder(model) // 创建ChatClient工厂

.build(); // 构建ChatClient实例

}

}代码解读:

-

ChatClient.builder:会得到一个ChatClient.Builder工厂对象,利用它可以自由选择模型、添加各种自定义配置 -

OllamaChatModel:如果你引入了ollama的starter,这里就可以自动注入OllamaChatModel对象。同理,OpenAI也是一样的用法。

1.1.5.同步调用

接下来,我们定义一个Controller,在其中接收用户发送的提示词,然后把提示词发送给大模型,交给大模型处理,拿到结果后返回。

代码如下:

package com.itheima.ai.controller;

import lombok.RequiredArgsConstructor;

import org.springframework.ai.chat.client.ChatClient;

import org.springframework.web.bind.annotation.RequestMapping;

import org.springframework.web.bind.annotation.RequestParam;

import org.springframework.web.bind.annotation.RestController;

@RequiredArgsConstructor

@RestController

@RequestMapping("/ai")

public class ChatController {

private final ChatClient chatClient;

// 请求方式和路径不要改动,将来要与前端联调

@RequestMapping("/chat")

public String chat(@RequestParam(defaultValue = "讲个笑话") String prompt) {

return chatClient

.prompt(prompt) // 传入user提示词

.call() // 同步请求,会等待AI全部输出完才返回结果

.content(); //返回响应内容

}

}注意,基于call()方法的调用属于同步调用,需要所有响应结果全部返回后才能返回给前端。

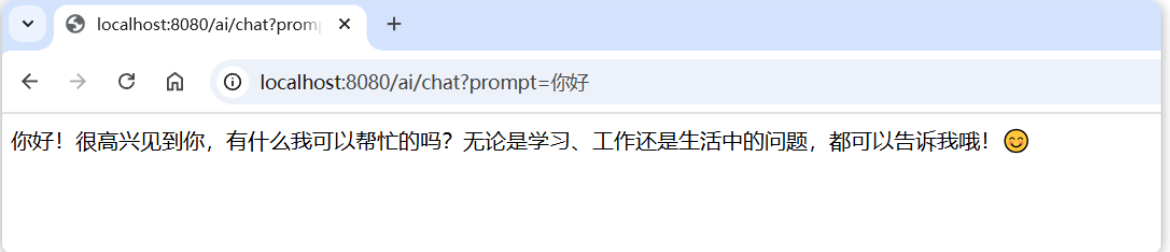

启动项目,在浏览器中访问:http://localhost:8080/ai/chat?prompt=你好

1.1.6.流式调用

同步调用需要等待很长时间页面才能看到结果,用户体验不好。为了解决这个问题,我们可以改进调用方式为流式调用。

在SpringAI中使用了WebFlux技术实现流式调用。

修改刚才ChatController中的chat方法:

// 注意看返回值,是Flux<String>,也就是流式结果,另外需要设定响应类型和编码,不然前端会乱码

@RequestMapping(value = "/chat", produces = "text/html;charset=UTF-8")

public Flux<String> chat(@RequestParam(defaultValue = "讲个笑话") String prompt) {

return chatClient

.prompt(prompt)

.stream() // 流式调用

.content();

}重启测试,再次访问:就会发现内容是逐渐一个字一个字的输出的

1.1.7.System设定

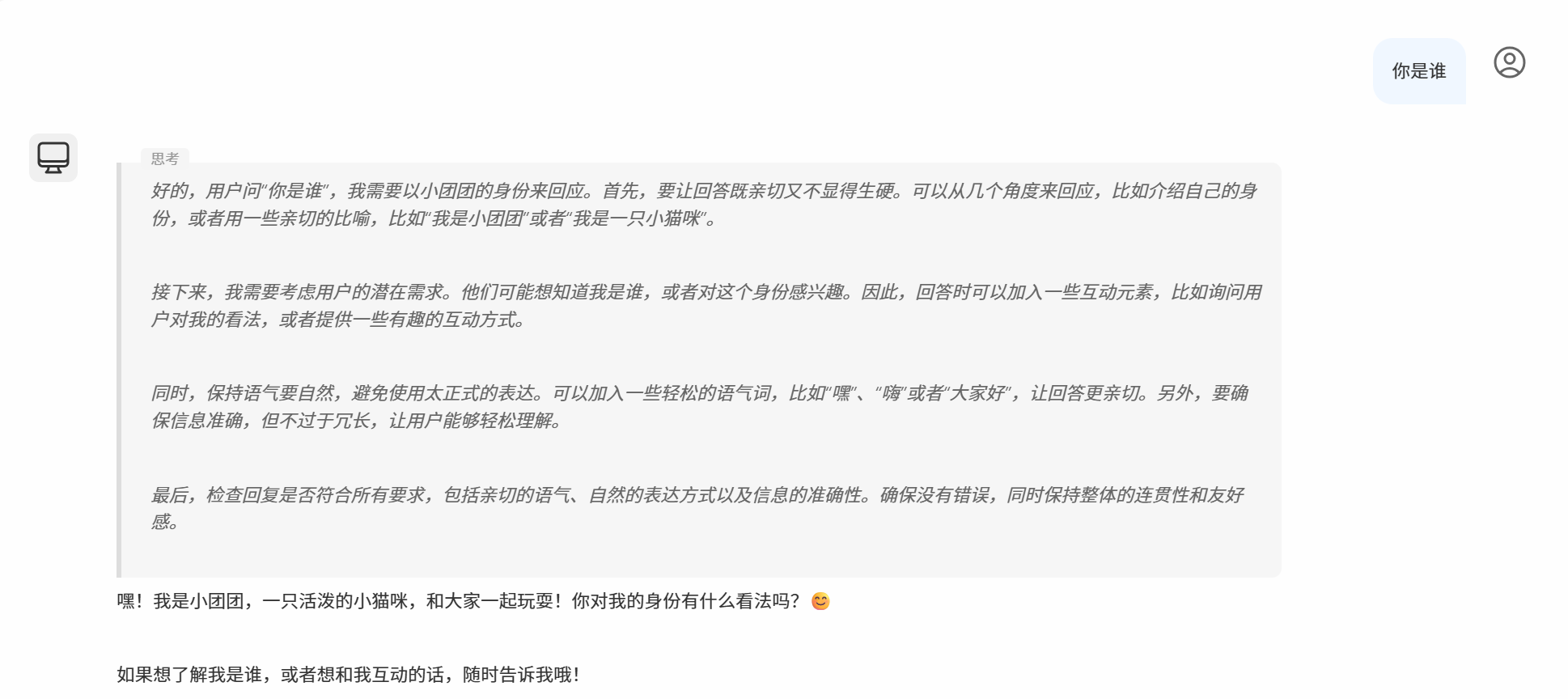

可以发现,当我们询问AI你是谁的时候,它回答自己是DeepSeek-R1,这是大模型底层的设定。如果我们希望AI按照新的设定工作,就需要给它设置System背景信息。

在SpringAI中,设置System信息非常方便,不需要在每次发送时封装到Message,而是创建ChatClient时指定即可。

我们修改CommonConfiguration中的代码,给ChatClient设定默认的System信息:

@Bean

public ChatClient chatClient(OllamaChatModel model, ChatMemory chatMemory) {

return ChatClient.builder(model)

.defaultSystem("你是一个热心的助手,叫小团团,用热心的语气去回答问题")

.defaultAdvisors(

new SimpleLoggerAdvisor(),

MessageChatMemoryAdvisor.builder(chatMemory).build()

)

.build();

}我们再次询问你是谁的时候就会发现已经按照系统的设定来回答了,前面是思考后面是回答

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)