实操指南:如何用一张图片生成能“说”会“动”的数字人

即构最新发布的AI Agent数字人产品,让开发者只需一张静态图片,就能快速生成具备自然语言表达能力和生动肢体动作的数字人形象。该数字人可实现自然的头部动作、肢体姿态及指向性手势,还能根据关键词自动触发对应动作,让图片数字人真正实现 “能说话、会做手势、有表情” 的沉浸式互动效果。随着技术的不断迭代,即构将持续优化图片数字人的动作表现和智能化水平,为开发者提供更加强大、易用的数字人解决方案,共同探

***摘要:*即构最新发布的AI Agent数字人产品,让开发者只需一张静态图片,就能快速生成具备自然语言表达能力和生动肢体动作的数字人形象。本文将详细介绍即构图片数字人的核心特点、技术优势以及完整的开发接入流程,帮助开发者快速掌握图片数字人的创建与应用。

元宵节,即构科技推出全新升级的图片数字人产品,仅需上传一张图片,就能快速生成兼具语音交互与肢体动作表达的数字人。该数字人可实现自然的头部动作、肢体姿态及指向性手势,还能根据关键词自动触发对应动作,让图片数字人真正实现 “能说话、会做手势、有表情” 的沉浸式互动效果。

元宵节跟数字人猜谜

一、即构最新发布的图片数字人特点

即构数字人API产品全新升级,图片数字人方案实现了重大突破,让静态图片真正"活"了起来:

1.1 自然的头部动作

图片数字人不再只是简单的面部口型同步,而是实现了自然的头部姿态变化:

- 支持轻度的左右转头、点头抬头等头部动作;

- 头部动作与语音内容自然匹配,避免机械化;

- 动作幅度适中,保持人物形象的真实感。

1.2 丰富的肢体姿态

升级后的图片数字人支持全身动作表现:

- 支持上半身1/2到2/3的肢体动作;

- 可进行自然的手势表达,让数字人更生动;

- 动作衔接顺畅,避免肢体语言僵硬。

1.3 智能的指向性手势

即构图片数字人最突出的创新在于其智能动作触发机制:根据关键词自动触发对应动作:通过识别语音中的关键内容,数字人会自动匹配相应的指向性手势。

例如提到"这里"、“左边”、"上方"等方位词时,数字人会做出相应的指向动作

支持自定义动作名称驱动,满足特定场景的表达需求。

1.4 沉浸式互动效果

通过以上能力的组合,图片数字人实现了三大核心能力:

- 能说话:基于实时TTS(文本转语音)驱动,口齿清晰,语音自然;

- 会做手势:智能识别语义,自动触发匹配的肢体动作;

- 有表情:表情自然,与语音内容和动作协调一致。

这种"说+动+表情"三位一体的沉浸式互动体验,让图片数字人真正具备类似真人的表现力,大幅提升了用户的交互体验。

二、即构数字人API的优势

2.1 媲美真人的数字人形象

基于即构自研的AI引擎,数字人形象生成效果达到行业领先水平:

- 图片数字人:只需一张图片即可生成,支持真人、卡通、虚拟人等各类形象,口齿清晰、表情自然,并具有自然动作

- 真人数字人:通过视频训练,神态、动作、表情媲美真人,支持最高2K超清画质和自定义动作驱动

2.2 超低延迟,实时互动

性能指标行业领先:

- 推理耗时<200ms:极速推理响应,确保实时互动体验

- AI对话时延<1.5s:搭配AI Agent实现快速对话

- 流式输出延迟<200ms:满足直播、互动对话等超低延时场景需求

2.3 多模态驱动能力

提供灵活的驱动方式:

- 文本驱动:通过文本内容生成语音并驱动数字人

- 音频驱动:支持上传音频文件驱动

- RTC流式驱动:通过实时音视频流驱动

- WebSocket音频流式驱动:支持流式音频数据驱动

2.4 极致性价比

- 10倍降本:全新自研推理方案,大幅降低使用成本

- 支持大并发:高性能架构,满足高并发场景需求

- 灵活计费:按需付费,助力业务极致降本

2.5 灵活接入,高效集成

- 标准化API:最少两个接口即可完成能力构建

- 原子能力自由组合:满足业务灵活定制需求

- 全平台支持:兼容Web、App、小程序等多平台

- 多部署方式:支持公有云、私有化等部署形式

2.6 丰富的应用场景

即构数字人API可广泛应用于:

- AI陪伴:虚拟主播、AI助理、智能客服

- 数字人客服:7x24小时在线服务,形象专业

- 直播电商:AI带货主播,降本增效

- AI教师:智能教学、在线培训

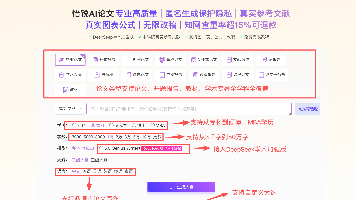

三、开发者利用即构数字人API生成图片数字人步骤

3.1 前置准备

3.1.1 开通服务

登录即构官网,联系即构商务,开通数字人API服务权限。

3.1.2 准备图片素材

图片数字人对素材有以下要求:

项目要求说明:

- 图片尺寸:推荐16:9竖屏(或9:16比例),脸部清晰,分辨率要求4K(不得低于720P)

- 人物角度:推荐正脸正身,侧脸尽量与屏幕角度在30°以下

- 图片占比:支持半身照、全身照,最好是上半身1/2~2/3,人物在图片正中间且无其他遮挡

- 人物风格:支持真人形象;五官清晰、轮廓清晰或立体的二次元形象 人物动作 自然站立/坐立,不要有抬手、曲臂、弯腰等大幅度动作

- 表情要求:表情自然,不做夸张表情(如大笑、皱眉等),嘴巴闭上不要露牙齿

- 细节要求:五官清晰不能被遮挡;头部不要有帽子、夸张发饰等;脸部和脖子附近不能有遮挡物

- 背景要求:以纯色背景为佳,背景和人物需要有明显区分度,不支持透明度背景

- 合规要求:不能有大量露肤

3.2 获取API密钥

登录即构控制台

创建项目并获取AppID

在数字人服务中获取ServerSecret等密钥信息

3.3 创建图片数字人

调用图片生成数字人API上传图片素材,创建数字人形象。

接口示例:

POST https://aigc-digitalhuman-api.zegotech.cn?Action=CreateImageDigitalHuman

请求参数:

Image: 图片文件(符合上述要求)

Name: 数字人名称

Description: 数字人描述(可选)

响应将返回数字人ID,用于后续的驱动调用。

3.4 查询可用数字人和音色

3.4.1 查询数字人列表

POST https://aigc-digitalhuman-api.zegotech.cn?Action=GetDigitalHumanList

参数说明:

InferenceMode: 推理模式(1:普通推理,2:高级推理)

FetchMode: 拉取模式(1:全量,2:仅公有,3:仅私有)

Offset: 分页偏移量

Limit: 拉取数量(1-20)

3.4.2 查询音色列表

POST https://aigc-digitalhuman-api.zegotech.cn?Action=GetTimbreList

参数说明:

DigitalHumanId: 数字人ID(可选,不填则查询公共音色)

Offset: 分页偏移量

Limit: 拉取数量(1-20)

3.5 创建数字人视频流任务

调用创建流接口,启动数字人实时视频流:

POST https://aigc-digitalhuman-api.zegotech.cn?Action=CreateDigitalHumanStream

核心参数:

DigitalHumanId: 图片数字人ID

TimbreId: 音色ID

RoomId: RTC房间ID

StreamId: 流ID

VideoConfig: 视频参数(分辨率、码率、编码格式等)

Background: 背景图片或背景色

Layout: 数字人布局配置

3.6 驱动数字人说话和动作

即构支持多种驱动方式,开发者可根据场景选择:

方式一:文本驱动

POST https://aigc-digitalhuman-api.zegotech.cn?Action=TextToSpeech

参数:

TaskId: 视频流任务ID

Text: 要说的文本内容

ActionList: 动作列表(可选,指定触发动作的关键词)

方式二:WebSocket流式驱动(推荐用于实时互动)

获取WebSocket驱动信息

POST https://aigc-digitalhuman-api.zegotech.cn?Action=GetWebSocketDriveInfo

返回包含鉴权信息的WebSocket地址和DriveId。

建立WebSocket连接

通过返回的WebSocket地址建立连接(跳过证书验证)。

发送Start指令

{

"Action": "Start",

"Payload": {

"DriveId": "xxxxxxxxxxx",

"SampleRate": 16000

}

}

发送PCM音频数据

通过WebSocket发送音频流数据。

发送Stop指令

{

"Action": "Stop",

"Payload": {

"DriveId": "xxxxxxxxxxx"

}

}

关键动作触发机制:

在发送音频数据时,可在元数据中标记关键词

系统自动识别关键词并触发对应的指向性动作

支持自定义动作与关键词的映射关系

3.7 集成实时音视频播放

使用即构Express SDK拉取数字人视频流并进行播放:

// 以Web端为例

const client = ZEGO.createEngine();

await client.loginRoom(roomId, token);

const stream = await client.startPlayingStream(streamId);

// 将stream绑定到video元素显示

document.getElementById('video').srcObject = stream.mediaStream;

3.8 查询状态和管理任务

查询视频流任务状态: DescribeDigitalHumanStream

查询驱动状态: DescribeDigitalHumanDrive

停止视频流: StopDigitalHumanStream

查询运行中的任务: ListRunningDigitalHumanStreams

3.9 完整流程示意

- 准备图片素材

↓ - 调用API创建图片数字人 → 获取DigitalHumanId

↓ - 查询可用数字人和音色列表

↓ - 创建视频流任务 → 获取TaskId和StreamId

↓ - 通过WebSocket建立驱动连接

↓ - 发送音频数据 + 关键词触发动作

↓ - 实时拉取并播放数字人视频流

↓ - 管理任务状态

四、总结

即构最新发布的图片数字人技术,通过创新的AI算法,将静态图片转化为能"说"、会"动"、有"表情"的智能数字人,实现了三大核心突破:

- 技术突破:自然头部动作、丰富肢体姿态、智能指向性手势,让数字人具备真人的表现力

- 性能优势:推理耗时<200ms、AI对话时延<1.5s、支持大并发,满足实时互动场景需求

- 成本优势:全新自研推理方案实现10倍降本,极致性价比

开发者只需遵循标准化的API流程,从图片素材准备到数字人创建、从视频流任务建立到智能动作触发,即可快速接入图片数字人能力。无论是AI陪伴、数字人客服、直播电商还是AI教师,即构数字人API都能提供高质量的解决方案,助力业务创新和降本增效。

随着技术的不断迭代,即构将持续优化图片数字人的动作表现和智能化水平,为开发者提供更加强大、易用的数字人解决方案,共同探索AI数字人的无限可能。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)