科研快报 |AI如何学会水墨丹青?这篇论文让 diffusion模型懂了“勾勒与晕染”

近期发表于《Pattern Recognition》(Q1/一区)的论文提出ChipDiff模型,专门解决中国水墨画风格迁移难题。该模型创新性地采用两阶段扩散机制:前期(t≥40)专注于结构保持,后期(t<40)注入水墨纹理细节。通过精心设计的损失函数组(包括VGG感知损失、HED边缘损失等)和专用TCWP数据集,模型成功模拟了"先勾勒后晕染"的传统技法。实验表明,Chi

Prism Path

科 研 快 报

CS跨学科顶尖期刊论文资讯

-NO.2026004-

ChipDiff:基于损失梯度引导的分阶段扩散模型实现中国水墨画风格迁移

ChipDiff: Staged diffusion model with loss gradient guidance for Chinese ink painting style transfer

期刊:Pattern Recognition(Q1/一区)

发布日期:2026年02月28日

DOI: 10.1016/j.patcog.2026.113309(论文数据图表详见)

目录

中国水墨画(Shui-Mo)讲究“气韵生动”,其独特的审美核心在于各向异性的水墨扩散、单色的分层墨韵(焦浓重淡清)以及基于点线的“骨法用笔”。然而,当我们要用计算机去复现这种艺术时,传统模型往往陷入困境。

通用风格迁移方法如基于VGG的Gram矩阵方法,在处理水墨画时,常常将刻意为之的“留白”(Liubai)误读为背景噪声,或者无法模拟水墨在宣纸上的自然渗化(bleeding)效果。尽管生成对抗网络(GANs)和扩散模型(Diffusion Models)近年来取得了巨大成功,但在面对水墨画时,GANs容易产生生硬的“光晕伪影”,而标准扩散模型则缺乏对笔触骨架(bone-work)的精细控制。

针对这一痛点,最新发表于《Pattern Recognition》期刊的论文提出了ChipDiff——一种专门为中国水墨画风格迁移设计的分阶段扩散框架。它模仿了传统画家“勾勒(Brushing)而后晕染(Inking)”的创作流程,通过损失梯度引导,在数字世界中实现了结构与神韵的平衡。

一、论文核心贡献

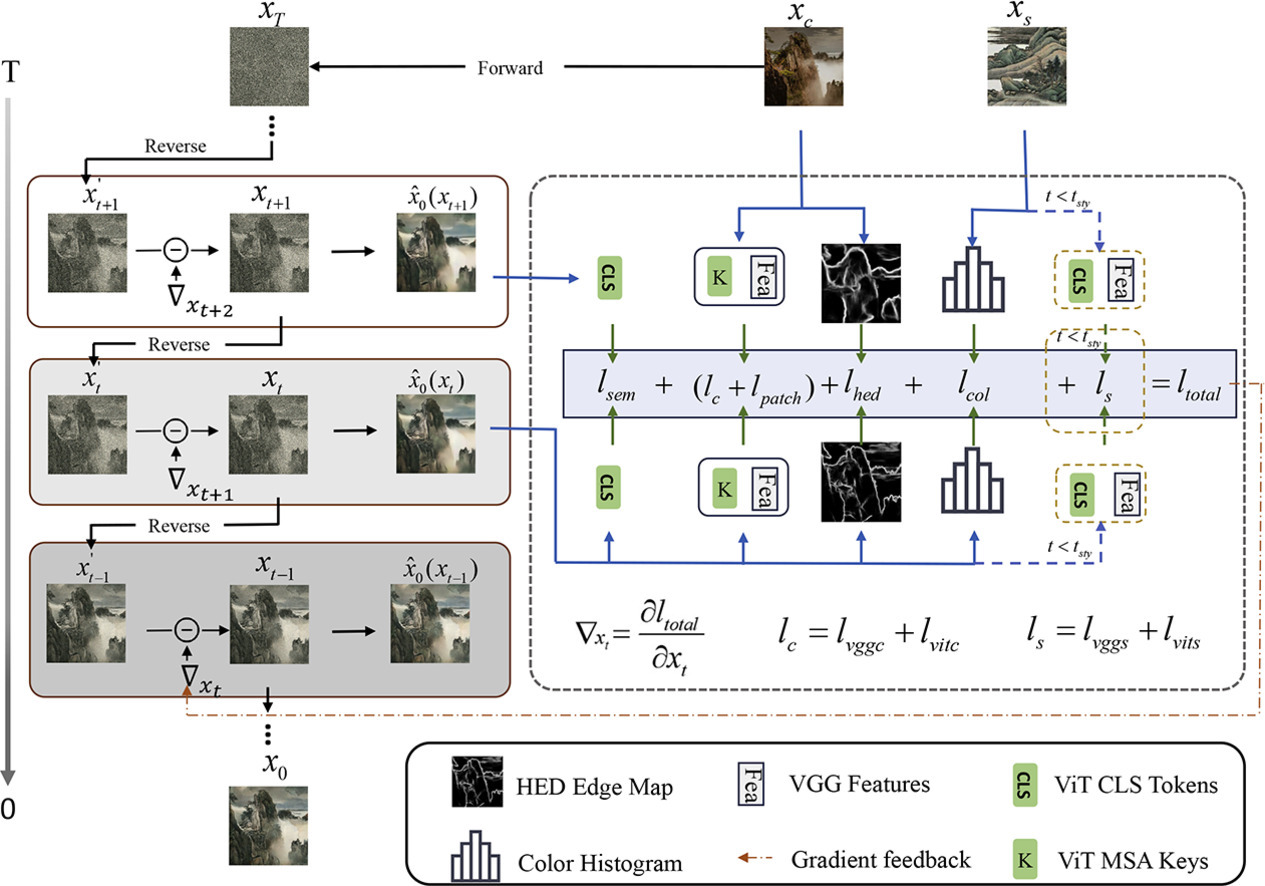

ChipDiff的核心洞察在于:扩散模型在不同时间步(timestep)具有不同的功能优先级——早期阶段决定结构布局,后期阶段填充纹理细节。

基于此,论文提出了一种两阶段采样策略,并辅以一套量身定制的损失函数。

1. 两阶段采样机制

ChipDiff不再是一个黑盒的单步去噪,而是设定了关键阈值 tstytsty:

-

第一阶段(t≥tstyt≥tsty,结构导向采样):此时信噪比较低,模型专注于恢复全局布局和“骨架”。主要依靠内容结构损失,确保物体的形状和场景结构不被破坏。

-

第二阶段(t<tstyt<tsty,风格细节细化):进入高保真度阶段,正式引入风格表征损失。模型开始注入精细的水墨纹理、各向异性渗化效果和单色渐变层。

这种物理意义上的解耦,有效防止了早期阶段因追求风格而导致的几何失真,完美契合了“先立骨,再填肉”的艺术直觉。

2. 多维度的损失函数引导

不同于依赖文本提示(prompt)的方法(难以描述非语言的渗化美感),ChipDiff采用了一套完全基于图像特征的可微分损失函数组合:

-

结构保持组:

-

内容损失(lclc):结合VGG感知损失和ViT自相似性矩阵,确保多尺度结构对齐。

-

HED边缘损失(lhedlhed):强制保留线描的几何轮廓,防止笔触模糊。

-

Patch对比损失(lpatchlpatch):维持局部纹理的不规则性,避免墨韵区域过度平滑。

-

-

水墨风格组:

-

风格表征损失(lsls):结合VGG-Gram矩阵(捕捉局部纹理)和ViT的[CLS]令牌(捕捉全局风格)。

-

可微分颜色直方图损失(lcollcol):这是本文的一个亮点。通过Sigmoid函数构建了一个完全可微分的颜色直方图,专门用于约束单色(monochromatic)分布的准确性,确保“墨分五色”的灰度层次。

-

3. 构建TCWP专用数据集

为了支撑该研究,团队构建了TCWP(Texture Collection of Water-ink Painting) 数据集。该数据集包含3328张高质量水墨画图像,并经过了严格的分辨率过滤、去重、语义验证和纹理均衡,包含点、线、方三种基元,为模型预训练和评测提供了标准化的基础。

二、模型效果分析

在TCWP数据集和ChipPhi数据集上的实验表明,ChipDiff不仅在视觉观感上更胜一筹,在定量指标上也实现了对现有方法的全面超越。(图表数据因版权敏感,详见于DOI地址)

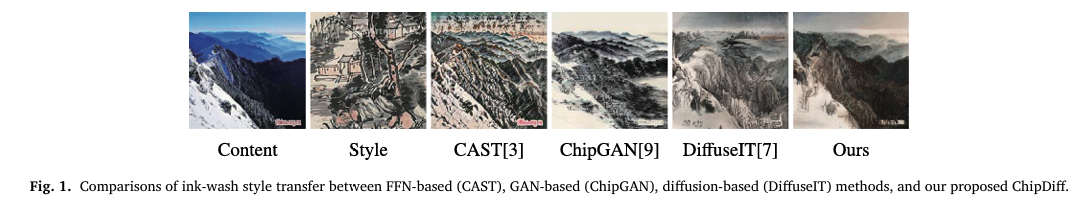

1. 定性视觉对比

-

对比FFN(前馈网络)方法:相比Avatar、CAST等方法,ChipDiff避免了纹理碎片化,在保留山石、树叶结构的同时,生成了和谐的自然墨韵变化。

-

对比扩散SOTA:相比DiffFashion、DiffuseIT、StyleID,ChipDiff解决了结构不一致(天空区域畸变等)和纹理斑驳的问题,实现了更均衡、更精细的晕染效果。

-

对比GAN方法:相比BitGAN和ChipGAN,ChipDiff有效抑制了山体轮廓的形变和上部区域的伪影,内容结构保持度极高。

2. 定量指标解读

针对水墨画这一特殊领域,论文提出了专门的评估协议,除了常规指标外,重点引入了颜色迁移率(CTR)、颜色偏差率(CDR)、色彩数量(Color Quantity)和笔触数(Stroke Count)。

| 对比维度 |

ChipDiff (本文) |

扩散基线 (DiffuseIT) |

GAN基线 (ChipGAN) |

|---|---|---|---|

| 核心哲学 |

分阶段梯度引导 (先结构后纹理,模拟人工绘制流程) |

单阶段梯度引导:全程使用相同损失组合 | 对抗学习:依赖判别器区分真伪 |

| 结构保持 (lvitclvitc) |

0.053 (TCWP上排名第二,更优) |

0.057 (稍差) | 0.063 (ChipPhi上表现最差) |

| 边缘保持 (lhedlhed) |

0.303 (TCWP上排名第二,更优) |

0.320 (较差) | 0.415 (对笔触轮廓保持不足) |

| 颜色保真度 (CTR) | 0.94 (高) | 0.94 (持平) | 0.93 (稍低) |

| 域一致性 (Color Q.) |

15.84 (最接近真实水墨分布) |

16.85 (偏高,色彩略杂) |

16.00 (偏高) |

| 统计显著性 |

经Shapiro-Wilk检验和t检验, 均p<0.05,证明提升具有统计学意义 |

- | - |

ChipDiff在结构保持指标(lhedlhed 和 lvitclvitc)上显著优于现有的扩散模型。这说明,如果不在早期阶段刻意保护内容,即使是强大的扩散模型也会引入风格图像中的结构噪声。

同时,在域一致性(Color Quantity)上,ChipDiff生成图像的色彩数量更接近真实水墨画(15.84),避免了其他方法带来的色彩过杂或过单调的问题。

3. 消融实验的关键启示

-

阶段性触发点 tstytsty 至关重要:实验表明,过早引入风格损失(tsty=80tsty=80)会破坏结构;过晚引入(tsty=10tsty=10)则导致风格迁移不充分。tsty=40tsty=40是实现结构-风格平衡的最优解。

-

Patch损失与语义发散损失缺一不可:移除 lpatchlpatch 会导致语义区域的广泛畸变,而移除 lsemlsem 则会引起细微的不稳定性。两者共同维护了生成过程的局部与全局一致性。

-

颜色损失(lcollcol)的必要性:如果没有这一可微分颜色直方图约束,模型容易忽略颜色对齐,导致生成的图像虽具墨韵但色调偏离参考图。

三、总结

ChipDiff不仅仅是一个针对水墨画的模型,而是为极具挑战的中国水墨画风格迁移问题提供了一个优雅且严谨的解决方案。它通过模仿人类创作过程的两阶段采样机制,结合一套完备的损失梯度引导体系,成功调和了“结构保存”与“风格注入”之间的矛盾。

这项工作不仅刷新了水墨画风格迁移的SOTA,其“分阶段生成”的理念也为更广泛的图像合成与编辑任务提供了重要的参考范式。

EI会议征稿中:IC-IPPR 2026

我们诚挚发起本次“2026年图像处理与模式识别国际会议 (IC-IPPR 2026)”的征稿,旨在汇聚全球顶尖学者、研发工程师与青年学子,共同搭建一个深度交流、碰撞思想、孕育合作的高端平台。

【组织单位】喀什大学、管理与技术大学(UMT)、新加坡机器人学会(RSS)

【会议出版】所有论文将由会议委员会的2-3名专家评审员进行评审。经过仔细的审查过程,所有被接受的论文都将发表在SPIE-The International Society for Optical Engineering《会议论文集》上,并提交给EI Compendex和Scopus进行索引。

【审稿流程】投稿 (全英WORD+PDF) - 稿件收到确认 (1个工作日) - 初审 (3个工作日内) - 告知结果 (接受/拒稿)

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)