【AI Agent基础 | 第二篇】从被动问答到主动推进任务的智能体

本文探讨了AI智能体(Agent)的概念及其在多步骤任务处理中的优势。文章首先区分了两种任务类型:一次性任务(无状态)和多步骤任务(有状态),指出传统AI模型仅适合处理前者。针对需要逐步推进的复杂任务,作者阐释了Agent的核心特征:具备目标意识、状态意识和行动意识,能够自主决策和动态调整流程。与固定流程的Workflow不同,Agent通过"思考-执行-反馈"的循环机制主动推

目录

Agent基础学习心得:从被动问答到主动推进任务的智能体

上一篇我们理清了一个核心点:AI模型本质上只是“拥有能力的工具”,而非“能主动做事的主体”。不管是大语言模型、多模态模型还是向量模型,它们的核心逻辑都很简单——给输入就出输出,全程被动响应。但在实际用AI解决问题时,发现一个现实问题:很多事根本不是“问一句、答一句”就能搞定的。

那些一次问答搞不定的事

先举个很实际的例子,一个典型的多步骤任务:从数据库里查一些数据,对数据做分析,最后把分析结果发到指定邮箱。如果直接把这个任务丢给普通AI模型,让它“直接给出结果”,大概率会得到这样的反馈:一段看起来逻辑通顺的分析文字,可能还附带一段看似专业的SQL代码,最后加一句“我已经把结果发去邮箱了”。

但真相是,数据库压根没被查询,分析也不是基于真实数据,邮件更是没发出去。这不是模型不够智能,而是这类任务本身就不适合“一次输入、一次输出”的模式来完成。

任务本身的类型

后来发现,其实任务可以简单分成两类,对应不同的AI使用场景,理解这一点就能明白为什么有的任务AI能直接搞定,有的却不行。

1. 一次性任务(无状态任务)

这类任务的特点很鲜明:不用依赖中间过程,一步就能完成,输入和输出的关联很直接。比如总结一段文字、翻译一篇文章、根据描述写一段代码,这些都是典型的一次性任务,交给普通模型就能高效搞定,完全不需要额外操作。

2. 多步骤任务(有状态任务)

像前面“查数据→分析→发邮件”的任务,就属于这类。它有明确的最终目标,必须一步步推进,每一步的结果都要依赖上一步,而且中间还得和数据库、邮件系统这些真实工具交互。这类任务本质上是一个“过程”,而不是一个“答案”,普通模型自然搞不定。

只要任务变成了“过程”,就需要有人(或某个单元)来理清三个问题:我要达成什么目标?现在做到哪一步了?接下来该做什么?而普通模型,根本不会主动思考这些。

Agent 为什么会出现?

正是为了解决多步骤任务的痛点,Agent(智能体)这个概念才应运而生。翻了不少资料后发现,不同文章对Agent的定义差别很大:有的说它能“自主决策”,有的强调它能“长期运行”,还有的说它擅长“规划任务”。

但以我目前的理解,Agent的核心其实很朴素:它就是一个带着明确目标、能一步步推进任务的AI单元。它不纠结于“怎么答好一句话”,而是专注于“怎么把一件事真正做完”,这也是它和普通模型最本质的区别。

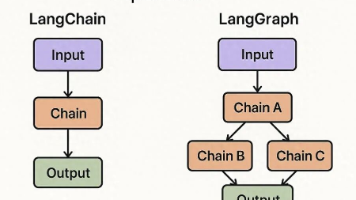

Agent和Workflow

刚开始学的时候,很容易把Agent和Workflow搞混,两者看起来都是“推进多步骤任务”,但底层逻辑差得很远,用通俗的话就能讲明白。

Workflow:流程是写死的

Workflow就是提前把每一步都规划好,流程、顺序全是固定的,AI模型只是在某个节点被调用一下。比如刚才的任务,Workflow会这么设计:第一步查数据库,第二步调用模型分析数据,第三步调用邮件接口发消息。模型全程被动,不用想“下一步该做什么”,只负责完成分配的那一步工作。

它的优点很明显:可控、稳定,出了问题也容易排查,但灵活性极差——如果数据库查不到数据,流程就卡壳了,没法自主调整。

Agent:模型掌握决策权

而Agent模式下,模型不再是被动工具,而是能根据当前进度决定下一步行动,整个流程是动态调整的。它会不断思考:目标完成了吗?现有信息够不够?要不要调用工具?是继续推进还是可以结束?

简单来说,Workflow定好了“做事的步骤”,Agent则决定“下一步该做什么”,这也是判断一个系统是不是Agent的核心标准。

Agent的三层意识

和普通聊天AI比起来,Agent之所以能“做事”,是因为它多了三层最基本的“任务意识”,这三层意识让它从“回答者”变成了“执行者”:

-

目标意识:清楚自己要完成的核心任务是什么,不偏离方向;

-

状态意识:掌握当前进度,知道自己做到哪一步了,手里有哪些可用信息;

-

行动意识:判断接下来该做什么,是否需要调用工具,以及什么时候能结束任务。

Agent Loop:把做事变成一个循环

把上面的三层意识转化为代码结构,本质上所有Agent系统都离不开一个核心循环(也就是Agent Loop)。这里不用纠结具体代码,我们只看概念层面:

这个循环大概是“思考→执行→反馈→再思考”的逻辑,其中“思考”不只是想一句话,“执行”也不一定是跑代码,更多是职责划分。这个循环的价值在于,把“推进任务”这件事变得有规律、可掌控,不管后面遇到多复杂的Agent框架,本质上都能还原成这个简单的循环。

一个Agent不够用?试试多智能体协作

当任务越来越复杂,我发现一个Agent很难搞定所有事——有的任务需要擅长规划拆解,有的需要精准检索信息,还有的侧重数据分析和总结。这时候就需要多个Agent分工合作,每个Agent负责自己擅长的领域,一起推进同一个目标。

这种多个Agent协作的系统,就叫做Agentic System(智能体系统),也是目前Agent领域比较热门的方向,能应对更复杂的真实场景。

Agentic:不是技巧,是系统设计思路

Agentic是个很新的概念,网上高质量的文章大多是近一两年才出现的。刚开始以为它是某种模型使用技巧,后来才明白,它和用哪个模型、写什么提示词没关系,本质上是一种系统设计思路。

Agentic关注的都是系统层面的问题:怎么拆解复杂任务?怎么管理任务状态?怎么控制过程中的不确定性?多个Agent怎么协作?如何让AI在系统中稳定运行?这么看下来,Agentic其实更偏向后端开发的问题,而不是单纯的AI技巧。

Agent 做事,离不开真实世界的工具

最后还有一个绕不开的问题:Agent能决定下一步做什么,但真正的动作还得靠真实系统来执行。比如查数据库、调用接口、发邮件、读写文件,这些能力模型本身都没有。

那Agent是如何请求这些能力的?系统又该如何安全地把这些工具交给AI使用?这是下一篇要和大家分享的核心内容——工具调用以及MCP。简单剧透一下:AI并不是自己在做事,而是在指挥系统做事。

上述内容也同步在我的飞书,欢迎访问

https://my.feishu.cn/wiki/QLauws6lWif1pnkhB8IcAvkhncc?from=from_copylink

如果我的内容对你有帮助,请点赞,评论,收藏。创作不易,你们的支持就是我坚持下去的动力!

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)