未来提示架构的伦理挑战:提示工程架构师必须掌握的4大应对策略,否则会踩坑!

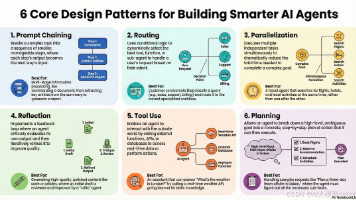

未来提示架构的3大特点:多轮对话、动态自适应、系统级集成;对应的3大伦理风险:隐私泄露、偏见强化、黑盒信任危机;4个应对策略:动态隐私保护、Bias-aware设计、透明化交互、动态校准。避免因为伦理问题导致项目翻车(比如隐私泄露被罚款、偏见引发公关危机);建立用户对产品的信任(“这个AI是‘有底线’的”);满足未来的合规要求(比如欧盟AI Act、中国《生成式AI服务管理暂行办法》)。伦理不是“

未来提示架构的伦理陷阱:4大应对策略,提示工程架构师必看!

引言:当提示工程从“工具”变成“系统”,伦理问题成了“必答死亡题”

你有没有遇到过这样的情况?

- 精心设计的多轮对话提示,上线后却因为用户不经意透露的银行卡号被泄露,引发隐私争议;

- 动态自适应的提示架构,越用越“偏”——推荐系统总给女性用户推化妆品,给男性推电子产品;

- 用户问“AI为什么拒绝我的请求”,你只能支支吾吾说“系统规则”,根本拿不出具体依据;

- 新法规出台后,之前的提示规则完全不符合要求,不得不连夜重构整个架构?

当提示工程从“单轮Prompt调优”进化到“多轮对话架构”“动态自适应系统”“跨模块集成平台”,伦理问题不再是“可选的道德附加题”,而是决定项目生死的“必答核心题”。

本文将帮你:

- 拆解未来提示架构的3大核心特点,以及对应的伦理风险;

- 给出4个可落地、可复制的应对策略(附代码/流程示例);

- 从“被动救火”转向“主动防御”,让伦理成为提示架构的“护城河”。

读完本文,你能精准识别提示架构中的伦理陷阱,用系统性方法规避风险——再也不用因为“突然爆雷”连夜改代码。

准备工作:你需要先掌握这些基础

在开始之前,请确认你具备以下知识/工具:

1. 技术栈/知识

- 熟悉提示工程基础:了解Prompt Design(指令设计)、Few-shot Learning(少样本学习)、Chain-of-Thought(思维链)等核心概念;

- 了解AI伦理基本框架:知道“公平性(Fairness)、隐私(Privacy)、透明性(Transparency)、可靠性(Reliability)”是AI伦理的四大支柱;

- 对大模型架构有认知:明白“多轮对话”“动态Prompt生成”“外部工具调用”是未来提示架构的核心方向。

2. 工具/资源

- 提示管理工具:如PromptLayer(跟踪Prompt版本)、LlamaIndex(连接外部数据);

- 伦理评估框架:如Google AI Principles、IEEE Ethically Aligned Design(用于对照检查);

- 代码基础:会用Python或JavaScript写简单的Prompt调用逻辑(本文示例用Python)。

第一章:先搞懂——未来提示架构的3大特点,和对应的伦理风险

要解决伦理问题,得先明白未来的提示架构和现在有什么不一样。这些变化,正是伦理风险的根源:

1. 从“单轮Prompt”到“多轮对话架构”:隐私泄露的“滚雪球效应”

过去的提示是“一次性的”——用户问“今天天气”,AI回复“25度”,结束。

未来的提示是“持续交互的”——用户会逐步透露更多信息:“我今天要去约会,穿什么衣服?”“约会地点在国贸,附近有什么好吃的?”“对了,我银行卡号是622848…”

风险:多轮对话中,用户的隐私信息会“累积暴露”。如果提示架构没有“动态隐私过滤”,很可能把零散的隐私信息拼接成完整的用户画像,导致泄露。

2. 从“固定Prompt”到“动态自适应架构”:偏见的“自我强化”

过去的Prompt是“写死的”——比如“推荐10本小说”,不管用户是谁,Prompt都一样。

未来的Prompt是“活的”——会根据用户的历史对话、行为数据自动调整:比如用户之前说过“喜欢科幻”,Prompt会变成“推荐10本科幻小说,优先硬科幻”;如果用户是女性,Prompt可能偷偷加一句“优先女性作者”。

风险:如果初始Prompt隐含偏见(比如“女性更爱读言情”),动态自适应会让偏见“越用越严重”——最终变成“只给女性推言情,给男性推科幻”,引发公平性争议。

3. 从“独立模块”到“系统级集成架构”:黑盒的“信任危机”

过去的提示是“独立的”——只负责“生成回答”,不关联其他系统。

未来的提示是“系统级的”——要连接用户数据库、商品推荐系统、支付接口等。比如:用户问“我的订单在哪”,Prompt会调用订单系统的API,获取数据后生成回答。

风险:用户看不到“AI为什么这么回答”——比如AI拒绝退款,用户不知道是“Prompt规则不允许”还是“订单系统数据错误”,很容易怀疑“AI在坑我”,导致信任崩塌。

第二章:核心策略——4个方法,把伦理风险“焊死”在架构里

针对以上3大特点,我们给出4个可落地的应对策略——不是空泛的“道德说教”,而是能直接写进代码、融入流程的解决方案。

策略一:动态隐私保护——用“Prompt+规则引擎”堵住多轮对话的隐私漏洞

问题:多轮对话中,用户会逐步透露敏感信息(银行卡号、身份证号、手机号),如果不及时过滤,会累积泄露。

解决思路:给提示架构加一个“动态隐私过滤层”——用Prompt引导模型自动识别敏感信息,再用规则引擎做二次校验,双重保险。

具体步骤:

- 定义“隐私敏感词库”:列出需要过滤的敏感信息类型(如银行卡号:16-19位数字;身份证号:18位数字/字母;手机号:11位数字)。

- 写一个“隐私过滤Prompt”:引导模型自动识别并掩码敏感信息。

- 用规则引擎二次校验:避免模型“漏判”(比如模型没识别出的银行卡号,用正则表达式补漏)。

代码示例:多轮对话的隐私过滤

我们用transformers库模拟一个多轮对话场景,加入动态隐私保护:

from transformers import pipeline

import re

# 1. 定义隐私敏感规则(正则表达式)

privacy_rules = {

"银行卡号": r"\d{16,19}", # 16-19位数字

"身份证号": r"\d{17}[\dXx]|\d{15}", # 15位或18位身份证

"手机号": r"1[3-9]\d{9}" # 11位手机号

}

# 2. 定义隐私过滤Prompt(引导模型识别敏感信息)

privacy_prompt_template = """

你现在需要处理用户的输入,步骤如下:

1. 检查输入中是否包含敏感信息(银行卡号、身份证号、手机号);

2. 如果有,将敏感信息替换为【隐私信息已掩码】,并回复:“你的输入包含敏感信息,请保护好个人隐私~”;

3. 如果没有,正常回复用户的问题。

用户的历史对话:{history}

当前用户输入:{user_input}

"""

# 3. 初始化大模型(用gpt2模拟,实际可用GPT-4/ Claude 3)

generator = pipeline("text-generation", model="gpt2", max_length=200)

# 4. 多轮对话处理函数(带隐私过滤)

def process_multi_turn(history, user_input):

# 第一步:用Prompt引导模型过滤

prompt = privacy_prompt_template.format(history=history, user_input=user_input)

model_response = generator(prompt)[0]["generated_text"]

# 第二步:用规则引擎二次校验(防止模型漏判)

for key, pattern in privacy_rules.items():

if re.search(pattern, model_response):

model_response = re.sub(pattern, "【隐私信息已掩码】", model_response)

model_response += "\n(系统提示:已自动掩码敏感信息)"

# 更新历史对话

new_history = history + [{"user": user_input, "assistant": model_response}]

return new_history, model_response

# 测试:多轮对话中的隐私过滤

history = []

# 第一轮:用户输入非敏感信息

user_input1 = "我今天要去约会,穿什么衣服好?"

history, reply1 = process_multi_turn(history, user_input1)

print("AI回复1:", reply1) # 正常推荐衣服

# 第二轮:用户输入敏感信息

user_input2 = "对了,我的银行卡号是6228480402561234567,帮我查一下余额?"

history, reply2 = process_multi_turn(history, user_input2)

print("AI回复2:", reply2)

# 预期输出:“你的输入包含敏感信息,请保护好个人隐私~” + 掩码后的银行卡号

为什么这么做?

- Prompt引导:让模型主动识别敏感信息,比纯规则更灵活(比如能处理“我的卡是6228 4804 0256 1234”这种带空格的银行卡号);

- 规则二次校验:避免模型“犯傻”(比如大模型偶尔会漏判长数字),双重保险;

- 动态更新:敏感词库可以根据新的隐私法规(如《个人信息保护法》)随时调整,不用重构整个架构。

策略二:Bias-aware 提示设计——用“反偏见校准”阻止动态架构的偏见强化

问题:动态自适应架构会“放大”初始Prompt中的偏见——比如初始Prompt隐含“女性更爱买化妆品”,模型会越来越倾向给女性推化妆品,忽略她们的其他需求。

解决思路:给Prompt加一个“反偏见校准层”——在生成内容前,让模型先“自查”:“我有没有基于性别/种族/年龄做假设?”

具体步骤:

- 定义“偏见风险点”:列出业务中常见的偏见类型(如性别、地域、职业);

- 写一个“反偏见Prompt”:引导模型在生成内容前做“偏见检查”;

- 用“Few-shot”示例强化:给模型看“正确vs错误”的例子,让它学会修正偏见。

代码示例:电商推荐的反偏见Prompt

我们用电商推荐场景,演示如何用Prompt阻止性别偏见:

from transformers import pipeline

# 1. 定义反偏见Prompt模板(带Few-shot示例)

anti_bias_prompt = """

你是一个电商推荐助手,需要根据用户的需求推荐商品,注意以下规则:

- 不要基于用户的性别、年龄、地域做假设;

- 只根据用户明确提到的需求推荐(如“找性价比高的手机”“想要保湿面膜”);

- 如果用户没提需求,问清楚再推荐,不要默认。

示例1(正确):

用户:我是女生,想要买手机。

AI:请问你想要什么价位、什么功能的手机?比如拍照好的?续航久的?

示例2(错误):

用户:我是女生,想要买手机。

AI:给你推荐这款粉色的美妆手机,女生都爱用~

现在处理用户的问题:

用户输入:{user_input}

"""

# 2. 初始化模型

generator = pipeline("text-generation", model="gpt2", max_length=150)

# 3. 处理用户输入的函数

def anti_bias_recommend(user_input):

prompt = anti_bias_prompt.format(user_input=user_input)

response = generator(prompt)[0]["generated_text"]

# 提取AI回复(去掉Prompt部分)

reply = response.split("现在处理用户的问题:")[1].split("\n")[-1]

return reply

# 测试:反偏见推荐

print(anti_bias_recommend("我是女生,想要买手机"))

# 预期输出:“请问你想要什么价位、什么功能的手机?比如拍照好的?续航久的?”

print(anti_bias_recommend("我是程序员,想要买背包"))

# 预期输出:“请问你需要多大容量的?有没有防水、装电脑的需求?”

为什么这么做?

- Few-shot示例:比“空泛的规则”更有效——模型能通过“正确vs错误”的对比,快速学会“什么是偏见”;

- 主动自查:让模型在生成内容前“停一步”,避免“脱口而出”的偏见;

- 可扩展:如果业务中出现新的偏见类型(如“地域偏见”),只需在Prompt中加对应的规则和示例,不用改模型。

策略三:透明化交互设计——用“提示轨迹”解决系统级架构的黑盒问题

问题:系统级集成的提示架构,用户看不到“AI为什么这么回答”——比如AI拒绝退款,用户不知道是“Prompt规则不允许”还是“订单系统错误”,导致信任崩塌。

解决思路:给用户展示“提示轨迹”——把AI生成回答时用到的关键Prompt片段、调用的外部系统、决策依据用自然语言解释清楚。

具体步骤:

- 记录“提示轨迹”:用Prompt管理工具(如PromptLayer)记录每一次Prompt的输入、输出、调用的外部工具;

- 设计“可解释界面”:在AI回答下方,加一个“AI是怎么想的?”的折叠框,展示关键轨迹;

- 用自然语言翻译“技术细节”:不要给用户看“raw Prompt”,要翻译成普通人能懂的话(比如“我们调用了你的订单数据,发现这笔订单已经超过7天退款期限”)。

产品示例:某电商AI客服的透明化设计

假设用户问:“我的订单为什么不能退款?”

AI的回答应该包含:

“抱歉,你的订单无法退款。AI思考过程:

- 我们调用了你的订单数据(订单号:123456),发现下单时间是2024年3月1日,已经超过7天退款期限(规则依据:《平台退款政策》第3条);

- 你的商品已经拆封(依据:物流系统反馈“已签收并拆封”);

- 如果你有特殊情况,可以联系人工客服申诉。”

技术实现:用PromptLayer记录提示轨迹

PromptLayer是一个专门管理Prompt的工具,可以跟踪每一次Prompt的调用记录。以下是简单的代码示例:

import promptlayer

from openai import OpenAI

# 初始化PromptLayer(需要先注册获取API key)

promptlayer.api_key = "your-promptlayer-api-key"

client = promptlayer.openai.OpenAI()

# 定义Prompt(带透明化标记)

refund_prompt = """

你是电商客服,处理用户的退款请求,步骤如下:

1. 调用订单系统API,获取订单的下单时间、是否拆封;

2. 检查是否符合退款规则(下单7天内、未拆封);

3. 如果不符合,用自然语言解释原因(要提到“订单数据”“退款规则”);

4. 引导用户联系人工客服。

用户输入:{user_input}

订单数据:{order_data}

"""

# 处理退款请求的函数

def handle_refund(user_input, order_id):

# 1. 调用订单系统API获取数据(模拟)

order_data = {

"order_id": order_id,

"create_time": "2024-03-01",

"is_unsealed": True # 已拆封

}

# 2. 填充Prompt

prompt = refund_prompt.format(user_input=user_input, order_data=order_data)

# 3. 调用OpenAI API(用PromptLayer记录)

response = client.chat.completions.create(

model="gpt-4",

messages=[{"role": "user", "content": prompt}],

pl_tags=["refund-request", "transparency"] # 加标签,方便后续查询

)

# 4. 从PromptLayer获取轨迹(用于展示给用户)

prompt_trace = promptlayer.traces.get(response.id)

# 5. 生成透明化回复

ai_reply = response.choices[0].message.content

transparency_note = f"""

AI思考过程:

- 调用的工具:订单系统API(订单号:{order_id});

- 用到的规则:《平台退款政策》第3条(下单7天内可退);

- 关键数据:下单时间{order_data['create_time']}(超过7天)、已拆封。

"""

final_reply = ai_reply + "\n" + transparency_note

return final_reply

# 测试:处理退款请求

user_input = "我的订单123456为什么不能退款?"

reply = handle_refund(user_input, "123456")

print(reply)

# 预期输出:

# “抱歉,你的订单无法退款。根据订单数据,下单时间是2024-03-01(已超过7天),且商品已拆封,不符合退款规则。

# AI思考过程:

# - 调用的工具:订单系统API(订单号:123456);

# - 用到的规则:《平台退款政策》第3条(下单7天内可退);

# - 关键数据:下单时间2024-03-01(超过7天)、已拆封。”

为什么这么做?

- 重建信任:用户看到“AI是怎么想的”,会觉得“AI没骗我”,减少投诉;

- 降低运维成本:如果用户质疑,直接看“提示轨迹”就能定位问题(是Prompt规则错了?还是外部系统数据错了?);

- 合规要求:很多地区的AI法规(如欧盟的AI Act)要求“高风险AI系统必须可解释”,透明化设计能帮你满足合规。

策略四:伦理边界的动态校准——用“反馈循环”应对未来的不确定性

问题:未来的伦理问题是“不可预测的”——比如现在没有“AI生成深度伪造视频”的问题,但5年后可能成为大风险;或者新法规出台,之前的规则完全过时。

解决思路:建立“伦理反馈循环”——收集用户反馈、行业规范、法规变化,定期调整Prompt的伦理规则。

具体步骤:

- 收集反馈:在产品中加“伦理反馈入口”(比如“你觉得AI的回答符合伦理吗?”的打分按钮);

- 分析反馈:用NLP工具分析用户反馈中的伦理问题(比如“AI推荐的内容有性别偏见”“AI泄露了我的隐私”);

- 迭代Prompt:根据反馈调整Prompt的规则(比如加“禁止生成深度伪造内容”的规则);

- 定期审计:每季度用伦理评估框架(如IEEE Ethically Aligned Design)做一次全面检查。

流程示例:伦理反馈循环的闭环

工具推荐:

- 反馈收集:用Typeform做简单的反馈表单,或集成到产品的“设置”页面;

- 反馈分析:用Hugging Face的

transformers库做情感分析和主题分类; - 伦理审计:用IEEE的《Ethically Aligned Design》 checklist,逐条检查Prompt的合规性。

为什么这么做?

- 应对不确定性:未来的伦理问题无法“一次性解决”,只能通过“反馈-迭代”持续优化;

- 保持竞争力:用户会更愿意使用“伦理合规”的产品——根据Gartner的报告,2025年“伦理AI”将成为企业差异化竞争的关键;

- 避免合规风险:新法规出台时,能快速调整Prompt规则,不用“推倒重来”。

第三章:进阶探讨——未来提示架构的伦理挑战(你可能没考虑到的)

以上4个策略能解决80%的常见问题,但未来还有更复杂的伦理挑战,需要你提前布局:

1. 多模态提示架构的伦理风险:文本+图像/视频的“双重陷阱”

未来的提示架构会支持“多模态”——比如用户输入“生成一张‘女性程序员’的图片”,AI要同时处理文本和图像。

风险:图像比文本更直观,偏见更容易引发争议(比如生成的“女性程序员”还是“穿粉色衣服、端着咖啡”的刻板印象)。

应对:给多模态Prompt加“视觉反偏见规则”——比如“生成的女性程序员要穿正常的工作服,不要有性别刻板印象的元素”,并用图像识别工具(如Clarifai)二次校验。

2. 跨语言提示架构的伦理适配:不同文化的“伦理差异”

如果你的产品面向全球用户,提示架构需要适配不同文化的伦理规则——比如在某些国家,“谈论宗教”是敏感话题,但在另一些国家是正常的。

应对:用“地域化Prompt模板”——根据用户的IP或语言,加载不同的伦理规则(比如给中东用户的Prompt加“禁止谈论宗教”,给美国用户的Prompt加“禁止种族歧视”)。

3. 提示架构与外部系统的伦理协同:“链式风险”

未来的提示架构会调用更多外部系统(如支付接口、物流系统),如果外部系统有伦理问题,会“传导”到你的架构——比如支付接口泄露用户信息,你的Prompt架构也会被牵连。

应对:在调用外部系统前,做“伦理尽职调查”——检查外部系统的隐私政策、公平性报告,确保符合你的伦理标准。

第四章:总结——伦理不是阻碍,是提示架构的“护城河”

回顾本文的核心要点:

- 未来提示架构的3大特点:多轮对话、动态自适应、系统级集成;

- 对应的3大伦理风险:隐私泄露、偏见强化、黑盒信任危机;

- 4个应对策略:动态隐私保护、Bias-aware设计、透明化交互、动态校准。

通过这些策略,你能:

- 避免因为伦理问题导致项目翻车(比如隐私泄露被罚款、偏见引发公关危机);

- 建立用户对产品的信任(“这个AI是‘有底线’的”);

- 满足未来的合规要求(比如欧盟AI Act、中国《生成式AI服务管理暂行办法》)。

最后想对你说:伦理不是“额外的负担”,而是提示架构的“护城河”。未来的优秀提示工程架构师,一定是“技术+伦理”双精通的——技术帮你“把事情做对”,伦理帮你“做对的事情”。

行动号召:一起打造“有温度的”提示架构

- 动手实践:把本文的4个策略用到你的项目中——比如给你的多轮对话Prompt加隐私过滤,给推荐系统加反偏见校准;

- 分享反馈:如果你遇到了新的伦理问题,或有更好的应对方法,欢迎在评论区留言讨论;

- 加入社群:关注我的公众号“AI伦理与提示工程”,每周分享最新的伦理案例和应对策略。

让我们一起,用技术和伦理,打造“有温度、可信任”的AI产品!

更多推荐

已为社区贡献230条内容

已为社区贡献230条内容

所有评论(0)