Harness Engineering:面向Agent-First世界的软件工程范式重构

OpenAI通过为期5个月的"零手动编码"实验,验证了智能体优先(Agent-First)软件工程范式的可行性。实验团队使用Codex智能体生成了100万行代码,实现10倍效率提升,工程师角色转变为环境设计者和意图规范者。关键创新包括:为智能体优化的多层次可观测性架构、渐进式披露的知识管理系统、多智能体评审的质量控制机制,以及自动化垃圾回收的代码维护。该范式特别适合大型新项目,

Harness Engineering:面向Agent-First世界的软件工程范式重构

1. 范式转移:从"人类编码"到"人类引导、智能体执行"

OpenAI于2025年8月至2026年1月进行了一项为期五个月的内部工程实验,其核心假设极具挑战性:在构建一个百万行代码级别的复杂系统时,强制要求"零手动编码"(Zero Hand-Written Code) 。这一实验并非简单的自动化辅助编程,而是对软件工程本质的重新定义。

实验结果验证了范式转移的可行性:由最初3名工程师(后扩展至7人)组成的团队,通过Codex智能体生成了约100万行代码,合并了1,500个Pull Request,实现了相比传统开发模式约10倍的效率提升 。关键洞察在于:当工程师被禁止直接编写代码时,他们被迫将注意力从语法实现转向更高维度的系统设计——构建能够让智能体有效工作的脚手架(Scaffolding)和反馈循环(Feedback Loops)。

这种范式下,工程师的角色发生根本性转变:

- 传统模式:工程师作为实现者(Implementer),直接操作代码细节

- Harness模式:工程师作为环境设计师(Environment Designer)和意图规范者(Intent Specifier),通过声明式提示(Declarative Prompts)定义目标,由智能体负责执行、验证和迭代

正如OpenAI技术团队成员Ryan Lopopolo所述:“我们团队的主要工作变成了让智能体能够完成有用的工作” 。

2. 架构设计:为智能体可观测性而优化的系统

在Agent-First开发模式中,代码生成吞吐量的指数级增长暴露了新的瓶颈:人类QA能力无法匹配智能体的代码产出速度。为解决这一问题,OpenAI团队提出了**应用可读性(Application Legibility)**概念——即系统必须能够被智能体感知、理解和调试 。

2.1 多层次可观测性架构

团队构建了一套完整的智能体"感官系统":

UI层感知:通过将Chrome DevTools Protocol(CDP)接入智能体运行环境,使Codex能够获取DOM快照、执行屏幕截图、模拟用户导航并观察运行时事件。这使得智能体可以自主重现Bug、验证UI修复效果,并根据视觉反馈调整实现方案 。

后端遥测集成:针对每个任务启动隔离的本地可观测性栈(包括Vector、Victoria Logs/Metrics等组件),智能体可使用LogQL和PromQL查询日志与指标。工程师可以下达诸如"确保服务启动时间在800ms内"或"关键路径延迟不超过2秒"的指令,智能体通过分析真实性能数据进行优化 。

这种闭环反馈机制使智能体能够执行长达6小时的连续任务,实现真正的异步自主工作模式。

2.2 技术栈选择的"无聊优先"原则

实验揭示了反直觉的技术选型策略:团队更倾向于选择"枯燥"(Boring)但API稳定、可组合性强、且在训练数据中表现良好的技术。在某些场景下,甚至允许智能体重新实现特定库功能,以确保行为对智能体完全透明和可控 。

这一策略的核心逻辑是:智能体的效率取决于其对工具链的熟悉程度,而非工具链对人类开发者的友好程度。这预示着未来技术栈的收敛趋势——“AI友好性”(AI-Friendliness)将成为架构选型的核心指标 。

3. 知识管理:上下文工程与渐进式披露

大型代码库中的上下文管理是智能体面临的核心挑战。OpenAI团队摒弃了传统的"操作手册"模式,转而采用**地图导向(Map-Oriented)**的知识架构 。

3.1 结构化文档体系

团队建立了层次化的知识管理系统:

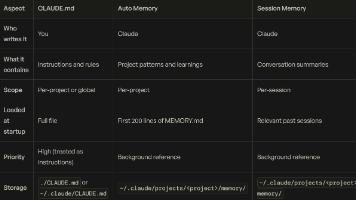

AGENTS.md:作为约100行的入口索引(Table of Contents),引导智能体按需深入,而非一次性加载全部上下文docs/目录:包含设计文档(Design Docs)、执行计划(Execution Plans)、技术债务追踪(Tech Debt Tracking)和质量评分(Quality Scores)- 机械一致性保障:通过Linter和CI验证强制确保跨链接文档的机械一致性,减少人工监督需求

这种**渐进式披露(Progressive Disclosure)**策略有效解决了上下文窗口限制问题,同时避免了单一庞大文档的快速过时风险。

3.2 架构约束的强制执行

为防止百万行代码演变为"大泥球"(Big Ball of Mud),团队实施了严格的架构边界控制:

分层领域架构:

Types → Config → Repo → Service → Runtime → UI

依赖必须沿此有向图单向流动。通过Codex生成的自定义Linter和结构测试(Structural Tests)强制执行这些规则,任何架构违规都会在CI阶段被拦截,并向智能体返回带有修复建议的错误信息 。

这种"中心化强制边界,本地化赋予自由"的策略,确保了即使代码风格不完全符合人类审美,其架构逻辑依然清晰且可维护。

4. 质量控制:自我修正与"垃圾回收"机制

高吞吐量代码生成带来了新的质量挑战:**AI废料(AI Slop)**的积累——即智能体在代码库中复制的不良或次优模式 。

4.1 多智能体评审循环(Ralph Wiggum Loop)

团队实现了"智能体对智能体"的评审机制:

- 智能体在本地运行代码并进行自我评审

- 请求云端其他智能体进行独立评审

- 根据反馈(包括Linter错误、测试失败或评审意见)迭代修改

- 直到所有自动化检查和智能体评审员都满意后才提交PR

这种机制模拟了传统代码评审流程,但通过智能体的7×24小时可用性实现了近乎即时的反馈循环 。

4.2 自动化"垃圾回收"

团队定义了黄金原则(Golden Principles),并实施定期的**重构智能体(Refactoring Agents)**扫描代码库中的偏离项,自动发起修复PR。这种对抗熵增(Entropy)的机制,模拟了垃圾回收器在内存管理中的作用,确保代码库长期健康 。

5. 工程哲学:Harness作为元层基础设施

Martin Fowler在分析中指出,"Harness"一词在OpenAI原文中仅出现一次,可能是受Mitchell Hashimoto相关文章启发后的补充 。然而,这一术语精准地描述了约束与赋能并存的工程哲学:

Harness Engineering的核心组件可分为三类 :

- 上下文工程(Context Engineering):持续增强的知识库,加上动态上下文(遥测数据、浏览器导航状态)的实时接入

- 架构约束(Architectural Constraints):不仅通过LLM-based智能体监控,还通过确定性自定义Linter和结构测试强制执行

- 垃圾回收(Garbage Collection):定期运行的智能体,发现文档不一致或架构约束违规,对抗系统熵增

这种元层(Meta-Level)基础设施的投资回报显著:实验初期进度缓慢,正是因为缺乏必要的抽象和工具;随着Harness的完善,智能体效率呈现非线性增长 。

6. 行业启示与局限性分析

6.1 范式适用性边界

Harness Engineering的有效性依赖于特定前提条件:

- 绿色字段优势:实验针对从零构建的系统。对于遗留代码库(Legacy Codebases), retrofitting Harness的成本可能过高,特别是当现有代码充满技术债务且缺乏标准化时

- 规模阈值:该模式在百万行代码级别展现优势,对于小型项目,Harness本身的开销可能超过收益

- 领域限制:当前实验主要集中在应用层开发,对于需要严格形式化验证的系统(如硬核系统软件、安全关键系统),其适用性仍需验证

6.2 工程师能力模型的转变

未来工程师的核心竞争力将向以下维度迁移:

- Prompt Engineering:精确表达意图和约束条件的能力

- 架构设计:定义清晰模块边界和接口契约的能力

- 反馈系统设计:构建有效测试策略和可观测性体系的能力

- 智能体行为调试:诊断智能体失败模式并改进Harness的能力

7. 结论:迈向Agent-Native软件工程

OpenAI的Harness Engineering实验标志着软件工程进入Agent-Native时代。这不仅是工具的升级,而是生产关系的重构——人类从直接生产代码转向生产"生产代码的环境"。

这一范式的深层意义在于:当代码生成成本趋近于零时,软件工程的价值锚点从"编写正确的代码"转向"定义正确的意图"和"验证正确的行为"。Harness作为连接人类意图与智能体执行的桥梁,将成为下一代软件工程的核心基础设施。

对于技术领导者而言, immediate actionable insights包括:

- 试点项目选择:从内部开发者工具等非关键系统开始验证

- 团队能力建设:培养工程师的"为智能体设计"思维

- 防护栏定义:在规模化之前建立架构约束、安全策略和成本控制机制

Harness Engineering不是遥远的未来实验,而是正在发生的工程现实。适应这一转变的团队将在交付速度上获得数量级优势,而犹豫者将面临日益扩大的竞争鸿沟。

参考来源:

- OpenAI官方博客《Harness engineering: leveraging Codex in an agent-first world》(2026-02)

- Martin Fowler技术分析文章(2026-02-17)

- InfoQ技术报道(2026-02-21)

- 中文技术社区深度解读(2026-02-26)

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)