MindSpore:Segment Anything Model (SAM) 的最佳推理实践

SAM 支持多种提示方式,本例使用Bounding Box (边界框)提示。# 定义BBox [x1, y1, x2, y2]通过本次复现,我们验证了 MindSpore + MindNLP 在大模型推理上的成熟度。开箱即用:无需手动下载权重,自动缓存管理。性能优异:基于 MindSpore 的图算融合能力,推理延迟极低。交互式分割:结合 Gradio 开发一个点击分割的 Web App。批量推理

1. SAM:通用分割的里程碑

Segment Anything Model (SAM) 是 Meta AI 发布的图像分割基础模型。它引入了“可提示(Promptable)”的分割范式,颠覆了传统分割模型闭集分类的限制。通过输入点、框或文本,SAM 能够在零样本(Zero-Shot)条件下对任意物体进行高质量分割。

对于开发者而言,掌握 SAM 的推理部署是进入 Foundation Model(基础模型) 应用开发的必修课。本次实践基于 MindSpore 官方生态库 MindNLP,在 Ascend/GPU 环境下均可流畅运行。

2. 复现准备:环境与数据

2.1 环境配置

本案例依赖 MindSpore 框架及 MindNLP 套件。

- MindSpore: 2.7.0

- MindNLP: 0.5.1

!pip install mindspore==2.7.0

!pip install mindnlp==0.5.1

体验记录:

MindNLP 是 MindSpore 官方维护的 NLP 与多模态模型库,它对标 Hugging Face Transformers,提供了极佳的 API 兼容性。安装过程顺滑,无需复杂的编译步骤。

2.2 数据准备

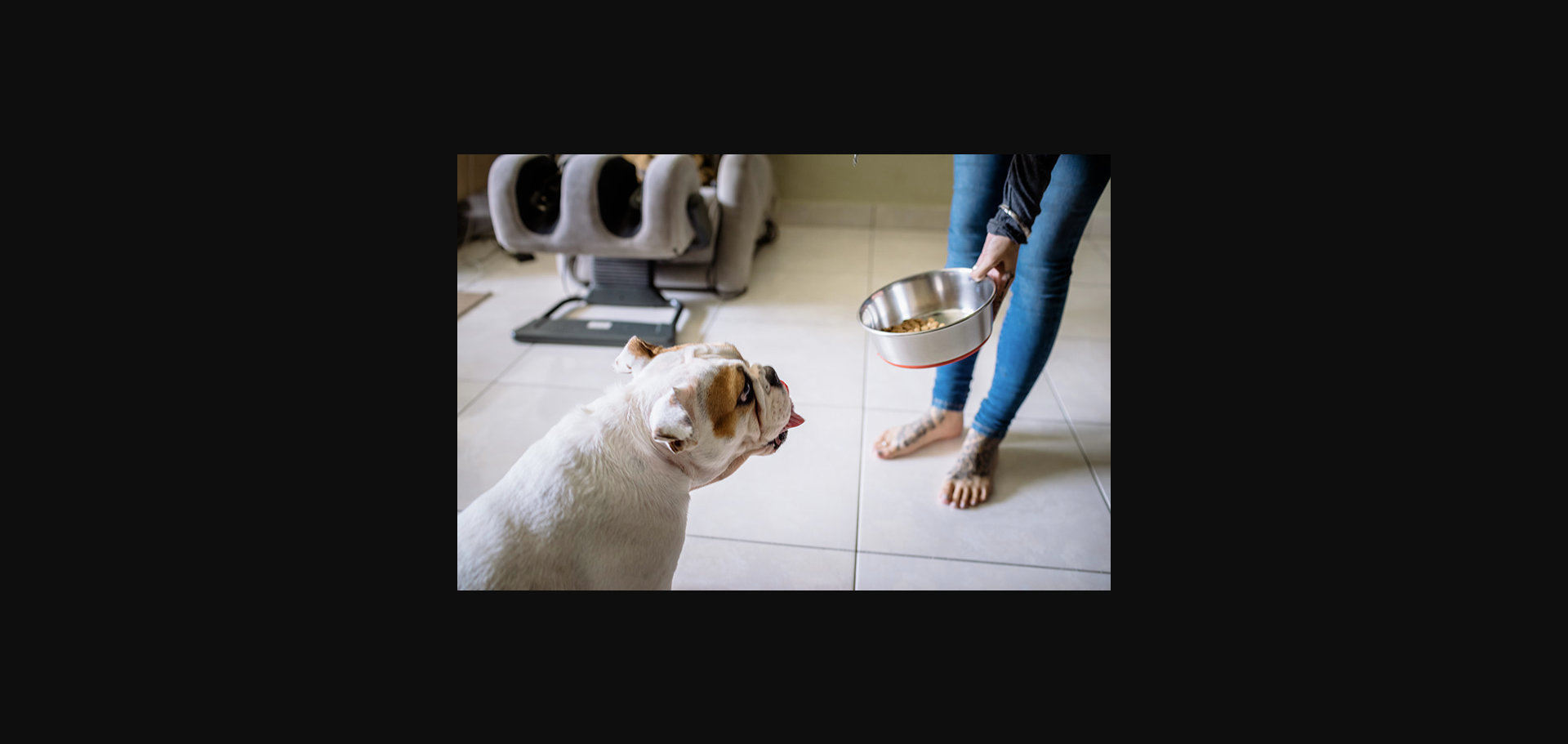

我们使用 Meta 官方演示的经典 dog.jpg 图片。

import requests

from pathlib import Path

def download_image(url: str, save_dir: str = ".") -> str:

# ... (下载逻辑)

return str(dst)

image_url = "https://raw.githubusercontent.com/facebookresearch/segment-anything/main/notebooks/images/dog.jpg"

downloaded_image = download_image(image_url)

3. 核心源码解析

在进行推理前,我们需要理解 SAM 在 MindNLP 中的架构实现。

3.1 预处理器:SamProcessor

SAM 对输入图像有严格的尺寸和归一化要求。SamProcessor 封装了这些复杂的预处理逻辑。

from mindnlp.transformers import SamProcessor

processor = SamProcessor.from_pretrained("facebook/sam-vit-base")

解析:SamProcessor 负责两件事:

- 图像变换:将任意尺寸的输入图像缩放并 Padding 到

1024x1024(SAM 的标准输入尺寸),同时进行归一化。 - 提示编码:将用户输入的 BBox 或 Point 坐标映射到 resize 后的坐标系中,生成模型所需的 tensor。

3.2 模型架构:SamModel

SAM 的核心架构包含三个组件:

- Image Encoder:基于 ViT (Vision Transformer) 的骨干网络,负责提取图像特征。这是计算量最大的部分。

- Prompt Encoder:轻量级编码器,将点/框提示编码为 Embedding。

- Mask Decoder:轻量级解码器,融合图像特征和提示特征,生成最终的掩码。

from mindnlp.transformers import SamModel

model = SamModel.from_pretrained("facebook/sam-vit-base")

model.set_train(False) # 设置为推理模式

解析:

MindNLP 的 SamModel 完美复现了这一架构。值得注意的是,Image Encoder 只需运行一次,生成的特征可以被缓存。后续如果改变 Prompt(例如点击图像的不同位置),只需重新运行轻量级的 Mask Decoder,这使得 SAM 非常适合交互式应用。

4. 推理过程实录

4.1 定义提示 (Prompt)

SAM 支持多种提示方式,本例使用 Bounding Box (边界框) 提示。

# 定义BBox [x1, y1, x2, y2]

bbox = [0, 217, 450, 800]

4.2 端到端推理

推理过程简洁高效:

# 1. 预处理

inputs = processor(images=image, input_boxes=[[bbox]], return_tensors="pt")

# 2. 模型前向计算

outputs = model(**inputs)

复现观察:

- API 设计:

processor->model的调用范式与 Hugging Face 完全一致,极大降低了学习成本。 - 输出内容:

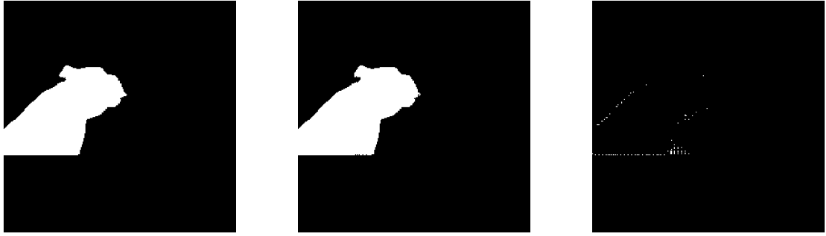

outputs包含pred_masks(预测掩码) 和iou_scores(IoU 预测值)。SAM 默认会输出 3 个不同层级的掩码(如整体、部分、子部分),以解决分割歧义性问题。

4.3 后处理与可视化

模型输出的掩码是 256x256 的低分辨率特征图,需要还原回原图尺寸。

# 后处理:将掩码插值回原图尺寸

upsampled_list = processor.post_process_masks(

outputs.pred_masks,

inputs["original_sizes"],

inputs["reshaped_input_sizes"]

)

解析:post_process_masks 是这一步的关键,它自动处理了 Padding 去除和双线性插值,确保生成的 Mask 与原图像素对齐。

5. 推理与结果展示

通过选取 IoU 分数最高的掩码进行可视化:

best_idx = int(np.argmax(scores_np))

best_mask = (m[best_idx].asnumpy() > 0)

视觉效果:

生成的 Mask 边缘清晰,紧贴物体轮廓。即使是毛发等细微结构,SAM 也能处理得相当出色。IoU 分数通常能达到 0.95 以上,显示了极高的置信度。

6. 结语与展望

通过本次复现,我们验证了 MindSpore + MindNLP 在大模型推理上的成熟度。

- 开箱即用:无需手动下载权重,自动缓存管理。

- 性能优异:基于 MindSpore 的图算融合能力,推理延迟极低。

如果你想进一步探索,可以尝试:

- 交互式分割:结合 Gradio 开发一个点击分割的 Web App。

- 批量推理:利用 MindSpore 的

vmap特性加速批量图片处理。 - 微调 (Fine-tuning):在特定医疗或工业数据集上微调 SAM 的 Decoder 部分,提升特定领域的分割效果。

参考资料:

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)