GPU、NPU、TPU…给你的AI项目配上对的“引擎”

本文解析了AI计算中不同芯片的特性与应用场景。CPU作为通用处理器在AI并行计算中效率低下;GPU凭借高并行性成为AI训练的主流选择;TPU/NPU作为专用芯片在特定任务上能效比更优。文章建议:模型训练首选GPU,固定模型推理可考虑TPU,终端设备适合NPU。通过云边协同架构,合理搭配不同芯片可优化整体计算效率。

在上一篇《AI的胃口有多大?一篇文章带你看懂“算力”这笔硬开支》中,我们聊了AI对算力近乎“贪婪”的需求。但算力不会凭空产生,它需要实实在在的物理载体——芯片。当你在云平台租用AI算力,或准备采购服务器时,面对琳琅满目的“GPU实例”、“NPU加速”选项,是否感到困惑:它们到底有何不同?我的AI项目,又该选择哪一颗“引擎”?

今天,我们就来解解惑。理解不同AI芯片的核心差异,是优化成本、提升效率的关键一步。这就像为一场比赛选车:城市通勤、越野拉力、F1赛道,需要的引擎截然不同。

Part 01 CPU:全能管家,为何在AI面前“力不从心”?

在我们谈论AI专用芯片前,必须先提及其“全能前辈”——CPU(中央处理器)。CPU是计算机的大脑,设计目标是通用性。它擅长处理复杂的、逻辑严密的串行任务(比如运行操作系统、办公软件),就像一个思维敏捷、多才多艺的“管家”,能处理家里各种杂事,但一次只能专注于一两件。

AI计算,尤其是深度学习,核心是“大规模并行计算”。它需要同时对海量数据(如图像的百万像素、文本的成千上万个词)执行完全相同的简单操作(比如矩阵乘加运算)。这就像需要同时指挥一支万人方阵,做出整齐划一的动作。

CPU的架构(核心数有限,控制单元和缓存复杂)在处理这种任务时效率很低。它像是一个“管家”在努力地一个人、一个人地去指挥方阵,绝大部分时间花在了“调度”和“沟通”上,真正用于“计算”的精力反而很少。于是,专为并行计算而生的“特种兵”芯片应运而生。

Part 02 GPU:从“图形处理器”到“AI算力之王”

GPU(图形处理器)是当前AI时代,特别是模型训练领域的绝对主角。它最初是为渲染游戏画面而设计的。图形渲染的本质,正是对数以百万计的像素并行进行颜色、光影的计算。因此,GPU被设计成了由数千个较小、较简单的核心组成的庞大阵列。

GPU的核心优势在于“高吞吐量”。它不像CPU那样追求单个任务的快速完成,而是追求在同一时钟周期内完成海量简单任务。回到方阵的比喻,GPU就像一个专门训练方阵的“教官团”,每个教官只负责一小队士兵,但数千名教官同时发令,能让整个万人方阵瞬间完成动作。

为什么GPU成为AI训练的基石?

- 完美契合矩阵/向量运算:深度学习算法90%以上的计算可归结为矩阵乘法,这正是GPU的“拿手好戏”。

- 成熟的生态:以NVIDIA CUDA为代表的软件生态经过十数年发展,已成为AI开发的事实标准。几乎所有主流AI框架(PyTorch, TensorFlow)都围绕GPU进行了深度优化。

- 通用可编程:现代GPU(尤其通过CUDA)已不仅是图形芯片,而是一个强大的通用并行计算平台,能适应各种仍在快速演进的AI算法。

但GPU也有其“短板”:它为通用并行计算而设计,内部电路并非专为神经网络运算定制,因此在执行特定AI操作时,仍存在一定的能效比(性能/功耗)提升空间。这就催生了更极致的“特长生”。

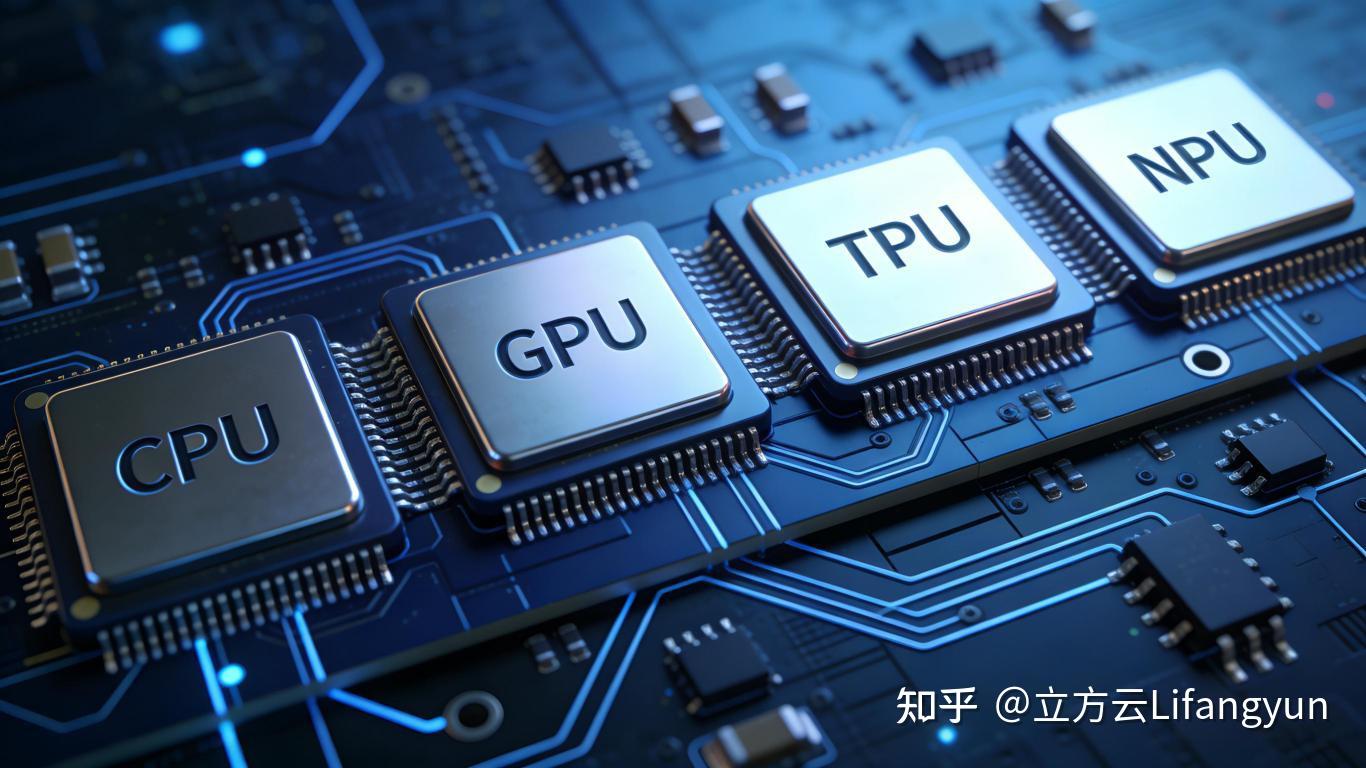

Part 03 TPU与NPU:为AI而生的“定制化特长生”

如果说GPU是从图形处理转型而来的“并行计算多面手”,那么TPU和NPU则是出生就为AI服务的“定制化特长生”。

| TPU | NPU | |

|---|---|---|

| 全称 | 张量处理器(Tensor Processing Unit) | 神经网络处理器(Neural Processing Unit) |

| 推出者 | 谷歌 | 移动设备、边缘计算芯片厂商(如华为海思、苹果、高通) |

| 设计目标 | 专为执行神经网络中的核心运算(如卷积、矩阵乘法) | 在低功耗约束下,高效执行AI推理任务 |

| 硬件设计 | 采用ASIC(专用集成电路)设计,硬件指令和计算单元极致优化 | 极度专注于低功耗设计(概念类似TPU) |

| 性能特点 | 执行特定任务时,能效比和绝对速度远超同代通用GPU | 追求每瓦特性能,而不是极致的峰值算力 |

| 应用场景 | 谷歌AI服务(如搜索、翻译) | 手机拍照、语音助手等移动和边缘计算场景 |

核心差异一目了然:

GPU:强大的“多面手”。生态系统无敌,灵活性最高,是AI研发、训练和复杂模型部署的“主力军”与“通用标准”。当你不知道选什么,或者需要应对多变的研究需求时,GPU通常是最安全、最高效的选择。

TPU/NPU:极致的“特长生”。在特定任务(尤其是其设计所针对的推理任务)上能效比惊人。TPU更适合云服务商大规模部署固定模型的场景;NPU则已无处不在,是让手机、摄像头变得智能的幕后功臣。

Part 04 为AI项目,选择合适的“引擎”

理解了芯片的禀赋差异,选择就会清晰很多:

场景一:AI模型训练与研发、复杂模型云端推理

- 核心需求:极高的峰值算力、巨大的内存带宽、应对算法迭代的灵活性、成熟的软件生态。

- 首选“引擎”:高性能GPU(如NVIDIA A/H系列),它为AI的“创新阶段”提供了最强大的通用计算平台。

场景二:大规模、固定模型的云端推理服务

- 核心需求:极高的吞吐量、极低的单次查询成本、优秀的能效比。

- 可考虑“引擎”:TPU或某些专用AI推理卡。适合已将模型固化,需要以最低成本服务海量请求的业务(如头部互联网公司的推荐系统、搜索引擎)。

场景三:边缘与终端AI推理

- 核心需求:低功耗、实时性、数据隐私、成本敏感。

- 首选“引擎”:NPU。集成在边缘设备、物联网关或手机SoC中,让智能在摄像头、工控机、车载设备上本地发生,无需回传云端。

总得来说,作为AI应用开发者,在架构设计之初,就应思考算力部署的层次。训练和复杂推理放在云端GPU集群;对时延、隐私要求极高的海量终端推理,则部署在带NPU的边缘节点。 这种“云边协同”的架构,正是通过匹配不同“引擎”的长处来实现整体效率最优。

欢迎关注立方云Lifangyun。

网鼎科技旗下“立方云”平台致力于为企业客户打造全球算力与网络解决方案。通过云主机、裸金属服务器、云连接及AI算力等核心服务,助力企业实现核心应用灵活部署、边缘业务高效运行与AI创新快速落地,全面满足多样化计算需求。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)