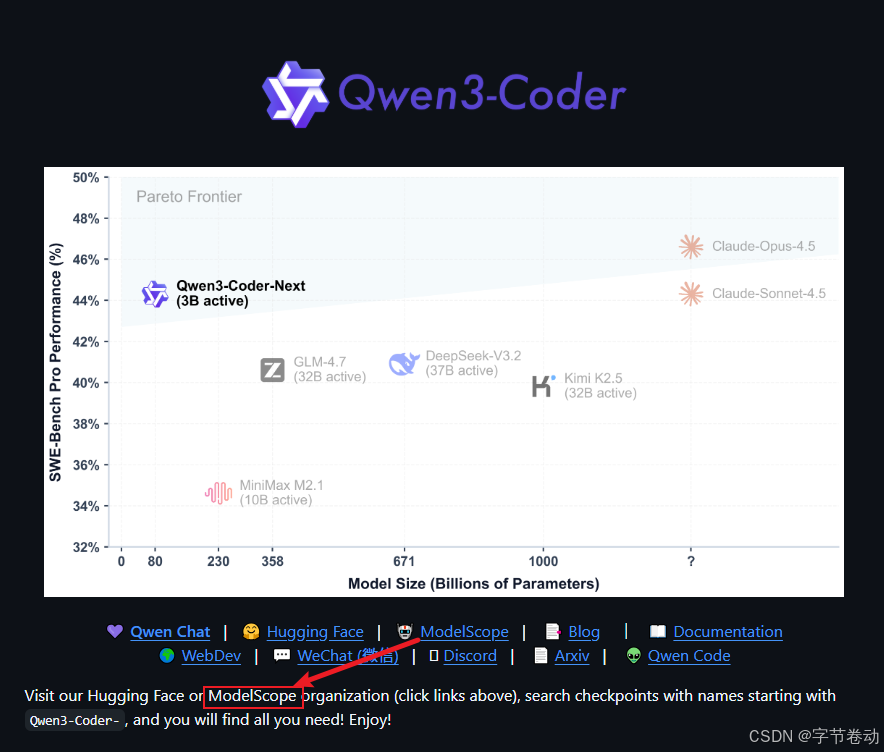

【Claude Code】Claude Code虽好,可钱包遭不住啊!白嫖党狂喜!手把手教你用Qwen3-Coder免费玩转Claude Code

摘要 Claude Code是一款强大的AI编程助手工具,但付费模式让用户望而却步。本文介绍了一种免费替代方案:通过Claude Code Router工具,将魔搭社区提供的免费Qwen3-Coder API(每天2000次调用)接入Claude Code系统。文章详细讲解了安装Claude Code和Claude Code Router的步骤,并提供了配置文件的示例说明,让用户能够在不付费的情况

Claude Code虽好,可钱包遭不住啊!

Claude Code 确实香——代码生成、重构、项目理解、自动补全、多文件分析,简直是在终端里养了个AI程序员。

但一看价格,我默默收回了伸向钱包的手。

不过别慌,免费午餐来了!今天教大家一套骚操作:

👉 Claude Code + Claude Code Router + 魔搭社区免费Qwen3-Coder API

完美实现“白嫖”Claude Code,每天2000次免费调用,真香警告!

一、Claude Code安装(已有可跳过)

Claude Code 是 Anthropic 官方推出的 AI 编程助手 CLI 工具,可以直接在终端中和你唠嗑写代码。

官方传送门::

怎么安装参考上面的文档安装即可,这里就不多说了!

安装命令(别怕,就一行),前提是先安装好Node.js 18+

npm install -g @anthropic-ai/claude-code

二、Claude Code Router :Claude Code 的“万能转接头”

Claude Code Router 是什么?

Claude Code Router 是一个开源神器,可以把任意大模型的 API “伪装”成 Claude Code 能懂的请求。

简单说,它就是个 翻译官+代理,让Claude Code能调用其他模型(比如免费的Qwen3-Coder)。

这样我们就可以把一些免费的API接入进来,达成不错的效果!

官方仓库地址: 👉 Claude Code Router的Github地址

Claude Code Router 的功能

- 模型路由: 根据您的需求将请求路由到不同的模型(例如,后台任务、思考、长上下文)。

- 多提供商支持: 支持 OpenRouter、DeepSeek、Ollama、Gemini、Volcengine 和 SiliconFlow 等各种模型提供商,当然还有我们今天的主角——魔搭社区 Modelscope。

- 请求/响应转换: 使用转换器为不同的提供商自定义请求和响应,自动适配不同提供商的接口格式,不用你操心。

- 动态模型切换: 在 Claude Code 中使用

/model命令动态切换模型。 - GitHub Actions 集成: 在您的 GitHub 工作流程中触发 Claude Code 任务。

- 插件系统: 使用自定义转换器扩展功能。

Claude Code Router 快速入门

1. 安装

首先,请确保您已安装 Claude Code:

npm install -g @anthropic-ai/claude-code

然后,安装 Claude Code Router:

npm install -g @musistudio/claude-code-router

装完就有 ccr 命令啦。

2. 配置

安装完成以后,创建并配置您的 ~/.claude-code-router/config.json 文件。

config.json 文件有几个关键部分:

PROXY_URL(可选): 您可以为 API 请求设置代理,例如:"PROXY_URL": "http://127.0.0.1:7890"。LOG(可选): 您可以通过将其设置为true来启用日志记录。当设置为false时,将不会创建日志文件。默认值为true。LOG_LEVEL(可选): 设置日志级别。可用选项包括:"fatal"、"error"、"warn"、"info"、"debug"、"trace"。默认值为"debug"。- 日志系统: Claude Code Router 使用两个独立的日志系统:

- 服务器级别日志: HTTP 请求、API 调用和服务器事件使用 pino 记录在

~/.claude-code-router/logs/目录中,文件名类似于ccr-*.log - 应用程序级别日志: 路由决策和业务逻辑事件记录在

~/.claude-code-router/claude-code-router.log文件中

- 服务器级别日志: HTTP 请求、API 调用和服务器事件使用 pino 记录在

APIKEY(可选): 您可以设置一个密钥来进行身份验证。设置后,客户端请求必须在Authorization请求头 (例如,Bearer your-secret-key) 或x-api-key请求头中提供此密钥。例如:"APIKEY": "your-secret-key"。HOST(可选): 您可以设置服务的主机地址。如果未设置APIKEY,出于安全考虑,主机地址将强制设置为127.0.0.1,以防止未经授权的访问。例如:"HOST": "0.0.0.0"。NON_INTERACTIVE_MODE(可选): 当设置为true时,启用与非交互式环境(如 GitHub Actions、Docker 容器或其他 CI/CD 系统)的兼容性。这会设置适当的环境变量(CI=true、FORCE_COLOR=0等)并配置 stdin 处理,以防止进程在自动化环境中挂起。例如:"NON_INTERACTIVE_MODE": true。Providers: 用于配置不同的模型提供商。Router: 用于设置路由规则。default指定默认模型,如果未配置其他路由,则该模型将用于所有请求。API_TIMEOUT_MS: API 请求超时时间,单位为毫秒。

有关更多详细信息,您可以参考 config.example.json。

这是一个综合示例:

{

"APIKEY": "your-secret-key",

"PROXY_URL": "http://127.0.0.1:7890",

"LOG": true,

"API_TIMEOUT_MS": 600000,

"NON_INTERACTIVE_MODE": false,

"Providers": [

{

"name": "openrouter",

"api_base_url": "https://openrouter.ai/api/v1/chat/completions",

"api_key": "sk-xxx",

"models": [

"google/gemini-2.5-pro-preview",

"anthropic/claude-sonnet-4",

"anthropic/claude-3.5-sonnet",

"anthropic/claude-3.7-sonnet:thinking"

],

"transformer": {

"use": ["openrouter"]

}

},

{

"name": "deepseek",

"api_base_url": "https://api.deepseek.com/chat/completions",

"api_key": "sk-xxx",

"models": ["deepseek-chat", "deepseek-reasoner"],

"transformer": {

"use": ["deepseek"],

"deepseek-chat": {

"use": ["tooluse"]

}

}

},

{

"name": "ollama",

"api_base_url": "http://localhost:11434/v1/chat/completions",

"api_key": "ollama",

"models": ["qwen2.5-coder:latest"]

},

{

"name": "gemini",

"api_base_url": "https://generativelanguage.googleapis.com/v1beta/models/",

"api_key": "sk-xxx",

"models": ["gemini-2.5-flash", "gemini-2.5-pro"],

"transformer": {

"use": ["gemini"]

}

},

{

"name": "volcengine",

"api_base_url": "https://ark.cn-beijing.volces.com/api/v3/chat/completions",

"api_key": "sk-xxx",

"models": ["deepseek-v3-250324", "deepseek-r1-250528"],

"transformer": {

"use": ["deepseek"]

}

},

{

"name": "modelscope",

"api_base_url": "https://api-inference.modelscope.cn/v1/chat/completions",

"api_key": "",

"models": ["Qwen/Qwen3-Coder-480B-A35B-Instruct", "Qwen/Qwen3-235B-A22B-Thinking-2507"],

"transformer": {

"use": [

[

"maxtoken",

{

"max_tokens": 65536

}

],

"enhancetool"

],

"Qwen/Qwen3-235B-A22B-Thinking-2507": {

"use": ["reasoning"]

}

}

},

{

"name": "dashscope",

"api_base_url": "https://dashscope.aliyuncs.com/compatible-mode/v1/chat/completions",

"api_key": "",

"models": ["qwen3-coder-plus"],

"transformer": {

"use": [

[

"maxtoken",

{

"max_tokens": 65536

}

],

"enhancetool"

]

}

},

{

"name": "aihubmix",

"api_base_url": "https://aihubmix.com/v1/chat/completions",

"api_key": "sk-",

"models": [

"Z/glm-4.5",

"claude-opus-4-20250514",

"gemini-2.5-pro"

]

}

],

"Router": {

"default": "deepseek,deepseek-chat",

"background": "ollama,qwen2.5-coder:latest",

"think": "deepseek,deepseek-reasoner",

"longContext": "openrouter,google/gemini-2.5-pro-preview",

"longContextThreshold": 60000,

"webSearch": "gemini,gemini-2.5-flash"

}

}

3. 使用 Router 运行 Claude Code

使用 router 启动 Claude Code:

ccr code

注意: 修改配置文件后,需要重启服务使配置生效:

ccr restart

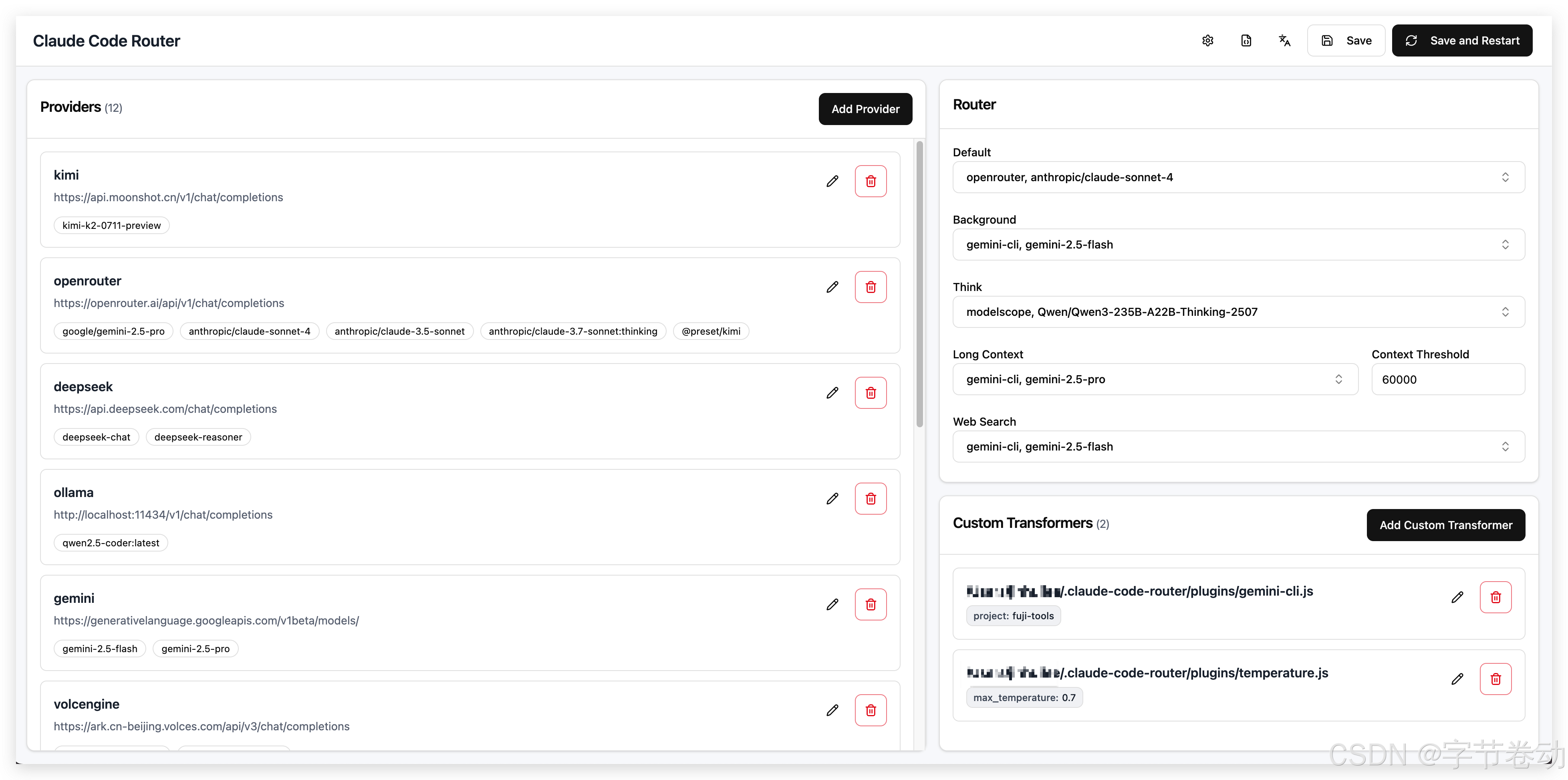

4. UI 模式

为了获得更直观的体验,您可以使用 UI 模式来管理您的配置:

ccr ui

这将打开一个基于 Web 的界面,您可以在其中轻松查看和编辑您的 config.json 文件。

5. CLI 模型管理

对于偏好终端工作流的用户,可以使用交互式 CLI 模型选择器:

ccr model

该命令提供交互式界面来:

- 查看当前配置

- 查看所有配置的模型(default、background、think、longContext、webSearch、image)

- 切换模型:快速更改每个路由器类型使用的模型

- 添加新模型:向现有提供商添加模型

- 创建新提供商:设置完整的提供商配置,包括:

- 提供商名称和 API 端点

- API 密钥

- 可用模型

- Transformer 配置,支持:

- 多个转换器(openrouter、deepseek、gemini 等)

- Transformer 选项(例如,带自定义限制的 maxtoken)

- 特定于提供商的路由(例如,OpenRouter 提供商偏好)

CLI 工具验证所有输入并提供有用的提示来引导您完成配置过程,使管理复杂的设置变得容易,无需手动编辑 JSON 文件。

三、实战

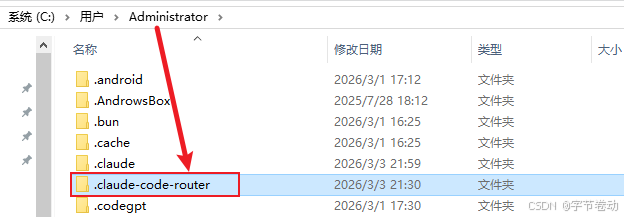

1. 创建文件夹 ~/.claude-code-router

比如我的windows电脑,用户名是Administrator,所以我的用户名目录是:C:\Users\Administrator

在该目录下,手动创建一个名为.claude-code-router的目录,如下所示

2. 创建 ~/.claude-code-router/config.json

在C:\Users\Administrator\.claude-code-router目录下,手动新建一个config.json文件

然后我们打开它,将刚刚上面的示例配置文件样板复制进来。

这里面有很多Provider提供商的地址,这里我们只需要填上自己想要的模型跟对应的提供商即可。

3. 免费午餐核心:配置Qwen3 Coder

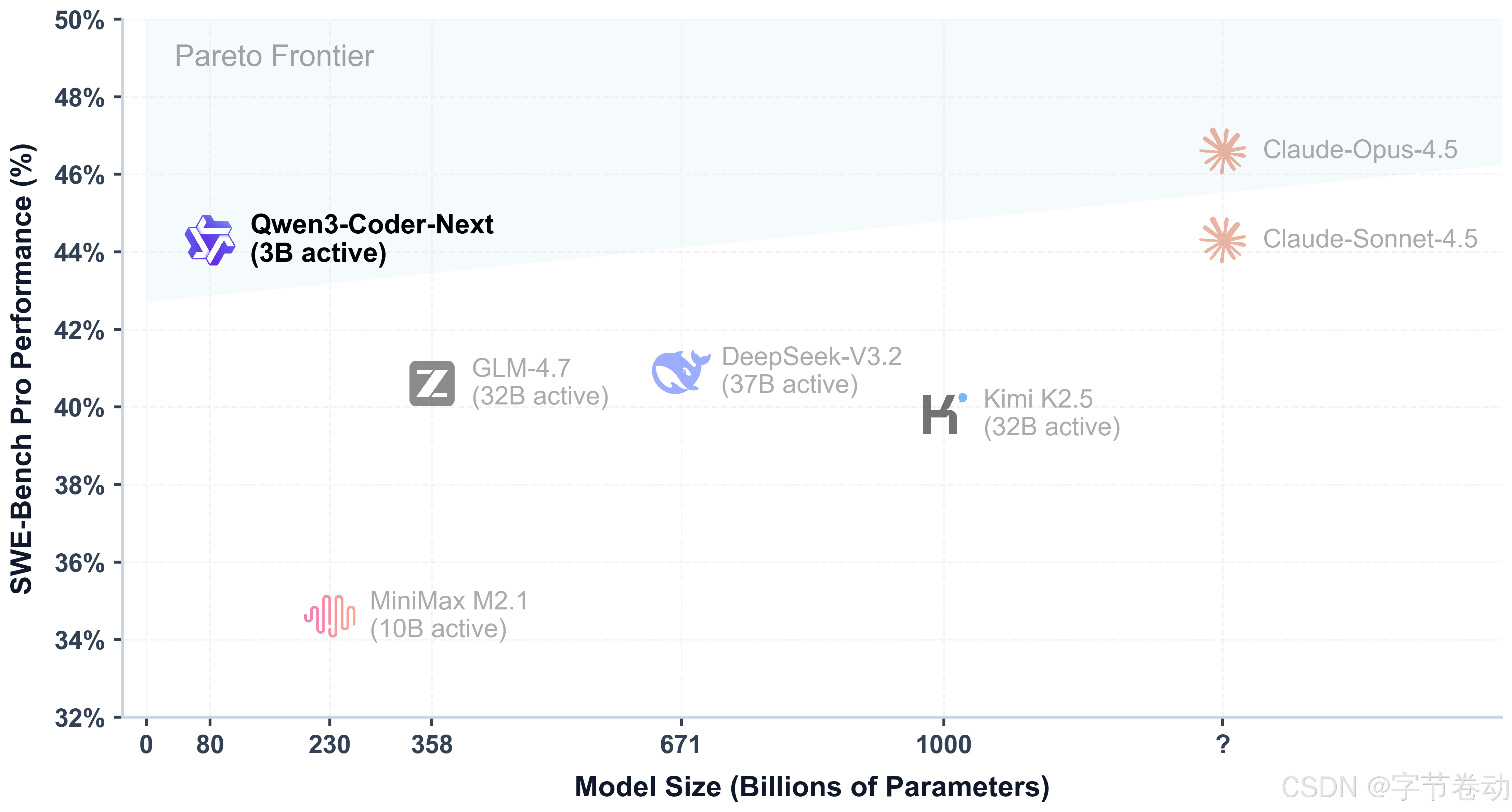

Qwen3 Coder是阿里最近开源的一个编程的AI大模型。

每位魔搭注册用户,当前每天允许进行总数(所有模型加和)为2000次的API-Inference调用。

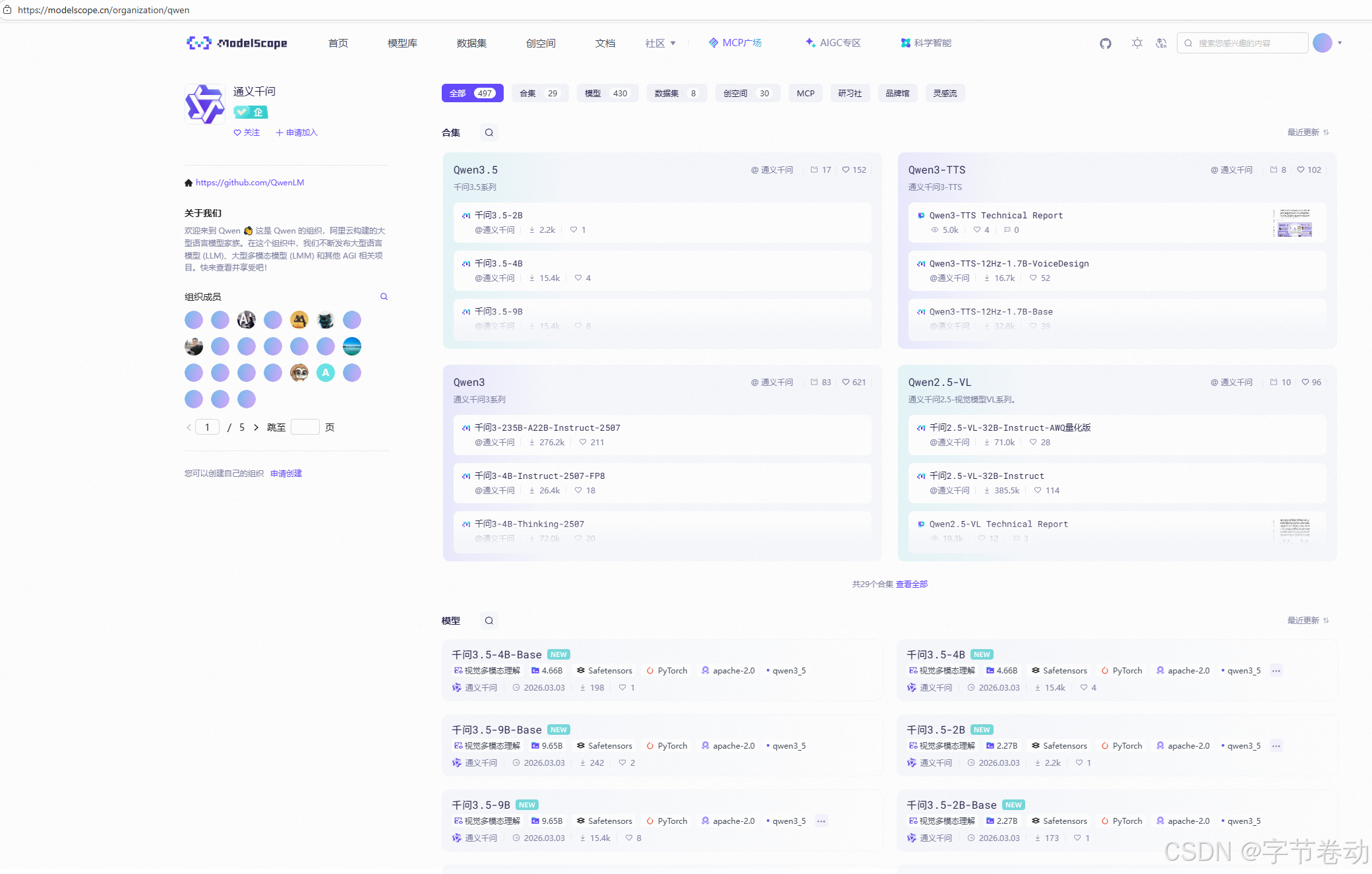

3.1 关于魔塔社区modelscope

官网地址:

- 👉 魔搭官网:https://modelscope.cn/

- 👉 魔塔API-Inference使用限制:https://modelscope.cn/docs/model-service/API-Inference/limits

- 👉 QWen在魔塔的主页:https://modelscope.cn/organization/qwen]

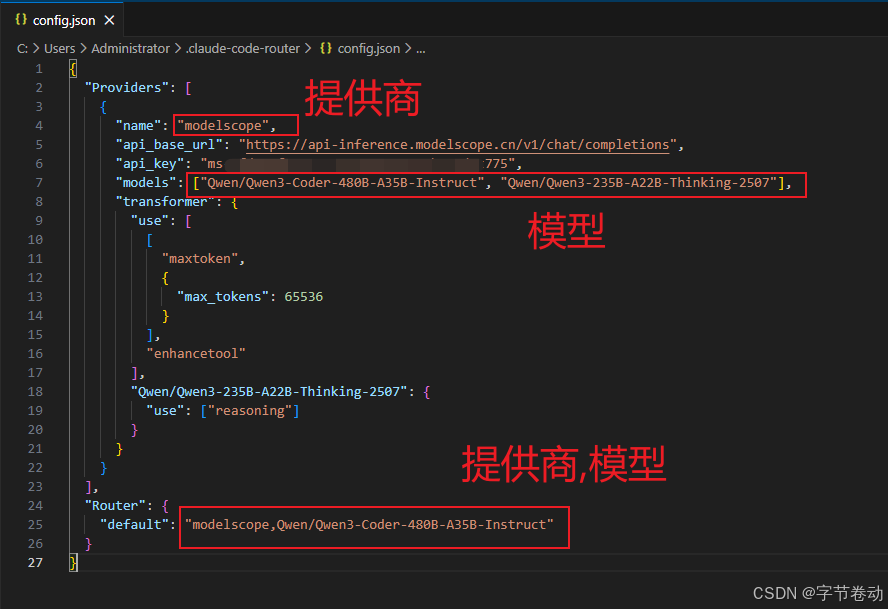

3.2 配置Qwen的config.json

修改上面的 ~/.claude-code-router/config.json 文件,将其他的都可以删掉,复制下面的进去,最后替换下api_key为你的即可。

{

"Providers": [

{

"name": "modelscope",

"api_base_url": "https://api-inference.modelscope.cn/v1/chat/completions",

"api_key": "你的魔塔社区api_key", // 这里换成你的!

"models": ["Qwen/Qwen3-Coder-480B-A35B-Instruct", "Qwen/Qwen3-235B-A22B-Thinking-2507"],

"transformer": {

"use": [

[

"maxtoken",

{

"max_tokens": 65536

}

],

"enhancetool"

],

"Qwen/Qwen3-235B-A22B-Thinking-2507": {

"use": ["reasoning"]

}

}

}

],

"Router": {

"default": "modelscope,Qwen/Qwen3-Coder-480B-A35B-Instruct"

}

}

配置说明:

-

name:提供商名字,随便取,但最好有意义。 -

api_base_url:魔搭社区的API地址,固定不变。 -

api_key:你的魔搭社区访问令牌,下面教你获取。 -

models:要用哪些模型,这里填了Qwen3-Coder的两个型号,第一个是主力编程模型,第二个带推理能力。 -

transformer:一些高级转换,不用管,抄作业就行。 -

Router.default:默认使用哪个模型,这里指定了魔搭社区的主力编程模型

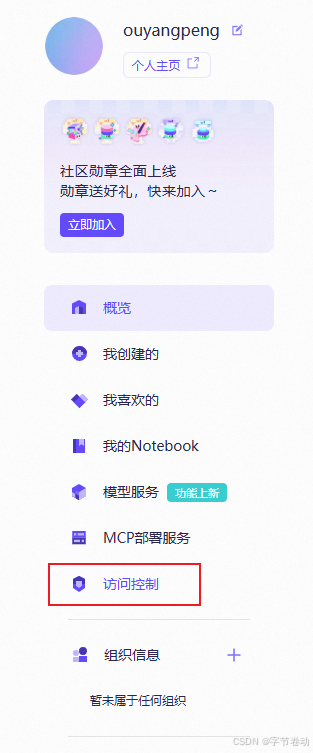

3.3 在魔塔社区获取免费的API Key

进入魔塔社区首页:https://modelscope.cn/my/overview,

-

没有账号的话可以先注册一个,

-

在右上角找到【账号设置】,点击【立即绑定阿里云账号】(已绑跳过)

我已经绑定好阿里云账号,绑定完成后的样子如下:

-

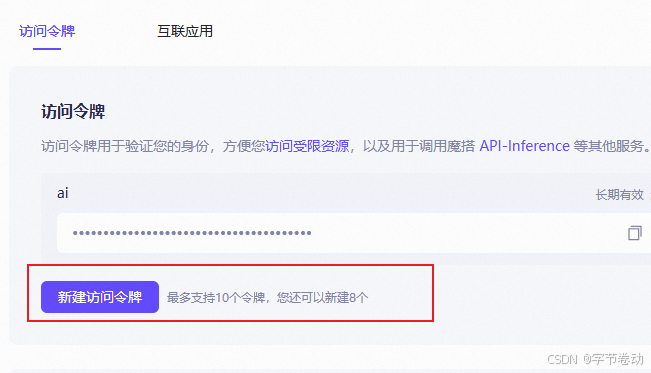

接着我们来到左侧,找到【访问控制】,点击【新建访问令牌】

-

随便取个名子即可,我之前取了一个名字为ai的令牌

-

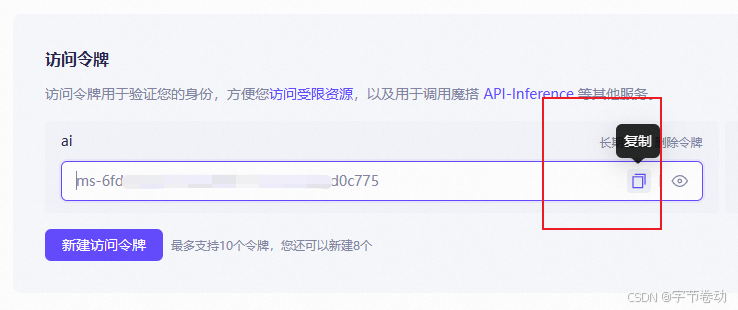

然后我们把这个api key复制下来即可(一串数字)

-

把复制的令牌贴到上面

config.json的api_key字段。

这样我们就全部配置完成了!

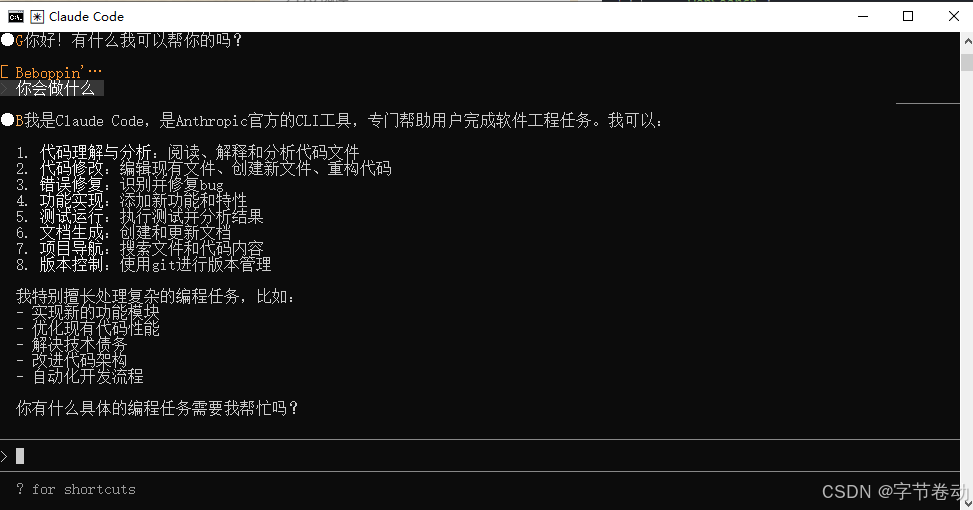

3.4 启动!启动!

保存一下,我们就可以开始使用Claude Code了!

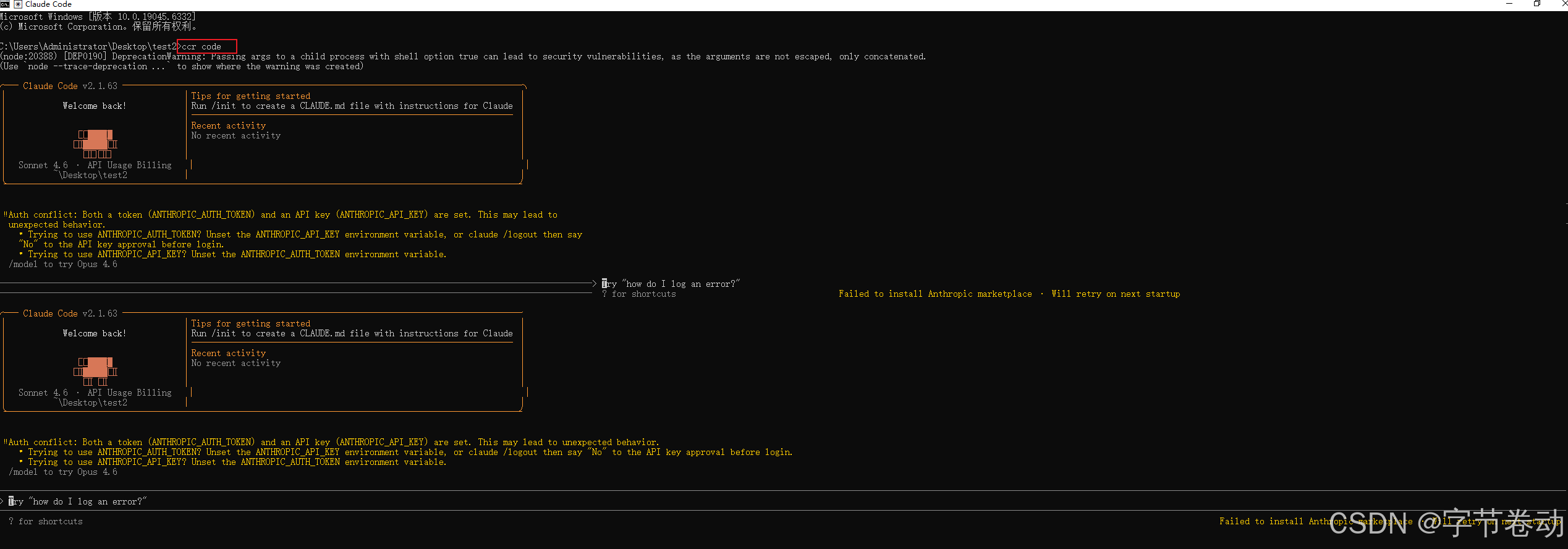

在cmd终端输入 ccr code 命令就可以直接使用Claude Code了!

第一次运行会问你接受条款,输入 Accept 回车。

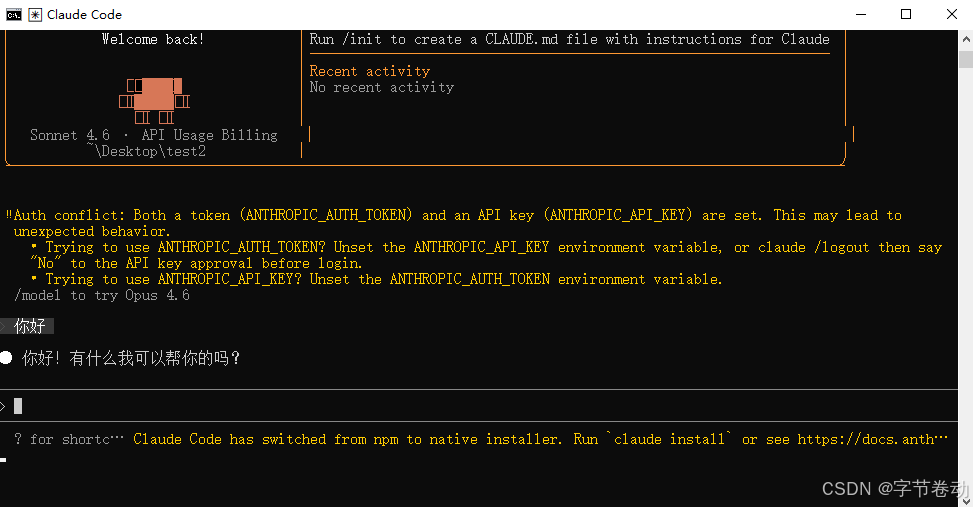

然后你就会看到熟悉的 Claude Code 界面,但它背后用的已经是免费的 Qwen3-Coder 啦!

试试跟它打个招呼

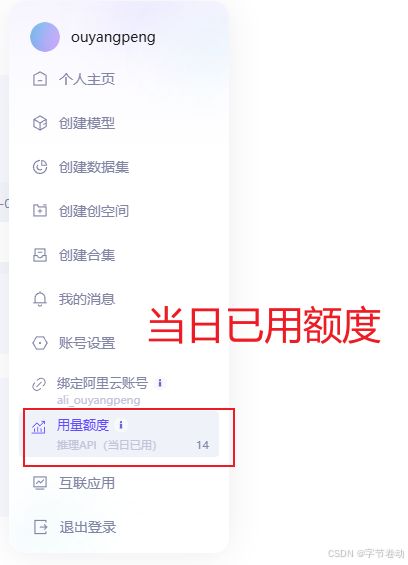

3.5 魔塔查看当日已用额度

在主页右上角的【用量额度】,就能看到今天用了多少次。

每天提供2000次免费调用额度还是挺香的!

4. 其他小技巧

-

修改配置后记得重启:

ccr restart -

想换模型? 在Claude Code里输入

/model就可以动态切换配置好的其他模型。 -

UI配置界面:输入

ccr ui会打开一个网页版配置管理器,图形化操作更直观。

写在最后

有了这套组合拳,Claude Code 不再是有钱人的玩具,咱们也能天天白嫖!

如果魔搭社区的免费额度不够用,你还可以配置其他免费/低价API,比如Ollama本地跑、硅基流动的免费模型等等,灵活得很。

快去试试吧,让你的终端也拥有一个免费的AI程序员!

参考链接

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)