特朗普封杀Anthropic,OpenAI火速上位

然而就在近日,白宫和五角大楼(战争部总部)宣布禁止联邦政府使用Anthropic及其AI平台Claude,甚至给该公司贴上了威胁国家安全的“供应链风险”标签,彻底切断了其与国防工业的联系。奥特曼声称,OpenAI在拿下这笔交易的同时,依然坚持了类似的安全原则,只是与政府协商采取了“不同的技术控制手段”。对此,Anthropic回应称,将在法庭上对“供应链风险”的认定提出起诉,认为其“法律依据不足”

当前,美国正身处一场战争之中——指的不仅仅是与伊朗的军事冲突。随着地缘政治紧张局势不断升级,美国正全力以赴应对伊朗问题。

但在美国国内,特朗普政府和美国战争部(原国防部)也发起了一场类似规模的对抗。这是一场针对美国顶尖AI巨头Anthropic的技术战。

此前,美国政府曾与Anthropic签署了一项高达2亿美元的合作协议。

然而就在近日,白宫和五角大楼(战争部总部)宣布禁止联邦政府使用Anthropic及其AI平台Claude,甚至给该公司贴上了威胁国家安全的“供应链风险”标签,彻底切断了其与国防工业的联系。

特朗普总统已下令所有联邦机构立即停用Anthropic的AI系统。

这一合作的提前终止,源于美国政府与Anthropic在“AI安全红线”问题上的激烈分歧。

戏剧性的是,禁令颁布后不久,OpenAI迅速介入并与五角大楼签署了新协议,直接接替了Anthropic的位置。

那么,美国政府与Anthropic之间到底发生了什么?Claude AI是如何从政府关键的AI工具沦为被封杀对象的?OpenAI又是在承诺安全的前提下,如何拿下这笔交易的?

以下从5个方面梳理事件脉络:

1、从合作伙伴到分道扬镳

近两年来,估值超3800亿美元的Anthropic一直与的美国政府(包括战争部)保持密切合作。该公司曾与五角大楼签有2亿美元的合同,旨在为国家安全目标定制和部署其AI模型Claude。

Claude曾是唯一获准在五角大楼高度机密的云网络上运行的大型AI系统。美国国防人员高度依赖该工具,其政府版“Claude Gov”因极高的易用性广受欢迎,甚至在早前抓捕委内瑞拉总统马杜罗的军事行动中发挥了作用。

然而,Anthropic一直将自己定位为“安全优先”的AI公司,频频强调要在敏感领域负责任地部署AI。

这成为了该公司与美国国防机构发生利益冲突的导火索——双方关于“军事系统究竟能如何使用Claude”的谈判,最终演变成了一场互不相让的权力争夺战。

2、安全红线 vs 军事灵活性

双方合作关系的破裂,源于一个核心分歧:谁拥有AI在国家安全领域的使用控制权?

在国防部长皮特·海格塞斯(Pete Hegseth)的领导下,五角大楼要求获得极大的灵活性,敦促Anthropic取消使用限制,允许军方在“任何合法国防用途”中不受限制地使用Claude。

但Anthropic首席执行官达里奥·阿莫迪(Dario Amodei)坚决拒绝放宽公司的道德底线。他死守两条“红线”:

- 严禁使用Claude对美国公民进行大规模的国内监控。

- 严禁将Claude部署于完全自主的武器系统(如“杀手机器人”)中,即不允许AI在没有人类实质参与的情况下做出定夺生死的决定。

Anthropic坚称,除这两个极其狭窄的限制外,公司全力支持Claude应用于合法的国家安全领域。

但五角大楼反驳称,应该由美国法律,而不是一家私人公司的“服务条款”来决定如何使用AI保卫国家。

3、联邦禁令与“供应链风险”黑名单

在谈判陷入僵局后,白宫据称要求Anthropic全面配合五角大楼的要求。

然而,在Anthropic错过了妥协的最后期限后,特朗普政府采取了两项强硬措施:

- 联邦禁令:特朗普下令所有联邦机构立即停止使用Anthropic的技术,并设立为期6个月的过渡期。

- 列入黑名单:紧接着,国防部长海格塞斯宣布,Anthropic被认定为威胁国家安全的“供应链风险”。

这个标签在历史上通常只用于国外对手企业。如今贴在Anthropic身上,等同于将该公司彻底踢出了整个美国国防工业体系。

任何与美国军方有业务往来的承包商或合作伙伴,现在都被明令禁止与该公司合作。

换言之,华盛顿正以前所未有的方式,将一家美国AI公司视作潜在的“敌对供应方”。

对此,Anthropic回应称,将在法庭上对“供应链风险”的认定提出起诉,认为其“法律依据不足”,并可能成为“危险的先例”。

4、意识形态之争:AI、监控与主权

美国政府对Anthropic采取极端措施的根本目的,在于维持军事主导权和国家主权。

五角大楼坚称,军方无意进行大规模监控或部署自主杀伤机器。但海格塞斯部长强调,战争部必须在战场上保持充分的灵活性(包括AI使用),绝不能让企业政策凌驾于军事战略之上。他指出,硅谷(影射Anthropic)建立的所谓“觉醒(Woke)”保护机制,可能会阻碍美国与竞争对手(如中国)的抗衡能力。

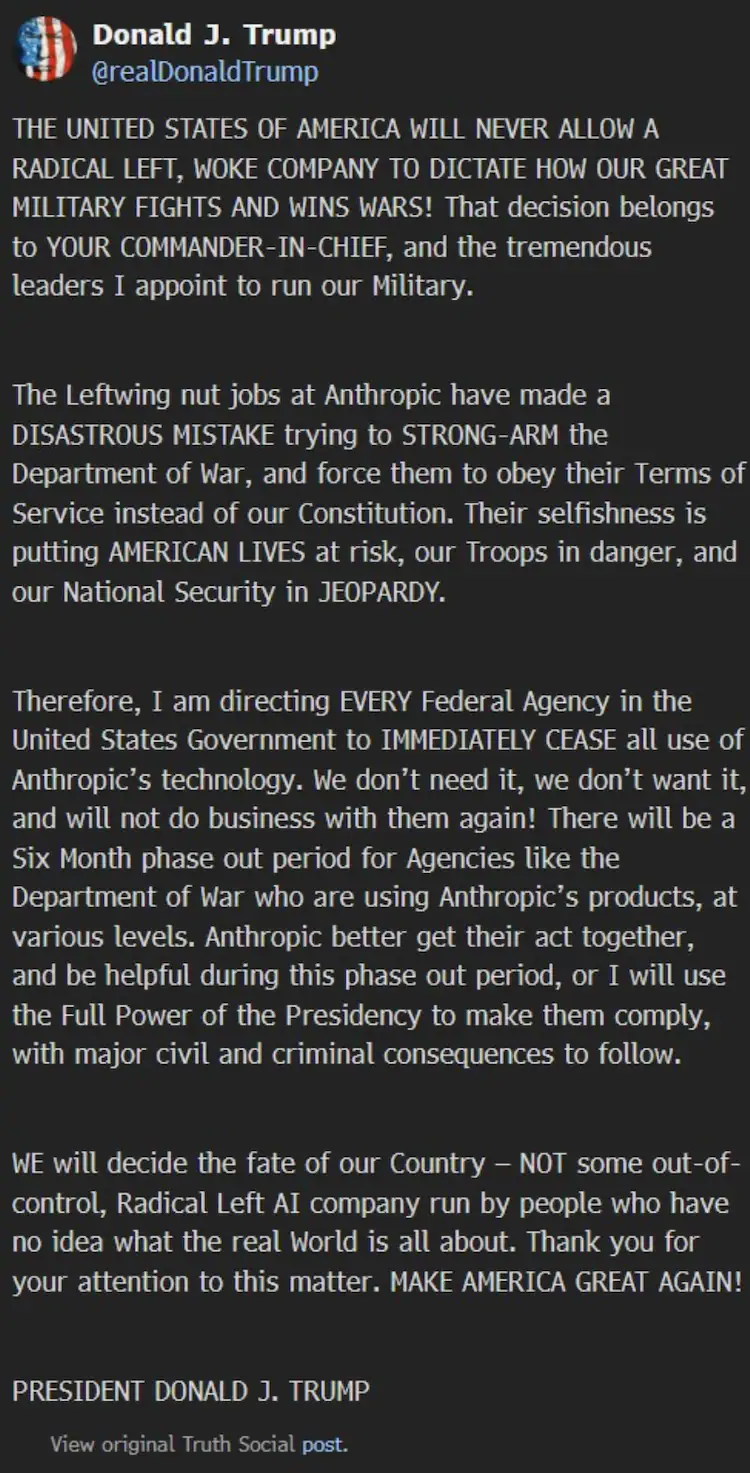

特朗普也在其社交平台Truth Social上发文怒斥:“Anthropic那些左翼疯子犯了一个灾难性的错误,他们试图向战争部施加强压,逼迫政府服从他们的服务条款,而不是我们的宪法。我们将决定国家的命运——绝不能由一家脱离现实的、失控的激进左翼AI公司来发号施令。”

他表示,虽然美国政府无意违反法律,但也绝不会受一家私企道德框架的约束。

而Anthropic及其支持者则警告,放宽这些“安全红线”将可能导致减少人类监督,并将生死决策权交给算法的系统出现,这是一条绝不该被跨越的底线。

5、Anthropic出局,OpenAI入场

在Anthropic遭遇禁令的短短几个小时内,OpenAI首席执行官山姆·奥特曼(Sam Altman)就宣布,公司已与五角大楼签署新协议,将其模型部署至涉密网络,实际上取代了Anthropic的位置。

奥特曼声称,OpenAI在拿下这笔交易的同时,依然坚持了类似的安全原则,只是与政府协商采取了“不同的技术控制手段”。他表示,该协议包含两项关键承诺:

- 不进行国内大规模监控;

- 在武力使用上保持明确的人类责任制。

奥特曼补充说,这些原则其实原本就已经体现在美国法律中,且目前已正式写入了双方的合同条款。

本文首发于微信公众号“通信官”,转载请联系授权。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)