OpenClaw 多模型本地部署实测,安装配置坑点全踩全解

如果你决定尝试OpenClaw,分享3个让你效率翻倍的技巧:先跑健康检查:安装完成后执行,自动修复80%的配置问题分步骤配置模型:先配置一个模型(比如Claude)跑通,再添加其他模型,避免同时踩多个坑定期更新:官方修复BUG的速度很快,执行保持最新版本本地AI的时代已经到来,与其等待「开箱即用」的完美工具,不如现在就动手尝试——毕竟,真正的自由,从来都需要一点折腾的勇气。【关键词标签】#Open

作为折腾过30+AI工具的科技老炮,最近被OpenClaw整得又爱又恨——

前两周花3天踩遍所有坑,从安装失败到模型调用报错,从权限问题到安全告警,一度想直接卸载;但当它真正跑通后,那种「本地AI随叫随到、数据不跑路」的体验,直接让我放弃了所有云端助手。

今天这篇不是官方说明书,而是纯实战干货:把安装配置的坑点、核心功能的真实表现、安全加固的关键步骤,一次性讲透,让你少走90%的弯路。

一、先搞懂:OpenClaw到底能解决什么痛点?

很多人误以为OpenClaw是「又一个AI聊天工具」,其实它的核心价值是「本地AI控制中枢」——

简单说,它就像一个「AI管家控制台」,能把Claude、GPT、Gemini等大模型「装进」你的电脑,还能让AI:

-

直接访问本地文件,编辑代码、处理文档不用再手动上传

-

执行系统命令,自动化批量操作(比如批量重命名、日志分析)

-

连接微信、飞书、Discord等平台,在聊天窗口直接调用AI

-

支持多模型无缝切换,哪个模型适合就用哪个,不用来回切换工具

最戳我的是「数据本地化」——所有对话记录、配置文件都存在本地,不用担心敏感信息泄露。对于需要处理商业数据、机密代码的开发者来说,这一点直接封神。

但必须坦诚:它不是给纯小白用的工具。需要你懂点终端命令、愿意花时间踩坑,毕竟「本地部署」的自由,代价就是前期的配置成本。

Openclaw安装准备:建议提前安装好cloudecode,Codex,Gemini等模型。请参考:Claude Code实战1:Claude Code深度介绍(附最全安装指南)

二、安装配置:5个必踩坑点+秒级解决方案

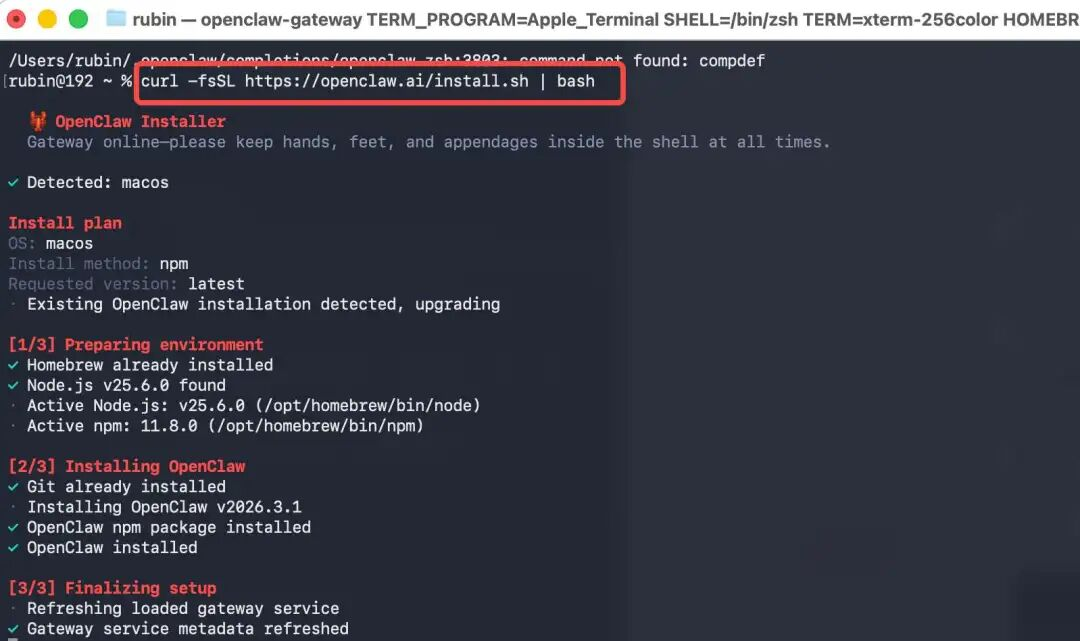

MacOS/Linux安装

curl -fsSL https://openclaw.ai/install.sh | bash

open claw安装不难,难的是配置

- 执行 openclaw 初始化命令:

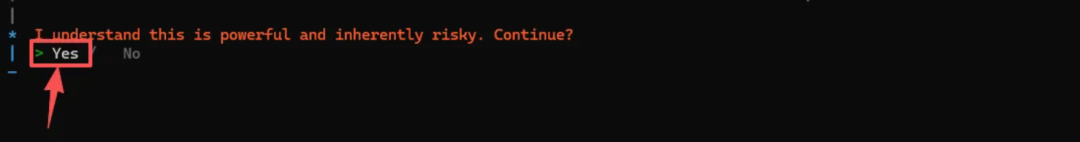

openclaw onboard --install-daemon2. 是否明白此工具功能强大且存在固有风险。是否继续?选择yes

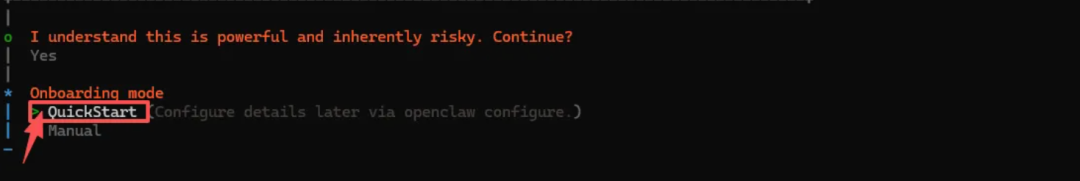

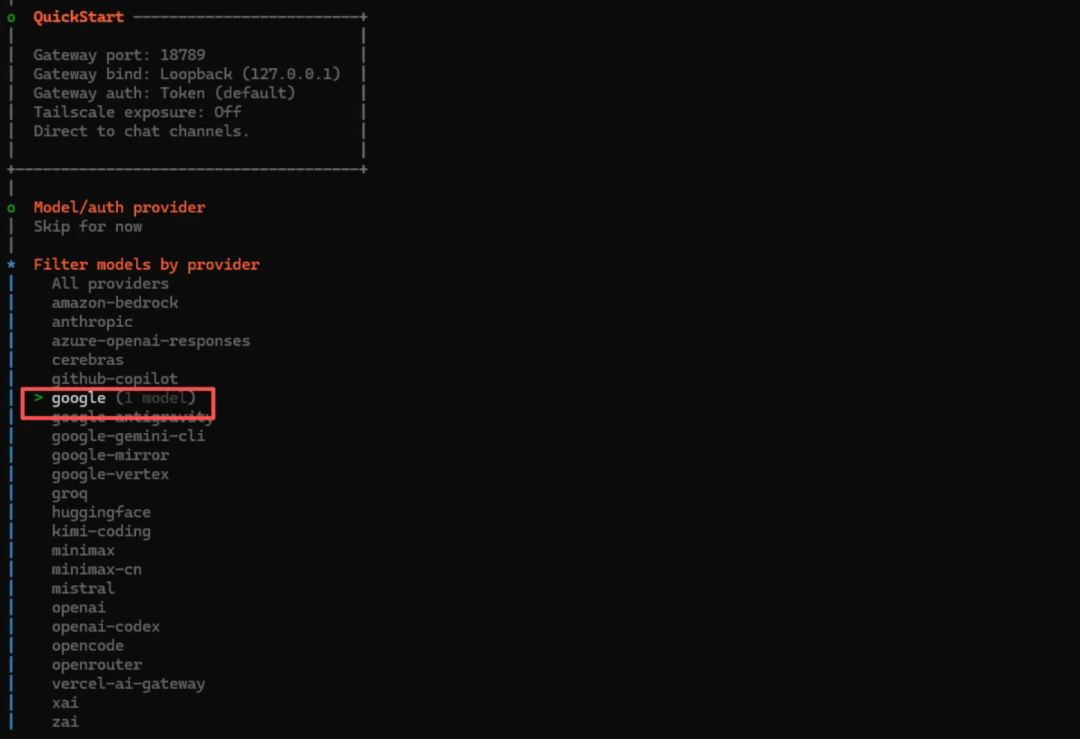

3.选择快速安装模式

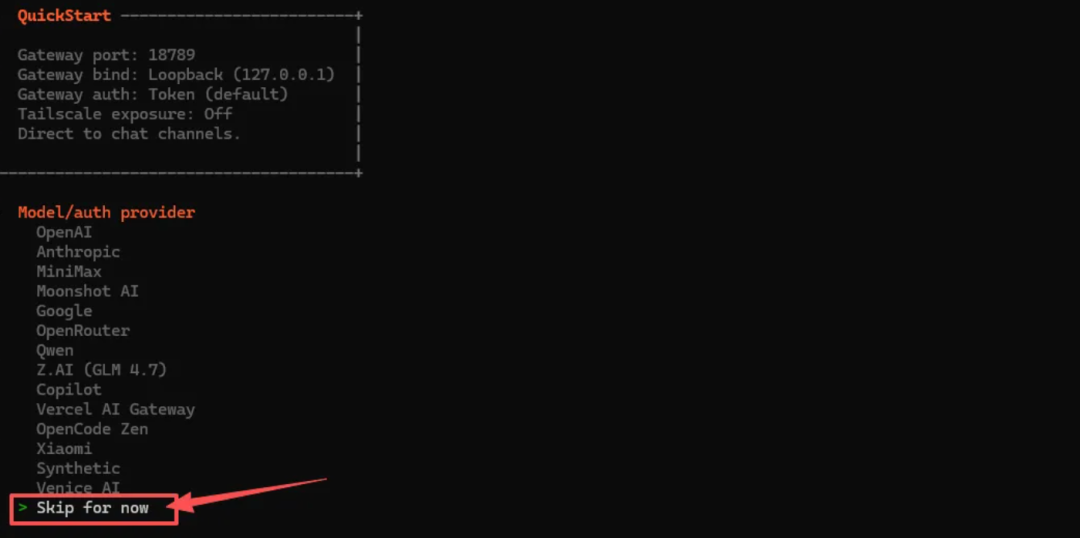

4.配置大模型,先选择跳过

5.按提供商筛选模型,这里选择你打算使用的模型。如果你用的是国内AICodeMirror那么随便选择一个,后面教你AICodeMirror的详细配置。

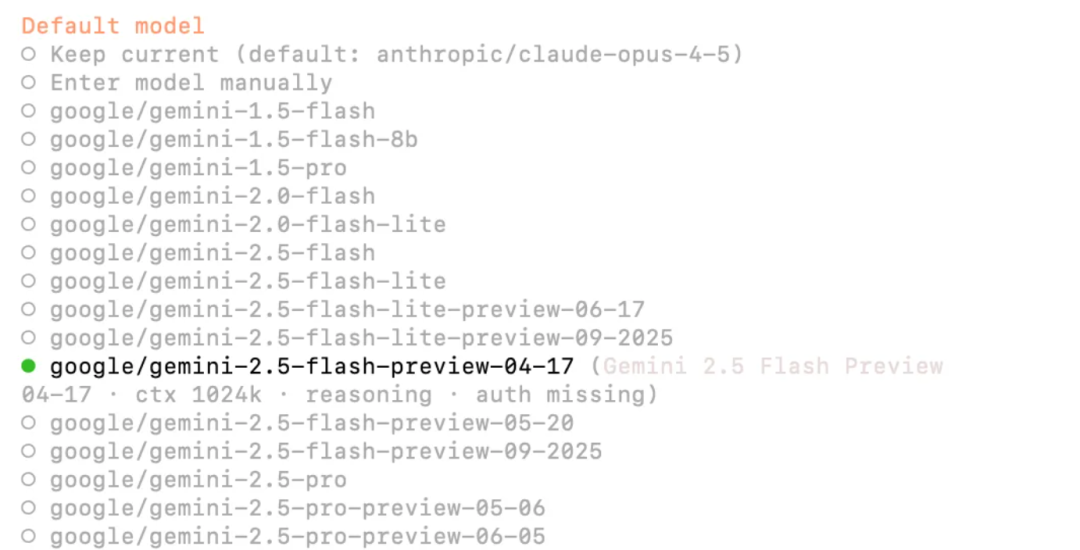

6.选择模型版本。也随便选一个版本,后面会重新配的.

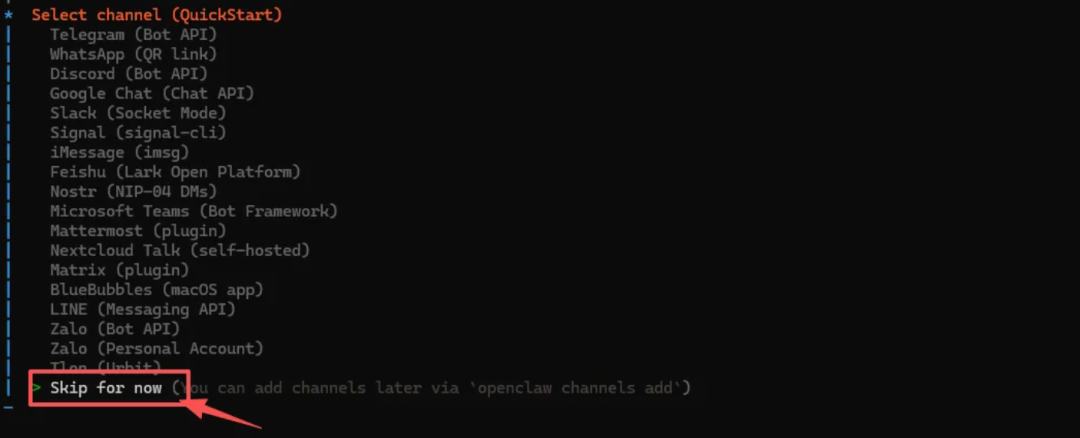

7.配置对话机器人,先跳过,后面再进行配置

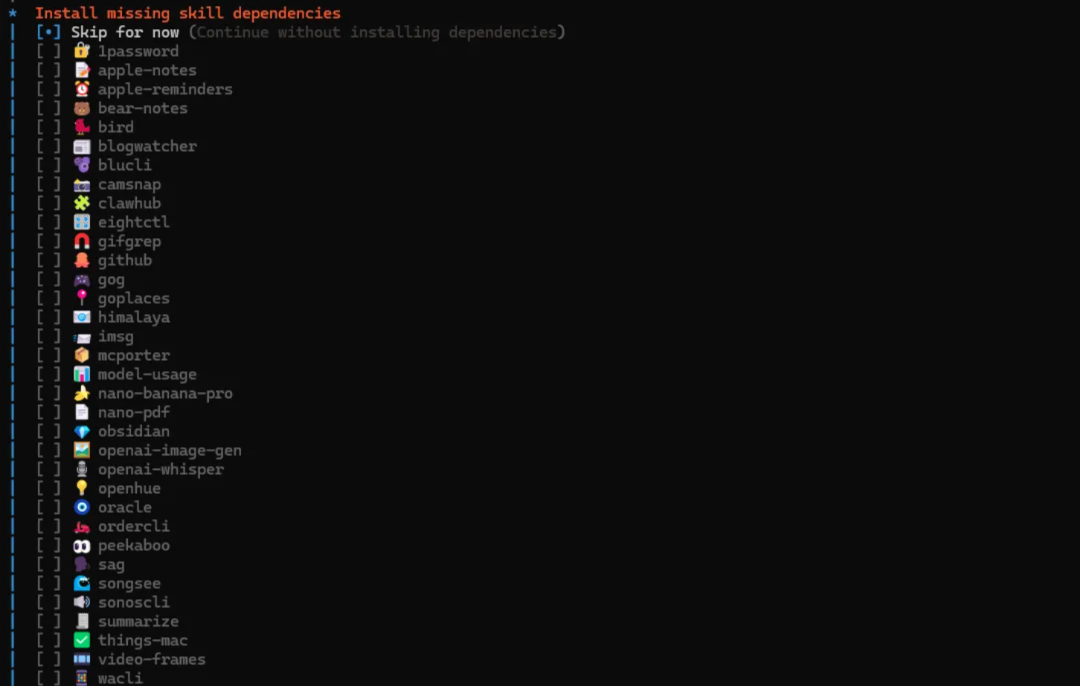

8. 配置自带的skills包,选择yes

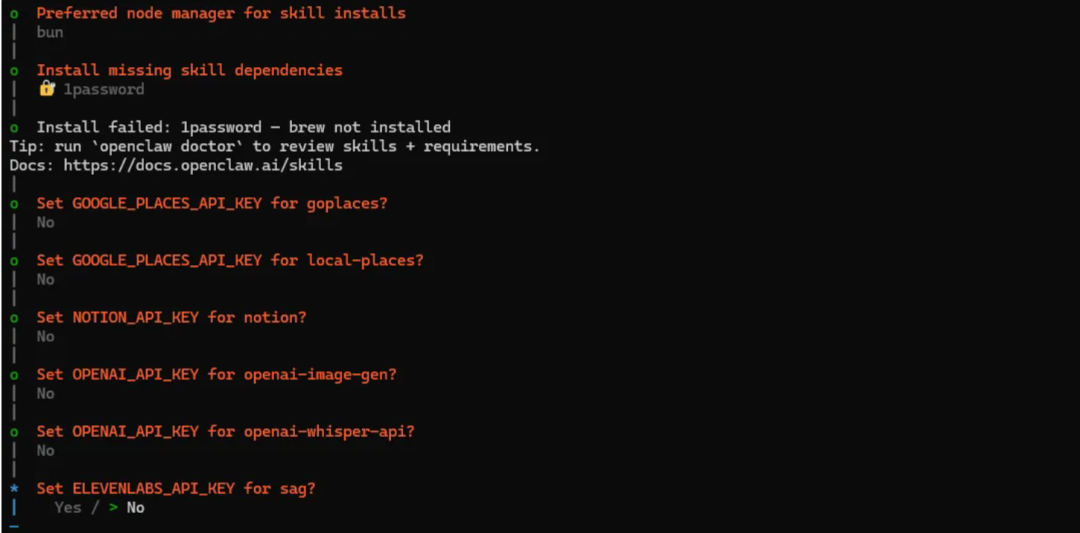

9.skills安装方式,选择pnpm

10.选择自己所需要的skills然后回车

11. 配置skills所需的大模型apikey,这里你可以输入你的模型API,也可以选择NO。用AICodeMirror的同学请选择No.

12. 自动安装好后会启动网关,这样就配置完成了。

如果你在国内使用的是aicodemirror的 API,请阅读下面一段配置信息。其他同学可以跳过这段。

- 文件路径 ~/.openclaw/openclaw.json

- 打开文件,将其中的 models 部分替换成下面的内容,请一定注意将 apiKey 更换为您自己的:

{

"models": {

"providers": {

"aicodemirror-claude": {

"baseUrl": "https://api.aicodemirror.com/api/claudecode",

"apiKey": "换成你的key",

"api": "anthropic-messages",

"models": [

{

"id": "claude-sonnet-4-5-20250929",

"name": "Claude Sonnet 4.5"

},

{

"id": "claude-opus-4-5-20251101",

"name": "Claude Opus 4.5"

}

]

},

"aicodemirror-gpt": {

"baseUrl": "https://api.aicodemirror.com/api/codex/backend-api/codex",

"apiKey": "换成你的key",

"api": "openai-responses",

"models": [

{

"id": "gpt-5.2",

"name": "GPT-5.2"

},

{

"id": "gpt-5.2-codex",

"name": "GPT-5.2 Codex"

}

]

},

"aicodemirror-gemini": {

"baseUrl": "https://api.aicodemirror.com/api/gemini/v1",

"apiKey": "换成你的key",

"api": "openai-completions",

"models": [

{

"id": "gemini-3-pro-preview",

"name": "Gemini 3 Pro Preview"

},

{

"id": "gemini-3-flash-preview",

"name": "Gemini 3 Flash Preview"

}

]

}

}

}

}3. 修改agent部分。

"agents": {

"defaults": {

"model": {

"primary": "aicodemirror-gemini/gemini-3-pro-preview"

},

"models": {

"aicodemirror-gpt/acm-codex/gpt-5.2-codex": {},

"aicodemirror-gpt/gpt-5.2-codex": {},

"aicodemirror-gemini/gemini-3-pro-preview": {},

"aicodemirror-claude/claude-opus-4-5-20251101": {}

},

"workspace": "写你自己的workspace路径",//我的路径供参考/Users/Rubin/.openclaw/workspace

"compaction": {

"mode": "safeguard"

},

"maxConcurrent": 4,

"subagents": {

"maxConcurrent": 8

}

}

},4. 配置完成后,打开终端执行命令:openclaw gateway restart,重启网关服务

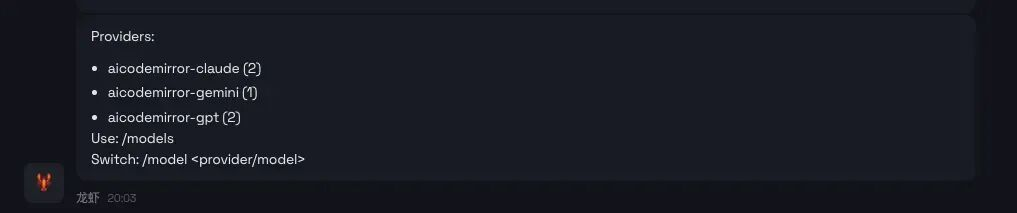

openclaw gateway restart5. 回到claw网关的网页界面,在「chat」输入「/models」查看已配置的 provider

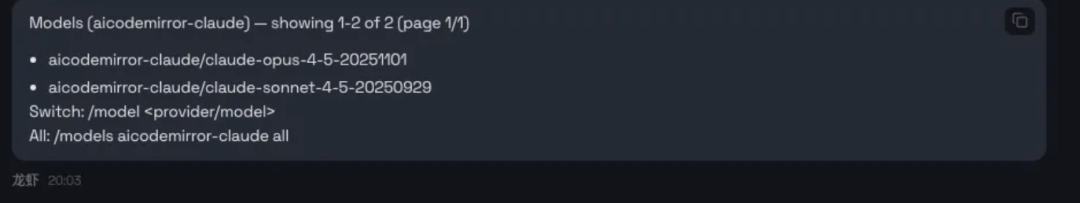

输入「/models aicodemirror-claude」选择 claude 系列 provider(您也可以选择 aicodemirror-gemini 或 aicodemirror-gpt)

坑1:openclaw: command not found(命令未找到)

这是最常见的开局坑,原因是npm全局目录没加入系统PATH。

解决方案:

# 1. 先查npm全局目录(复制输出结果)

npm prefix -g

# 2. 把目录加入PATH(macOS/Linux)

echo 'export PATH="$(npm prefix -g)/bin:$PATH"' >> ~/.zshrc

# 3. 立即生效

source ~/.zshrc

✅ 验证:输入openclaw --version,能显示版本号就没问题。

坑2:权限错误(EACCES: permission denied)

执行npm install -g时报错,本质是系统级目录不让普通用户写入。

解决方案:切换到用户级全局目录,永久解决权限问题:

mkdir -p "$HOME/.npm-global"

npm config set prefix "$HOME/.npm-global"

echo 'export PATH="$HOME/.npm-global/bin:$PATH"' >> ~/.zshrc

source ~/.zshrc

坑3:Gateway启动被阻止(set gateway.mode=local)

启动时提示「未设置运行模式」,这是OpenClaw的安全机制,防止无配置误运行。

解决方案:一句话配置本地模式:

openclaw config set gateway.mode local && openclaw gateway start

坑4:模型调用报错(No API key found)

配置好密钥后仍提示「缺少API密钥」,罪魁祸首是缺失agent认证目录。

解决方案(macOS为例):

# 1. 新建认证目录

mkdir -p /Users/你的用户名/.openclaw/agents/main/agent

# 2. 写入密钥文件(以Gemini为例)

cat > /Users/你的用户名/.openclaw/agents/main/agent/auth-profiles.json << EOF

{"google":{"apiKey":"你的AIzaSyxxx密钥","model":"gemini-3-pro-preview"}}

EOF

# 3. 重启网关

openclaw gateway restart

坑5:Dashboard认证失败(次数过多锁定)

浏览器提示「too many failed authentication attempts」,是因为缓存了旧Token。

解决方案:

# 1. 重启网关,清零失败计数

openclaw gateway stop && pkill -f openclaw && openclaw gateway start --mode local

# 2. 用无痕模式打开Dashboard

open -a "Google Chrome" --args --incognito http://127.0.0.1:18789

⚠️ 关键提醒:所有配置修改后,必须重启网关才能生效!别像我一样改完配置等半天,才发现忘了重启。

三、核心功能实测:哪些好用?哪些是噱头?

跑通配置后,我测试了OpenClaw的5个核心功能,结论很明确:实用功能拉满,噱头功能可以忽略。

1. 多模型切换:真·无缝切换,不用来回切换工具

这是我用得最多的功能。配置好Claude、GPT、Gemini的密钥后,在Dashboard里一键切换,聊天窗口直接沿用之前的上下文。

实测体验:

-

切换响应速度≤2秒,没有卡顿

-

支持模型专属参数配置(比如Claude的temperature、GPT的top_p)

-

能自动记忆每个模型的使用习惯

✅ 适用场景:需要对比不同模型输出的开发者(比如用Claude写代码、GPT写文案、Gemini处理多模态)。

2. 本地文件访问:安全但需要手动授权

OpenClaw能直接读取本地文件,编辑代码、分析数据不用上传云端。

实测体验:

-

访问文件需要手动授权目录,安全性有保障

-

支持批量处理文件(比如批量格式化代码、提取文档关键信息)

-

对大文件(100MB+)的处理速度取决于本地硬件

❌ 槽点:不能直接修改文件,需要生成修改后的代码,手动替换,有点繁琐。

3. 系统命令执行:自动化神器,但要注意安全

能让AI帮你执行终端命令,比如批量重命名文件、分析日志、安装依赖。

实测体验:

-

执行高危命令(比如rm、sudo)会二次确认,防止误操作

-

能自动生成复杂命令(比如awk分析日志的命令)

-

支持命令结果实时反馈,不用切换终端

✅ 适用场景:需要处理重复劳动的程序员(比如每天的日志分析、文件整理)。

4. 多平台消息集成:功能强大但配置复杂

支持把AI集成到微信、Telegram、Discord等平台,在聊天窗口直接调用。

实测体验:

-

Telegram、Discord配置简单,10分钟搞定

-

微信需要借助第三方插件,稳定性一般

-

支持群聊@调用,适合团队共享AI助手

❌ 槽点:配置步骤太多,新手容易在「webhook设置」「token绑定」环节卡住。

5. 安全加固:必须做,否则有风险

本地部署的自由,意味着需要自己负责安全。OpenClaw默认的安全配置比较宽松,必须手动加固。

核心加固步骤(3分钟搞定):

# 1. 收紧目录权限,仅自己可访问

chmod 700 ~/.openclaw

# 2. 开启系统防火墙(macOS)

sudo /usr/libexec/ApplicationFirewall/socketfilterfw --setglobalstate on

# 3. 重置Gateway Token,防止未授权访问

openclaw config set gateway.auth.token $(openssl rand -hex 32)

# 4. 绑定仅本地访问,禁止外部连接

openclaw config set gateway.bind loopback

✅ 实测效果:安全审计显示「0 critical风险」,放心使用。

四、谁该用?谁别碰?清醒看待工具价值

OpenClaw不是万能的,也不是所有人都需要。基于实测体验,给大家一个清晰的选择建议:

适合的用户:

-

开发者:需要处理代码、本地文件,追求数据安全

-

数据分析师:需要批量处理本地数据,不想上传云端

-

隐私敏感人群:担心聊天记录、商业数据泄露

-

自动化爱好者:想通过AI简化重复劳动

不适合的用户:

-

纯小白:连终端都不会用,怕踩配置坑

-

怕麻烦的用户:不想花时间配置、加固,追求「开箱即用」

-

仅需要简单聊天的用户:普通云端AI助手完全能满足需求

坦诚说,OpenClaw的「学习曲线」是真实存在的。但一旦跨过这个门槛,你会发现:本地AI助手的灵活性、安全性、响应速度,都是云端工具无法比拟的。

我现在每天用它处理3类工作:

-

代码编写与重构:直接访问本地项目,生成的代码不用复制粘贴

-

日志分析:让AI执行命令,自动提取关键信息,生成报告

-

多模型对比:同一需求同时用3个模型生成结果,择优使用

效率至少提升了40%,而且再也不用担心「数据上传」的风险。

五、关键洞察:本地AI助手的3个发展趋势

折腾OpenClaw的过程中,我明显感受到本地AI助手的3个趋势,未来1-2年一定会成为主流:

趋势1:数据本地化成为核心竞争力

随着数据安全法规越来越严,企业和个人对「数据不跑路」的需求会越来越强烈。

OpenClaw这类本地部署工具,正是抓住了这个痛点——数据存储在本地,完全可控,这是云端工具无法替代的优势。

趋势2:多模型集成成为标配

没有哪个模型是万能的:Claude擅长代码和长文本,GPT擅长文案和创意,Gemini擅长多模态。

未来的AI助手,必然是「多模型集成」的——用户不用关心背后是哪个模型,工具自动根据需求匹配最优模型,OpenClaw已经走在了前面。

趋势3:从「单一功能」到「生态协同」

现在的OpenClaw已经能连接多平台、执行系统命令、访问本地文件,未来会进一步打通更多生态:

比如连接智能家居、控制本地软件、对接企业内部系统,成为真正的「本地AI中枢」。

但也要警惕一个隐忧:本地AI助手的安全风险。如果不做好权限控制、防火墙配置,很可能成为黑客攻击的入口。这也是我为什么反复强调「安全加固」的原因。

六、最后:我的使用建议与互动

如果你决定尝试OpenClaw,分享3个让你效率翻倍的技巧:

-

先跑健康检查:安装完成后执行

openclaw doctor,自动修复80%的配置问题 -

分步骤配置模型:先配置一个模型(比如Claude)跑通,再添加其他模型,避免同时踩多个坑

-

定期更新:官方修复BUG的速度很快,执行

openclaw --update保持最新版本

本地AI的时代已经到来,与其等待「开箱即用」的完美工具,不如现在就动手尝试——毕竟,真正的自由,从来都需要一点折腾的勇气。

【关键词标签】#OpenClaw #本地AI助手 #AI工具实测 #开发者效率 #数据安全 #AI部署教程 #编程工具推荐 #技术避坑指南

Claude Code实战1:Claude Code深度介绍(附最全安装指南)

Claude Code 实战2:快速入门,5分钟上手让终端成为你的AI编程搭档

Claude Code实战3: 七大效率模块详解,让你效率快人一步

Claude code实战4: Opus、Sonnet、Haiku 同台竞技,谁的代码能力最强?怎么选最划算?

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)