迁移学习的通俗理解(微调是迁移学习的一种方式)

迁移学习,就是把一个已经训练好的模型(比如学会识别猫的神经网络),把它学到的“知识”,应用到另一个不同但相关的任务上(比如识别老虎)。3. 为什么需要迁移学习?在很多专业领域(比如医疗影像分析),我们很难获得海量的、被医生标注好的X光片数据。数据太少,AI很难训练好。但互联网上有海量的、普通的图片数据(比如猫、狗、汽车的图片)。我们可以先用这些海量数据训练一个基础模型,然后把它的知识迁移到医疗影像

内容来源于AI:

迁移学习与泛化的区别,参考该文。

1. 一个核心比喻:学会弹钢琴后,学电子琴会很快

想象一下:

-

任务A(源领域):你花了很多年,学会了弹钢琴。你掌握了乐理知识、手指的灵活性、对和弦的理解。

-

任务B(目标领域):现在,你想学弹电子琴。

问题来了:你需要从零开始学电子琴吗?

当然不用!你不需要重新学习“什么是音符”,也不需要重新练习“手指怎么动才灵活”。

-

你已经把学习弹钢琴时获得的大部分通用知识(乐理、指法、节奏感)“迁移”到了学习电子琴上。

-

你只需要稍微适应一下电子琴和钢琴的不同之处(比如音色切换、力度感应等),就能很快上手弹电子琴。

在这个比喻里:

-

弹钢琴 = 我们用来做迁移的源任务(通常是一个数据量很大的任务)。

-

学电子琴 = 我们真正想解决的目标任务(通常数据量较小)。

-

通用的乐理和指法 = 迁移学习中被转移的知识。

2. 迁移学习的正式定义

把上面的例子抽象一下,就是迁移学习:

迁移学习,就是把一个已经训练好的模型(比如学会识别猫的神经网络),把它学到的“知识”,应用到另一个不同但相关的任务上(比如识别老虎)。

3. 为什么需要迁移学习?

主要有两个非常现实的原因:

-

解决“数据孤岛”问题:

-

在很多专业领域(比如医疗影像分析),我们很难获得海量的、被医生标注好的X光片数据。数据太少,AI很难训练好。

-

但互联网上有海量的、普通的图片数据(比如猫、狗、汽车的图片)。我们可以先用这些海量数据训练一个基础模型,然后把它的知识迁移到医疗影像这个小众任务上。这样,即使只有少量X光片,也能训练出一个不错的模型。

-

-

节省计算资源和时间:

-

训练一个大型AI模型(比如GPT)需要成千上万块显卡和数周时间,花费巨大。

-

普通人没有这个条件。但我们可以直接下载大公司已经训练好的模型,把它作为一个“预训练模型”,然后在自己的电脑上用少量数据和较短时间内,对它进行“微调”,让它适应自己的任务。

-

4. 一个经典的AI例子:识别卡车

假设你的目标是让AI识别卡车,但你只有100张卡车的照片(数据太少,很难训练好)。

用迁移学习怎么解决?

-

找一个现成的模型:从网上下载一个已经训练好的AI模型,比如 ImageNet模型。

-

ImageNet是一个巨大的图片数据集,包含上千万张图片,涵盖1000个类别,比如猫、狗、汽车、船等。这个模型已经学会了如何从图片中提取基础特征(比如物体的边缘、轮廓、形状、颜色、纹理等)。

-

-

进行“微调”:

-

你把这个现成模型拿过来,把它最后用来判断“这是猫还是狗”的那一层(分类层)拆掉。

-

然后,装上一个新的、用来判断“这是不是卡车”的分类层。

-

接着,用你手里仅有的100张卡车照片,去轻微地调整一下整个模型的参数。这个过程就像是在“复习”和“适应”,而不是“从头学起”。

-

-

结果:最终得到的模型,会非常擅长识别卡车。因为它站在了ImageNet这个“巨人”的肩膀上,它已经知道什么是物体、什么是纹理,只需要专门学习一下“卡车长什么样”就行了。

总结

迁移学习 = 站在前人的肩膀上,让AI不用每次都“从零开始”。

它把一个领域学会的通用知识(底层特征、规律)应用到另一个相关领域,从而降低了对新领域数据量和计算资源的需求。

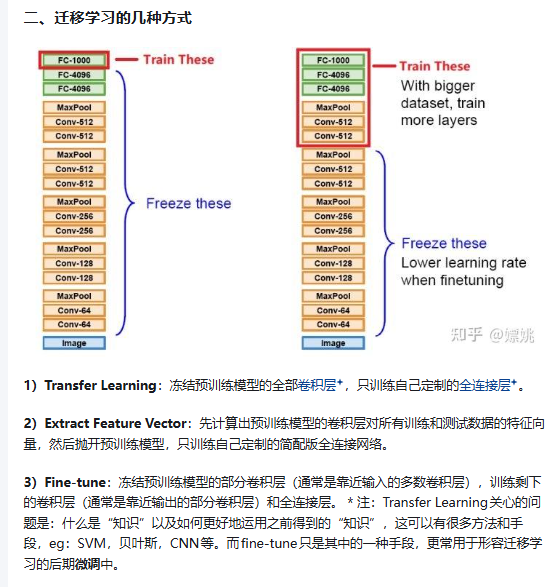

微调是迁移学习的一种方式。

更多推荐

已为社区贡献57条内容

已为社区贡献57条内容

所有评论(0)