企业级 RAG 知识库:从原理、架构到生产实战全解析

拒绝“垃圾进,垃圾出”!构建高性能 AI 知识库,RAG 架构的设计至关重要。本文梳理了从文档解析(PDF/Word 转 Markdown)到向量检索、再到语义重排序(Rerank)的全链路实现方案。重点讨论了在生产环境下,如何通过元数据过滤实现多租户数据隔离,并对比了 BGE-M3、Cohere 等主流模型的实战表现,助你打造企业级精准问答系统。

在 LLM(大模型)时代,如何让 AI 读懂你的私有文档?RAG(Retrieval-Augmented Generation,检索增强生成) 配合 向量数据库 已成为工业界的标准答案。本文将带你深度拆解这一技术的底层逻辑与实现细节。

一、 核心原理:为什么 LLM 需要 RAG?

大模型虽然博学,但存在“幻觉”和“知识滞后”的问题。RAG 的本质是给大模型配上一本实时更新的参考书。

其核心技术支撑是向量化(Embedding):将文本转化为多维空间中的坐标。语义相似的内容在空间中距离更近。

-

传统搜索:关键词匹配(搜“苹果”找不到“iPhone”)。

-

向量搜索:语义匹配(理解“乔布斯的公司”与“苹果”的相关性)。

二、 系统架构:RAG 的“两条流水线”

一个成熟的 RAG 系统由离线入库和在线检索两部分组成。

1. 离线数据处理(ETL 流水线)

-

文档解析:将 PDF、Word、PPT、Markdown 等杂乱格式统一提取为文本。

-

数据清洗:剔除页眉页脚、乱码、重复信息。

-

分块(Chunking):长文切段。建议采用“父子索引”或保持 10%-20% 的重叠度以保留上下文。

-

向量化(Embedding):调用模型将文本转为向量。

-

入库:将“向量 + 原始文本 + 元数据(Metadata)”存入向量数据库。

2. 在线检索生成(RAG Chain)

-

意图理解:对用户提问进行改写或关键词提取。

-

多路检索:同时进行向量检索和关键词检索(BM25)。

-

重排序(Rerank):使用精排模型对检索结果进行相关性打分。

-

提示词增强(Prompt):将最相关的知识片段喂给 LLM。

-

流式生成:LLM 输出最终答案。

三、 关键选型策略

1. 向量数据库:如何做数据隔离?

在生产环境,必须区分不同领域(如财务 vs 技术)的数据,策略如下:

-

元数据过滤 (Metadata Filtering):最推荐。给数据打标签(如

domain: finance),检索时带上 Filter 条件。 -

命名空间 (Namespace):逻辑隔离,兼顾性能与灵活性。

-

多集合隔离 (Collection):物理隔离,适用于数据完全互不往来的严苛场景。

2. 模型选型:双剑合璧

-

Embedding 模型:决定检索下限。中文推荐

BGE-M3(多语言支持强)或GTE系列。 -

Rerank 模型:决定检索上限。向量搜索常有噪声,必须加一级 Rerank(如

BGE-Reranker或Cohere)来精准纠偏。

四、 生产实战:支持的格式与预处理

在生产领域,数据质量决定 AI 智商。

| 数据格式 | 处理难点 | 生产建议 |

| 扫描件、多栏布局、表格断裂 | 使用 Marker 或 Unstructured 将其转为 Markdown 格式。 |

|

| Markdown / TXT | 结构最友好 | 直接按标题层级分块。 |

| Excel / CSV | 语义支离破碎 | 将每一行转为一段描述性文字,或使用 LLM 生成摘要再入库。 |

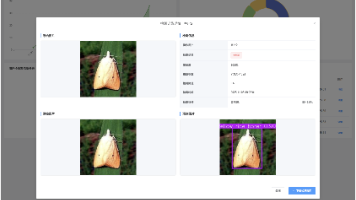

| 图片 / 图表 | 无法直接识别 | 接入多模态模型(如 GPT-4o)生成 Caption(文字描述)。 |

金律: 永远不要直接入库原始文档。在系统内部建立一套自动化 ETL 任务,先统一转为 Markdown 格式,再进行清洗和分块。

五、 避坑指南:给开发者的 4 个建议

-

垃圾进,垃圾出 (GIGO):入库前的清洗占 70% 的工作量。表格处理不好,RAG 基本废一半。

-

必须有 Rerank:纯向量检索在大规模数据下容易产生“语义漂移”,Rerank 是保证准确率的最后一道防线。

-

混合检索 (Hybrid Search):向量检索不是万能的,必须结合传统关键词检索(Elasticsearch/BM25)来处理人名、型号等硬匹配。

-

动态分块:针对不同领域文档,设置不同的块大小(Chunk Size)。技术文档建议小而精,政策文档建议大而全。

结语

RAG 不是简单的“搜索 + 问答”,而是一套复杂的数据工程。从精细的 PDF 解析,到多路并发的混合检索,再到精准的重排序,每一个环节的优化都能显著提升用户体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)