大模型“涌现能力”的来源解析

大模型“涌现能力”的来源解析

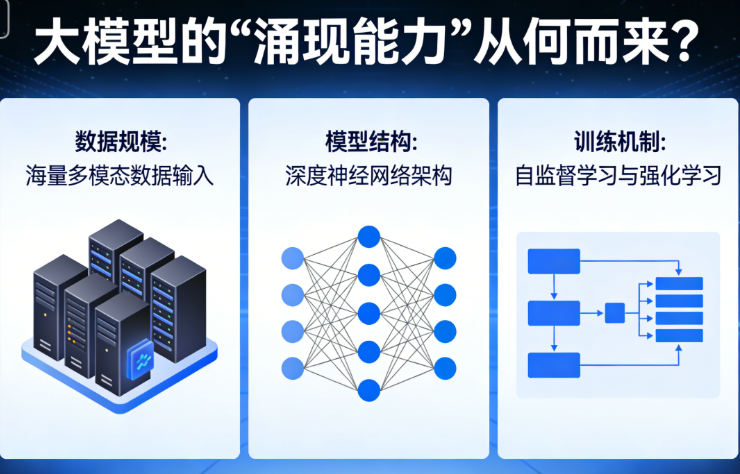

大模型的“涌现能力”,是指当模型规模、训练数据或计算资源突破某个临界阈值后,突然展现出的、小模型中完全不存在的全新能力——这种“从无到有”的跃迁式质变,并非神秘的“魔法现象”,而是多重因素协同作用的结果,目前学界虽无完全统一的定论,但主流研究已明确其核心来源围绕规模、结构、数据三大支柱展开,辅以提示工程等催化因素,共同推动能力的爆发式显现。

一、核心支柱一:规模效应——涌现的“第一推动力”

规模是涌现能力的基础前提,这里的“规模”并非单一的参数量,而是参数量、训练数据量与计算资源的综合积累,其核心作用是为模型提供捕捉复杂模式的“容量”与“素材”,这也是规模定律(Scaling Law)在大模型领域的直接体现。

小模型受限于参数量不足,仅能学习数据中表层、常见的简单模式,无法捕捉语言、知识与世界规律中的长距离、高阶关联,陷入欠拟合和知识碎片化的困境;而当参数量突破百亿、千亿级阈值(如GPT-3的175B参数、Llama-2-70B),模型便拥有了足够广阔的“假设空间”,能够承载海量数据中的深层信息——它不再是简单记忆数据,而是对人类文明积累的知识进行极致压缩与提炼,习得更具泛化性的底层规则。

例如,小模型在零样本三位数加法任务中准确率几乎为0%,而千亿级参数量的大模型准确率可突然提升至80%以上;小模型无法理解多步数学推理的逻辑关联,大模型却能通过规模优势捕捉到数学运算的内在规律,即便未被专门训练,也能逐步完成复杂解题任务。同时,计算资源的升级为规模扩展提供了保障,FP8训练等技术降低了显存消耗,间接扩大了训练批量,让海量参数的训练与复杂模式的学习成为可能,而MoE架构通过稀疏激活,让“名义上的万亿参数”转化为可高效训练的“有效参数”,进一步推动了涌现能力的提前显现。

二、核心支柱二:模型结构——涌现的“高效载体”

如果说规模是“原料”,那么先进的模型结构就是“熔炉”,它决定了模型能否高效整合参数与数据,将规模优势转化为实际能力,其中Transformer架构的贡献最为关键,其自注意力机制为涌现能力提供了核心结构支撑。

Transformer的自注意力机制,允许模型在处理序列数据时,动态权衡不同内容的重要性,高效捕捉长距离依赖关系——这解决了传统模型难以理解复杂上下文、无法连贯推理的痛点。比如,在处理“小明把书给了小红,它很厚”这句话时,大模型能通过注意力权重计算,准确判断“它”指代“书”而非“小红”,这种连贯的语义理解能力,正是多步推理、复杂指令遵循等涌现能力的基础。

此外,模型的“过参数化”特性也助力了涌现能力的产生:当模型参数远超训练样本数时,其非线性映射能力会呈指数级增强,能够拟合更抽象、更复杂的函数关系,在看似无关的概念之间建立关联,进而催生出新的综合能力。同时,模型深度与宽度的优化(如Chinchilla-optimal证明同等算力下,更深的网络在推理任务上涌现更早),进一步提升了结构的高效性,让规模优势得以充分释放。

三、核心支柱三:数据质量——涌现的“营养供给”

海量、多样化的训练数据,是涌现能力的“燃料”,没有高质量数据的支撑,再大的参数量、再先进的结构,也无法催生出有价值的涌现能力。数据的核心价值体现在“结构化多样性”上,而非单纯的“数量多”。

一方面,数据的“知识广度”为模型构建起全面的知识体系——涵盖人类社会、自然科学、语言文化等各个领域,让模型能够接触到各种复杂场景与问题;另一方面,数据的“模式多样性”(包含不同的语言风格、逻辑结构与表达形式),促使模型学习到更通用、更灵活的底层规则,而非死记硬背特定样本。OpenAI内部实验显示,当数据语言种类超过40种且领域超过200个时,多步推理任务会出现明显的能力跃迁。

更重要的是,数据中的“隐式监督信号”发挥着关键作用——模型在训练过程中,会自发从海量数据中挖掘隐藏的推理规则、逻辑关联,无需人工专门标注,这种“自学”能力正是涌现能力的重要来源之一。例如,模型通过学习大量包含因果关系的文本,会自发掌握因果推理的基本逻辑;通过学习不同句式的表达,会自主总结出语法规则与语义框架,进而在新任务中展现出泛化能力。同时,自监督学习方式让模型能充分利用未标记数据,进一步丰富知识储备,推动能力涌现;而适量的噪声(如5%的随机标签)还能起到“正则化”作用,提升模型在对抗样本上的鲁棒性,间接助力涌现能力的稳定显现。

四、辅助催化因素:激活涌现的“加速器”

除了三大核心支柱,还有两个关键因素会影响涌现能力的显现,它们并非核心成因,却能加速或激活涌现能力的爆发,让“潜在能力”转化为“可用能力”。

(一)提示工程的激发作用

很多涌现能力并非“天生存在”,而是需要通过特定的提示方式激发,其中思维链推理(CoT)、上下文学习(In-context Learning)等方式最为典型。小模型即便采用相同的提示方式,也无法理解其中的逻辑,而大模型在规模与结构的支撑下,能通过提示捕捉任务模式——例如,仅在提示中给出几个示例,大模型就能快速学会类似任务;通过引导模型生成“思考过程”,其推理准确率会显著提升,这种快速学习能力,正是被提示方式激活的涌现能力之一。

(二)任务特性的适配性

涌现能力并非在所有任务中都会出现,它更倾向于出现在需要多步推理、组合技能的复杂任务中,如代码生成、多语言翻译、复杂指令遵循等。这类任务需要模型整合多种基础能力,而只有当模型规模、结构与数据积累达到阈值,能够同时掌握这些基础能力并加以整合时,涌现能力才会显现;而诸如简单事实问答等基础任务,能力提升呈线性趋势,不会出现“跃迁式”的涌现现象。

五、争议与本质总结

需要注意的是,学界对涌现能力仍存在合理争议:部分研究者认为“涌现”可能被夸大,一些现象其实是评估指标不敏感或任务设计偏差导致的假象;另一些人指出,如果用更合适的提示或微调,小模型也可能表现出类似能力,因此“涌现”可能依赖于推理方式而非单纯的规模。

但不可否认的是,涌现能力的本质是“规模、结构、数据”三大支柱协同作用下的“量变引起质变”,三者形成正向循环:更大模型带来更高的数据压缩效率,可喂入更多多样化数据,进而进一步放大模型容量,当综合条件突破临界阈值时,模型便会实现能力跃迁。这种现象类似于物理学中的“相变”,体现了复杂系统中“整体大于部分之和”的特性,既为通用人工智能的发展带来了希望,也提出了安全可控的挑战。

更多推荐

已为社区贡献24条内容

已为社区贡献24条内容

所有评论(0)