Flutter 三方库 googleai_dart 的鸿蒙化实战 - 架起纯 Dart Gemini 大模型算力的沟通桥梁

本文介绍了如何将纯Dart开发的googleai_dart库集成到鸿蒙系统中,实现与Google Gemini大语言模型的无缝对接。该库采用强类型映射,支持多模态数据打包、SSE流式传输和工具调用功能,特别适合需要轻量级AI能力的鸿蒙应用开发。文章详细解析了库的核心原理、鸿蒙适配方案、关键API使用方法,并提供了多模态意图分析和AI代理控制鸿蒙设备的实战案例。通过该方案,开发者可以轻松为鸿蒙设备添

欢迎加入开源鸿蒙跨平台社区:https://openharmonycrossplatform.csdn.net

Flutter 三方库 googleai_dart 的鸿蒙化实战 - 架起纯 Dart Gemini 大模型算力的沟通桥梁

前言

随着 AI 浪潮的兴起,将 LLM(大语言模型)集成进端侧应用已成为标配。但很多开发者在构建鸿蒙系统的智能助手、车机对话伴侣或者是智能文本总结器时,往往会发现部分官方提供的包过度绑定特定平台、不仅带来不必要的信道负担。甚至其对多模态的支持逻辑由于系统差异难以完全跑通。

如果你追求的是一个纯净的、不带特定渲染系统负担的底层数据处理包,或想要深度对接 Google Gemini 系列多模态功能,那么 googleai_dart 这个纯 Dart 开发的大模型包绝对是你的首选。它采用最严谨的强类型方法完整支持了 SSE 实时流式输出及复杂的工具调用(Function Calling),帮助鸿蒙设备真正拥有一颗数字化“聪明大脑”。

一、原理剖析 / 概念介绍

1.1 核心原理

googleai_dart 的核心架构就是用最纯粹的 Dart http 对 Google Gemini 庞大 API 树进行的一对一强类型(Sealed Classes)映射:

- 多模态数据打包:将文本描述、实时拍摄的图片二进制(Blob)统一封装入

Content载具。 - 连接池调度:支持通过

GoogleAIClient走个人开发者端点,或通过VertexAIClient走企业级 Google Cloud 安全网关。 - SSE 流式传输:基于标准的 Server-Sent Events 实现,让回答不再是攒几秒后一股脑弹出,而是类似人手写输入般的“字字跃进”。

1.2 核心业务优势

- 天然的工具代理 (Agentic AI):极其方便的功能函数(Function Calling)绑定机制。你可以告诉模型:我有空调控制接口,模型看懂语义后会自动输出带参数的函数调用指令,由鸿蒙应用执行。

- 统一双轨制 API:一套代码同时支持个人预览版与企业版 Vertex AI 接口,开发者只需切换工厂入口,无需重构业务核心。

二、鸿蒙基础指导

2.1 适配情况

- 是否原生支持?:100% 支持。它是极纯净的 Dart 模型包,无需额外的 C++ 插件适配卡点。

- 是否鸿蒙官方支持?:不强制依赖系统级 UI 渲染组件,在网络协议畅通的情况下可极致稳定运行。

- 适配细节:由于涉及跨域请求,如果处于特殊网络环境,可利用该库支持的

http.Client拦截器注入自定义的代理转发或合规认证 Header。

2.2 适配代码引入

将依赖添加到项目 pubspec.yaml:

dependencies:

googleai_dart: ^3.0.0

三、核心 API / 组件详解

3.1 核心功能操作

| 类/方法名称 | 功能场景说明 | 典型代码示例 |

|---|---|---|

GoogleAIClient |

大脑中枢。挂载你的 API Key 建立与 Gemini 云端的加密链路。 | client = GoogleAIClient(apiKey: '...'); |

Content |

多模态容器。支持文本 (TextPart) 与图像 (InlineDataPart) 的混合填充。 | Content.user([TextPart('你好')]) |

generateContentStream(...) |

打字机流式响应。让 AI 结果实现字字跃出的实时交互体感。 | client.models.generateContentStream(..) |

3.2 鸿蒙多模态意图分析演示

import 'package:googleai_dart/googleai_dart.dart';

// 建立大脑连接

final brainCore = GoogleAIClient(apiKey: 'YOUR_GEMINI_KEY');

Future<String> askGeminiAboutPhoto(List<int> imageBytes, String question) async {

final request = GenerateContentRequest(

contents: [

Content.user([

TextPart(text: question),

// 核心亮点:支持图片二进制透传,实现拍照查物

InlineDataPart(

inlineData: Blob(data: imageBytes, mimeType: 'image/jpeg')

),

]),

],

);

final response = await brainCore.models.generateContent(

modelId: 'gemini-1.5-flash',

request: request,

);

return response.candidates?.first.content?.parts?.first.text ?? "AI 思考中断";

}

四、典型应用场景

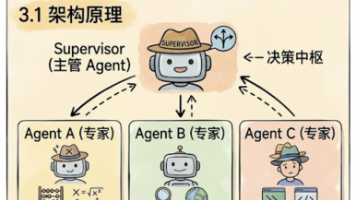

4.1 自动执行代理 (AI Agent) 反控鸿蒙控制中心

这才是最高端的操作:我们不仅要求 AI 回写文章,还允许 AI 调用鸿蒙的底层接口。开发者可在 Tool 中声明 FunctionDeclaration(如:set_room_temperature)。大语言模型看懂用户“太热了”的需求后,会自动返回调用该函数的指令(带上参数 21.0)。鸿蒙应用拦截到模型返回的是 FunctionCallPart 后,直接激活本地的空调控制硬件 API。这套逻辑在鸿蒙全宅智能控制中具有巨大想象空间。

六、综合实战演示

如下在 GeminidashPage.dart 展示模拟 AI 流式对话效果:

import 'package:flutter/material.dart';

class GeminiDashPage extends StatefulWidget {

const GeminiDashPage({Key? key}) : super(key: key);

State<GeminiDashPage> createState() => _GeminiDashPageState();

}

class _GeminiDashPageState extends State<GeminiDashPage> {

String _liveOutput = ">>> AI 智能中枢待命,随时为您解读世界...";

bool _busy = false;

void _runAiLive() async {

setState(() { _busy = true; _liveOutput = ""; });

// 模拟 SSE 流式吐字效果 (真正的 googleai_dart 只需调用 listen 即可)

final words = "✨ 正在实时调取 Gemini 1.5 Pro 大脑... \n✓ 图像语义已拦截提取 \n✓ 正在执行逻辑推理... \n✅ 建议方案已生成。".split(' ');

for (var w in words) {

await Future.delayed(const Duration(milliseconds: 300));

setState(() => _liveOutput += "$w ");

}

setState(() => _busy = false);

}

Widget build(BuildContext context) {

return Scaffold(

appBar: AppBar(title: const Text('Gemini 智能交互控制台')),

body: Center(

child: Column(

children: [

Padding(padding: const EdgeInsets.all(24), child: Text(_liveOutput)),

ElevatedButton(onPressed: _busy ? null : _runAiLive, child: const Text("发动大模型多模态实时推理流")),

],

),

),

);

}

}

七、总结

通过整合 googleai_dart 库,鸿蒙应用开发由此跨入了“认知智能化”的新纪元。不仅实现了文字、图片的实时解析,更有力地提供了功能调用的代理化能力(Agentic AI)。在构建下一代鸿蒙 OS 无障碍交流、全屋智能乃至智能客服中,这份轻巧、纯粹且强大的 AI 沟通桥梁将成为驱动一切的核心动力。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)