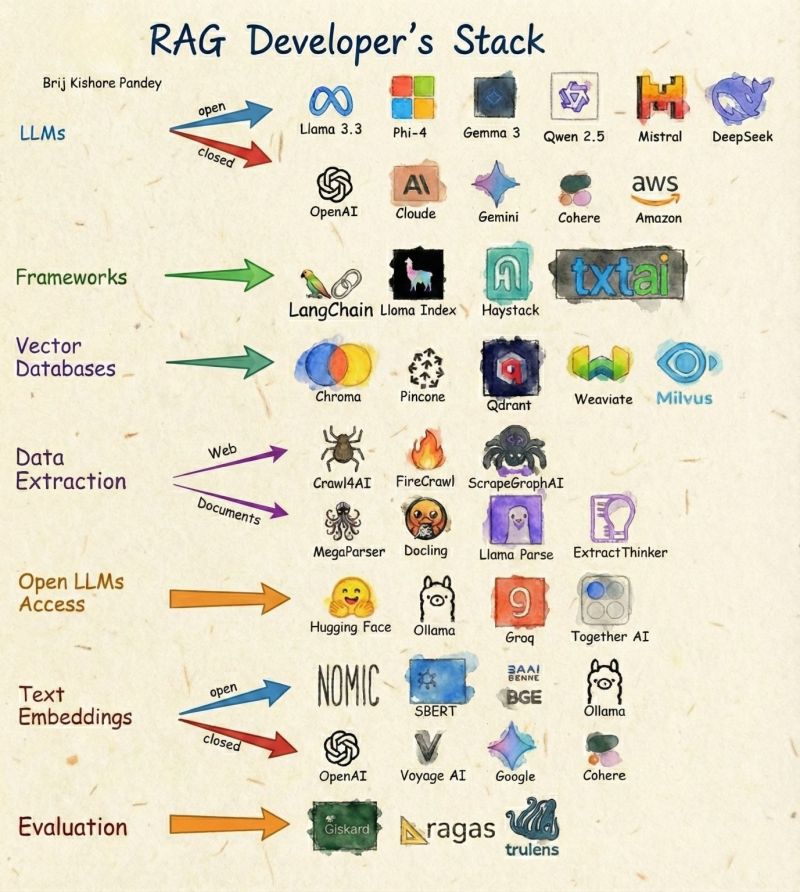

RAG 开发者全栈指南:从 “搜索 + LLM” 到完整工程化生态的演进

RAG已从临时解决方案发展为完整技术栈,涵盖数据提取、嵌入生成、向量存储、模型调度等7大层级。其核心价值是为大模型提供实时更新、专属定制的安全外部记忆,解决幻觉、知识更新和私有数据落地问题。生产级RAG需搭建全链路工程体系,而非简单拼接工具,关键在于数据质量、检索准确率和持续评估优化。当前RAG生态已成熟,开发者可根据场景选择各层工具,但需避免过度依赖大模型或忽视评估体系的误区。未来RAG将向标准

RAG is not a “technique.” It’s a whole ecosystem — and a developer’s stack.

在生成式 AI 全面落地的今天,检索增强生成(RAG)早已不是那个用来临时解决大模型幻觉的 “小技巧”。过去 18 个月里,RAG 已经悄无声息地完成了一次本质跃迁:从最初 “搜索 + LLM” 的简单拼接模式,进化成了一套完整、分层、体系化的工程化学科,成为了企业级 AI 落地的核心基础设施。

今天,构建一套生产级的 RAG 系统,早已不是 “选个大模型、写个检索逻辑” 就能完成的事。它需要开发者搭建一套覆盖数据提取、嵌入生成、向量存储、流程编排、模型调度、效果评估的全链路技术栈 —— 从闭源商用模型到开源创新方案,从本地轻量原型到企业级生产部署,每一层都有成熟的工具生态,也对应着严谨的选型逻辑。

本文将基于完整的 RAG 开发者技术栈全景图,逐层拆解每一层的核心定位、工具选型、生产级考量,帮你从 0 到 1 建立对 RAG 工程化体系的完整认知,搞懂从 Demo 到生产级系统的核心差距。

先搞懂本质:RAG 到底解决了什么核心问题?

在拆解技术栈之前,我们必须先对齐 RAG 的核心价值:它的本质,是为大模型装上 “可实时更新、可专属定制、可安全管控的外部记忆”,从根源上解决大模型的三大核心痛点:

- 幻觉问题:让大模型的回答完全基于检索到的真实、准确的上下文,而非模型内置的过时、错误的知识,从根源上降低幻觉风险;

- 知识更新难题:无需重新微调大模型,只需更新向量数据库中的知识内容,就能让大模型获取最新的信息,解决大模型 “知识截止日期” 的硬限制;

- 私有数据落地:让大模型能安全、合规地使用企业内部的私有文档、业务数据、专属知识,无需将敏感数据用于模型微调,完美适配企业级数据安全与合规要求。

正是这些不可替代的价值,让 RAG 从一个临时的 “补丁方案”,变成了今天生成式 AI 落地的标准范式。而支撑起这套范式的,就是一套完整的、分层的开发者技术栈。

RAG 开发者技术栈全拆解:7 大核心层级,从数据到评估的全链路闭环

一套完整的生产级 RAG 系统,从下到上分为 7 个核心层级,每一层各司其职、环环相扣,共同构成了 RAG 系统的完整工程体系。

第一层:数据提取层(Data Extraction)—— RAG 效果的天花板,由数据质量决定

这是 RAG 系统的最前端,是所有知识的入口,也是最容易被开发者忽略、却直接决定 RAG 效果上限的一层。脏数据、不完整的提取、混乱的格式,哪怕用再好的检索模型和大模型,也救不回来。

RAG 的核心是 “基于正确的上下文生成回答”,如果从源头提取的内容就是错误、缺失、混乱的,后续的所有环节都会偏离方向。这一层的核心职责,是把非结构化的网页、文档、表格、图片等内容,转化为干净、结构化、可被 RAG 系统利用的文本内容,分为两大核心场景:

1. 网页数据抓取

针对互联网网页、企业内部 Wiki、知识库站点,核心工具包括:

- FireCrawl:企业级网页抓取工具,支持整站爬取、动态内容渲染、结构化数据提取,能把杂乱的网页转化为干净的 markdown 格式,专为 RAG 场景优化,是目前生产级场景的首选;

- Crawl4AI:开源轻量网页抓取工具,支持 JavaScript 渲染、媒体内容提取、代理池,本地部署成本极低,适合原型开发和中小规模场景;

- ScrapeGraphAI:基于智能体的网页抓取工具,用大模型驱动网页内容的理解和提取,能自动适配不同的网页结构,适合复杂、非标准化的网页抓取场景。

2. 文档内容解析

针对 PDF、Word、PPT、Excel、扫描件等企业常见文档格式,核心解决 “复杂格式、表格、公式、图片内容的精准提取” 难题,核心工具包括:

- Llama Parse:Llama Index 官方推出的文档解析工具,专为 RAG 场景深度优化,支持复杂表格、数学公式、多模态内容提取,能完美保留文档的层级结构和语义逻辑,是目前企业级文档解析的标杆工具;

- Docling:开源文档解析框架,针对 PDF、Office 文档做了深度优化,能精准提取表格、章节、列表等结构化内容,输出标准化的 JSON 格式,完美适配后续的分块和嵌入流程;

- MegaParser、ExtractThinker:专注于复杂、非标准化文档的提取,支持扫描件 OCR、手写体识别、多语言混合文档解析,适合金融、法律等专业文档场景。

生产级选型建议:

- 快速原型开发、轻量场景:优先选择 Crawl4AI+Llama Parse,开箱即用,提取效果有保障;

- 企业级生产环境、大规模文档处理:优先选择 FireCrawl+Docling,支持高并发、可扩展部署,提取精度和稳定性更有保障;

- 专业领域文档(法律、金融、医疗):优先选择针对垂直领域优化的解析工具,重点保障表格、公式、专业术语的提取准确率。

第二层:文本嵌入层(Text Embeddings)—— RAG 的语义翻译官,决定检索的准确率

如果说数据提取决定了 RAG 的效果上限,那么嵌入模型就决定了 RAG 的效果下限。这一层的核心职责,是把人类语言的文本内容,转化为大模型和向量数据库能理解的高维向量表征,实现 “语义匹配” 而非简单的关键词匹配。

嵌入模型的质量,直接决定了检索环节的准确率 —— 哪怕你的向量数据库性能再强,用了不合适的嵌入模型,也根本检索不到与用户问题相关的上下文,最终的回答自然会偏离预期。这一层的工具分为开源与闭源两大阵营:

1. 闭源商用嵌入模型

开箱即用、准确率高、维护成本低,适合快速落地的商用场景:

- OpenAI Embeddings:最主流的闭源嵌入模型,text-embedding-3 系列支持多维度灵活调整,语义表征能力强,与 OpenAI 大模型完美适配,是 RAG 场景的通用首选;

- Voyage AI:专为 RAG 场景优化的嵌入模型,在长文档、多语言、垂直领域的检索准确率上,普遍优于通用嵌入模型,适合对检索精度要求极高的场景;

- Google、Cohere Embeddings:支持多语言、长上下文嵌入,Cohere 的多语言嵌入模型对小语种的适配性极佳,适合全球化的 RAG 场景。

2. 开源嵌入模型

可本地部署、数据完全可控、可针对垂直领域微调,适合私有化部署、数据敏感场景:

- BGE:智源研究院推出的开源嵌入模型,中文语义表征能力拉满,支持中英文双语、长上下文、多粒度检索,是中文 RAG 场景的绝对首选;

- NOMIC、SBERT:英文场景的经典开源嵌入模型,轻量高效、适配性强,支持本地部署和微调,适合英文知识库场景;

- Ollama Embeddings:Ollama 内置的嵌入模型支持,一键本地部署,能和本地大模型完美适配,是本地私有化 RAG 场景的最便捷选择。

生产级选型建议:

- 中文场景:优先选择 BGE 系列开源模型,或适配中文优化的闭源模型,避免用纯英文嵌入模型处理中文内容,导致检索准确率大幅下降;

- 私有化部署、数据敏感场景:必须选择可本地部署的开源嵌入模型,确保数据不会离开本地环境;

- 长文档场景:优先选择支持长上下文的嵌入模型,避免分块过细导致语义断裂,或分块过粗导致检索精度下降;

- 垂直领域场景:优先在通用嵌入模型的基础上,用领域内的专属数据做微调,大幅提升垂直场景的检索准确率。

第三层:向量数据库(Vector Databases)—— RAG 的记忆中枢,核心基础设施

向量数据库是 RAG 系统的核心存储组件,是连接私有数据与大模型的核心桥梁。它的核心职责,是存储嵌入模型生成的高维向量,支持高效的相似性检索,在用户提问时,快速召回与问题语义最相关的文本片段,为大模型提供准确的上下文。

过去两年,向量数据库赛道迎来了爆发式增长,从本地轻量工具到云端企业级服务,形成了完整的产品矩阵,核心工具包括:

- Chroma:开源轻量向量数据库,零配置、开箱即用,完美适配本地原型开发和小型项目,是 RAG 入门的首选;

- Pinecone:云端托管的向量数据库 SaaS 服务,零运维、弹性扩缩容、高并发低延迟,是目前商用 RAG 场景最主流的选择,无需关注底层部署,专注于业务逻辑;

- Qdrant、Milvus、Weaviate:开源企业级向量数据库,支持本地私有化部署、分布式集群扩展,功能完善、性能强劲,支持多模态数据、丰富的检索策略,是企业级生产环境的首选;

- PG Vector:PostgreSQL 的向量扩展插件,适合已经在使用 PostgreSQL 的业务场景,无需额外部署一套数据库,就能实现向量检索能力,降低架构复杂度和运维成本。

生产级选型建议:

- 本地原型开发、小型项目:优先选择 Chroma 或 PG Vector,零成本快速落地;

- 云端 SaaS 化部署、快速商用:优先选择 Pinecone,无需运维,弹性扩展,稳定性有保障;

- 企业级私有化部署、大规模数据场景:优先选择 Qdrant、Milvus,支持分布式集群,能应对亿级向量的高并发检索场景;

- 多模态 RAG 场景:优先选择 Weaviate、Milvus,对图片、音频、视频等多模态向量的支持更完善。

第四层:开源大模型接入层(Open LLMs Access)—— RAG 的模型灵活性保障

这一层的核心价值,是让 RAG 系统摆脱对单一闭源大模型的绑定,实现开源大模型的灵活接入、部署与调度,适配私有化部署、成本控制、定制化优化等多样化需求。

核心工具包括:

- Hugging Face:全球最大的开源大模型社区,提供了海量的开源大模型、推理工具、微调框架,是开源 RAG 系统的模型大本营,几乎所有主流开源模型都能在这里找到;

- Ollama:彻底降低了本地部署开源大模型的门槛,一行命令就能在本地电脑、服务器上部署 Llama、DeepSeek、Qwen 等主流开源模型,提供标准化的 API 接口,能完美适配所有 RAG 框架,是本地私有化 RAG 的核心工具;

- Groq、Together AI:开源模型的云端推理 API 服务,提供了极低的延迟、极高的吞吐量,成本远低于闭源大模型 API,适合规模化的开源模型 RAG 场景,无需自己部署和维护模型推理服务。

生产级选型建议:

- 本地开发、轻量私有化场景:优先选择 Ollama,一键部署,零运维成本,完美适配 RAG 场景;

- 规模化商用、不想自己维护模型:优先选择 Groq、Together AI,开箱即用的开源模型 API,成本低、延迟低,无需关注底层部署;

- 企业级深度定制、完全私有化:基于 Hugging Face 的生态,自行部署和微调开源大模型,实现完全的自主可控。

第五层:大语言模型层(LLMs)—— RAG 的生成引擎,最终输出的核心载体

大语言模型是 RAG 系统的最后一环,也是最终回答的生成者。它的核心职责,不是记住所有知识,而是基于检索到的准确上下文,结合用户的问题,生成准确、通顺、符合要求、无幻觉的回答。

很多人误以为 RAG 的效果取决于大模型的能力,但实际上,在一套完善的 RAG 系统中,大模型的核心作用是 “整理和表达”,而非 “记忆和创造”—— 只要上下文足够准确,哪怕是轻量的开源模型,也能生成远超通用大模型的准确回答。这一层的模型同样分为闭源与开源两大阵营:

1. 闭源商用大模型

推理能力强、开箱即用、适配复杂逻辑场景,是商用 RAG 系统的首选:

- OpenAI GPT 系列:目前最主流的闭源模型,GPT-4o、GPT-4o-mini 在推理能力、指令遵循、上下文理解上表现极佳,与 RAG 场景完美适配,是绝大多数商用 RAG 系统的默认选择;

- Anthropic Claude:超长上下文窗口(最高 200 万 token),完美适配超长文档、整本书籍的 RAG 场景,在法律、金融等长文档场景优势明显;

- Google Gemini、Cohere、AWS Amazon Bedrock:多模态能力强,支持多语言,提供了完整的企业级安全与合规能力,适合全球化、多模态的 RAG 场景。

2. 开源大模型

可本地部署、数据完全可控、可定制化微调,适合私有化部署、数据敏感场景:

- Llama 3.3、Mistral:Meta 和 Mistral 推出的主流开源模型,推理能力强、指令遵循好,是英文 RAG 场景的开源首选;

- DeepSeek、Qwen 2.5、Phi-4、Gemma 3:国产与轻量化开源模型,DeepSeek、Qwen 对中文的适配性极佳,Phi-4、Gemma 3 轻量高效,能在普通服务器甚至本地电脑上流畅运行,是中文 RAG 和轻量化部署的首选。

生产级选型建议:

- 通用商用场景、快速落地:优先选择 OpenAI GPT-4o-mini/GPT-4o,平衡成本、效果与稳定性;

- 长文档、法律 / 金融专业场景:优先选择 Claude 系列,超长上下文窗口能完美适配整份合同、财报的检索与生成;

- 中文场景、私有化部署:优先选择 DeepSeek、Qwen 系列开源模型,中文理解能力远超通用开源模型;

- 轻量部署、低延迟场景:优先选择 Phi-4、Gemma 3 等轻量模型,在保持效果的同时,大幅降低部署成本和延迟。

第六层:RAG 编排框架(Frameworks)—— RAG 系统的骨架,全链路的串联中枢

如果说前面的层级是 RAG 系统的 “器官”,那么编排框架就是 RAG 系统的 “骨架”。它的核心职责,是把数据加载、文本分块、嵌入生成、向量检索、重排优化、LLM 调用、提示词管理、异常处理这些环节,封装成可复用、可配置的模块,让开发者无需从零编写每一个环节的代码,快速搭建完整的 RAG 系统。

目前主流的 RAG 编排框架,已经形成了清晰的产品定位与生态划分:

- LangChain:目前生态最完善的大模型应用开发框架,对 RAG 的全链路环节提供了完整的支持,同时兼容多模型、多向量数据库、多工具调用,适合复杂的 “RAG + 智能体” 场景,是目前企业级大模型应用开发的事实标准;

- Llama Index:专为 RAG 场景深度优化的框架,在文档加载、分块策略、检索优化、嵌入管理上做了大量针对性优化,对文档密集型的知识库场景适配性极佳,是专注于 RAG 场景的首选框架;

- Haystack:面向企业级生产环境的 RAG 框架,提供了完善的流水线管理、可观测性、评估体系,支持分布式部署,适合大规模、高可用的商用 RAG 系统;

- txtai:轻量高效的开源 RAG 框架,把嵌入生成、向量检索、LLM 调用封装成极简的 API,零配置快速上手,适合原型开发、小型项目和轻量化场景。

生产级选型建议:

- 快速原型开发、轻量化场景:优先选择 txtai 或 Llama Index,极简上手,快速跑通 RAG 全流程;

- 文档密集型知识库、专业 RAG 场景:优先选择 Llama Index,针对 RAG 的优化更深入,检索策略更丰富;

- 复杂业务场景、RAG + 智能体融合:优先选择 LangChain,生态最完善,可扩展性最强,能适配复杂的业务逻辑;

- 企业级生产部署、高可用要求:优先选择 Haystack,生产级的运维、监控、部署能力更完善。

第七层:效果评估层(Evaluation)—— 生产级 RAG 与 Demo 的核心区别

这是 RAG 系统的 “质检中枢”,也是区分 Demo 玩具与生产级系统的核心标志。

绝大多数开发者搭建 RAG 系统,都只做到了 “能跑通”—— 输入一个问题,能返回一个回答,但却不知道这个回答好不好、准不准、有没有幻觉、哪里可以优化。而评估层的核心职责,就是让 RAG 的效果可量化、可追踪、可优化,建立完整的 “执行 - 评估 - 优化” 闭环。

没有评估体系的 RAG 系统,就像没有仪表盘的汽车,你根本不知道它跑的对不对、快不快,随时可能出问题。目前主流的 RAG 评估工具包括:

- Ragas:专为 RAG 场景设计的开源评估框架,提供了忠实度、答案相关性、上下文召回率、上下文精准度等核心评估指标,能自动化完成 RAG 系统的全链路效果评估,是目前 RAG 评估的首选工具;

- TruLens:专注于 LLM 应用的可观测性与评估,能追踪 RAG 系统的全链路执行过程,定位检索环节、生成环节的问题,帮助开发者针对性优化 RAG 系统;

- Giskard:偏向于企业级的 LLM 应用安全与合规评估,能检测 RAG 系统的幻觉、偏见、数据泄露、合规风险,适合金融、医疗等强监管场景的 RAG 系统评估。

生产级核心实践:生产级 RAG 系统,必须建立三级评估体系:

- 离线批量评估:用标注好的测试集,批量评估 RAG 系统的检索准确率、生成忠实度,验证版本迭代的效果优化;

- 线上实时评估:对线上每一次请求的回答质量做自动化评估,监控幻觉率、相关性等核心指标,出现异常及时告警;

- 用户反馈闭环:收集用户的点赞、点踩、修改意见,把用户反馈转化为评估数据,持续优化 RAG 系统的检索策略、提示词、嵌入模型。

完整的 RAG 系统工作流:7 大层级的协同闭环

讲完了每一层的核心定位,我们把它们串联起来,看一套完整的 RAG 系统,是如何从用户提问到生成回答,完成全链路的工作的:

- 知识入库流程:通过数据提取层,抓取网页、解析文档,把非结构化的内容转化为干净的文本;通过文本嵌入层,把文本分块并转化为向量表征;存入向量数据库,构建企业专属的知识库。

- 用户提问响应流程:

- 用户输入问题,编排框架先把问题交给文本嵌入层,转化为查询向量;

- 从向量数据库中做语义检索,召回与问题最相关的文本上下文;

- 编排框架把用户问题、检索到的上下文、系统提示词整合,交给大语言模型;

- 大模型基于上下文,生成准确、无幻觉的回答,返回给用户;

- 评估层对本次回答的质量做自动化评估,记录核心指标,持续优化整个系统。

这就是一套完整的生产级 RAG 系统的运行逻辑,它不是简单的 “搜索 + LLM”,而是 7 大层级协同工作的完整工程体系。

核心洞察:RAG 的竞争,是工程化体系的竞争

看完完整的技术栈拆解,我们就能明白行业里的核心共识:今天的 RAG,早已不是一个简单的技术技巧,而是一套完整的工程化学科。

很多开发者对 RAG 的认知,还停留在 “写个检索逻辑,调用一下大模型 API” 的阶段,但实际上,生产级 RAG 系统的核心差距,从来不是用了多强的大模型,而是整个技术栈的工程化能力。

这里有两个最常见的认知误区,必须纠正:

-

误区一:RAG 的效果取决于大模型的能力现实是:RAG 的效果下限,由数据提取和嵌入环节决定;RAG 的效果上限,由检索环节的准确率决定;大模型只是把检索到的内容,整理成通顺的回答。很多开发者花了大量时间优化大模型的提示词,却忽略了数据提取的质量和检索的准确率,最终本末倒置,无法解决根本问题。

-

误区二:RAG 系统搭起来就完事了现实是:Demo 级的 RAG 系统,只需要几个小时就能搭起来;但生产级的 RAG 系统,需要持续的优化、迭代、评估。一套没有评估体系、没有迭代闭环的 RAG 系统,上线之后效果只会越来越差,最终变成一个不可用的玩具。

写在最后:RAG 的未来,是标准化的工程化基础设施

过去 18 个月,RAG 的生态已经完成了从 “零散工具” 到 “完整体系” 的跃迁。今天,开发者不再需要从零搭建每一个环节,只需要根据业务场景,在每一层选择合适的工具,就能快速搭建一套生产级的 RAG 系统。

未来,RAG 会继续朝着标准化、工程化、一体化的方向演进,从 “需要开发者拼接的管道”,变成开箱即用的基础设施。但无论工具如何迭代,RAG 的核心本质永远不会变:让大模型基于准确、实时、专属的知识,生成可靠、合规、有价值的回答,真正把 AI 能力落地到具体的业务场景中。

对于开发者而言,掌握完整的 RAG 技术栈,理解每一层的核心逻辑与选型策略,已经成为 AI 时代的核心竞争力。毕竟,能真正落地到业务中、创造实际价值的 AI 系统,从来不是靠一个强大的大模型,而是靠一套完整、严谨、可优化的工程化体系。

更多推荐

已为社区贡献104条内容

已为社区贡献104条内容

所有评论(0)