【OpenAI】轻量级AI助手全攻略:模型选型、微调实操与架构搭建指南获取OpenAI API KEY的两种方式,开发者必看全方面教程!

随着人工智能技术的飞速发展,越来越多的企业和个人开始尝试将AI助手应用到客服、内容创作、代码辅助等场景中。然而,主流大模型往往体积庞大、资源消耗高,部署和维护成本极高。轻量级AI助手因此应运而生,成为“降本增效”的利器。小张是一名创业者,想打造一款智能客服机器人,但苦于服务器资源有限,无法承载大型模型。通过本文介绍的轻量级模型和微调技巧,他成功搭建了一个响应迅速、效果优异的AI助手,节省了大量成本

【详解】轻量级AI助手打造全攻略:模型选型+微调教程+实战架构,零基础也能快速上手!

你是否也在为如何打造一个高效、轻量级的AI助手而苦恼?市面上模型繁多,微调复杂,架构搭建更是让人头疼。别急!本文将带你从零开始,手把手教你如何选模型、做微调、设计提示词,最终搭建出一套实用的智能助手系统。无论你是AI小白还是开发老手,都能从中获得干货!

前言:为什么轻量级AI助手成为新风口?

随着人工智能技术的飞速发展,越来越多的企业和个人开始尝试将AI助手应用到客服、内容创作、代码辅助等场景中。然而,主流大模型往往体积庞大、资源消耗高,部署和维护成本极高。轻量级AI助手因此应运而生,成为“降本增效”的利器。

小张是一名创业者,想打造一款智能客服机器人,但苦于服务器资源有限,无法承载大型模型。通过本文介绍的轻量级模型和微调技巧,他成功搭建了一个响应迅速、效果优异的AI助手,节省了大量成本。

这就是轻量级AI助手的魅力所在——用有限资源,创造无限可能!

目录

一、轻量级模型选型详解

1. 为什么选择轻量级模型?

大模型虽然强大,但对硬件要求极高,训练和推理成本不菲。轻量级模型则在性能和资源消耗之间找到平衡,适合中小企业和个人开发者。

2. 主流轻量级模型推荐

| 模型名称 | 参数量 | 适用场景 | 优缺点 |

|---|---|---|---|

| GPT-2 Medium | 345M | 入门级对话、文本生成 | 资源需求低,效果稳定 |

| GPT-Neo 1.3B | 1.3B | 对话、代码辅助 | 性能提升明显,资源适中 |

| GPT-J 6B | 6B | 复杂文本、代码生成 | 性能强大,资源需求较高 |

| LLaMA 7B | 7B | 多任务通用 | 开源灵活,社区支持好 |

| CodeGen 2B | 2B | 代码生成 | 专注代码,生成质量高 |

3. 蒸馏与量化技术

- 模型蒸馏:通过训练小模型模仿大模型行为,显著降低推理成本。

- 量化:将模型权重从32位浮点数压缩到8位甚至4位,减少显存占用。

例如,小李通过对GPT-J 6B进行8-bit量化,推理速度提升了3倍,成本降低了70%。

二、微调策略与实操教程

1. 数据准备

微调的第一步是准备高质量的数据。根据应用场景不同,数据类型也有所区别:

- 对话数据:如PersonaChat、DailyDialog、OpenSubtitles等,适合训练对话型助手。

- 代码数据:如CodeSearchNet、GitHub开源项目,适合代码生成和辅助。

- 文本数据:行业报告、专业文章等,适合内容生成和专业问答。

确保数据的多样性和质量,是微调成功的关键。

2. 微调方法详解

LoRA微调(低秩适配)

LoRA是一种高效的微调技术,它只训练模型中的少量参数(低秩矩阵),大幅降低显存需求和训练时间,同时保持模型性能。其核心思想是通过添加可训练的低秩权重矩阵,来适配预训练模型,而无需修改原始模型参数。

优势:

- 显著减少训练参数量,节省计算资源。

- 训练速度快,适合资源有限的环境。

- 方便与其他微调技术结合使用。

混合精度训练

采用FP16或BF16混合精度训练,能够提升训练速度和显存利用率,同时保持模型精度。

学习率调节与早停机制

合理设置学习率调度(如warm-up和cosine decay),结合早停机制,防止模型过拟合,提高泛化能力。

3. 训练指标监控

- 对话任务:关注BLEU、ROUGE等自动评价指标,同时结合人工评估对话连贯性和自然度。

- 代码生成:关注代码准确率、语法正确率及执行通过率。

- 文本生成:评估语言流畅度、专业度和信息完整性。

持续监控指标,及时调整训练策略,确保微调效果最佳。

三、提示词设计技巧与案例

1. 提示词的重要性

提示词是引导模型生成高质量输出的关键。设计得当的提示词能显著提升模型理解和响应能力。

2. 常用提示词模板

-

对话助手

明确角色身份和风格,增强对话的自然感和专业度。

例如:

“你是一个专业且友好的助手,能够理解用户的情绪和需求,提供准确且富有同理心的回答。用户:{用户输入},助手:” -

文章生成

明确主题和写作要求,确保内容结构清晰、语言流畅。

例如:

“请根据以下主题撰写一篇结构清晰、语言流畅且内容丰富的文章:主题:{主题内容},文章:” -

代码辅助

明确编程语言和功能需求,提升代码生成的准确性和实用性。

例如:

“你是资深程序员,能够理解并生成高质量代码。请根据需求完成代码编写或优化。需求:{具体需求描述},代码:”

3. 上下文与角色设定

- 在提示词中加入历史对话或代码上下文,帮助模型理解当前任务。

- 设定明确的角色身份,规范回答风格和语气。

四、应用架构搭建全流程

1. 前端设计

- 支持多轮对话上下文管理,自动拼接历史消息,提升交互体验。

- 代码块高亮显示,支持复制和下载功能,方便用户使用。

- 多终端支持,包括Web端和移动端,满足不同用户需求。

2. 后端部署

- 采用容器化部署(如Docker、Kubernetes),方便扩展和维护。

- 引入异步队列(如RabbitMQ、Kafka)提升系统吞吐量和响应速度。

- 利用缓存机制(如Redis)降低模型调用频率,提升效率。

3. 数据管理与监控

- 持续收集用户交互数据,进行标注和清洗,优化训练数据集。

- 实时监控系统性能和用户反馈,快速定位问题并迭代升级。

4. 扩展功能

- 集成知识库检索,结合检索增强生成(RAG)技术,提升回答准确性。

- 支持多模态输入(如图片、文档),丰富交互形式。

轻量级AI助手不仅能帮助你节省成本,还能快速响应多样化需求。通过合理选型、科学微调和精心设计提示词,你完全可以打造出媲美大模型的智能助手。

第二种方式(国内):获取 能用AI API Key

要开始使用 能用AI 的服务,以下是获取 API Key 的详细步骤:

1. 点击 [能用AI 工具]

在浏览器中打开 能用AI 工具。

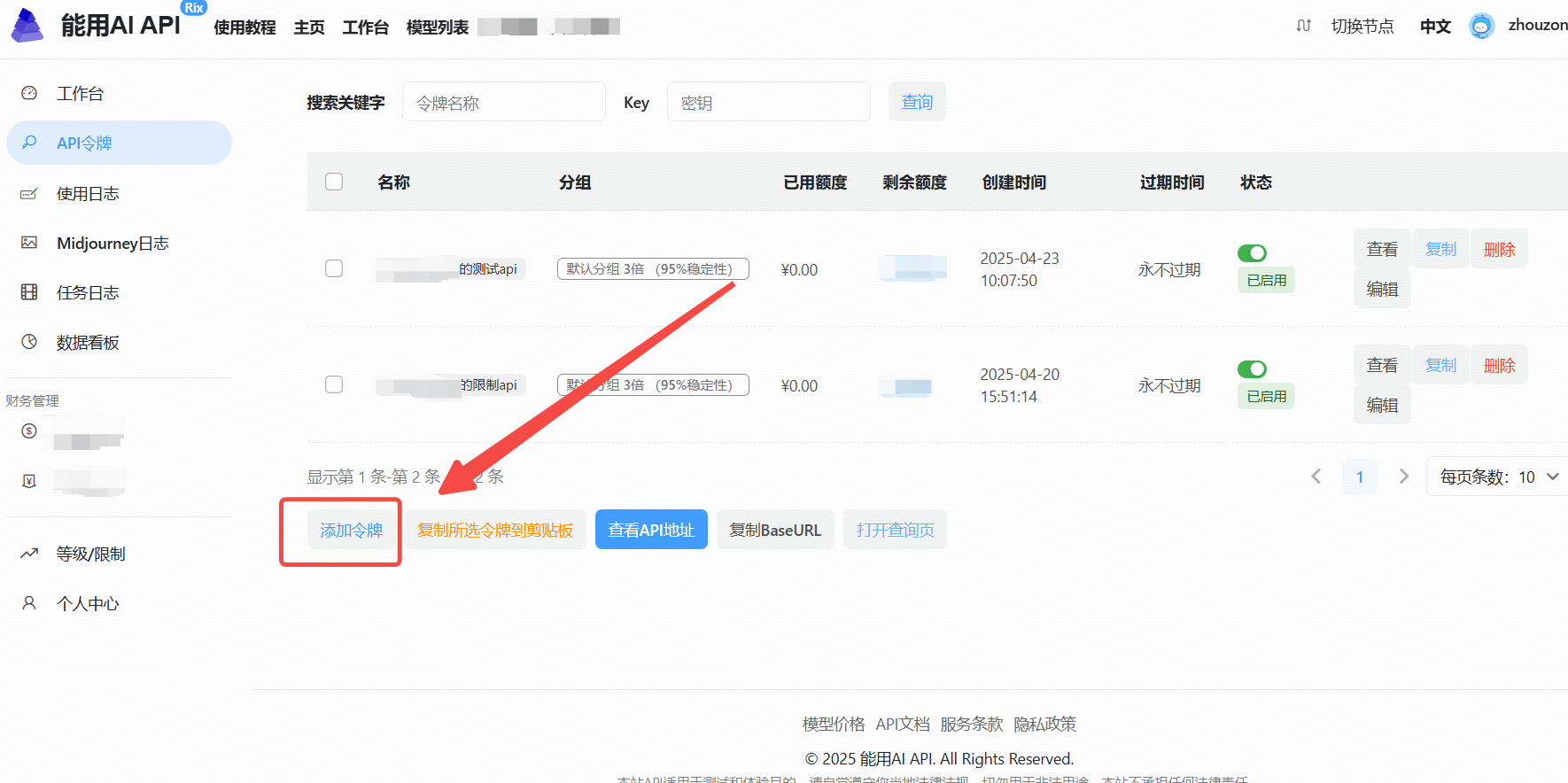

2. . 进入 API 管理界面

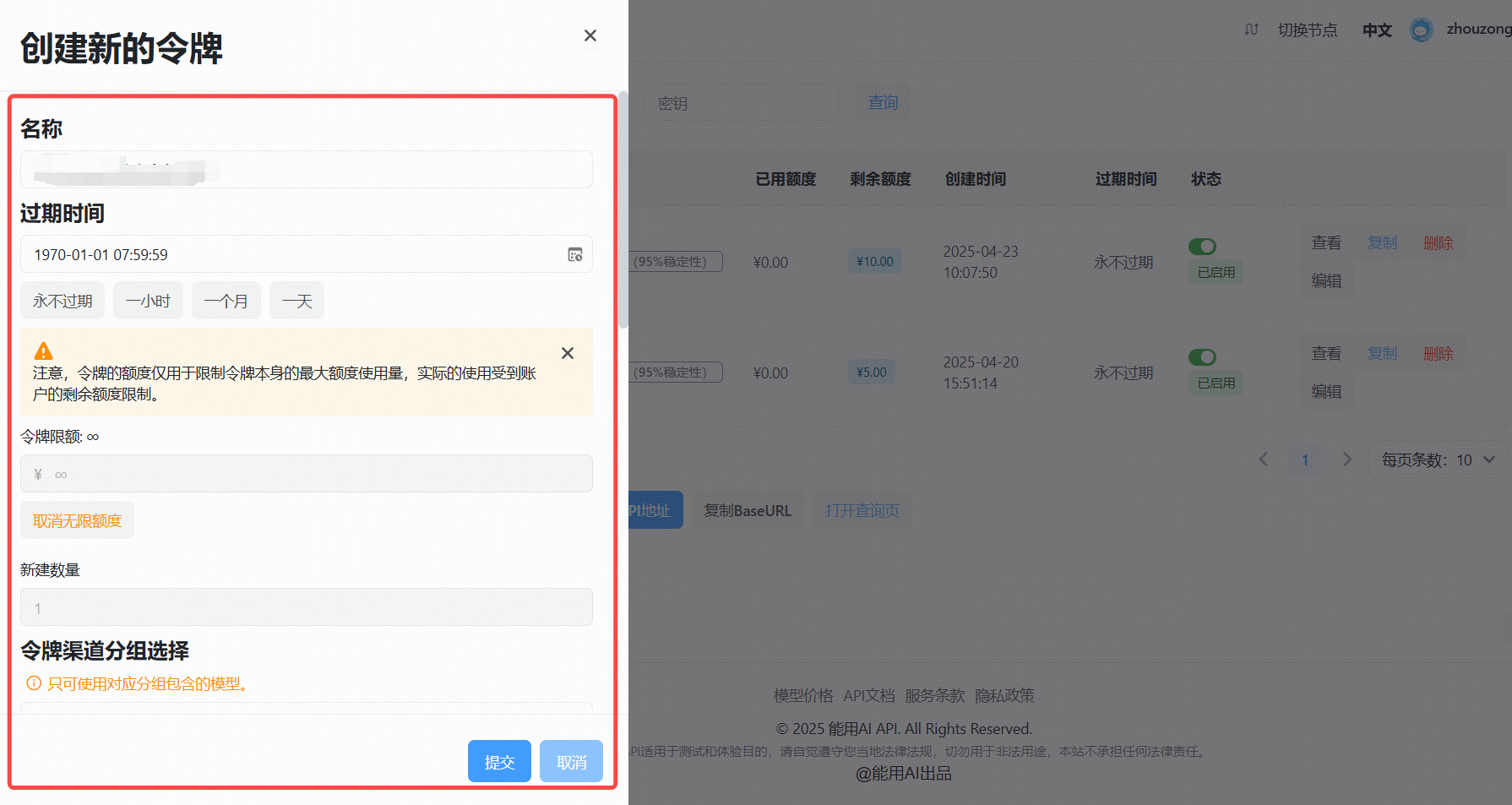

3. 生成新的 API Key

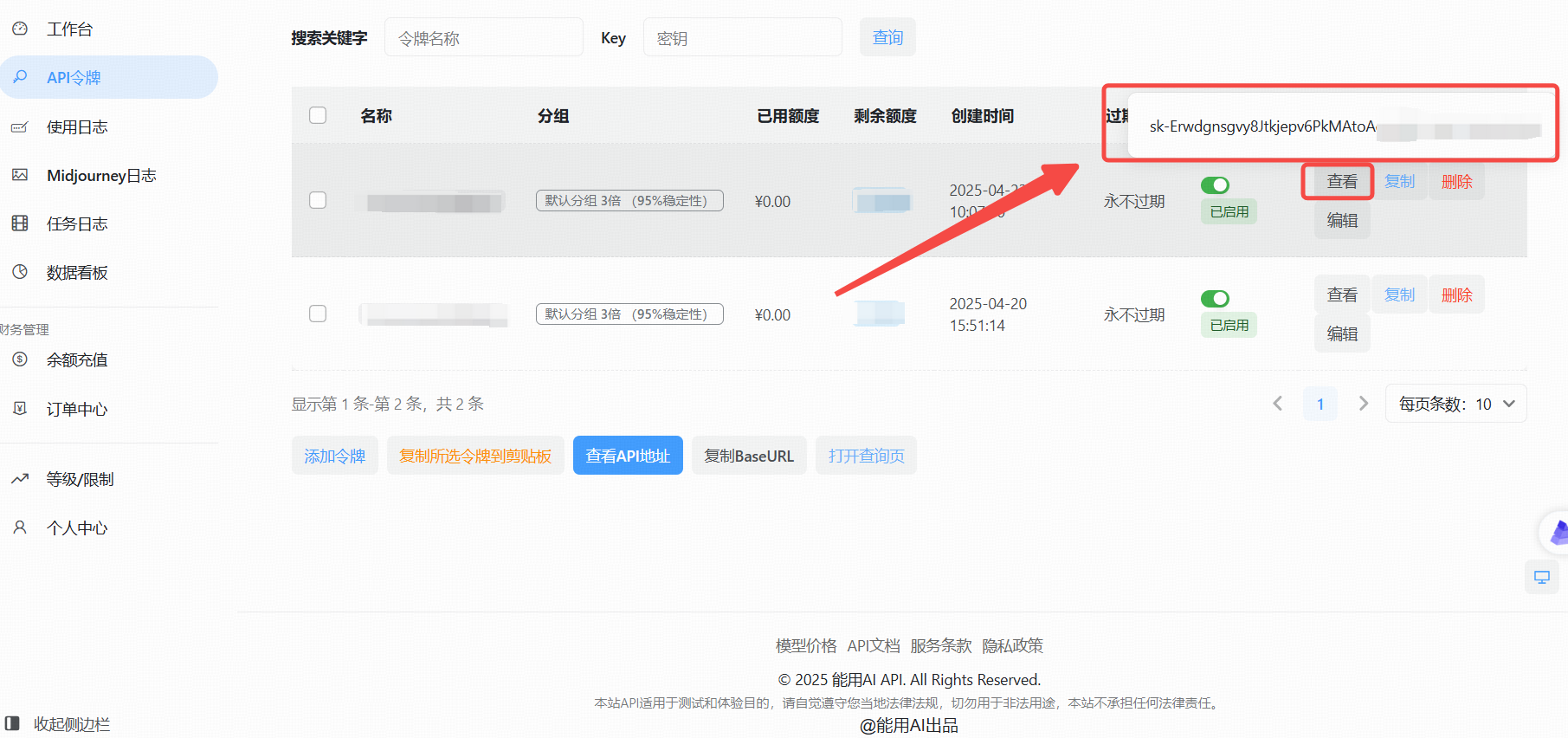

创建成功后点击“查看KEY”

4. 调用代码使用 能用AI API

# [调用API:具体模型大全](https://flowus.cn/codemoss/share/42cfc0d9-b571-465d-8fe2-18eb4b6bc852)

from openai import OpenAI

client = OpenAI(

api_key="这里是能用AI的api_key",

base_url="https://ai.nengyongai.cn/v1"

)

response = client.chat.completions.create(

messages=[

{'role': 'user', 'content': "鲁迅为什么打周树人?"},

],

model='gpt-4',

stream=True

)

for chunk in response:

print(chunk.choices[0].delta.content, end="", flush=True)

总结

通过以上步骤,你已经掌握了如何获取和使用 OpenAI API Key 的基本流程。无论你是开发者还是技术爱好者,掌握这些技能都将为你的项目增添无限可能!🌟

更多推荐

已为社区贡献75条内容

已为社区贡献75条内容

所有评论(0)