从迷失到全知:SLAM技术全景解析与2026实战入门指南

SLAM不仅是数学公式的堆砌,更是机器人感知世界的眼睛和大脑。从早期的滤波方法到如今的图优化、神经辐射场与大模型融合,SLAM技术正在经历前所未有的爆发。对于入门者,“动手”胜过“空想”。不要畏惧复杂的数学推导,当你在屏幕上看到机器人画出的轨迹与真实路径完美重合,当稀疏的点云逐渐构建出房间的轮廓时,那种成就感是无与伦比的。2026年,SLAM的下半场已经开启:从“构建地图”走向“理解世界”。愿你在

摘要:同步定位与建图(SLAM, Simultaneous Localization and Mapping)是机器人实现自主导航的“圣杯”技术。本文从零开始,系统拆解SLAM的数学原理、核心算法架构、传感器选型及工程落地难点。结合2026年最新技术趋势(如NeRF-SLAM、大模型辅助语义建图),为初学者提供一条从理论推导到代码实战的完整进阶路径。无论你是学生、研究者还是工程师,本文都将是你进入SLAM领域的最佳敲门砖。

一、引言:机器人的“自我认知”觉醒

想象一下,你被蒙住双眼扔进一个完全陌生的房间。你需要回答两个问题:

我在哪?(定位,Localization)

房间长什么样?(建图,Mapping)

如果你能一边移动,一边在脑海中构建房间的地图,并实时知道自己在这张地图上的位置,你就完成了人类版的SLAM。对于机器人而言,这是实现真正自主(Autonomy)的前提。

1.1 为什么SLAM如此困难?

SLAM被称为“鸡生蛋,蛋生鸡”的问题:

要精准定位,需要一张完美的地图。

要构建完美的地图,需要精准的定位轨迹。

两者相互依赖,且都受到传感器噪声、环境动态变化、计算资源限制的干扰。解决这一耦合问题,正是SLAM技术的核心魅力所在。

1.2 2026年SLAM技术新貌

传统的几何SLAM已趋于成熟,2026年的SLAM正呈现以下新特征:

语义化:从“点云地图”进化为“可理解的对象地图”(如:这是椅子,那是门)。

神经辐射场(NeRF)融合:利用隐式神经表示构建高保真稠密地图。

大模型辅助:利用VLA(视觉 - 语言 - 动作)模型进行闭环检测和重定位。

多传感器紧耦合:激光、视觉、IMU、轮速计的深度融成为标配。

二、SLAM数学基石:不推导公式,无法入门

SLAM的本质是一个状态估计问题。我们需要在概率框架下,根据带有噪声的观测数据,推断机器人的状态和地图。

2.1 核心状态向量

定义 tt时刻的状态向量 xtxt和地图 mm:

xt=[pt,qt,vt,ba,bg]Txt=[pt,qt,vt,ba,bg]T

其中:

- pt : 位置 (3D)

- qtqt : 姿态/四元数 (4D)

- vtvt : 速度 (3D)

- ba,bgba,bg : IMU加速度计和陀螺仪的零偏

地图 mm通常由一系列路标点(Landmarks)组成: m={l1,l2,...,lN}m={l1,l2,...,lN} 。

2.2 两大核心方程

1. 运动方程(预测)

描述机器人如何随时间运动:

xt=f(xt−1,ut)+wtxt=f(xt−1,ut)+wt

- utut : 控制输入(如电机转速、IMU读数)

- wtwt : 过程噪声(服从高斯分布)

2. 观测方程(更新)

描述机器人看到了什么:

zt=h(xt,m)+vtzt=h(xt,m)+vt

- ztzt : 传感器观测(如激光雷达点、图像特征点)

- vtvt : 观测噪声

2.3 求解目标:最大后验概率(MAP)

SLAM的目标是找到最可能的状态序列 XX 和地图 MM ,使得后验概率最大化:

X∗,M∗=argmaxX,MP(X,M∣Z,U)X∗,M∗=argX,MmaxP(X,M∣Z,U)

通过贝叶斯法则转化,这通常等价于最小化重投影误差或点云配准误差的非线性最小二乘问题:

minX,M∑∥zt−h(xt,m)∥Σ2X,Mmin∑∥zt−h(xt,m)∥Σ2

求解工具:

- 扩展卡尔曼滤波 (EKF):早期主流,适用于小规模,但线性化误差大。

- 非线性优化 (Graph SLAM):当前主流(如g2o, Ceres),将问题建模为因子图,精度更高,适合大规模场景。

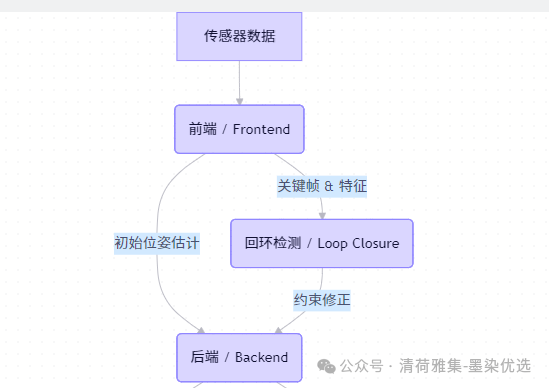

三、SLAM系统架构:前端、后端与回环

一个完整的SLAM系统通常包含四个核心模块:

3.1 前端(Visual Odometry / Lidar Odometry)

任务:处理原始传感器数据,估计相邻帧之间的相对运动,提供初始位姿 guess。

-

视觉前端 (VO):

- 优点:半稠密/稠密地图,无纹理区可用。

- 缺点:对光照变化极度敏感。

- 优点:抗光照变化,计算量可控。

- 缺点:纹理缺失区域失效。

- 特征点法:提取ORB/SIFT特征,匹配,PnP解算位姿。代表:ORB-SLAM3。

- 直接法:直接利用像素灰度信息,最小化光度误差。代表:DSO, SVO。

-

激光前端 (LO):

- 点云配准:ICP (Iterative Closest Point) 及其变种(NDT, GICP)。

- 特征匹配:提取线特征、面特征进行匹配。代表:LOAM, LeGO-LOAM。

3.2 后端(Optimization)

任务:消除累积误差(漂移),全局优化轨迹和地图。

- 滤波器后端:EKF-SLAM。维护协方差矩阵,计算复杂度 O(N2)O(N2) ,难以扩展。

- 图优化后端:

- 构建因子图:节点是位姿和路标,边是约束(观测或运动)。

- 使用高斯 - 牛顿法或列文伯格 - 马夸尔特法 (LM) 迭代求解。

- 关键库:g2o, Ceres Solver, GTSAM。

3.3 回环检测(Loop Closure)

任务:识别“我曾经来过这里”,纠正长期累积的漂移。

- 基于外观:使用词袋模型(Bag of Words, BoW)将图像/点云转换为向量,计算相似度(DBoW2/DBoW3)。

- 基于几何:验证候选回环的几何一致性(RANSAC)。

- 2026新趋势:利用深度学习描述子(如NetVLAD)或大模型语义匹配,提高动态环境和视角剧烈变化下的鲁棒性。

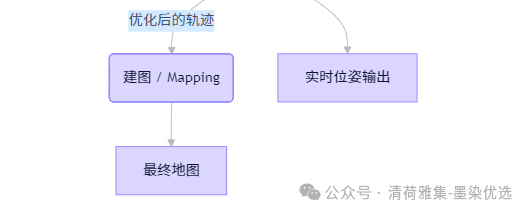

3.4 建图(Mapping)

- 栅格地图 (Occupancy Grid):2D导航常用,每个格子记录占用概率。

- 点云地图 (Point Cloud):3D激光SLAM常用,存储稀疏或稠密点。

- 八叉树地图 (OctoMap): probabilistic 3D占据网格,支持多分辨率。

- 语义地图:不仅有点,还有物体类别标签。

- NeRF地图:隐式神经表示,可实现照片级重建和新视角合成。

四、主流传感器方案对比与选型

| 传感器组合 | 代表算法 | 优势 | 劣势 | 适用场景 |

| :--- | :--- | :--- | :--- :--- |

|单目相机| ORB-SLAM3, DSO | 成本极低,信息丰富 | 尺度不确定,弱纹理失效 | 无人机,AR/VR,低成本小车 |

|双目/RGB-D| ORB-SLAM3, ElasticFusion | 自带尺度,深度信息直接 | 测距范围有限,受光照影响 | 室内服务机器人,避障 |

|激光雷达 (LiDAR)| LOAM, FAST-LIO2, LIO-SAM | 精度高,不受光照影响,测距远 | 成本高,无法识别语义,玻璃反射 | 自动驾驶,室外巡检,仓储物流 |

|视觉+IMU (VIO)| VINS-Fusion, OKVIS | 高频,抗运动模糊,有尺度 | 标定复杂,长时间运行有漂移 | 高速无人机,手持设备 |

|激光+IMU (LIO)| FAST-LIO2, R3LIVE | 极高精度,强鲁棒性,实时性好 | 硬件成本高,算力要求高 | 自动驾驶,复杂地形机器人 |

|多传感器融合| R2LIVE, MSCKF | 取长补短,极致鲁棒 | 系统极其复杂,标定困难 | 全场景通用机器人 |

五、2026年SLAM前沿趋势

5.1 神经SLAM (Neural SLAM)

传统几何方法难以处理反光、透明物体和动态场景。NeRF-SLAM和3D Gaussian Splatting SLAM正在崛起。它们利用神经网络隐式表达场景,不仅能定位,还能生成极其逼真的三维重建。

挑战:训练时间长,实时性仍在优化中(2026年已有实时版本)。

5.2 语义SLAM (Semantic SLAM)

从“几何一致性”走向“语义一致性”。

- 利用Segment Anything Model (SAM) 等分割大模型,实时提取物体掩码。

- 构建对象级地图:机器人知道“前面5米有一把椅子”,而不仅仅是“前面5米有一团点云”。这对人机交互和长周期导航至关重要。

5.3 终身SLAM (Lifelong SLAM)

环境是动态变化的(家具移动、季节变化)。传统SLAM假设静态环境。

- 新一代系统具备地图更新机制,能区分“临时动态物体”和“永久性环境改变”,自动更新地图而不导致定位丢失。

5.4 云端协同SLAM

- 机器人本地运行轻量级前端,将关键帧上传云端。

- 云端利用强大算力进行全局优化、大规模回环检测和地图融合,再下发给机器人。实现多机器人共享一张全局地图。

六、实战入门:如何迈出第一步?

6.1 知识储备清单

- 数学:线性代数(矩阵分解、SVD)、概率论(贝叶斯、高斯分布)、李群李代数(SO(3), SE(3))。

- 编程:C++ (必须,追求性能), Python (原型验证), Linux/CMake。

- 工具:ROS/ROS2, Eigen, OpenCV, PCL, g2o/Ceres。

6.2 推荐学习路线

第一阶段:理论奠基(2-4周)

- 必读书籍:《视觉SLAM十四讲》(高翔 著)—— 中文SLAM界的“圣经”,理论与代码并重。

- 补充阅读:《Probabilistic Robotics》(Thrun 著)—— 概率机器人学基础。

- 重点:手推卡尔曼滤波,理解李代数求导。

第二阶段:代码复现(1-2个月)

- Hello World:跑通 ORB-SLAM3 或 FAST-LIO2。

- 下载代码,编译,运行公开数据集(EuRoC, KITTI, TUM)。

- 关键动作:不要只跑通,要尝试修改参数,观察轨迹变化;尝试关闭回环检测,看漂移有多大。

- 迷你项目:

- 用C++写一个简单的2D EKF-SLAM(模拟机器人移动和观测路标)。

- 实现一个简单的ICP点云配准算法。

第三阶段:深入源码与改进(3个月+)

- 阅读源码:深入ORB-SLAM3的

Tracking,LocalMapping,LoopClosing线程逻辑。 - 数据集调试:在自己的采集数据上测试,处理标定、时间同步问题。

- 创新尝试:

- 尝试接入深度学习特征(SuperPoint/SuperGlue)替换ORB。

- 尝试将语义信息融入后端优化。

6.3 常用开源项目推荐 (2026版)

| 项目名称 | 类型 | 语言 | 特点 | GitHub Stars |

|---|---|---|---|---|

| ORB-SLAM3 | Visual/VIO | C++ | 功能最全,支持单目/双目/RGB-D/鱼眼,多地图复用 | 9k+ |

| FAST-LIO2 | LiDAR-IMU | C++ | 速度极快,无需地面提取,鲁棒性强 | 3k+ |

| VINS-Fusion | VIO | C++ | 融合GPS,支持多传感器,经典之作 | 4k+ |

| OpenVINS | VIO | C++ | 模块化设计好,适合二次开发和教学 | 1.5k+ |

| Kimera-VIO | VIO+Semantic | C++ | 输出度量语义网格地图 | 1k+ |

| SplaTAM | Neural SLAM | Python/C++ | 基于3D Gaussian Splatting的实时SLAM | 新兴热门 |

七、常见坑点与调试技巧

- 时间同步:这是新手最容易忽视的问题。相机、IMU、雷达的时间戳必须严格对齐(硬件触发或软同步插值),否则会导致轨迹发散。

- 外参标定:传感器之间的相对位置(Extrinsics)不准,SLAM必挂。务必使用高精度标定板和方法(如Kalibr)。

- 初始化:VIO系统对初始化敏感(如需要静止或特定运动)。调试时关注初始化是否成功。

- 参数调优:噪声协方差矩阵( Q,RQ,R )不是越大越好,需要根据传感器datasheet和实际测试调整。

- 动态物体:在人流密集区,传统SLAM容易跟丢。尝试使用动态点剔除策略(如DynSLAM思路)。

八、结语:从算法到智能

SLAM不仅是数学公式的堆砌,更是机器人感知世界的眼睛和大脑。从早期的滤波方法到如今的图优化、神经辐射场与大模型融合,SLAM技术正在经历前所未有的爆发。

对于入门者,“动手”胜过“空想”。不要畏惧复杂的数学推导,当你在屏幕上看到机器人画出的轨迹与真实路径完美重合,当稀疏的点云逐渐构建出房间的轮廓时,那种成就感是无与伦比的。

2026年,SLAM的下半场已经开启:从“构建地图”走向“理解世界”。愿你在这场技术浪潮中,找到属于自己的坐标。

附录:学习资源索引

书籍:《视觉SLAM十四讲:从理论到实践》(第2版)

更多精彩推荐:

Android开发集

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选从 AIDL 到 HIDL:跨语言 Binder 通信的自动化桥接与零拷贝回调优化全栈指南

C/C++编程精选

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选宏之双刃剑:C/C++ 预处理器宏的威力、陷阱与现代化演进全解

开源工场与工具集

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选nlohmann/json:现代 C++ 开发者的 JSON 神器

MCU内核工坊

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选STM32:嵌入式世界的“瑞士军刀”——深度解析意法半导体32位MCU的架构演进、生态优势与全场景应用

拾光札记簿

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选周末遛娃好去处!黄河之巅畅享亲子欢乐时光

数智星河集

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选被算法盯上的岗位:人工智能优先取代的十大职业深度解析与人类突围路径

Docker 容器

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选Docker 原理及使用注意事项(精要版)

linux开发集

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选零拷贝之王:Linux splice() 全面深度解析与高性能实战指南

青衣染霜华

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选脑机接口:从瘫痪患者的“意念行走”到人类智能的下一次跃迁

QT开发记录-专栏

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选Qt 样式表(QSS)终极指南:打造媲美 Web 的精美原生界面

Web/webassembly技术情报局

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选WebAssembly 全栈透视:从应用开发到底层执行的完整技术链路与核心原理深度解析

数据库开发

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选ARM Linux 下 SQLite3 数据库使用全方位指南

鸿蒙开发全系列教程

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选掌握鸿蒙生态开发利器:ohpm 命令全解析与高效开发实战指南

具身智能时代:机器人开发全栈技术图谱与实战指南(2026版)

青衣霜华渡白鸽,公众号:清荷雅集-墨染优选具身智能时代:机器人开发全栈技术图谱与实战指南(2026版)

更多推荐

已为社区贡献29条内容

已为社区贡献29条内容

所有评论(0)